Mistral 3 ialah keluaran utama bagi keluarga model Mistral AI lewat 2025. Ia menghadirkan gabungan model padat dan pantas yang disesuaikan untuk penyebaran setempat/edge serta model perdana berasaskan sparse yang sangat besar yang mendorong skala dan panjang konteks termaju. Artikel ini menerangkan apa itu Mistral 3, bagaimana ia dibina, mengapa anda mungkin mahu menjalankannya secara setempat, dan tiga cara praktikal untuk menjalankannya pada mesin atau pelayan peribadi anda — daripada kemudahan “klik-untuk-jalankan” Ollama kepada penyajian GPU produksi dengan vLLM/TGI, hinggalah inferens CPU peranti kecil menggunakan GGUF + llama.cpp.

Apakah itu Mistral 3?

Mistral 3 ialah generasi terkini model open-weight daripada Mistral AI. Keluarga ini merangkumi Mistral Large 3 yang besar (model sparse Mixture-of-Experts — MoE) serta beberapa varian edge/“ministral” (3B, 8B, 14B) yang ditala untuk pematuhan arahan dan tugasan multimodal (teks+penglihatan). Mistral memposisikan keluaran ini untuk kegunaan yang meluas: daripada inferens pusat data berprestasi tinggi (dengan checkpoint khusus yang dioptimumkan) kepada penggunaan di edge dan komputer riba melalui format terkuantum dan varian yang lebih kecil.

Sifat praktikal utama :

- Seni bina Mixture-of-Experts (MoE) dalam varian Large 3 yang menghasilkan bilangan parameter “jumlah” yang sangat besar sambil hanya mengaktifkan subset pakar bagi setiap token — ini meningkatkan kecekapan pada skala besar.

- Keluarga Ministral 3 (3B / 8B / 14B) untuk kegunaan edge dan setempat, dengan varian bertala arahan dan multimodal.

- Checkpoint rasmi dan set checkpoint yang dioptimumkan (NVFP4/FP8) untuk runtime dipercepat seperti vLLM dan platform NVIDIA.

- Berbilang mod + berbilang bahasa + konteks panjang — varian ministers dan varian besar menekankan kefahaman imej+teks dan liputan bahasa yang luas. Bagi aplikasi yang menggabungkan imej + dokumen panjang, ini penting.

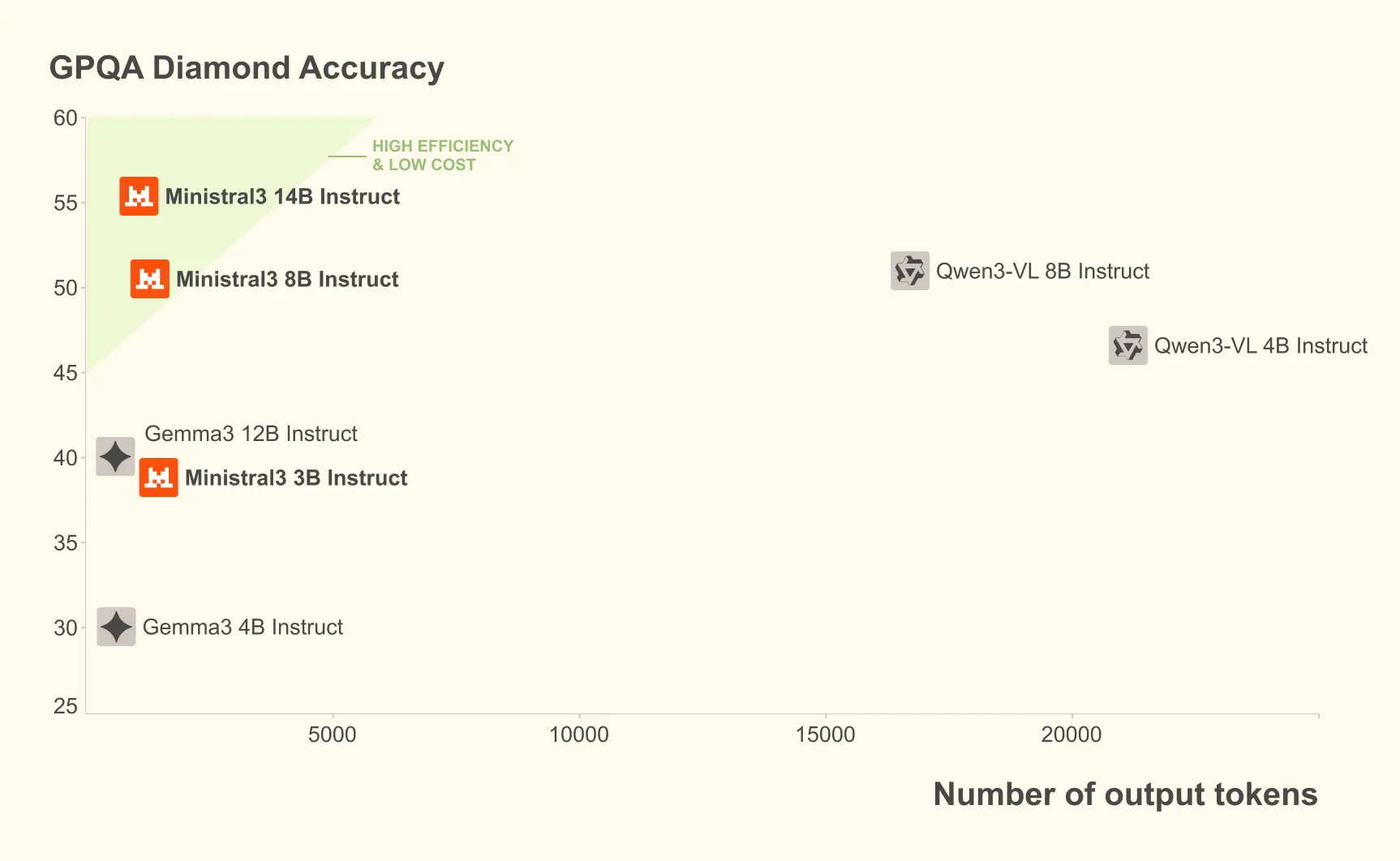

Pada set data GPQA Diamond (ujian penaakulan saintifik yang ketat), pelbagai varian Miniral 3 mengekalkan ketepatan tinggi walaupun dengan peningkatan bilangan token keluaran. Sebagai contoh, model Miniral 3B Instruct mengekalkan ketepatan 35–40% apabila mengendalikan sehingga 20,000 token, setanding dengan model yang lebih besar seperti Gemma 2 9B, sambil menggunakan sumber yang lebih sedikit.

Apakah seni bina Mistral 3?

Mistral 3 ialah sebuah keluarga dan bukannya satu seni bina tunggal, tetapi dua corak seni bina yang perlu anda fahami ialah:

Model kecil padat (Ministral 3)

- Timbunan transformer standard, dioptimumkan untuk kecekapan dan inferens edge.

- Ditawarkan dalam pelbagai saiz (3B/8B/14B) dan varian ditala: base, instruct, dan reasoning; banyak varian menyertakan sokongan multimodal (penglihatan + teks) asli dan operasi konteks panjang. Model Minstral dikeluarkan dengan pemberat FP8 yang dioptimumkan untuk kepadatan dalam sesetengah edaran.

Mixture-of-Experts sparse (Mistral Large 3)

- Seni bina MoE: model mempunyai banyak pakar (jumlah parameter yang besar), tetapi hanya subset terpilih melalui perutean dinilai bagi setiap token — ini menghasilkan pertukaran skala berbanding komput yang lebih baik.

- Mistral Large 3 menyatakan ~675B jumlah parameter dengan ~41B parameter aktif semasa inferens, mencerminkan reka bentuk MoE ini. Model ini dilatih pada perkakasan NVIDIA moden dan dioptimumkan untuk pelaksanaan ketepatan rendah yang cekap (NVFP4/TensorRT/pengoptimuman kernel besar).

Ciri teknikal yang penting apabila dijalankan secara setempat:

- Konteks panjang: sesetengah varian Mistral 3 menyokong konteks yang sangat panjang (dokumen vLLM dan Mistral menyebut tetingkap konteks besar untuk varian tertentu; contohnya, 256k dalam beberapa varian Ministral). Itu mempengaruhi corak memori dan penyajian.

- Format pemberat & kuantisasi: Mistral menyediakan pemberat dalam format mampat/dioptimumkan (FP8, NVFP4) dan berfungsi dengan rantaian alat kuantisasi moden (BitsAndBytes, GPTQ, rantaian alat vendor) untuk inferens setempat yang praktikal.

Mengapa anda akan menjalankan Mistral 3 secara setempat?

Menjalankan LLM secara setempat bukan lagi hobi khusus — ia merupakan pilihan praktikal untuk pasukan dan individu yang mementingkan:

- Privasi data dan pematuhan. Pengehosan setempat memastikan input sensitif kekal dalam infrastruktur anda (penting untuk kewangan, penjagaan kesihatan, perundangan). Reuters melaporkan pelanggan berprofil tinggi memilih untuk menghoskan sendiri model Mistral.

- Kepantasan (latensi) dan kawalan kos. Untuk SLO latensi yang ketat dan kos yang boleh diramal, inferens setempat atau kluster peribadi boleh mengatasi kejutan bil API awan. Varian ministral yang lebih kecil dan format terkuantum menjadikannya praktikal.

- Penyesuaian dan fine-tuning. Apabila anda memerlukan kelakuan khusus, pemanggilan fungsi, atau modaliti baharu, kawalan setempat membolehkan fine-tuning dan pengendalian data tersuai. Integrasi Hugging Face dan vLLM menjadikannya lebih siap guna.

Jika sebab-sebab tersebut selaras dengan keutamaan anda — privasi, kawalan, kebolehramalan kos, atau penyelidikan — penyebaran setempat berbaloi dipertimbangkan.

Bagaimana anda boleh menjalankan Mistral 3 secara setempat (tiga kaedah praktikal)?

Terdapat banyak cara untuk menjalankan Mistral 3 secara setempat. Saya akan merangkumi tiga pendekatan yang meliputi senario pengguna yang paling biasa:

- Ollama (desktop/pelayan setempat tanpa konfigurasi, paling mudah untuk ramai pengguna)

- Hugging Face Transformers + PyTorch / vLLM (kawalan penuh, kluster GPU)

- llama.cpp / ggml / inferens CPU terkuantum GGUF (ringan, berjalan pada komputer riba/CPU)

Untuk setiap kaedah saya akan menyenaraikan bila sesuai digunakan, prasyarat, langkah demi langkah dan contoh kod kecil.

1) Bagaimana menjalankan Mistral 3 dengan Ollama (laluan terpantas)?

Bila hendak guna ini: anda mahukan pengalaman setempat tanpa geseran (macOS/Linux/Windows), CLI atau GUI yang mudah didekati, dan muat turun/artifak terkuantum automatik apabila tersedia. Ollama mempunyai entri model untuk Ministral 3 dan ahli keluarga Mistral yang lain.

Prasyarat

- Ollama dipasang (ikuti pemasang di ollama.com). Perpustakaan Ollama menunjukkan versi minimum tertentu untuk beberapa keluaran ministral.

- Ruang cakera yang mencukupi untuk menyimpan artifak model (saiz model berbeza — varian kuantum ministral 3B mungkin beberapa GB; varian BF16 yang lebih besar adalah berpuluh-puluh GB).

Langkah (contoh)

- Pasang Ollama (contoh macOS — gantikan mengikut platform):

# macOS (Homebrew) example — see ollama.com for platform-specific installersbrew install ollama

- Jalankan model ministral:

# Pull and run the model interactivelyollama run ministral-3

- Sajikan secara setempat (API) dan panggil daripada kod:

# Run Ollama server (default port shown in docs)ollama serve# Then curl against it (example)curl -s -X POST "http://localhost:11434/api/v1/generate" \ -H "Content-Type: application/json" \ -d '{"model":"ministral-3","prompt":"Summarize Mistral 3 in one sentence."}'

Nota & petua

- Ollama mengendalikan muat turun model dan (apabila tersedia) varian terkuantum setempat — sangat mudah untuk mencuba model dengan pantas.

- Jika anda merancang menggunakan model dalam produksi dengan banyak permintaan serentak, Ollama bagus untuk prototaip, tetapi nilaikan penskalaan dan orkestrasi sumber untuk beban mantap.

2) Bagaimana menjalankan Mistral 3 dengan Hugging Face Transformers (GPU / integrasi vLLM)?

Bila hendak guna ini: anda memerlukan kawalan berprogram untuk penyelidikan atau produksi, mahu melakukan fine-tuning, atau mahu menggunakan timbunan inferens dipercepat seperti vLLM pada kluster GPU. Hugging Face menyediakan sokongan Transformers dan Mistral menawarkan checkpoint yang dioptimumkan untuk vLLM/perkakasan NVIDIA.

Prasyarat

- GPU dengan memori yang mencukupi (berbeza mengikut model dan ketepatan). Ministral 3 kecil (3B/8B) boleh berjalan pada satu GPU kelas pertengahan apabila terkuantum; varian lebih besar memerlukan berbilang H100/A100 atau checkpoint NVFP4 yang dioptimumkan untuk vLLM. Dokumentasi NVIDIA dan Mistral mengesyorkan saiz nod tertentu untuk model besar.

- Python, PyTorch, transformers, accelerate (atau vLLM jika anda mahukan pelayan tersebut).

Contoh Python — saluran asas Hugging Face (varian 3B instruct, GPU):

# Example: CPU/GPU inference with transformers pipeline# Assumes you have CUDA and a compatible PyTorch build.import torchfrom transformers import pipelinemodel_name = "mistralai/Ministral-3-3B-Instruct-2512-BF16" # example HF model idgenerator = pipeline( "text-generation", model=model_name, device_map="auto", torch_dtype=torch.bfloat16, # use bfloat16 if your hardware supports it)prompt = "Explain how attention helps transformers, in 3 sentences."out = generator(prompt, max_new_tokens=120, do_sample=False)print(out[0]["generated_text"])

Menggunakan vLLM untuk inferens GPU produksi

vLLM direka untuk menyajikan model besar dengan cekap, menyokong keluarga Mistral 3, dan Mistral menerbitkan checkpoint yang dioptimumkan untuk perkakasan vLLM/NVIDIA (NVFP4/FP8) bagi mengurangkan jejak memori dan mempercepatkan. Memulakan pelayan vLLM memberikan anda titik akhir inferens berkelompok dengan latensi rendah. Lihat resipi vLLM dan panduan Mistral untuk laluan model dan bendera yang disyorkan.

Nota & petua

- Untuk produksi, utamakan checkpoint yang dioptimumkan (NVFP4/FP8) dan jalankan pada GPU yang disyorkan (cth., H100/A100) atau gunakan lapisan orkestrasi yang menyokong pemparalelan tensor/model. Mistral dan NVIDIA mempunyai dokumentasi dan siaran blog tentang runtime yang dioptimumkan.

- Sentiasa tetapkan checkpoint model tepat pada cakera (atau snapshot HF yang boleh diulang) untuk keputusan yang boleh dihasilkan semula dan mengelakkan kemas kini model secara senyap.

3) Bagaimana menjalankan Mistral 3 pada CPU dengan llama.cpp / model terkuantum GGUF?

Bila hendak guna ini: anda memerlukan inferens setempat, luar talian pada CPU (contohnya, komputer riba pembangun, persekitaran terkepung/air-gapped) dan bersedia menukar sedikit ketepatan untuk kecekapan masa jalan dan memori. Kaedah ini menggunakan ggml/llama.cpp dan pemberat terkuantum GGUF (q4/q5/dll).

Prasyarat

- Binaan terkuantum GGUF bagi model Ministral (ramai ahli komuniti menerbitkan GGUF terkuantum di Hugging Face atau menukar pemberat BF16 kepada GGUF secara setempat). Cari varian

Ministral-3-3B-InstructGGUF. - Binari llama.cpp yang telah dikompil (ikuti README projek).

Kuantisasi (jika anda mempunyai pemberat asal) — contoh (konseptual)

# Example: quantize from an FP16/BF16 model to a GGUF q4_K_M (syntax depends on llama.cpp version)./quantize /path/to/original/model.bin /path/to/out.gguf q4_k_m

Jalankan GGUF dengan llama.cpp

# run interactive inference with a quantized GGUF model./main -m /path/to/ministral-3-3b-instruct.gguf -t 8 -c 2048 --interactive# -t sets threads, -c sets context (tokens) if supported

Contoh klien Python (pelayan llama.cpp setempat atau subprocess)

Anda boleh melancarkan llama.cpp sebagai subprocess dan menghantarnya prompt, atau gunakan klien pembalut kecil. Banyak projek komuniti menawarkan pelayan HTTP ringkas di atas llama.cpp untuk integrasi aplikasi setempat.

Nota & pertukaran

- Kuantisasi mengurangkan VRAM dan membolehkan inferens CPU tetapi boleh menurunkan kualiti (ringan hingga sederhana, bergantung pada format kuantisasi). Format seperti q4_K_M atau varian q5 ialah kompromi biasa untuk penggunaan CPU. Artikel Jepun dan teknikal menerangkan jenis Q4/ Q5 dan penukaran GGUF secara terperinci.

- Untuk beban kerja kecil hingga sederhana, GGUF + llama.cpp selalunya cara paling murah dan paling mudah alih untuk menjalankan LLM setempat.

Pertimbangan perkakasan dan memori yang penting?

Panduan ringkas dan praktikal:

- Model 3B: sering kali boleh dikuantum dan dijalankan pada CPU komputer riba yang baik atau satu GPU dengan 8–16 GB VRAM (bergantung pada ketepatan/kuantisasi). Varian GGUF q4 boleh berjalan pada ramai CPU moden.

- 8B dan 14B ministers: lazimnya memerlukan GPU kelas pertengahan (cth., 24–80 GB bergantung pada ketepatan dan cache pengaktifan) atau kuantisasi merentas berbilang peranti.

- Mistral Large 3 (675B jumlah, 41B aktif): ditujukan untuk penyebaran pusat data dan lazimnya berjalan terbaik dengan nod multi-GPU (cth., 8×A100 atau H100) dan format khusus (NVFP4/FP8) untuk vLLM. Mistral secara jelas menerbitkan checkpoint yang dioptimumkan untuk menjadikan penyebaran sedemikian boleh dilaksanakan.

Jika keutamaan anda ialah penggunaan komputer riba setempat, sasarkan laluan GGUF terkuantum Ministral 3B + llama.cpp. Jika keutamaan anda ialah hasil produksi yang tinggi, lihat vLLM + checkpoint NVFP4 pada GPU. Jika anda mahukan kemudahan eksperimen, Ollama ialah yang terpantas untuk bermula.

Bagaimana anda harus memilih kuantisasi dan ketepatan?

Kuantisasi ialah pertukaran: memori dan kelajuan berbanding kualiti model mentah. Pilihan biasa:

- q4_0 / q4_1 / q4_K_M: pilihan 4-bit popular untuk inferens CPU; q4_K_M (varian k-means) sering menawarkan keseimbangan kualiti/prestasi yang lebih baik.

- varian q5 / q8 / imatrix: format perantaraan yang mungkin mengekalkan lebih banyak fideliti dengan kos saiz.

- FP16 / BF16 / FP8 / NVFP4: ketepatan GPU — BF16 dan FP16 lazim untuk latihan/inferens pada GPU moden; FP8 / NVFP4 ialah format muncul yang menjimatkan memori untuk model yang sangat besar dan disokong oleh runtime yang dioptimumkan serta keluaran checkpoint Mistral.

Kaedah mudah: untuk larian CPU setempat pilih q4_K_M atau seumpamanya; untuk inferens GPU dengan fideliti tinggi gunakan BF16/FP16 atau FP8/NVFP4 khusus vendor apabila disokong oleh runtime.

Kesimpulan — patutkah anda menjalankan Mistral 3 secara setempat?

Jika anda memerlukan privasi, latensi rendah, atau penyesuaian, ya: keluarga Mistral 3 memberikan anda palet yang luas — model kecil untuk CPU edge, model sederhana untuk satu GPU atau kluster sederhana, dan perisa MoE besar untuk skala pusat data — dan ekosistem (Ollama, Hugging Face, vLLM, llama.cpp) sudah menyokong corak penyebaran setempat dan persendirian yang praktikal. Mistral juga bekerjasama dengan NVIDIA dan vLLM untuk menyediakan checkpoint yang dioptimumkan bagi throughput tinggi dan jejak memori yang berkurang, yang menjadikan pengehosan sendiri produksi lebih realistik berbanding sebelumnya.

Untuk bermula, terokai lagi keupayaan model (seperti Gemini 3 Pro) dalam Playground dan rujuk API guide untuk arahan terperinci. Sebelum mengakses, sila pastikan anda telah log masuk ke CometAPI dan memperoleh kunci API. CometAPI menawarkan harga yang jauh lebih rendah daripada harga rasmi untuk membantu anda berintegrasi.

Sedia untuk bermula?→ Daftar CometAPI hari ini !