LobeChat og CometAPI er to hurtigt udviklende projekter i det åbne AI-økosystem. I september 2025 fusionerede LobeChat en komplet CometAPI-udbyderintegration, der gør det nemt at kalde CometAPIs samlede, OpenAI-kompatible endpoints fra LobeChat. Denne artikel forklarer, hvad LobeChat og CometAPI er, hvorfor du bør integrere dem, trinvis integration og konfiguration (inklusive en færdigudviklet TypeScript-udbyderbasiskonfiguration), runtime-eksempler, konkrete use cases og produktionstips til omkostninger, pålidelighed og observerbarhed.

Hvad er LobeChat, og hvilke funktioner tilbyder det?

LobeChat er et open source, moderne chatframework designet til at hoste LLM-chatapplikationer med flere udbydere med en poleret brugergrænseflade og implementeringsværktøjer. Det er bygget til at understøtte multimodale input (tekst, billeder, lyd), vidensbase/RAG-arbejdsgange, forgreningssamtaler og "tankekæde"-visualiseringer, plus et udvideligt udbyder-/plugin-system, så du kan bytte mellem forskellige model-backends uden at omstrukturere din app. LobeChats dokumentation og repo præsenterer det som et produktionsklart framework til både selvhostede og cloud-implementeringer, med miljødrevet konfiguration og en markedsplads for tredjeparts MCP-integrationer (model control plane).

Overblik over de vigtigste LobeChat-funktioner

- Understøttelse af flere udbydere (OpenAI, Anthropic, Google Gemini, Ollama osv.).

- Filupload + vidensbase til RAG-arbejdsgange (dokumenter, PDF'er, lyd).

- Udviklervenlig konfiguration via miljøvariabler og import af URL-indstillinger.

- Udvidelig runtime: Udbydere er konfigureret med korte adapter-runtimes, så nye backends kan tilsluttes.

Hvad er CometAPI?

CometAPI er et samlet AI-adgangslag, der eksponerer mere end 500 modeller fra mange underliggende udbydere via en enkelt, OpenAI-kompatibel API-overflade. Det er positioneret til at lade udviklere vælge model-slutpunkter for ydeevne, omkostninger eller kapacitet uden binding og til at centralisere fakturering, routing og adgang. CometAPI annoncerer samlede slutpunkter til chat/fuldførelser og en modelliste-API til at finde tilgængelige model-ID'er.

Hvorfor CometAPI er attraktiv for teams

- Modelvalg og bærbarhed: Skift mellem mange banebrydende modeller uden at ændre integrationskoden væsentligt.

- OpenAI-kompatible slutpunkter: Mange klientbiblioteker og frameworks, der forventer HTTP-slutpunkter i OpenAI-stil, kan fungere med CometAPI ved at ændre basis-URL + godkendelse (Praktiske eksempler viser

https://api.cometapi.com/v1/som en OpenAI-kompatibel overflade.) - Udviklerdokumentation og integrationer: CometAPI udgiver dokumenter og trinvise vejledninger til integration med værktøjer som LlamaIndex og andre low-code platforme.

Hvorfor bør du integrere CometAPI i LobeChat?

Kort svar: fleksibilitet, omkostningskontrol og hurtig adgang til nye modellerLobeChat er bygget til at være udbyder-uafhængig; ved at tilslutte CometAPI får din LobeChat-implementering muligheden for at kalde mange forskellige modeller gennem den samme kodesti - bytte modeller for gennemløb, latenstid, omkostninger eller kapacitet uden at ændre din brugergrænseflade eller promptflows. Derudover har fællesskabet og vedligeholderne aktivt tilføjet CometAPI-udbydersupport til LobeChat, hvilket gør integrationen mere problemfri.

Forretningsmæssige og tekniske fordele

- Modeldiversitet uden kodekørning. Har du brug for at evaluere Gemini, Claude eller en nichebilledmodel? CometAPI kan eksponere disse model-ID'er via en enkelt API. Dette reducerer mængden af manipulation pr. udbyder i LobeChat.

- Omkostningsoptimering. CometAPI giver dig mulighed for dynamisk at rute til billigere modeller eller vælge billigere udbydere, hvilket kan reducere omkostningerne pr. samtale betydeligt for implementeringer med høj volumen.

- Enklere håndtering af hemmeligheder. Én API-nøgle til administration i LobeChats indstillinger eller Docker-miljø i stedet for flere udbydernøgler. LobeChat-platformen understøtter allerede aktivering af en udbyder via

ENABLED_<PROVIDER>og et udbydernøgle-miljøvariabelmønster, så integrationen er operationelt konsistent. - Holder LobeChat-kodebasen minimal: udbyderlogik er indkapslet og konfigureret med env-variabler.

Hvordan opsætter og integrerer jeg CometAPI i LobeChat?

Dette afsnit giver en handlingsrettet, trin-for-trin opskrift: Hent nøgler, indstil miljøvariabler, tilføj udbyderen til LobeChat (eksempel på udbyderkonfiguration), og vis runtime-brug (chatkald). Eksemplerne følger LobeChats udbydermønstre og de CometAPI OpenAI-kompatible slutpunkter.

1) Få en CometAPI-konto og API-nøgle

Tilmeld dig på CometAPI, og åbn API-konsollen. For at registrere en CometAPI-konto skal du bruge en e-mailadresse eller logge ind direkte med Google One-Click.

Når du har gennemført registreringen, skal du gå til legepladsen og klikke på tilføj ny hemmelig nøgle for at oprette en ny API-nøgle:

Få en API-nøgle.

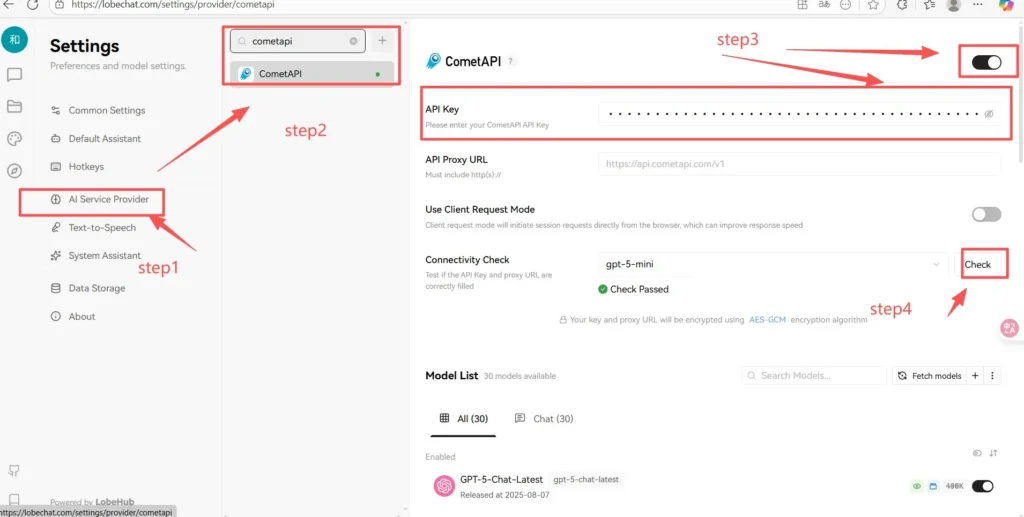

2) Konfiguration af CometAPI i LobeChat

- Gå ind i Lobe-Chat-indstillinger, klik på avataren, og klik på programindstillinger.

- Vælg cometapi som modeludbyder.

- Indsæt sk-xxxxx fra cometapi i API-nøglefeltet, og tænd knappen. Vælg en model for at kontrollere den.

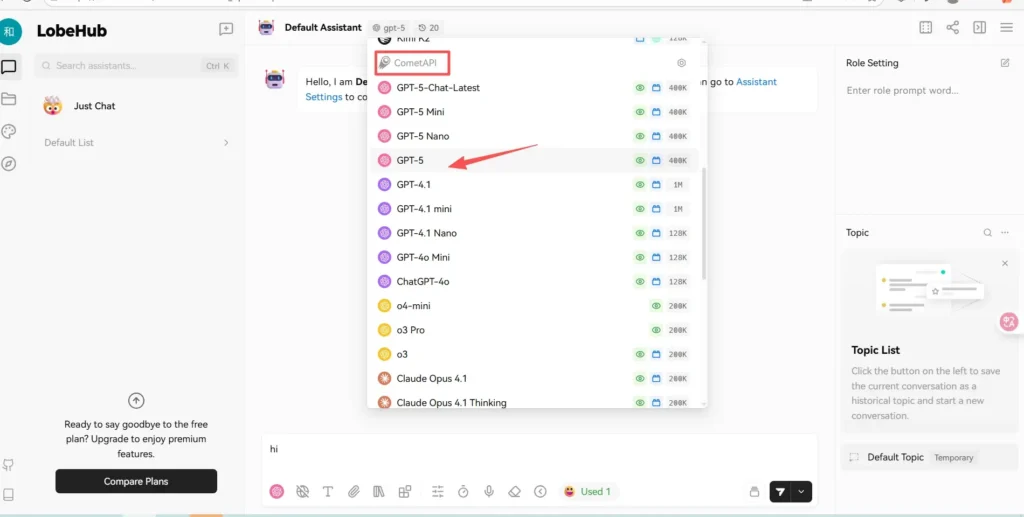

3) Test af opkaldet

Vælg en CometAPI-model for at kontrollere. Indtast en simpel testkommando i Lobe-Chat. Hvis opkaldet lykkes, modtager du et tilsvarende svar. Hvis det mislykkes, skal du kontrollere, om konfigurationen er korrekt, eller kontakte cometapis online kundeservice.

I øjeblikket tilbyder cometapi mere end 30 af de nyeste modeller fra store udviklere (OpenAI, Grok, Claude, Gemini) på Lobechat.

Hvordan kan du udvide integrationen (avancerede forbedringer)?

Vil du gå ud over det grundlæggende? Her er nogle solide næste trin, der tager din integration fra funktionel til produktionsmæssig.

Forbedring 1: Dynamisk modelorkestrering (multimodelagenter)

Opret agentlogik i LobeChat, der dynamisk forhandler underopgaver til forskellige Comet-modeller (f.eks. lille indlejringsmodel til hentning, mellemmodel til udarbejdelse, højkapacitetsmodel til opsummering). Brug LobeChats funktionskald/plugin-system til at koordinere arbejdsgangen og aggregere de endelige svar.

Forbedring 2: Cachelagring af indlejringer og svar

Når du bruger indlejringer (til RAG), skal du beregne indlejringerne én gang og cache dem for at reducere overhead. Hvis du kalder CometAPI til indlejringer, skal du gemme vektorrepræsentationer i din vektordatabase og kun genberegne ved indholdsændringer. Dette reducerer tokens og omkostninger.

Forbedring 3: Konfiguration og kvoter pr. lejer

Hvis du kører en LobeChat-instans med flere lejere, skal du kontrollere grænserne pr. lejer (anmodninger/time, modelniveauer) ved at skrive en middleware, der kortlægger lejer-id → liste over tilladte modeller (ved hjælp af CometAPI-model-ID'er). Dette giver premium-niveauer adgang til bedre modeller.

Forbedring 4: Brug modelmetadata og tilstandstjek

Implementer udbydersundhedstjek, der kalder en letvægts CometAPI "model ping" eller et minimalt chatkald for at sikre, at latensen er inden for SLA'er; ellers undgå problemfrit at bruge fallback-modeller. Overvåg pulsen, og vis udbyderstatus i LobeChat-administratorgrænsefladen.

Hvilke faldgruber skal man være opmærksom på?

- API-nøgleeksponeringGem aldrig CometAPI-nøgler i klientkode. Gem dem altid på serversiden (LobeChats serverlag).

- Modelnavn driftCometAPI kan tilføje eller udfase model-ID'er. Brug en servertilknytning og opdatering

COMETAPI_MODEL_LISTnår du vil præsentere nye modeller. - Forskelle i svarformatSelvom CometAPI sigter mod OpenAI-kompatibilitet, kan nogle modeller eller metafelter variere; kortlæg og rengør altid svar, før du viser dem til brugerne.

Kom godt i gang

CometAPI er en samlet API-platform, der samler over 500 AI-modeller fra førende udbydere – såsom OpenAIs GPT-serie, Googles Gemini, Anthropics Claude, Midjourney, Suno og flere – i en enkelt, udviklervenlig grænseflade. Ved at tilbyde ensartet godkendelse, formatering af anmodninger og svarhåndtering forenkler CometAPI dramatisk integrationen af AI-funktioner i dine applikationer. Uanset om du bygger chatbots, billedgeneratorer, musikkomponister eller datadrevne analysepipelines, giver CometAPI dig mulighed for at iterere hurtigere, kontrollere omkostninger og forblive leverandøruafhængig – alt imens du udnytter de seneste gennembrud på tværs af AI-økosystemet.

Til at begynde med, udforsk modellens muligheder i Legeplads og konsulter API guide for detaljerede instruktioner. Før du får adgang, skal du sørge for at være logget ind på CometAPI og have fået API-nøglen. CometAPI tilbyde en pris, der er langt lavere end den officielle pris, for at hjælpe dig med at integrere.

Klar til at gå? → Tilmeld dig CometAPI i dag !

Konklusion

Integration af CometAPI i LobeChat er en praktisk måde at opnå modeldiversitet, omkostningsfleksibilitet og hurtig eksperimenteringskapacitet, samtidig med at man bevarer de polerede UX- og RAG-funktioner, som LobeChat tilbyder. LobeChat-fællesskabet har allerede gjort et betydeligt forsøg på at tilføje CometAPI-support (udbyderkort, modelliste, runtime-adaptere, tests og dokumentation), som du kan udnytte direkte eller bruge som inspiration til at implementere en brugerdefineret adapter til specialiserede behov. For de mest præcise integrationstrin og de seneste eksempler, se CometAPIs dokumentation og ... LobeChat modeludbyderdokumentation og repo—links der henvises til nedenfor vil hjælpe dig med at fortsætte.