OpenAIs seneste ræsonnementsmodel, o3-pro, repræsenterer et betydeligt spring inden for ydeevne og kapacitet for AI-drevne applikationer. O2025-pro, der blev lanceret i begyndelsen af juni 3, tilbyder udviklere og virksomheder avanceret ræsonnement, multimodal forståelse og værktøjsbrug – alt sammen til en premiumpris. Denne artikel sammenfatter de seneste annonceringer, brugerrapporter og benchmarkdata for at give et omfattende overblik over o3-pros ydeevne, omkostningsovervejelser og tilgængelighed.

Hvad er o3-pro?

OpenAIs seneste tilbud, o3-pro, markerer en betydelig milepæl inden for AI-ræsonnementsmodeller ved at kombinere forbedrede funktioner med en premiumpris. O11-pro, der blev lanceret den 2025. juni 3, efterfølger standard o3-modellen og erstatter o1-pro i OpenAIs produktsortiment og er rettet mod udviklere og virksomheder, der prioriterer dybdegående analyse og pålidelighed frem for rå hastighed. O3-pro er bygget på den samme underliggende arkitektur som o2025 – oprindeligt introduceret i april 3 – og integrerer websøgning i realtid, filanalyse, visuel ræsonnement, Python-udførelse og avancerede hukommelsesfunktioner, der adresserer komplekse arbejdsgange inden for videnskab, programmering, forretning og skrivning. Modellens bevidste ræsonnementstilgang medfører dog længere latenstider og en betydelig omkostningsstigning, hvilket afspejler dens beregningsintensive design.

Hvad adskiller o3‑pro fra standard o3-modellen?

Avanceret multimodal ræsonnement

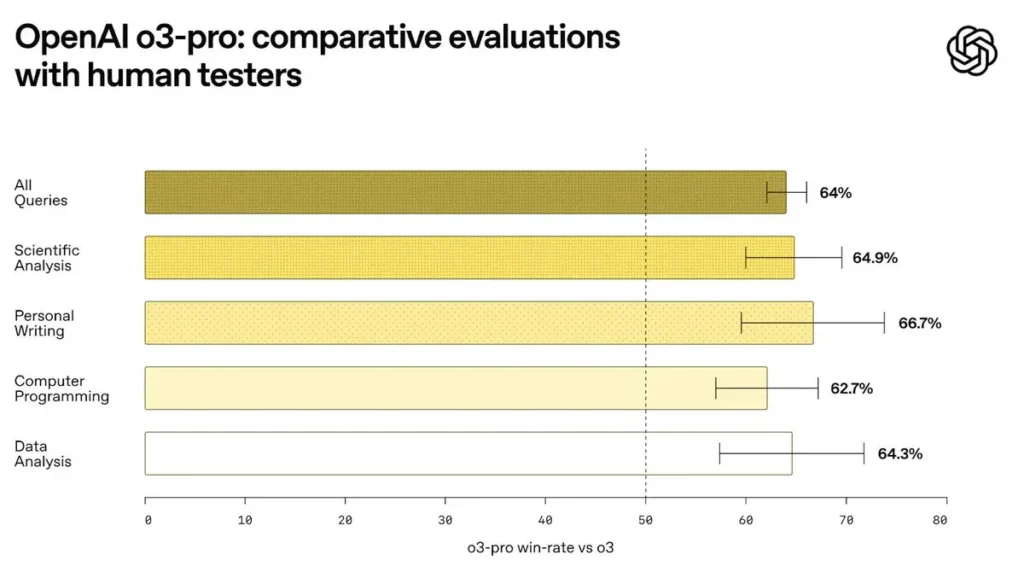

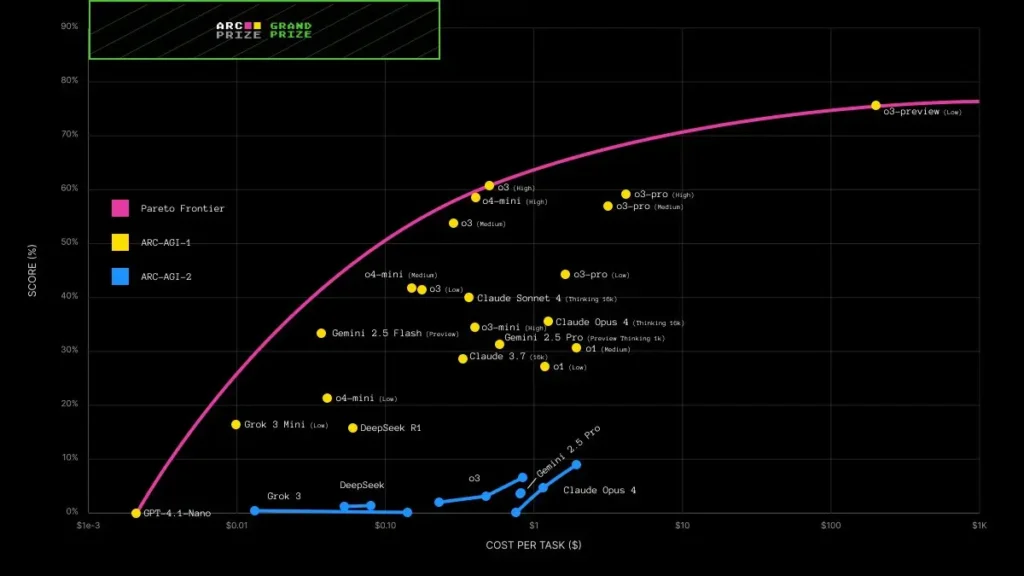

OpenAI har grundigt evalueret o3-pro på tværs af flere standard AI-vurderinger for at validere dens ræsonnementsevner. Inden for matematik overgår o3-pro Googles Gemini 2.5 Pro på AIME 2024-benchmarken og demonstrerer overlegen logisk ræsonnement og kompleks ligningsløsning under tidsbestemte forhold. Tilsvarende overgår o3-pro Anthropics Claude 4 Opus på GPQA Diamond-benchmarken – som måler videnskabelig forståelse og problemløsning på ph.d.-niveau – og understreger dens dybde inden for avanceret videnskabelig ræsonnement.

o3-pro bygger videre på styrkerne ved OpenAIs flagskibsmodel o3 ved at integrere realtids-webbrowsering, filanalyse, visuel forståelse og Python-udførelse undervejs i en enkelt brugerflade. Ifølge OpenAI giver denne forbedrede ræsonnementsevne o3-pro mulighed for at håndtere komplekse opgaver – såsom fortolkning af videnskabelige data, fejlfinding af langkode og generering af multimodal indhold – med større pålidelighed end sin forgænger.

Pålidelighed frem for latenstid

Disse nye funktioner kommer med kompromiser: o3-pros svartider er målbart langsommere end o3, hvilket afspejler de ekstra beregnings- og kontekstbehandlingstrin, der kræves til avanceret værktøjsbrug. Tidlige brugere rapporterer typiske latenstider på 1.5-2 gange o3's på tilsvarende prompts, selvom de præcise tal varierer baseret på anmodningskompleksitet.

Funktionsbegrænsninger ved lancering

Ved lanceringen bemærkede o3-pro-brugere et par midlertidige begrænsninger: billedgenerering er stadig ikke tilgængelig, og visse ChatGPT-funktioner – såsom flygtige "Canvas"-sessioner og midlertidige chattråde – er deaktiveret, mens OpenAI skalerer infrastruktur til den nye model. Disse begrænsninger forventes at lettes i løbet af de kommende måneder, efterhånden som kapaciteten udvides.

Hvordan klarer o3‑pro sig i branchens benchmarks?

Standardiserede ræsonnementstests

I interne tests overgik o3-pro o3 med en betydelig margin på standardiserede ræsonnementsopgaver, der dækkede matematik, logiske gåder og programmeringsudfordringer. Resultater rapporteret af lokalsamfundet placerer o3 på omkring 2,517 point, mens o3-pro scorer tæt på 2,748 – en forbedring på cirka 9 %.

Evalueringer af kodning i den virkelige verden

Udviklere, der kører live kodegenerering og fejlfindingsopgaver, har observeret, at o3-pro producerer mere syntaktisk korrekte og semantisk nøjagtige output i single-shot og few-shot indstillinger. Benchmarks på kodningsarkiver som CodeSearchNet viser en stigning på 5-7% i funktionel korrekthed i forhold til o3, især på langkontekstproblemer, der overstiger 4,000 tokens.

Sammenlignende præstation mod konkurrenter

I direkte tests slår o3-pro ikke kun Gemini 2.5 Pro og Claude 4 Opus på rå scorer, men leverer også mere ensartede output under kontradiktoriske stresstests. Ved at kombinere multimodal inputhåndtering og dynamisk værktøjsbrug mindsker o3-pro kløften til specialmodeller fra rivaler som Google PaLM og Anthropic Claude X. Tidlige direkte tests indikerer, at o3-pro matcher eller overgår konkurrenternes nøjagtighed på komplekse ræsonnementbenchmarks, selvom omfattende tredjepartsrapporter stadig er på vej.

Hvilken prisstruktur bør udviklere forvente?

Tokenbaseret faktureringsmodel

OpenAI fortsætter sin tokenbaserede fakturering: o3-pro koster 20 dollars pr. million input-tokens og 80 dollars pr. million output-tokens – præcis ti gange prisen på standard o3-modellen efter den seneste prisreduktion. I modsætning hertil koster o3 nu 2 dollars pr. million input-tokens og 8 dollars pr. million output-tokens efter en prisreduktion på 80 % tidligere i juni 2025.

| Model | Input token-pris | Output Token Pris |

|---|---|---|

| o3 | $2 / 1 mio. tokens | $8 / 1 mio. tokens |

| o3-pro | $20 / 1 mio. tokens | $80 / 1 mio. tokens |

Begrundelse for præmien

Denne tidoblede prisstigning afspejler de ekstra computerressourcer, højkapacitetsinfrastruktur og specialiserede værktøjsintegrationer, som o3-pro kræver. OpenAI positionerer o3-pro som en "missionskritisk" model til applikationer, hvor nøjagtighed og avanceret ræsonnement retfærdiggør omkostningspræmien.

Mængderabatter og batch-API

Virksomheder, der behandler store mængder tokens, kan stadig udnytte Batch API'en til at spare op til 50 % på cachelagrede input og output. Selvom denne mekanisme primært gavner brugere med stor volumen af GPT-4.1-varianter, forventes lignende batching-muligheder at blive rullet ud til O-serie-modeller senere i 2025.

Hvordan kan udviklere og teams få adgang til o3‑pro?

API-tilgængelighed

I direkte tests slår o3-pro ikke blot Gemini 2.5 Pro og Claude 4 Opus på rå scorer, men leverer også mere ensartede resultater under kontradiktoriske stresstests.

OpenAI gjorde o3-pro tilgængelig via sin offentlige API den 10. juni 2025 med øjeblikkelig understøttelse i både Completions- og Chat-slutpunkterne. Udviklere kan angive "o3-pro" model i deres API-kald, underlagt hastighedsgrænser og kvotebegrænsninger knyttet til deres abonnementsniveau.

POST https://api.openai.com/v1/chat/completions

{

"model": "o3-pro",

"messages": ,

"max_tokens": 1500

}

ChatGPT Pro- og teamabonnementer

ChatGPT Pro- og Team-abonnenter får direkte adgang til o3-pro i ChatGPT-grænsefladen. Brugere kan skifte mellem o3 og o3-pro i modelvælgeren, selvom den indledende tilgængelighed er begrænset til en delmængde af virksomhedskunder og betatestere.

Via CometAPI API

Udviklere kan få adgang o3-Pro API(model: ”o3-Pro"eller"o3-pro-2025-06-10") igennem CometAPI, de nyeste modeller, der er anført, er fra artiklens udgivelsesdato. For at begynde, skal du udforske modellens muligheder i Legeplads og konsulter API guide for detaljerede instruktioner. Før du får adgang, skal du sørge for at være logget ind på CometAPI og have fået API-nøglen. CometAPI tilbyde en pris, der er langt lavere end den officielle pris, for at hjælpe dig med at integrere.

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.cometapi.com/v1",

api_key="<YOUR_API_KEY>",

)

response = client.chat.completions.create(

model="o3-Pro",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices.message.content

print(f"Assistant: {message}")

Hvilke praktiske anvendelsesscenarier drager størst fordel af o3‑pro?

Videnskabelig forskning og dataanalyse

Forskere, der arbejder med store datasæt – lige fra genomik til klimasimuleringer – kan udnytte o3-pros filanalyse- og Python-udførelsesfunktioner til at automatisere hypotesetestning og generere indsigt uden begrænsninger i kontekstlængde.

Virksomhedsvidensarbejdsgange

I sektorer som finans og juridiske tjenester, hvor præcision og revisionsvenlighed er altafgørende, reducerer o3-pros forbedrede instruktionsoverholdelse og multimodale ræsonnement fejlrater i kontraktgennemgange, finansiel modellering og opgaver med overholdelse af lovgivningen.

Softwareudvikling og DevOps

Ved at kombinere forståelse af lang kontekstkode med live-testning via Python-eksekvering, strømliner o3-pro fejlfinding og automatiserer komplekse refactoring-arbejdsgange, hvilket accelererer leveringscyklusser for store softwareprojekter.

Hvad bør organisationer overveje, før de opgraderer?

Cost-benefit-analyse

Teams skal afveje den 10-dobbelte prisstigning mod de forventede effektivitetsgevinster. For opgaver med høj værdi og lav volumen – såsom udarbejdelse af strategiske rapporter eller opbygning af kritiske sikkerhedssystemer – kan nøjagtigheden og værktøjssupporten retfærdiggøre o3-pros premium. Til generering af masseindhold kan det være mere økonomisk at holde sig til standard o3- eller o4-mini-modeller.

Infrastrukturberedskab

Da o3-pro pålægger højere latenstid og gennemløbskrav, bør organisationer revidere deres API-hastighedsgrænser, netværkskapacitet og strategier for fejlforsøg for at undgå flaskehalse under spidsbelastning.

Afslutningsvis

OpenAIs o3-pro-model sætter en ny standard for avanceret ræsonnement, multimodal forståelse og integreret værktøjsbrug i AI. Dens benchmarkgevinster og forbedringer af pålidelighed gør den til en attraktiv mulighed for missionskritiske applikationer, forudsat at budgetter og infrastruktur kan understøtte de øgede omkostninger. Efterhånden som AI-landskabet udvikler sig, vil o3-pros rolle styrkes i områder, der kræver de højeste niveauer af nøjagtighed og kontekstuel dybde, mens mere omkostningsfølsomme arbejdsbelastninger kan fortsætte med at udnytte basismodeller i o-serien eller nye minivarianter.