Durch die Integration von Coze – einem visuellen KI-Agenten und einer Workflow-Plattform – mit CometAPI – einem einheitlichen, OpenAI-kompatiblen Gateway zu über 500 Modellen – können Sie die Low-Code-Agent-Tools und das Plug-in-System von Coze mit der Breite und den Kosten-/Kontrollvorteilen des Multi-Modell-Katalogs von CometAPI kombinieren. Das Ergebnis: Agenten, die genau das gewünschte Modell (oder den gewünschten Bild-/Video-Endpunkt) aufrufen, den Anbieter ohne Neuverdrahtung des Codes wechseln und mit einheitlicher Abrechnung vom Prototypen zur Produktion skalieren können.

Was ist Coze?

Coze ist eine Entwicklungsplattform für KI-Anwendungen und -Agenten, die sich auf die Erstellung visueller Workflows, Plug-Ins/Tools und die Veröffentlichung von Agenten als APIs oder Chat-Apps konzentriert. Sie ermöglicht es sowohl Nicht-Ingenieuren als auch Ingenieuren, Chatbots/Agenten aus Modellauswahlen, Eingabeaufforderungen, Logikblöcken und externen Tools (Plug-Ins) zusammenzustellen, diese Agenten oder Workflows anschließend zu veröffentlichen und programmgesteuert aufzurufen.

Wichtige Coze-Funktionen, die Sie bei der Integration externer KI-APIs verwenden:

- Plugins / Tools: Coze kann externe APIs als Plugins importieren/registrieren und diese Endpunkte als Tools in Workflows bereitstellen. Dies ist der offizielle Erweiterungspunkt für Dienste von Drittanbietern.

- Workflows/Agentenknoten: Workflows sind visuelle Sequenzen von Knoten (Logik, Code, Plugin-/Tool-Aufrufe, API-Aufrufe), die ein Agent zur Erfüllung einer Aufgabe ausführt. Bestimmte Knoten ermöglichen HTTP-/API-Aufrufe oder den Aufruf registrierter Plugin-Tools.

- Als API veröffentlichen: Abgeschlossene Agenten/Workflows können als API-Dienste veröffentlicht werden (damit andere Apps sie aufrufen können) und können während der Ausführung selbst externe APIs aufrufen.

Was ist CometAPI und warum sollte man es wählen?

CometAPI ist ein einheitliches API-Gateway, das Zugriff auf Hunderte von Modellen Anbieterübergreifend über eine einheitliche Schnittstelle (Chat-Vervollständigungen, Bildgenerierung usw.). Teams nutzen CometAPI, um Vendor Lock-in zu vermeiden, Modell-A/B-Tests durchzuführen und Kosten durch Modellwechsel ohne Code-Neuschreibung zu optimieren. Der Dienst stellt Standard-Endpunkte bereit, wie z. B. https://api.cometapi.com/v1/chat/completions zur Chat-Generierung.

Warum CometAPI mit Coze kombinieren?

- Modellauswahl & Portabilität: Richten Sie Coze-Agenten auf CometAPI und tauschen Sie Modelle zentral aus.

- Kostenkontrolle und Tarifmanagement: Mit CometAPI können Sie kostengünstigere Modelle für Routineaufgaben und Premiummodelle für hochwertige Abfragen auswählen.

- Zentralisierte Beobachtbarkeit: zentraler Ort zum Rotieren von Schlüsseln, Überwachen der Nutzung und Anwenden von Kontingenten.

- Modellauswahl und Anbieterportabilität: Mit CometAPI können Sie aus zahlreichen Anbietern und Modellen wählen, ohne für jeden eine separate Integration erstellen zu müssen. So können Coze-Agenten Modelle A/B-Tests durchführen, auf günstigere Optionen zurückgreifen oder Spezialmodelle (z. B. Bildmodelle oder Musikmodelle) auswählen.

- Drop-In-Kompatibilität: Die OpenAI-kompatible Oberfläche von CometAPI bedeutet oft minimale Änderungen an vorhandenen OpenAI-Clients oder Coze-Knoten, die Standardformate erwarten.

- Schnelle Markteinführung: Verwenden Sie die Low-Code-Workflows von Coze und den Modellkatalog von CometAPI, um schnell erweiterte Multitool-Agenten zusammenzustellen (z. B. Zusammenfassung mit einem Modell, Bildgenerierung mit einem anderen).

Wie kann ich eine Integration durchführen, indem ich in Coze nach einem CometAPI-Plugin suche?

Kurze Antwort: Registrieren/importieren Sie CometAPI als Plugin, autorisieren Sie es und rufen Sie dann seine Tools in Workflows auf.

Schritt für Schritt (Plugin-Marktplatz / Import)

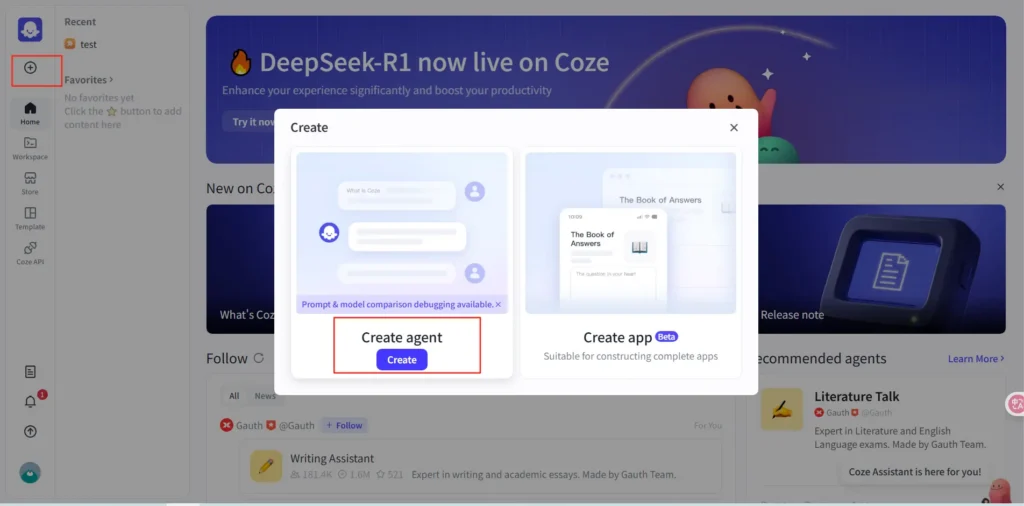

- Geben Sie Coze ein und klicken Sie auf „Erste Schritte“, um einen Agenten zum Testen zu erstellen.

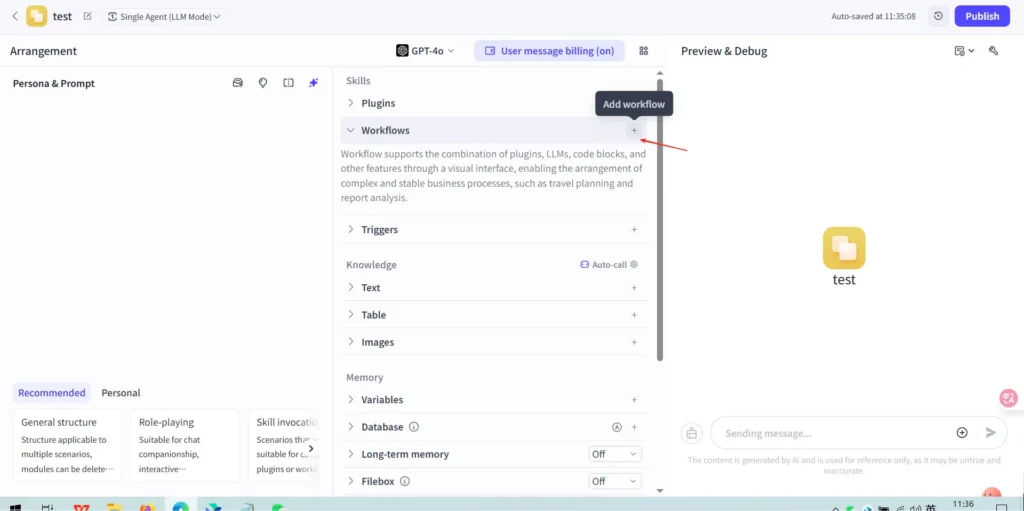

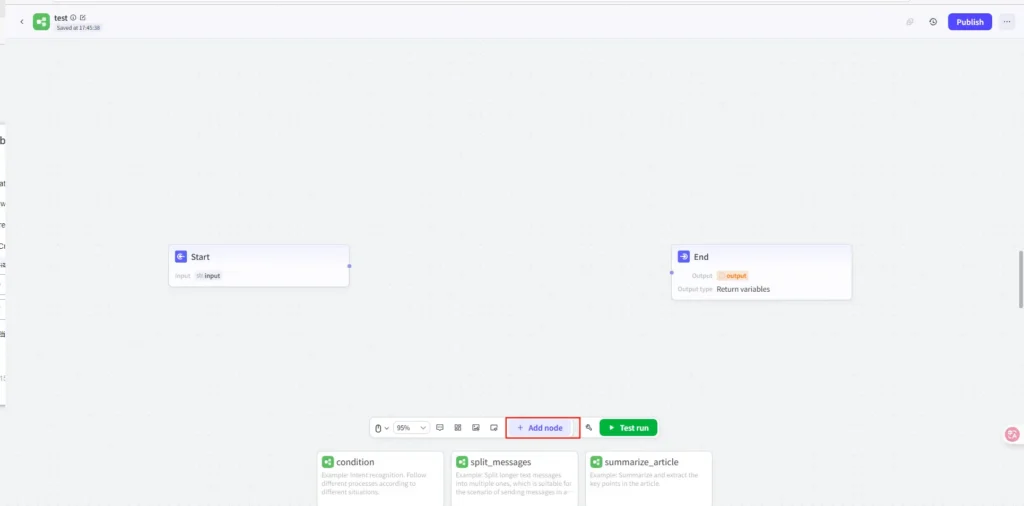

- Fügen Sie dann einen Workflow hinzu und wählen Sie „Knoten hinzufügen“.

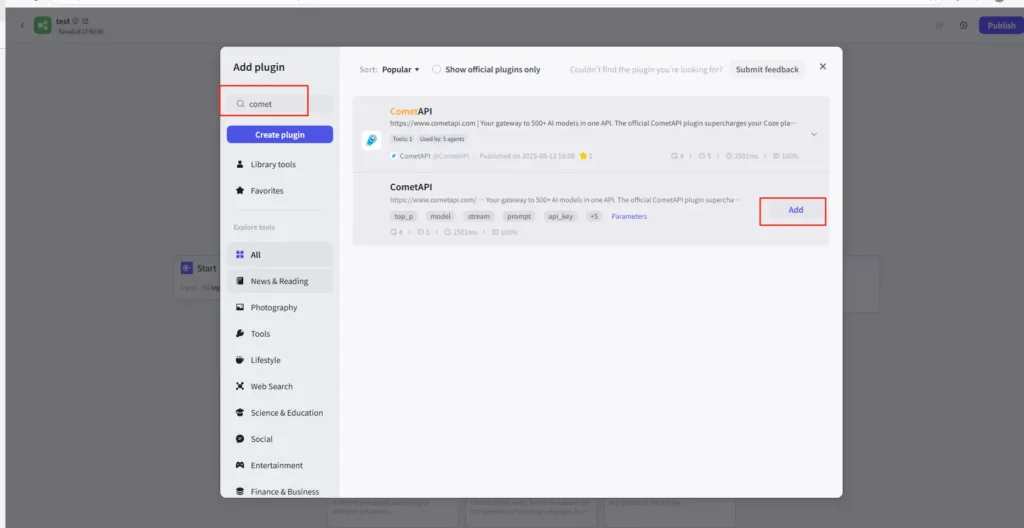

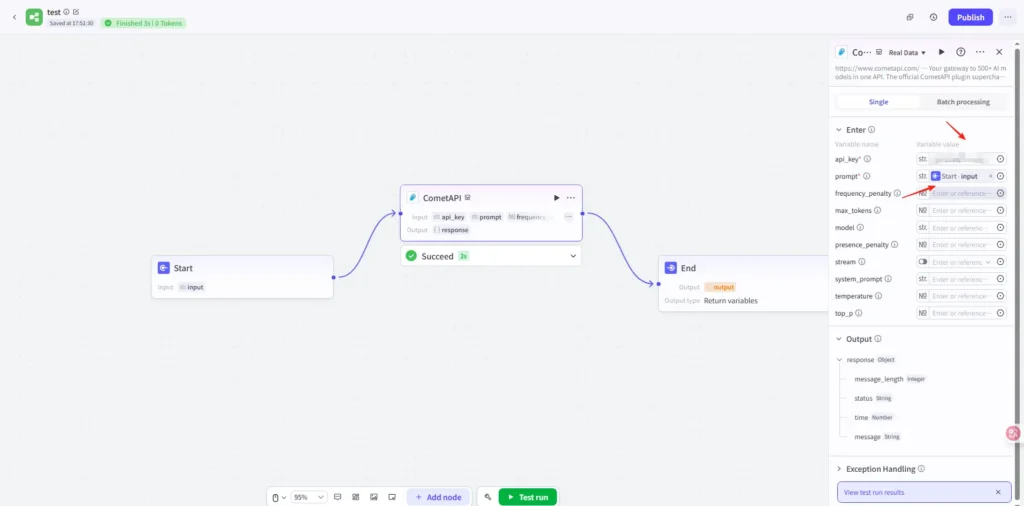

- Suchen Sie im Marktplatz nach „CometAPI“: Wählen Sie im Workflow „Knoten hinzufügen“, klicken Sie auf Plugins und suchen Sie nach „cometapi“. Fügen Sie dieses Plugin hinzu. Geben Sie im Suchfeld „CometAPI“ ein – es wird in den Ergebnissen angezeigt. Klicken Sie auf die Plugin-Karte → Hinzufügen. Folgen Sie den Anweisungen auf dem Bildschirm, um Anmeldeinformationen hinzuzufügen.

- Fügen Sie in das Eingabefeld „API-Schlüssel“ den von CometAPI erhaltenen Schlüssel „sk-xxxxx“ ein. Testen und veröffentlichen Sie ihn anschließend.

Wann ist diese Methode anzuwenden?

- Es ist ein offizielles oder Community-CometAPI-Plugin verfügbar.

- Sie bevorzugen eine Einrichtung ohne Code und eine zentrale Plugin-Verwaltung.

- Ihr Team möchte den einfachsten Weg zur Produktion.

Wie können Sie die Integration durchführen, indem Sie einen Agenten erstellen und einen API-Aufrufknoten im Workflow verwenden? (Methode 2)

Diese Methode ermöglicht Ihnen eine genauere Kontrolle zur Workflow-Laufzeit (Routing, Wiederholungsversuche, bedingte Logik).

Schritt für Schritt: Erstellen Sie einen Agenten + fügen Sie einen API-Aufrufknoten (HTTP) hinzu

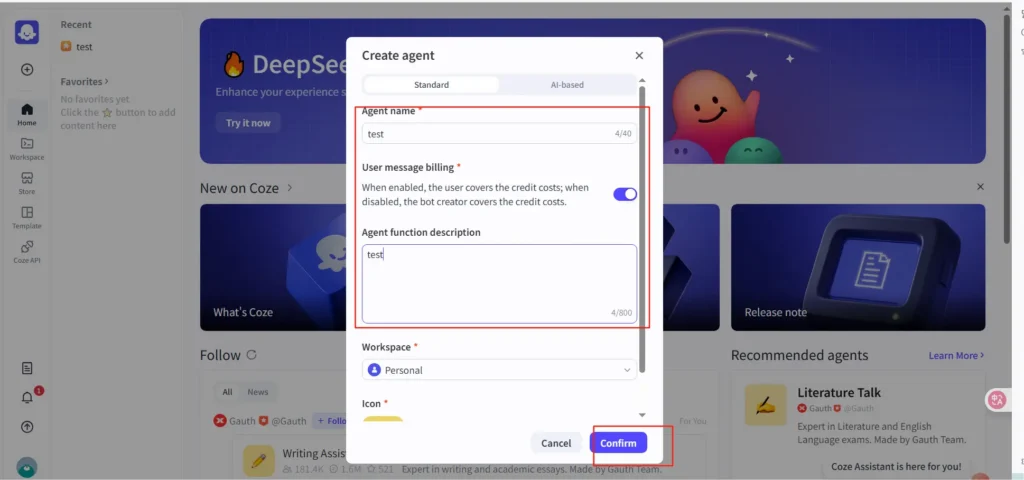

- Erstellen Sie einen Agenten in Coze (Bot/Agent → Erstellen). Konfigurieren Sie Persona, Basis-Eingabeaufforderung und Veröffentlichungseinstellungen, wenn Sie diese später als API verfügbar machen möchten.

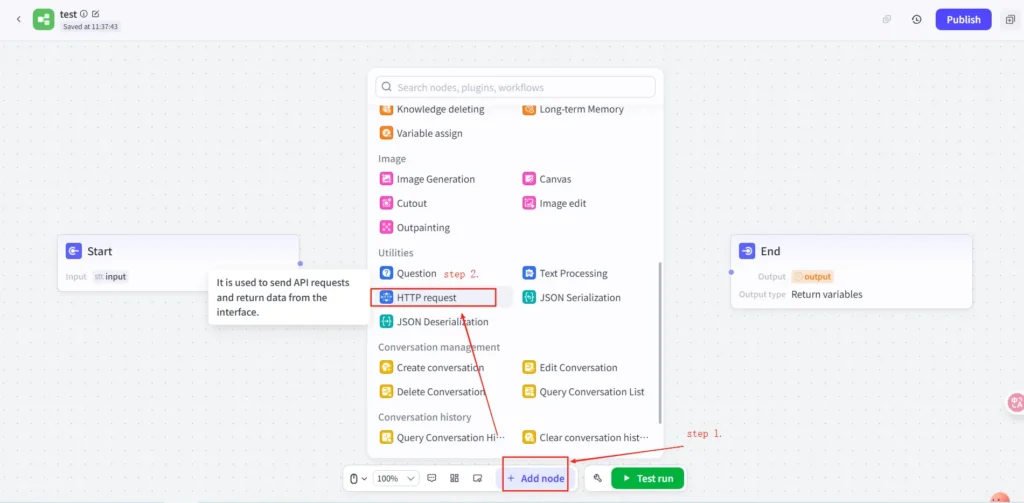

- Offene Workflows für diesen Agenten und fügen Sie einen neuen Workflow hinzu oder bearbeiten Sie einen vorhandenen. Workflows sind visuelle Sequenzen von Knoten (Nachrichtenknoten, Bedingungsknoten, HTTP/API-Knoten usw.).

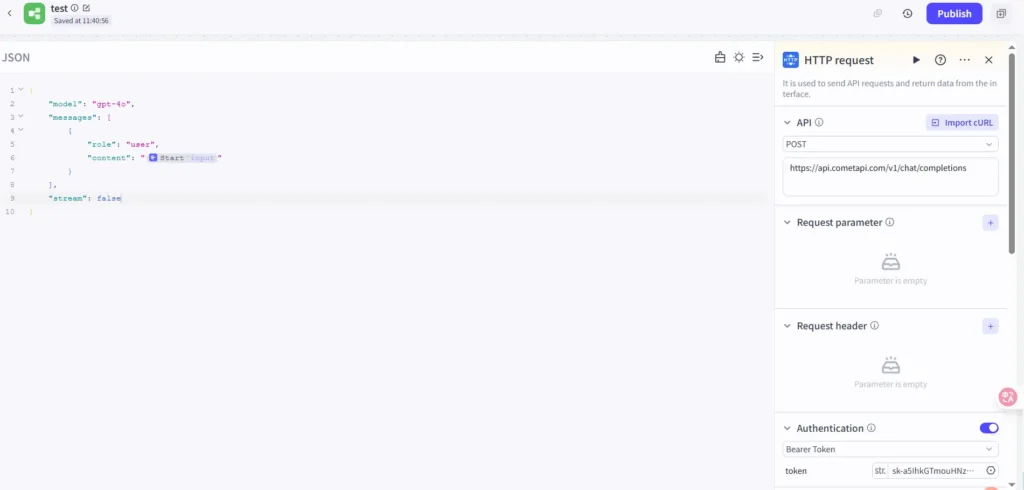

- HTTP-Anforderungsknoten hinzufügen aus der Knotenpalette. Konfigurieren Sie den Knoten für den Aufruf von CometAPI: setze die Methode

POST, URLhttps://api.cometapi.com/v1/chat/completions(oder den modellspezifischen Pfad in Ihren CometAPI-Dokumenten) und fügen Sie Anforderungsheader und -text hinzu. - Fügen Sie in das Eingabefeld „Authentifizierungstoken“ den von CometAPI erhaltenen Schlüssel „sk-xxxxx“ ein und klicken Sie dann auf „Bestätigen“.

Beispiel einer HTTP-Knotenkonfiguration (ohne Streaming)

Kopfzeilen:

Authorization: Bearer sk-<YOUR_COMETAPI_KEY>Content-Type: application/json

Text (JSON – OpenAI-ähnliches Format, unterstützt von CometAPI):

{

"model": "gpt-4.1",

"messages": [

{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"Summarize recent AI news in bullet points."}

],

"stream": false

}

- Verdrahten Sie die Ausgaben wieder mit dem Workflow. Ordnen Sie das HTTP-Antwortfeld zu (z. B.

choices.message.content) in den nachfolgenden Nachrichtenknoten oder die Agentenantwort. Mit Coze-Workflows können Sie JSON-Felder extrahieren und als Variablen wiederverwenden. - Behandeln Sie Streaming und lange Antworten. Wenn Sie gestreamte Token für eine Tipp-UX benötigen, unterstützt Coze die Ausführung von Workflows im Streaming-Antwortmodus und stellt Streaming-Ereignisse bereit. Verwenden Sie die Streaming-Exec-API, wenn Ihre Knoten/Ausgaben dies erfordern.

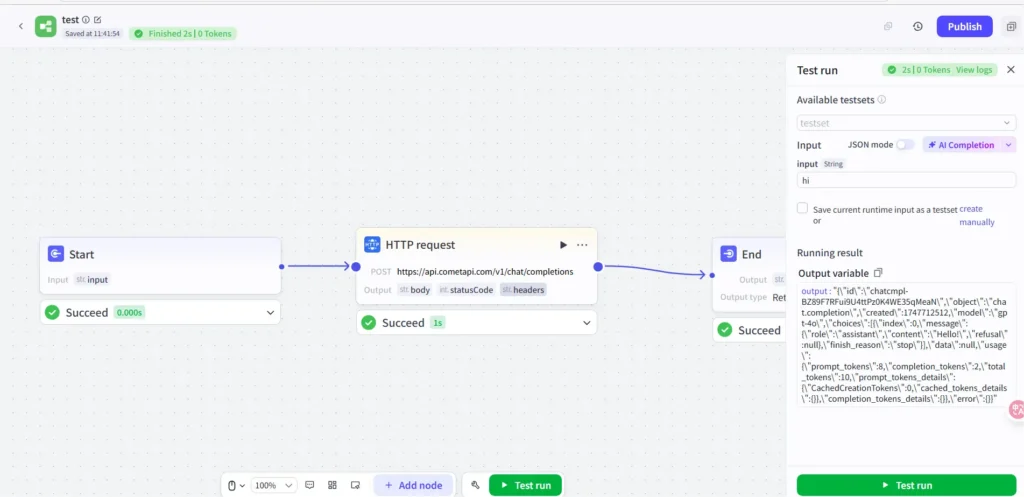

- Wählen Sie für die Ausgabe des Endknotens den Text der HTTP-Anforderung aus, testen und veröffentlichen Sie ihn.

- Gründlich testen. Nutzen Sie die Play/Test-Oberfläche von Coze, um Testläufe durchzuführen und die Ein- und Ausgaben auf Knotenebene zu überprüfen. Coze zeigt eine Testlauf-Benutzeroberfläche mit den Ein- und Ausgaben pro Knoten an, die für die Abbildung von Plugin-Antworten in Agententext äußerst hilfreich ist.

Best Practices für Produktionsintegrationen

1) Sichern Sie Ihre Schlüssel und verwenden Sie Arbeitsbereichsgeheimnisse

Speichern Sie CometAPI-Schlüssel im geheimen Manager von Coze (oder in Umgebungsvariablen) und verweisen Sie in der Plugin-/Auth-Konfiguration darauf. Betten Sie niemals Schlüssel in Eingabeaufforderungen oder Knotenkörper ein.

2) Modellauswahl und Routing-Richtlinien

- Verwenden Sie eine mehrstufige Modellstrategie: kostengünstige Modelle für grundlegende Fragen und Antworten, hochpräzise Modelle für politische/rechtliche/kritische Abläufe.

- Integrieren Sie Auswahllogik in Coze-Workflows, um A/B-Regeln zu verwenden oder Regeln zu ändern, ohne Code neu zu implementieren. Die einheitliche API von CometAPI erleichtert das Umschalten der

modelParameter trivial.

3) Timeouts, Wiederholungsversuche und Backoff

Verpacken Sie Ihre CometAPI-Aufrufe mit Timeouts und exponentiellem Backoff in Coze-Workflow-Knoten. Fügen Sie eine Fallback-Kette hinzu – falls das bevorzugte Modell abläuft, greifen Sie auf ein günstigeres oder zwischengespeichertes Ergebnis zurück. Coze unterstützt bedingte Knoten und Fehlerbehandlung, um dies robust zu gestalten.

4) Kostenkontrolle und Beobachtbarkeit

Verfolgen Sie die Token-Nutzung pro Modell und zeigen Sie diese in Ihrem Observability-Stack an. Nutzen Sie das CometAPI-Dashboard für die Abrechnung und Coze-Protokolle für das Debuggen auf Anfrageebene. Korrelieren Sie Agentenereignisse mit CometAPI-Anfrage-IDs zur Fehlerbehebung.

5) Schnelle Engineering- und Werkzeugbeschreibungen

Schreiben Sie beim Erstellen von Plug-In-Tools in Coze präzise Toolnamen und -beschreibungen. Coze kann diese Beschreibungen an das Modell weitergeben, um die Toolauswahl und die Aufrufgenauigkeit zu verbessern. Halten Sie das Toolschema minimal und streng typisiert.

6) Sicherheit und Inhaltsmoderation

Wenn Ihr Agent mit Benutzerinhalten interagiert, führen Sie einen Sicherheits-/Moderationsdurchlauf (CometAPI oder Ihren eigenen Filter) durch, bevor Sie vertrauliche Ergebnisse weiterleiten. Begrenzen Sie stets die Modellausgaben, um die Weitergabe von Geheimnissen oder personenbezogenen Daten aus optimierten/abgerufenen Inhalten zu vermeiden.

7) Test-Streaming vs. Batch

Streaming bietet dem Endbenutzer ein besseres Tipperlebnis, ist aber komplexer zu handhaben. Verwenden Sie die Streaming-Ausführung von Coze nur, wenn Sie inkrementelle Token benötigen – für viele Back-End-Aufgaben ist ein einzelner API-Aufruf + Antwort einfacher und kostengünstiger.

Welche realen Anwendungsfälle eignen sich am besten für Coze + CometAPI?

Anwendungsfall: Multimodaler Kundensupport-Assistent

- Fließen: Benutzernachricht → Agent entscheidet (Text-LLM zum Verständnis) → ruft Wissensdatenbank ab (Plugin) → generiert Zusammenfassung und vorgeschlagene Antwort (CometAPI LLM) → generiert optional unterstützende Bilder (Midjourney/Suno über CometAPI) → sendet Antwort.

- Warum es funktioniert: Mit CometAPI können Sie Text an hochwertige Schlussfolgerungsmodelle weiterleiten, aber Bildaufgaben an spezialisierte Bildmodelle senden – alles von einem Integrationspunkt aus.

Anwendungsfall: A/B-Modellbewertung in der Produktion

- Fließen: Der Coze-Agent führt dieselbe Eingabeaufforderung für zwei verschiedene CometAPI-Modelle aus (z. B.

o4-minivsgpt-4o) und zeichnet Messwerte (Latenz, Benutzerbewertung) auf, um den Gewinner zu ermitteln. - Warum es funktioniert: Durch die zentrale Modellumschaltung sind A/B-Tests kostengünstig umsetzbar.

Anwendungsfall: Dokumentenautomatisierung und -zusammenfassung im großen Maßstab

- Fließen: Der Coze-Workflow empfängt eine Dokument-URL, ruft CometAPI auf (ein auf die Zusammenfassung langer Kontexte spezialisiertes Modell), extrahiert dann Aktionselemente und schreibt ein strukturiertes Ticket an ein nachgelagertes System.

- Warum es funktioniert: CometAPI unterstützt Dokument-/Datei-Eingabemuster (Beispiele in den Dokumenten) und Coze bietet Workflow-Automatisierung für nachgelagerte Aktionen.

Anwendungsfall: Kreative Pipelines (Marketing-Assets)

- Fließen: Technischen Knoten schnell aufrufen → Slogan generieren (LLM) → Bild generieren (Midjourney- oder Runway-Modell über CometAPI) → Ergebnisse in Marketing-Briefing kombinieren → veröffentlichen.

- Warum es funktioniert: Der Multimodellkatalog von CometAPI umfasst kreative Bild-/Videogeneratoren, die Sie programmgesteuert in einem einzigen Workflow aufrufen können.

Fazit

Die Kombination aus Cozes visueller, Workflow-orientierter Agentenentwicklung und CometAPIs breiter, OpenAI-kompatibler Modelloberfläche bietet Teams eine leistungsstarke Kombination: die Geschwindigkeit von Low-Code-Iterationen und die Flexibilität, für jede Mikroaufgabe die am besten geeigneten Modelle auszuwählen. Beginnen Sie mit dem Plug-in-Ansatz für schnelles Prototyping und wechseln Sie zu expliziten API-Aufruf-Workflows, wenn Sie eine präzisere Kontrolle über Header, Streaming, Wiederholungsversuche oder die Orchestrierung von Multi-Modell-Pipelines benötigen. Behalten Sie Kosten und Qualität im Auge und halten Sie die Modellauswahl konfigurierbar, damit Sie sich an die sich ändernde Modelllandschaft anpassen können.

Erste Schritte

CometAPI ist eine einheitliche API-Plattform, die über 500 KI-Modelle führender Anbieter – wie die GPT-Reihe von OpenAI, Gemini von Google, Claude von Anthropic, Midjourney, Suno und weitere – in einer einzigen, entwicklerfreundlichen Oberfläche vereint. Durch konsistente Authentifizierung, Anforderungsformatierung und Antwortverarbeitung vereinfacht CometAPI die Integration von KI-Funktionen in Ihre Anwendungen erheblich. Ob Sie Chatbots, Bildgeneratoren, Musikkomponisten oder datengesteuerte Analyse-Pipelines entwickeln – CometAPI ermöglicht Ihnen schnellere Iterationen, Kostenkontrolle und Herstellerunabhängigkeit – und gleichzeitig die neuesten Erkenntnisse des KI-Ökosystems zu nutzen.

Erkunden Sie zunächst die Möglichkeiten des Modells in der Spielplatz und konsultieren Sie die Coze-Integrationshandbuch Für detaillierte Anweisungen. Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bieten einen Preis weit unter dem offiziellen Preis an, um Ihnen bei der Integration zu helfen.

Bereit loszulegen? → Melden Sie sich noch heute für CometAPI an !