Mistral 3 ist die Hauptveröffentlichung der Modellfamilie von Mistral AI Ende 2025. Es bringt eine Mischung aus kompakten, schnellen Modellen, die auf lokale/Edge-Bereitstellung ausgerichtet sind, und ein sehr großes spärliches Flaggschiff, das den Stand der Technik in Bezug auf Skalierung und Kontextlänge vorantreibt. Dieser Artikel erklärt, was Mistral 3 ist, wie es gebaut ist, warum Sie es lokal ausführen möchten und drei praktische Wege, es auf Ihrem Rechner oder privaten Server zu betreiben — von der „Klick-und-laufen“-Bequemlichkeit von Ollama über produktives GPU-Serving mit vLLM/TGI bis hin zur CPU-Inferenz auf Kleinstgeräten mit GGUF + llama.cpp.

Was ist Mistral 3?

Mistral 3 ist die neueste Generation von Open-Weight-Modellen von Mistral AI. Die Familie umfasst sowohl ein massives Mistral Large 3 (ein spärliches Mixture-of-Experts — MoE — Modell) als auch mehrere Edge-/„Ministral“-Varianten (3B, 8B, 14B), die auf Instruction-Following und multimodale (Text+Vision) Aufgaben abgestimmt sind. Mistral hat die Veröffentlichung so positioniert, dass sie breit einsetzbar ist: von leistungsstarker Rechenzentrumsinferenz (mit spezialisierten optimierten Checkpoints) bis hin zur Nutzung an der Edge und auf Laptops über quantisierte Formate und kleinere Varianten.

Wichtige praktische Eigenschaften:

- Eine Mixture-of-Experts (MoE)-Architektur in der Large-3-Variante, die zu einer sehr großen „gesamt“ Parameterzahl führt, während pro Token nur eine Teilmenge der Experten aktiviert wird — das verbessert die Effizienz im großen Maßstab.

- Eine Familie von Ministral 3-Modellen (3B / 8B / 14B) für Edge- und lokale Nutzung, mit Instruction-Tuning und multimodalen Varianten.

- Offizielle Checkpoints und eine Reihe optimierter Checkpoints (NVFP4/FP8) für beschleunigte Laufzeiten wie vLLM und NVIDIA-Plattformen.

- Multimodal + mehrsprachig + langer Kontext — Ministral- und Large-Varianten legen Schwerpunkt auf Bild+Text-Verständnis und breite Sprachabdeckung. Für Anwendungen, die Bilder + lange Dokumente kombinieren, ist das wichtig.

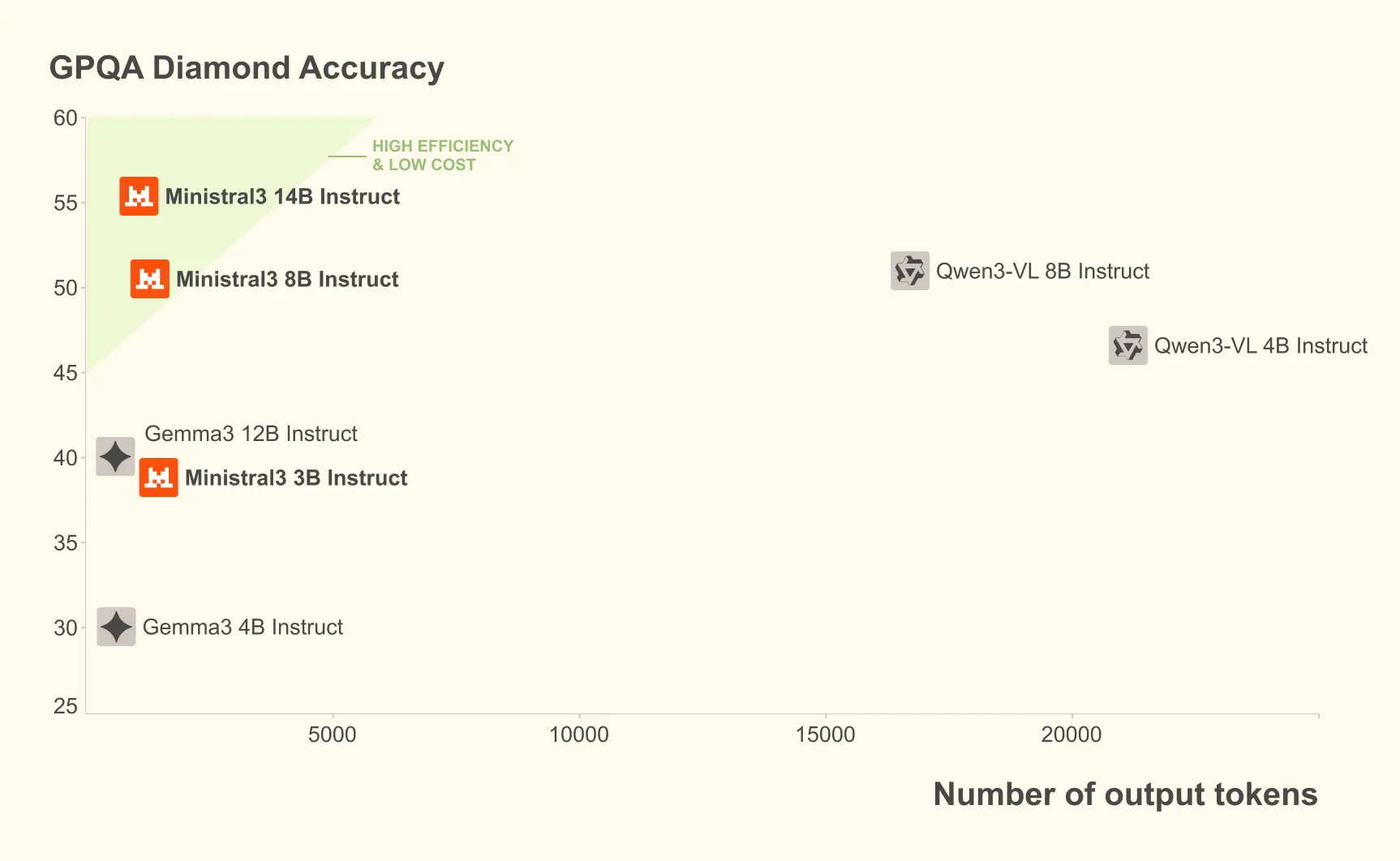

Auf dem GPQA-Diamond-Datensatz (ein rigoroser Test für wissenschaftliches Schlussfolgern) halten verschiedene Varianten von Ministral 3 hohe Genauigkeit, selbst bei zunehmender Anzahl an Ausgabetokens. Beispielsweise hält das Ministral 3B Instruct-Modell 35–40% Genauigkeit beim Umgang mit bis zu 20,000 Tokens, vergleichbar mit größeren Modellen wie Gemma 2 9B, bei geringerem Ressourcenbedarf.

Wie ist die Architektur von Mistral 3?

Mistral 3 ist eine Familie statt einer einzelnen Architektur, aber die beiden Architektur-Muster, die Sie verstehen sollten, sind:

Dichte kleine Modelle (Ministral 3)

- Standard-Transformer-Stacks, optimiert für Effizienz und Edge-Inferenz.

- In mehreren Größen erhältlich (3B/8B/14B) und in unterschiedlichen Fine-Tuning-Varianten: Base, Instruct und Reasoning; viele Varianten beinhalten native multimodale (Vision + Text) Unterstützung und langen Kontextbetrieb. Die Ministral-Modelle werden in einigen Distributionen mit optimierten FP8-Gewichten für Kompaktheit veröffentlicht.

Spärliches Mixture-of-Experts (Mistral Large 3)

- MoE-Architektur: Das Modell hat viele Experten (riesige Gesamtparameterzahl), aber nur eine routing-ausgewählte Teilmenge wird pro Token ausgewertet — das führt zu einem besseren Verhältnis von Skalierung zu Rechenaufwand.

- Mistral Large 3 gibt ~675B Gesamtparameter mit ~41B aktiven Parametern während der Inferenz an, was dieses MoE-Design widerspiegelt. Das Modell wurde auf moderner NVIDIA-Hardware trainiert und für effiziente Niedrigpräzisionsausführung (NVFP4/TensorRT/Optimierungen für große Kernel) optimiert.

Technische Merkmale, die beim lokalen Betrieb wichtig sind:

- Langer Kontext: Einige Mistral-3-Varianten unterstützen sehr lange Kontexte (vLLM- und Mistral-Dokumente erwähnen massive Kontextfenster für bestimmte Varianten; z. B. 256k in manchen Ministral-Varianten). Das beeinflusst Speicher- und Serving-Muster.

- Gewichtsformate & Quantisierung: Mistral stellt Gewichte in komprimierten/optimierten Formaten (FP8, NVFP4) bereit und arbeitet mit modernen Quantisierungs-Toolchains (BitsAndBytes, GPTQ, Anbietertoolchains) für praktische lokale Inferenz.

Warum sollte man Mistral 3 lokal ausführen?

Lokales Ausführen von LLMs ist längst keine Nischenbeschäftigung mehr — es ist eine praktische Option für Teams und Einzelpersonen, die Wert legen auf:

- Datenschutz und Compliance. Lokales Hosting hält sensible Eingaben in Ihrer Infrastruktur (wichtig für Finanzwesen, Gesundheitswesen, Recht). Reuters berichtete über namhafte Kunden, die Mistral-Modelle selbst hosten.

- Latenz und Kostenkontrolle. Für strenge Latenz-SLOs und kalkulierbare Kosten kann lokale oder private Cluster-Inferenz den Cloud-API-Kostenschock schlagen. Kleinere Ministral-Varianten und quantisierte Formate machen das praktikabel.

- Anpassung und Fine-Tuning. Wenn Sie maßgeschränktes Verhalten, Function Calling oder neue Modalitäten benötigen, ermöglicht lokale Kontrolle individuelles Fine-Tuning und Datenverarbeitung. Hugging Face und vLLM-Integration machen das zunehmend „turnkey“.

Wenn diese Gründe mit Ihren Prioritäten — Datenschutz, Kontrolle, Kostenvorhersagbarkeit oder Forschung — übereinstimmen, lohnt sich eine lokale Bereitstellung.

Wie kann man Mistral 3 lokal ausführen (drei praktische Methoden)?

Es gibt viele Wege, Mistral 3 lokal auszuführen. Ich decke drei Ansätze ab, die die häufigsten Anwenderszenarien abdecken:

- Ollama (Zero-Config-Desktop / lokaler Server, für viele Nutzer am einfachsten)

- Hugging Face Transformers + PyTorch / vLLM (volle Kontrolle, GPU-Cluster)

- llama.cpp / ggml / GGUF quantisierte CPU-Inferenz (leichtgewichtig, läuft auf Laptops/CPU)

Für jede Methode nenne ich, wann es sinnvoll ist, die Voraussetzungen, Schritt-für-Schritt-Kommandos und kleine Codebeispiele.

1) Wie lässt sich Mistral 3 mit Ollama ausführen (schnellster Weg)?

Wann verwenden: Sie möchten ein reibungsloses lokales Erlebnis (macOS/Linux/Windows), eine zugängliche CLI oder GUI und automatische Downloads/quantisierte Artefakte, wenn verfügbar. Ollama hat Modelleinträge für Ministral 3 und andere Mitglieder der Mistral-Familie.

Voraussetzungen

- Ollama installiert (dem Installer auf ollama.com folgen). Die Ollama-Bibliothek gibt für einige Ministral-Releases spezifische Mindestversionen an.

- Genug Speicherplatz, um die Modellartefakte zu speichern (Modellgrößen unterscheiden sich — quantisierte Ministral-3B-Versionen können einige GB groß sein; größere BF16-Varianten sind viele Dutzend GB).

Schritte (Beispiel)

- Ollama installieren (macOS-Beispiel — je nach Plattform ersetzen):

# macOS (Homebrew) example — see ollama.com for platform-specific installersbrew install ollama

- Ein Ministral-Modell ausführen:

# Pull and run the model interactivelyollama run ministral-3

- Lokal bereitstellen (API) und aus Code aufrufen:

# Run Ollama server (default port shown in docs)ollama serve# Then curl against it (example)curl -s -X POST "http://localhost:11434/api/v1/generate" \ -H "Content-Type: application/json" \ -d '{"model":"ministral-3","prompt":"Summarize Mistral 3 in one sentence."}'

Hinweise & Tipps

- Ollama übernimmt den Modelldownload und (wenn verfügbar) lokale quantisierte Varianten — sehr praktisch, um Modelle schnell auszuprobieren.

- Wenn Sie das Modell in Produktion mit vielen gleichzeitigen Anfragen verwenden möchten, ist Ollama großartig für Prototyping, aber evaluieren Sie Skalierung und Ressourcen-Orchestrierung für dauerhafte Last.

2) Wie lässt sich Mistral 3 mit Hugging Face Transformers ausführen (GPU / vLLM-Integration)?

Wann verwenden: Sie benötigen programmgesteuerte Kontrolle für Forschung oder Produktion, möchten feinabstimmen oder beschleunigte Inferenz-Stacks wie vLLM auf GPU-Clustern einsetzen. Hugging Face bietet Transformers-Unterstützung und Mistral stellt optimierte Checkpoints für vLLM/NVIDIA bereit.

Voraussetzungen

- GPU mit ausreichendem Speicher (je nach Modell und Präzision). Kleine Ministral-3-Modelle (3B/8B) können auf einer einzelnen Mittelklasse-GPU laufen, wenn quantisiert; größere Varianten erfordern mehrere H100/A100 oder optimierte NVFP4-Checkpoints für vLLM. NVIDIA- und Mistral-Dokumentationen empfehlen spezifische Knotengrößen für die großen Modelle.

- Python, PyTorch, transformers, accelerate (oder vLLM, falls Sie diesen Server möchten).

Python-Beispiel — grundlegende Hugging-Face-Pipeline (3B-Instruct-Variante, GPU):

# Example: CPU/GPU inference with transformers pipeline# Assumes you have CUDA and a compatible PyTorch build.import torchfrom transformers import pipelinemodel_name = "mistralai/Ministral-3-3B-Instruct-2512-BF16" # example HF model idgenerator = pipeline( "text-generation", model=model_name, device_map="auto", torch_dtype=torch.bfloat16, # use bfloat16 if your hardware supports it)prompt = "Explain how attention helps transformers, in 3 sentences."out = generator(prompt, max_new_tokens=120, do_sample=False)print(out[0]["generated_text"])

vLLM für produktive GPU-Inferenz verwenden

vLLM ist darauf ausgelegt, große Modelle effizient zu serven, unterstützt die Mistral-3-Familie und Mistral veröffentlichte Checkpoints, die für vLLM/NVIDIA-Hardware (NVFP4/FP8) optimiert sind, um den Speicherbedarf zu reduzieren und die Geschwindigkeit zu erhöhen. Das Starten eines vLLM-Servers bietet einen latenzarmen, gebündelten Inferenz-Endpunkt. Siehe vLLM-Rezepte und Mistral-Hinweise für Modellpfade und empfohlene Flags.

Hinweise & Tipps

- Für Produktion bevorzugen Sie optimierte Checkpoints (NVFP4/FP8) und setzen empfohlene GPUs ein (z. B. H100/A100) oder nutzen eine Orchestrierungsschicht, die Tensor-/Modell-Parallelismus unterstützt. Mistral und NVIDIA haben Dokumentationen und Blogposts zu optimierten Laufzeiten.

- Fixieren Sie in Produktion den exakten Modell-Checkpoint auf der Platte (oder einen reproduzierbaren HF-Snapshot), um reproduzierbare Ergebnisse sicherzustellen und stille Modellupdates zu vermeiden.

3) Wie lässt sich Mistral 3 auf der CPU mit llama.cpp / GGUF quantisierten Modellen ausführen?

Wann verwenden: Sie benötigen lokale, offline Inferenz auf der CPU (z. B. Entwickler-Laptop, sicheres Air-Gapped-Umfeld) und sind bereit, etwas Genauigkeit gegen Laufzeit- und Speicher-Effizienz zu tauschen. Diese Methode verwendet ggml/llama.cpp und GGUF-quantisierte Gewichte (q4/q5/etc.).

Voraussetzungen

- Ein GGUF-quantisierter Build eines Ministral-Modells (viele Community-Mitglieder veröffentlichen quantisierte GGUFs auf Hugging Face oder konvertieren BF16-Gewichte lokal zu GGUF). Suchen Sie nach

Ministral-3-3B-InstructGGUF-Varianten. - Kompilierte llama.cpp-Binary (der README des Projekts folgen).

Quantisieren (falls Sie Originalgewichte haben) — Beispiel (konzeptionell)

# Example: quantize from an FP16/BF16 model to a GGUF q4_K_M (syntax depends on llama.cpp version)./quantize /path/to/original/model.bin /path/to/out.gguf q4_k_m

Ein GGUF mit llama.cpp ausführen

# run interactive inference with a quantized GGUF model./main -m /path/to/ministral-3-3b-instruct.gguf -t 8 -c 2048 --interactive# -t sets threads, -c sets context (tokens) if supported

Python-Client-Beispiel (lokaler llama.cpp-Server oder Subprozess)

Sie können llama.cpp als Subprozess starten und Prompts einspeisen oder einen kleinen Wrapper-Client verwenden. Viele Community-Projekte bieten einen einfachen HTTP-Server-Wrapper um llama.cpp für die Integration in lokale Apps.

Hinweise & Abwägungen

- Quantisierung reduziert VRAM und ermöglicht CPU-Inferenz, kann aber die Qualität verringern (leicht bis moderat, abhängig vom Quantformat). Formate wie q4_K_M oder q5-Varianten sind gängige Kompromisse für die CPU-Nutzung. Japanische und technische Beiträge erklären Q4-/Q5-Typen und GGUF-Konvertierungen im Detail.

- Für kleine bis mittlere Workloads ist GGUF + llama.cpp oft der günstigste und portabelste Weg, lokale LLMs auszuführen.

Welche Hardware- und Speicheraspekte sind wichtig?

Kurze, praktische Hinweise:

- 3B-Modelle: können oft quantisiert auf einer ordentlichen Laptop-CPU oder einer einzelnen GPU mit 8–16 GB VRAM laufen (je nach Präzision/Quantisierung). GGUF-q4-Varianten laufen auf vielen modernen CPUs.

- 8B- und 14B-Ministral-Modelle: benötigen typischerweise eine Mittelklasse-GPU (z. B. 24–80 GB je nach Präzision und Aktivierungscaching) oder Quantisierung über mehrere Geräte.

- Mistral Large 3 (675B gesamt, 41B aktiv): für den Einsatz im Rechenzentrum vorgesehen und läuft typischerweise am besten mit Multi-GPU-Knoten (z. B. 8×A100 oder H100) und spezialisierten Formaten (NVFP4/FP8) für vLLM. Mistral hat explizit optimierte Checkpoints veröffentlicht, um solche Deployments handhabbar zu machen.

Wenn Ihre Priorität lokale Laptop-Nutzung ist, zielen Sie auf den Weg mit Ministral 3B quantisiertem GGUF + llama.cpp. Wenn Ihre Priorität Produktionsdurchsatz ist, schauen Sie auf vLLM + NVFP4-Checkpoints auf GPUs. Wenn Sie einfache Experimente wollen, ist Ollama der schnellste Einstieg.

Wie sollten Sie Quantisierung und Präzision auswählen?

Quantisierung ist ein Trade-off: Speicher und Geschwindigkeit vs. rohe Modellqualität. Übliche Optionen:

- q4_0 / q4_1 / q4_K_M: beliebte 4-Bit-Optionen für CPU-Inferenz; q4_K_M (K-Means-Variante) bietet oft eine bessere Balance aus Qualität/Performance.

- q5 / q8 / imatrix-Varianten: Zwischenformate, die möglicherweise mehr Fidelity erhalten, dafür größer sind.

- FP16 / BF16 / FP8 / NVFP4: GPU-Präzisionen — BF16 und FP16 sind üblich für Training/Inferenz auf modernen GPUs; FP8 / NVFP4 sind aufkommende Formate, die Speicher sparen und von optimierten Laufzeiten und Mistrals Checkpoint-Releases unterstützt werden.

Faustregel: Für lokale CPU-Läufe wählen Sie q4_K_M oder ähnliches; für GPU-Inferenz mit hoher Fidelity nutzen Sie BF16/FP16 oder anbieter-spezifisches FP8/NVFP4, wenn vom Runtime unterstützt.

Fazit — sollten Sie Mistral 3 lokal ausführen?

Wenn Sie Datenschutz, niedrige Latenz oder Anpassung benötigen, ja: Die Mistral-3-Familie bietet ein breites Spektrum — winzige Modelle für Edge-CPU, mittelgroße Modelle für eine einzelne GPU oder einen kleinen Cluster und eine große MoE-Variante für Rechenzentrumsmaßstab — und das Ökosystem (Ollama, Hugging Face, vLLM, llama.cpp) unterstützt bereits praktische lokale und private Bereitstellungsmuster. Mistral hat zudem mit NVIDIA und vLLM zusammengearbeitet, um optimierte Checkpoints für hohen Durchsatz und reduzierte Speicheranforderungen bereitzustellen, was produktives Self-Hosting realistischer macht als zuvor.

Zum Einstieg: Erkunden Sie die Möglichkeiten weiterer Modelle (wie Gemini 3 Pro) im Playground und konsultieren Sie den API-Leitfaden für detaillierte Anweisungen. Bitte stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bietet einen weit niedrigeren Preis als der offizielle, um Ihnen die Integration zu erleichtern.

Bereit?→ Melden Sie sich noch heute bei CometAPI an !