Das neueste Reasoning-Modell von OpenAI, o3‑pro, stellt einen deutlichen Leistungssprung für KI-basierte Anwendungen dar. o2025‑pro wurde Anfang Juni 3 eingeführt und bietet Entwicklern und Unternehmen fortschrittliches Reasoning, multimodales Verständnis und Tool-Nutzung – und das alles zu einem Premiumpreis. Dieser Artikel fasst die neuesten Ankündigungen, Nutzerberichte und Benchmark-Daten zusammen und bietet einen umfassenden Überblick über Leistung, Kosten und Verfügbarkeit von o3‑pro.

Was ist o3‑pro?

OpenAIs neuestes Angebot, o3‑pro, markiert einen wichtigen Meilenstein im Bereich der KI-Reasoning-Modelle, indem es erweiterte Funktionen mit einem Premium-Preis kombiniert. o11‑pro wurde am 2025. Juni 3 eingeführt und ist der Nachfolger des Standardmodells o3 sowie von o1‑pro in der OpenAI-Produktpalette. Es richtet sich an Entwickler und Unternehmen, denen tiefgehende Analysen und Zuverlässigkeit wichtiger sind als reine Geschwindigkeit. Basierend auf der gleichen Architektur wie o3 – ursprünglich im April 2025 eingeführt – integriert o3‑pro Echtzeit-Websuche, Dateianalyse, visuelles Reasoning, Python-Ausführung und erweiterte Speicherfunktionen und unterstützt so komplexe Arbeitsabläufe in Wissenschaft, Programmierung, Wirtschaft und Schreiben. Der gezielte Reasoning-Ansatz des Modells führt jedoch zu längeren Latenzen und einem erheblichen Kostenanstieg, was auf sein rechenintensives Design zurückzuführen ist.

Was unterscheidet o3‑pro vom Standardmodell von o3?

Fortgeschrittenes multimodales Denken

OpenAI hat o3‑pro anhand mehrerer Standard-KI-Bewertungen rigoros evaluiert, um seine Fähigkeiten im logischem Denken zu bestätigen. Im mathematischen Bereich übertrifft o3‑pro Googles Gemini 2.5 Pro im AIME 2024-Benchmark und demonstriert überlegenes logisches Denken und das Lösen komplexer Gleichungen unter Zeitdruck. Auch im GPQA Diamond-Benchmark – der wissenschaftliches Verständnis und Problemlösungsfähigkeiten auf PhD-Niveau misst – übertrifft o3‑pro Anthropics Claude 4 Opus und unterstreicht damit seine Kompetenz im fortgeschrittenen wissenschaftlichen Denken.

o3‑pro baut auf den Stärken des OpenAI-Flaggschiffmodells o3 auf und integriert Echtzeit-Webbrowsing, Dateianalyse, visuelles Verständnis und die sofortige Ausführung von Python-Funktionen in einer einzigen Oberfläche. Laut OpenAI ermöglicht diese verbesserte Denkfähigkeit o3‑pro die Bewältigung komplexer Aufgaben – wie die Interpretation wissenschaftlicher Daten, das Debuggen von Langformcode und die Generierung multimodaler Inhalte – zuverlässiger als sein Vorgänger.

Zuverlässigkeit statt Latenz

Diese neuen Funktionen sind mit Nachteilen verbunden: Die Reaktionszeiten von o3-pro sind messbar langsamer als die von o3, was die zusätzlichen Rechen- und Kontextverarbeitungsschritte widerspiegelt, die für die Nutzung erweiterter Tools erforderlich sind. Frühanwender berichten von typischen Latenzen von 1.5- bis 2-mal so lang wie bei o3 bei gleichwertigen Eingabeaufforderungen, wobei die genauen Werte je nach Komplexität der Anfrage variieren.

Funktionseinschränkungen beim Start

Zum Start bemerkten o3‑pro-Nutzer einige vorübergehende Einschränkungen: Die Bildgenerierung ist weiterhin nicht verfügbar, und bestimmte ChatGPT-Funktionen – wie flüchtige „Canvas“-Sitzungen und temporäre Chat-Threads – sind deaktiviert, während OpenAI die Infrastruktur für das neue Modell skaliert. Diese Einschränkungen werden sich voraussichtlich in den kommenden Monaten mit der Kapazitätserweiterung verringern.

Wie schneidet o3‑pro im Branchenvergleich ab?

Standardisierte Denktests

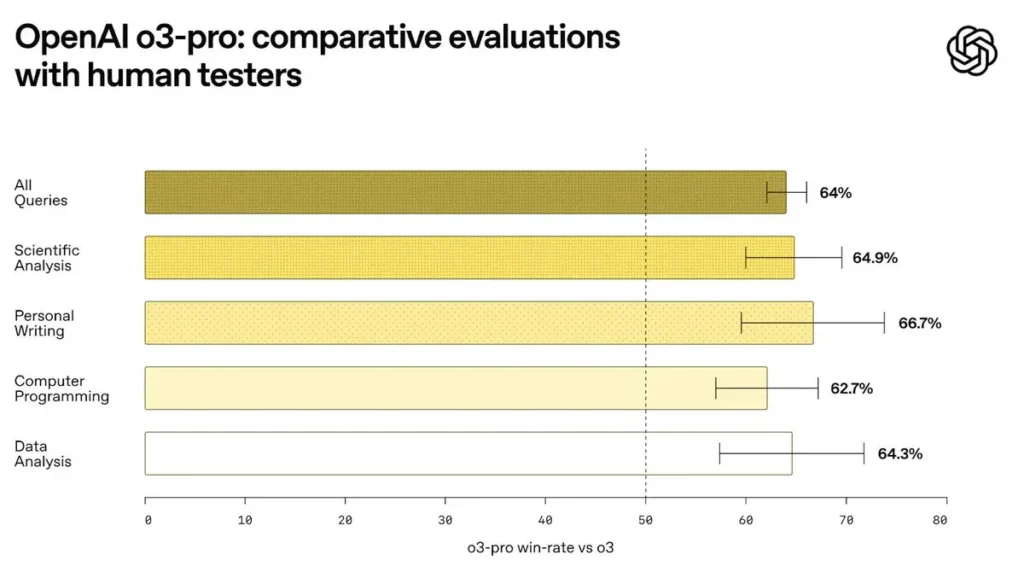

In internen Tests übertraf o3‑pro o3 bei standardisierten Denkaufgaben aus den Bereichen Mathematik, Logikrätsel und Programmieraufgaben deutlich. Die von der Community gemeldeten Ergebnisse beziffern o3 auf rund 2,517 Punkte, während o3‑pro bei 2,748 Punkten liegt – eine Verbesserung um etwa 9 %.

Codierungsevaluierungen in der Praxis

Entwickler, die Live-Codegenerierung und Debugging-Aufgaben ausführen, haben festgestellt, dass o3-pro in Single-Shot- und Few-Shot-Einstellungen syntaktisch korrektere und semantisch präzisere Ergebnisse liefert. Benchmarks in Code-Repositories wie CodeSearchNet zeigen eine um 5–7 % höhere funktionale Korrektheit im Vergleich zu o3, insbesondere bei Problemen mit längeren Kontexten und mehr als 4,000 Token.

Vergleichende Leistung mit Wettbewerbern

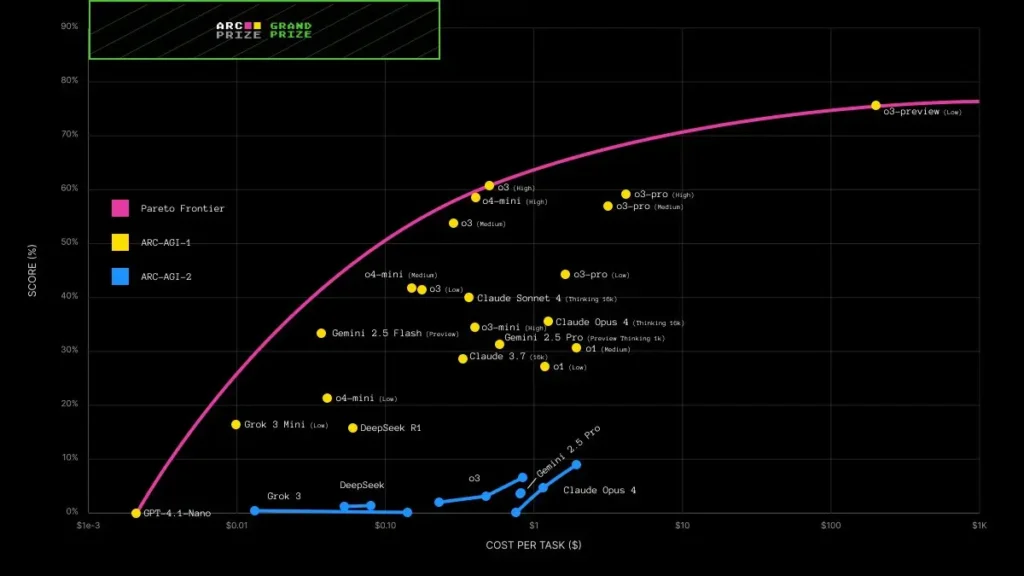

In direkten Vergleichstests schlägt o3-pro nicht nur Gemini 2.5 Pro und Claude 4 Opus bei den Rohergebnissen, sondern liefert auch bei Stresstests mit Gegnern konsistentere Ergebnisse. Durch die Kombination aus multimodaler Eingabeverarbeitung und dynamischer Tool-Nutzung verringert o3-pro den Abstand zu Spezialmodellen von Konkurrenten wie Google PaLM und Anthropic Claude X. Frühe direkte Vergleichstests zeigen, dass o3-pro bei Benchmarks für komplexes Denken die Genauigkeit der Konkurrenz erreicht oder übertrifft, obwohl umfassende Berichte von Drittanbietern noch ausstehen.

Mit welcher Preisstruktur müssen Entwickler rechnen?

Tokenbasiertes Abrechnungsmodell

OpenAI setzt seine tokenbasierte Abrechnung fort: o3‑pro kostet 20 US-Dollar pro Million Input-Token und 80 US-Dollar pro Million Output-Token – genau das Zehnfache des Standardmodells von o3 nach der jüngsten Preissenkung. Im Gegensatz dazu kostet o3 nach einer Preissenkung um 2 % Anfang Juni 8 nun 80 US-Dollar pro Million Input-Token und 2025 US-Dollar pro Million Output-Token.

| Modell | Input Token Preis | Output Token Preis |

|---|---|---|

| o3 | 2 $ / 1 Mio. Token | 8 $ / 1 Mio. Token |

| o3‑pro | 20 $ / 1 Mio. Token | 80 $ / 1 Mio. Token |

Begründung für die Prämie

Diese Verzehnfachung des Preises spiegelt die zusätzlichen Rechenressourcen, die Hochdurchsatzinfrastruktur und die Integration spezialisierter Tools wider, die o3‑pro benötigt. OpenAI positioniert o3‑pro als „unternehmenskritisches“ Modell für Anwendungen, bei denen Genauigkeit und fortgeschrittenes Denken den Kostenaufschlag rechtfertigen.

Mengenrabatte und Batch-API

Unternehmen, die große Token-Mengen verarbeiten, können die Batch-API weiterhin nutzen, um bis zu 50 % der zwischengespeicherten Ein- und Ausgaben einzusparen. Dieser Mechanismus kommt vor allem Großverbrauchern von GPT-4.1-Varianten zugute. Es wird erwartet, dass ähnliche Batching-Optionen später im Jahr 2025 auch für O-Serie-Modelle eingeführt werden.

Wie können Entwickler und Teams auf o3‑pro zugreifen?

API-Verfügbarkeit

In direkten Vergleichstests schlägt o3‑pro nicht nur Gemini 2.5 Pro und Claude 4 Opus bei den Rohergebnissen, sondern liefert auch bei Stresstests mit Gegnern konsistentere Ergebnisse.

OpenAI hat o3‑pro am 10. Juni 2025 über seine öffentliche API zugänglich gemacht, mit sofortiger Unterstützung sowohl in den Completions- als auch in den Chat-Endpunkten. Entwickler können die "o3-pro" Modell in ihren API-Aufrufen, vorbehaltlich der Ratenbegrenzungen und Kontingentbeschränkungen, die an ihre Abonnementstufe gebunden sind.

POST https://api.openai.com/v1/chat/completions

{

"model": "o3-pro",

"messages": ,

"max_tokens": 1500

}

ChatGPT Pro- und Team-Pläne

ChatGPT Pro- und Team-Abonnenten erhalten über die ChatGPT-Oberfläche direkten Zugriff auf o3‑pro. Benutzer können in der Modellauswahl zwischen o3 und o3‑pro wechseln. Die anfängliche Verfügbarkeit ist jedoch auf eine Auswahl von Unternehmenskunden und Betatestern beschränkt.

Über die CometAPI-API

Entwickler können zugreifen o3-Pro API(Modell: "o3-Pro"oder"o3-pro-2025-06-10") durch CometAPIDie neuesten Modelle sind zum Veröffentlichungsdatum des Artikels aufgeführt. Erkunden Sie zunächst die Funktionen des Modells im Spielplatz und konsultieren Sie die API-Leitfaden Für detaillierte Anweisungen. Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bieten einen Preis weit unter dem offiziellen Preis an, um Ihnen bei der Integration zu helfen.

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.cometapi.com/v1",

api_key="<YOUR_API_KEY>",

)

response = client.chat.completions.create(

model="o3-Pro",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices.message.content

print(f"Assistant: {message}")

Welche praktischen Anwendungsfälle profitieren am meisten von o3‑pro?

Wissenschaftliche Forschung und Datenanalyse

Forscher, die mit großen Datensätzen arbeiten – von der Genomik bis zu Klimasimulationen – können die Dateianalyse- und Python-Ausführungsfunktionen von o3-pro nutzen, um Hypothesentests zu automatisieren und Erkenntnisse ohne Kontextlängenbeschränkungen zu gewinnen.

Wissens-Workflows im Unternehmen

In Sektoren wie dem Finanz- und Rechtsdienstleistungsbereich, in denen Präzision und Überprüfbarkeit von größter Bedeutung sind, verringern die verbesserte Einhaltung von Anweisungen und das multimodale Denken von o3-pro die Fehlerraten bei Vertragsprüfungen, der Finanzmodellierung und der Einhaltung gesetzlicher Vorschriften.

Softwareentwicklung & DevOps

Durch die Kombination von Codeverständnis im Langzeitkontext mit Live-Tests durch Python-Ausführung rationalisiert o3-pro das Debuggen und automatisiert komplexe Refactoring-Workflows, wodurch die Bereitstellungszyklen für große Softwareprojekte beschleunigt werden.

Was sollten Organisationen vor einem Upgrade beachten?

Kosten-Nutzen-Analyse

Teams müssen den zehnfachen Preisanstieg gegen die erwarteten Effizienzgewinne abwägen. Bei anspruchsvollen, aber wenig aufwendigen Aufgaben – wie der Erstellung strategischer Berichte oder dem Aufbau kritischer Sicherheitssysteme – können Genauigkeit und Tool-Unterstützung den Aufpreis von o10‑pro rechtfertigen. Für die Erstellung großer Mengen an Inhalten kann es wirtschaftlicher sein, bei den Standardmodellen o3 oder o3‑mini zu bleiben.

Infrastrukturbereitschaft

Da o3‑pro höhere Anforderungen an Latenz und Durchsatz stellt, sollten Unternehmen ihre API-Ratenbegrenzungen, Netzwerkkapazität und Fehlerwiederholungsstrategien überprüfen, um Engpässe während der Spitzenauslastung zu vermeiden.

Ganz zum Schluss ...

Das o3-pro-Modell von OpenAI setzt neue Maßstäbe für fortgeschrittenes Denken, multimodales Verständnis und integrierten Tool-Einsatz in der KI. Seine Benchmark-Gewinne und Zuverlässigkeitsverbesserungen machen es zu einer attraktiven Option für unternehmenskritische Anwendungen, sofern Budget und Infrastruktur die höheren Kosten decken. Mit der Weiterentwicklung der KI-Landschaft wird sich die Rolle von o3-pro in Bereichen festigen, die höchste Genauigkeit und Kontexttiefe erfordern, während kostensensitivere Workloads weiterhin Basismodelle der o-Serie oder neue Mini-Varianten nutzen können.