OpenAI anunció recientemente varias actualizaciones, incluyendo el lanzamiento del modelo GPT-5-Codex-Mini, mejoras en el límite de velocidad para jerarquías multiusuario y optimizaciones en la eficiencia del procesamiento de modelos.

OpenAI's GPT-5-Codex-Mini GPT-5-Codex es una nueva variante de GPT-5-Codex, diseñada para desarrolladores: un modelo más pequeño, optimizado en coste y rendimiento, que ofrece la mayor parte de la asistencia de codificación de GPT-5-Codex a un coste mucho menor y con un mayor volumen de uso. La variante «Mini» se presenta como una opción práctica para sesiones de codificación largas, automatización en segundo plano y flujos de trabajo de desarrollo de alta frecuencia, donde la capacidad máxima bruta es menos importante que obtener más tokens/solicitudes para el mismo plan.

¿Qué es GPT-5-Codex-Mini y cuáles son sus características?

GPT-5-Codex-Mini es una variante compacta y económica de la familia GPT-5-Codex de OpenAI, diseñada específicamente para la integración con la interfaz de línea de comandos (CLI) y el entorno de desarrollo integrado (IDE) de Codex. Se presenta como un modelo más pequeño y económico que sacrifica una pequeña parte de su capacidad máxima a cambio de un consumo de recursos considerablemente menor y una mayor cuota de recursos utilizables para flujos de trabajo de desarrollo interactivos. El modelo mini permite a los desarrolladores ejecutar muchas más operaciones de codificación (OpenAI lo describe aproximadamente así). 4 veces más uso para el mismo nivel de suscripción de ChatGPT) manteniendo bajos la latencia y los costos para tareas de ingeniería comunes y bien definidas.

En cuanto a sus capacidades, GPT-5-Codex-Mini hereda las características principales de la línea de productos Codex: un profundo conocimiento del código fuente y la ejecución de tareas de varios pasos de forma automatizada. Gracias a las funciones de la interfaz de línea de comandos (CLI) de Codex, los desarrolladores pueden enviar comandos en lenguaje natural, fragmentos de código, capturas de pantalla o diagramas de diseño de interfaz a Codex en una terminal interactiva. El modelo primero generará un plan y, tras obtener la aprobación del usuario, explorará automáticamente los archivos, editará el código, ejecutará comandos y realizará pruebas.

Desde una perspectiva modal, los productos Codex permiten adjuntar imágenes (como capturas de pantalla de la interfaz de usuario, bocetos de diseño o capturas de pantalla de mensajes de error) a la sesión en la terminal o el IDE. El modelo puede interpretar tanto texto como imágenes, pero la salida sigue siendo principalmente código y explicaciones. Por lo tanto, GPT-5-Codex-Mini puede considerarse un modelo proxy de código que se centra principalmente en la entrada de texto e imágenes y la salida de texto, y no realiza tareas como la generación de imágenes, audio o vídeo.

¿Qué diferencias hay entre GPT-5-Codex-Mini y GPT-5-Codex?

¿Qué novedades hay en Codex?

Además del lanzamiento de GPT-5-Codex-Mini, OpenAI ha aumentado uniformemente el límite de solicitudes del Codex en un 50 % para los niveles de usuario ChatGPT Plus, Business y Edu, incrementando significativamente el límite de solicitudes disponibles. Asimismo, los usuarios de ChatGPT Pro obtendrán permisos de procesamiento prioritarios para mejorar la velocidad de respuesta y la experiencia de ejecución de tareas.

Además, OpenAI ha realizado una pequeña actualización del modelo GPT-5-Codex, optimizando su rendimiento en escenarios colaborativos. El modelo actualizado muestra mejoras de varios puntos porcentuales en las métricas de evaluación clave, un aumento aproximado del 3 % en la eficiencia del uso de tokens y una mayor robustez en el manejo de casos límite, lo que reduce la necesidad de asistencia al usuario.

| nivel de usuario | Códice GPT-5 | GPT-5-Codex-Mini |

|---|---|---|

| Plus/Negocios/Educación | aumenta el volumen de mensajes en 1.5x respectivamente. | aumenta el volumen de mensajes en 6x respectivamente. |

GPT-5-Codex-Mini vs GPT-5-Codex: diferencias en las pruebas de rendimiento

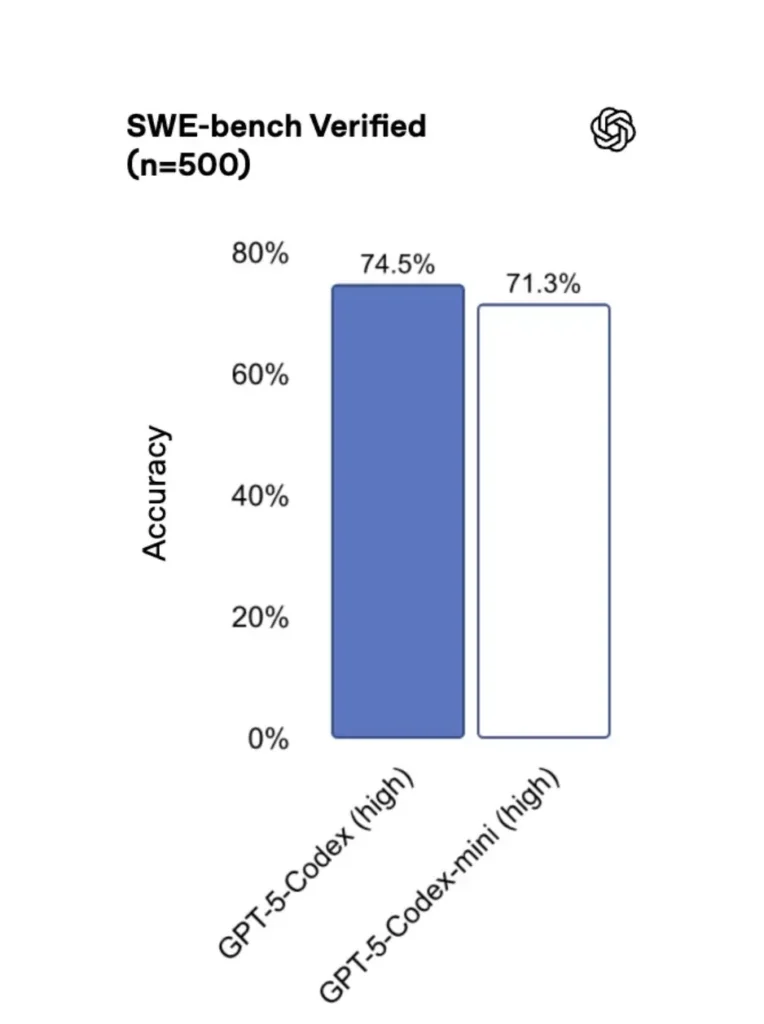

GPT-5-Codex-Mini, en comparación con la versión original, tiene un rendimiento ligeramente inferior, pero ofrece a los desarrolladores aproximadamente cuatro veces más créditos de uso. En la prueba verificada de SWE-bench, GPT-5 High obtuvo una puntuación del 72.8 %, GPT-5-Codex del 74.5 % y GPT-5-Codex-Mini del 71.3 %.

Codex (y su variante mini) utilizan muchos menos tokens para interacciones sencillas; los materiales de OpenAI afirman reducciones del orden de decenas de puntos porcentuales para indicaciones simples (por ejemplo, una cifra citada de ≈93.7% menos tokens sobre interacciones ligeras para la familia Codex frente a GPT-5 en algunos escenarios).

GPT-5-Codex-Mini vs GPT-5-Codex: diferencias de características

- Tamaño y precio: Mini es explícitamente más pequeño y rentable; OpenAI lo presenta como una solución que permite un uso aproximadamente cuatro veces mayor con las mismas restricciones de suscripción. Se trata de una optimización de cuotas y eficiencia para las tareas rutinarias de los desarrolladores.

- Envolvente de capacidad: GPT-5-Codex sigue siendo la opción más potente para tareas de agentes largas y complejas (grandes refactorizaciones, revisiones de código exhaustivas, ciclos de prueba prolongados). Mini está optimizado para ser más ágil y consumir menos recursos en interacciones cortas y frecuentes.

- Límites de latencia y velocidad: Mini suele ofrecer una latencia más baja y permite límites de velocidad más altos por plan, lo que lo hace adecuado para flujos de trabajo densos e interactivos.

- Superficies predeterminadas: Mini está disponible como modelo seleccionable en Codex CLI y en la extensión IDE; GPT-5-Codex es el valor predeterminado para las tareas en la nube y los flujos de revisión de código profundo en Codex.

Cuándo usar el Códice Mini o el Códice Completo

- Use Mini para: creación de andamios, generación de código repetitivo, pequeñas refactorizaciones, autocompletado interactivo durante la edición y cuando se trabaja con una cuota o restricción de costos.

- Use Códice GPT-5 Para: revisiones de código exhaustivas, tareas autónomas de varias horas, refactorizaciones complejas y tareas que requieren el razonamiento más sólido del modelo y una ejecución basada en pruebas.

¿Cómo puedo acceder a GPT-5-Codex-Mini (CLI, IDE, API)?

Codex CLI (primero la terminal)

Presentación de OpenAI gpt-5-codex-mini como opción de modelo dentro de la CLI de Codex. Los patrones de uso típicos siguen el flujo de trabajo de la CLI de Codex: iniciar una sesión interactiva, especificar el modelo, adjuntar archivos o capturas de pantalla, ejecutar "tareas de Codex Cloud", etc. La CLI también admite acceso rápido. /model alternando entre completo gpt-5-codex y gpt-5-codex-miniLa primera vez que ejecute la aplicación, deberá autenticarse con su cuenta de ChatGPT/Pro/Enterprise (o proporcionar una clave API). La interfaz de línea de comandos (CLI) ofrece varios comandos que permiten a Codex analizar bases de código, ejecutar pruebas, abrir entornos REPL o aplicar recomendaciones de parches.

Ejemplo (sesión interactiva de la CLI de Codex):

# Install Codex CLI (npm)

npm i -g @openai/codex

# or Homebrew on macOS

brew install --cask codex

# Launch in a repo

cd myproject

# Open a codex interactive session

codex

# In the session you can switch the model:

# (this is typed in the Codex TUI)

> /model gpt-5-codex-mini

# Ask Codex to generate a unit test

> Write pytest tests for function `calculate_discount` in discounts.py

Ese flujo refleja los nuevos valores predeterminados de la CLI de Codex, donde la herramienta sugerirá Mini cerca de los límites de uso.

Extensión para VS Code / IDE

Sí, la extensión Codex IDE (VS Code) ya la incluye. gpt-5-codex-mini Como opción, instala la extensión Codex en Visual Studio Code para obtener autocompletado de código en línea, sugerencias de refactorización y correcciones rápidas basadas en IA. La extensión también ofrece acciones rápidas (generar código, explicar el código seleccionado, refactorizar) y permite ejecutar tareas de Codex Cloud desde el editor. Pasos de VS Code:

- Instala la extensión OpenAI Codex / ChatGPT para VS Code.

- Inicia sesión con tu cuenta de ChatGPT (Plus/Pro/Business).

- Abre la paleta de comandos:

Cmd/Ctrl+Shift+P → Codex: Set Model→ elegirgpt-5-codex-mini. - Utilice comandos en línea (seleccione el código → haga clic con el botón derecho → “Explicar con Codex” o pulse la tecla de acceso rápido configurada).

Ejemplo: Comando en línea de VS Code (pseudo pasos)

- Seleccione una función en

user_service.py. - Prensa

Cmd/Ctrl+Shift+P → Codex: Explain Selectiono bien, utilice el botón derecho del ratón → “Explicar con el Códice”. - La extensión abre un panel lateral con la explicación de Mini, pruebas sugeridas y un botón "Crear PR" de un solo clic que utiliza las tareas de Codex Cloud para enviar una rama para su revisión.

¿Y la API? ¿Puedo llamarla desde mi aplicación?

Los anuncios de OpenAI indican Próximamente estará disponible la compatibilidad con API. Para GPT-5-Codex-Mini; al momento de redactar este documento, el modelo está disponible primero en la cadena de herramientas Codex (CLI/IDE). Esto significa que los clientes de la API de producción deben prepararse para el nombre del modelo. gpt-5-codex-mini en la API de Solicitudes/Respuestas una vez publicada. Mientras tanto, puedes crear prototipos con la CLI de Codex y los flujos del IDE.

Cuando el acceso a la API está habilitado, una llamada típica (al estilo de las respuestas) podría tener el siguiente aspecto:

# illustrative — check OpenAI docs for final param names

from openai import OpenAI

client = OpenAI(api_key="sk-...")

resp = client.responses.create(

model="gpt-5-codex-mini",

input="Write a Python function that validates an email address and includes unit tests.",

max_tokens=512,

temperature=0.2

)

print(resp.output_text)

¿Cuáles son las mejores prácticas para la ingeniería rápida con Codex Mini?

A continuación se presentan prácticas recomendadas y patrones concretos y probados en campo para obtener el máximo valor de Codex Mini en los flujos de trabajo de ingeniería de producción.

1) Estrategia de selección de modelos: combinación y selección

Usa Mini para tareas frecuentes y de baja complejidad (formateo, pequeñas refactorizaciones, pruebas automáticas) y recurre a Codex completo para diseño complejo, depuración exhaustiva o transformaciones importantes en todo el repositorio. Automatiza el cambio: la CLI de Codex ya sugiere Mini cuando se utiliza al 90%, y puedes crear un script para ello. /model Cambia en tus herramientas para elegir un modelo según la complejidad de la tarea.

2) Plantillas de ingeniería rápidas

Crea plantillas de prompts breves y deterministas para tareas repetitivas: generación de pruebas, borradores de registros de cambios, generación de mensajes de commit y descripciones de pull requests. Guárdalas como fragmentos reutilizables en tu repositorio o como preajustes de prompts en Codex.

Ejemplo de plantilla de solicitud para pruebas unitarias:

# Template: generate_pytests

System: You are a precise Python developer. Produce pytest tests.

User: Given the function below, produce parametrized pytest functions that cover typical edge cases.

--- file: discounts.py

<insert function>

---

Return only valid Python test code with imports and fixtures.

3) Automatizar las redes de seguridad: aprobaciones y control de acceso a la información.

Nunca permitas que un modelo envíe código directamente sin aprobación humana. Usa los modos de aprobación de Codex y las tareas de Codex Cloud para crear diferencias y requerir la aprobación humana en la integración continua (CI). La CLI de Codex admite "modos de aprobación", por lo que las modificaciones deben aprobarse antes de aplicarse.

4) Almacenar en caché y eliminar llamadas duplicadas al modelo

Para solicitudes repetitivas (p. ej., explicar una función), almacene en caché la respuesta indexada por la solicitud y el hash del archivo. Esto reduce las llamadas redundantes y mantiene un perfil de coste predecible.

5) Utilizar diferencias incrementales y en streaming

Siempre que sea posible, solicite salidas en tiempo real y diferencias incrementales en lugar de reescrituras de archivos completos. Esto reduce el uso de tokens y ayuda a los revisores a ver los cambios específicos.

6) Prueba unitaria: flujo del generador primero

Genera pruebas y ejecútalas localmente en un entorno efímero. Si las pruebas fallan, itera con el modelo proporcionando correcciones para las pruebas fallidas. Presenta cada iteración como una solicitud independiente con los resultados de las pruebas incluidos.

Ejemplo de fragmento de automatización de la CLI de Codex (bash):

# Generate tests

codex --model gpt-5-codex-mini request "Generate pytest tests for discounts.py" > generated_tests.py

# Run tests locally

pytest generated_tests.py -q || {

echo "Tests failed. Opening Codex for debugging..."

codex --model gpt-5-codex-mini request "Tests failed. Here's pytest output: $(tail -n 50 pytest_output.txt). Propose a fix for discounts.py."

}

Conclusión

GPT-5-Codex-Mini es una medida pragmática del producto: reconoce que los flujos de trabajo de los desarrolladores suelen estar dominados por numerosas interacciones breves donde la latencia, el coste y la continuidad del flujo son cruciales. Al ofrecer un nivel básico diseñado para su uso en IDE y CLI, OpenAI permite a los equipos escalar la asistencia diaria a la codificación sin tener que recurrir inmediatamente al modelo de mayor coste en cada interacción.

Los desarrolladores pueden acceder API del códice GPT-5 ,API de GPT-5 Pro A través de CometAPI, los modelos más recientes de cometAPI se listan a la fecha de publicación del artículo. Antes de acceder, asegúrese de haber iniciado sesión en CometAPI y obtenido la clave API.CometAPI Ofrecemos un precio muy inferior al oficial para ayudarte a integrarte.

¿Listo para ir?→ Regístrate en CometAPI hoy !

Si quieres conocer más consejos, guías y novedades sobre IA síguenos en VK, X y Discord!