LobeChat y CometAPI son dos proyectos en constante evolución en el ecosistema abierto de IA. En septiembre de 2025, LobeChat fusionó una integración completa con el proveedor CometAPI, lo que facilita la llamada a los endpoints unificados de CometAPI, compatibles con OpenAI, desde LobeChat. Este artículo explica qué son LobeChat y CometAPI, por qué integrarlos, la integración y configuración paso a paso (incluida una configuración básica del proveedor TypeScript lista para usar), ejemplos de tiempo de ejecución, casos de uso concretos y consejos de producción para optimizar el coste, la fiabilidad y la observabilidad.

¿Qué es LobeChat y qué funcionalidades ofrece?

LobeChat es un moderno framework de chat de código abierto diseñado para alojar aplicaciones de chat LLM multiproveedor con una interfaz de usuario optimizada y herramientas de implementación. Está diseñado para admitir entradas multimodales (texto, imágenes, audio), flujos de trabajo de base de conocimiento/RAG, conversaciones ramificadas y visualizaciones de cadena de pensamiento. Además, cuenta con un sistema extensible de proveedores y complementos que permite intercambiar diferentes backends de modelos sin tener que rediseñar la aplicación. La documentación y el repositorio de LobeChat lo presentan como un framework listo para producción, tanto para implementaciones alojadas en servidores propios como en la nube, con configuración basada en el entorno y un marketplace para integraciones MCP (plano de control del modelo) de terceros.

Características clave de LobeChat de un vistazo

- Soporte multiproveedor (OpenAI, Anthropic, Google Gemini, Ollama, etc.).

- Carga de archivos + base de conocimientos para flujos de trabajo RAG (documentos, PDF, audio).

- Configuración amigable para desarrolladores a través de variables de entorno y configuración-importación de URL.

- Tiempo de ejecución extensible: los proveedores se configuran con tiempos de ejecución de adaptadores pequeños para que se puedan conectar nuevos backends.

¿Qué es CometAPI?

CometAPI es una capa unificada de acceso a IA que expone más de 500 modelos de diversos proveedores subyacentes a través de una única superficie API compatible con OpenAI. Permite a los desarrolladores seleccionar los puntos finales de los modelos según su rendimiento, coste o capacidad sin dependencia, y centralizar la facturación, el enrutamiento y el acceso. CometAPI anuncia puntos finales unificados para chat/finalizaciones y una API de lista de modelos para descubrir los ID de modelo disponibles.

Por qué CometAPI es atractivo para los equipos

- Elección del modelo y portabilidad: cambiar entre muchos modelos de vanguardia sin cambiar significativamente el código de integración.

- Puntos finales compatibles con OpenAI: Muchas bibliotecas de cliente y marcos que esperan puntos finales HTTP de estilo OpenAI pueden funcionar con CometAPI cambiando la URL base + autenticación. (Los ejemplos prácticos muestran

https://api.cometapi.com/v1/como una superficie compatible con OpenAI). - Documentación para desarrolladores e integraciones: CometAPI publica documentos y guías paso a paso para la integración con herramientas como LlamaIndex y otras plataformas de bajo código.

¿Por qué debería integrar CometAPI en LobeChat?

Respuesta corta: flexibilidad, control de costes y acceso rápido a nuevos modelosLobeChat está diseñado para ser independiente del proveedor; al conectar CometAPI, su implementación de LobeChat puede llamar a varios modelos diferentes a través de la misma ruta de código: intercambie modelos por rendimiento, latencia, costo o capacidad sin cambiar la interfaz de usuario ni los flujos de comandos. Además, la comunidad y los mantenedores han incorporado activamente la compatibilidad con el proveedor CometAPI a LobeChat, lo que facilita la integración.

Beneficios comerciales y técnicos

- Diversidad de modelos sin rotación de código. ¿Necesita evaluar Gemini, Claude o un modelo de imagen específico? CometAPI puede exponer los ID de esos modelos mediante una única API. Esto reduce la necesidad de conectar a cada proveedor en LobeChat.

- Optimización de costos. CometAPI le permite dirigirse a modelos más económicos o seleccionar proveedores de menor costo de forma dinámica, lo que puede reducir sustancialmente los costos por conversación para implementaciones de gran volumen.

- Gestión de secretos más sencilla. Una clave API para administrar en la configuración de LobeChat o en el entorno Docker, en lugar de varias claves de proveedor. La plataforma LobeChat ya permite habilitar un proveedor mediante

ENABLED_<PROVIDER>y un patrón de variable de entorno de clave de proveedor, por lo que la integración es operativamente consistente. - Mantiene la base de código de LobeChat mínima: la lógica del proveedor está encapsulada y configurada con variables de entorno.

¿Cómo configuro e integro CometAPI en LobeChat?

Esta sección ofrece una receta práctica, paso a paso: obtener claves, configurar variables de entorno, añadir el proveedor a LobeChat (ejemplo de configuración del proveedor) y mostrar el uso en tiempo de ejecución (llamada de chat). Los ejemplos siguen los patrones de proveedor de LobeChat y los endpoints compatibles con CometAPI OpenAI.

1) Obtenga una cuenta CometAPI y una clave API

Regístrate en CometAPI y abre la consola de la API. Para registrar una cuenta de CometAPI, deberás usar una dirección de correo electrónico o iniciar sesión directamente con Google One-Click.

Después de completar el registro, vaya al área de juegos y haga clic en Agregar nueva clave secreta para crear una nueva clave API:

Obtenga una clave API.

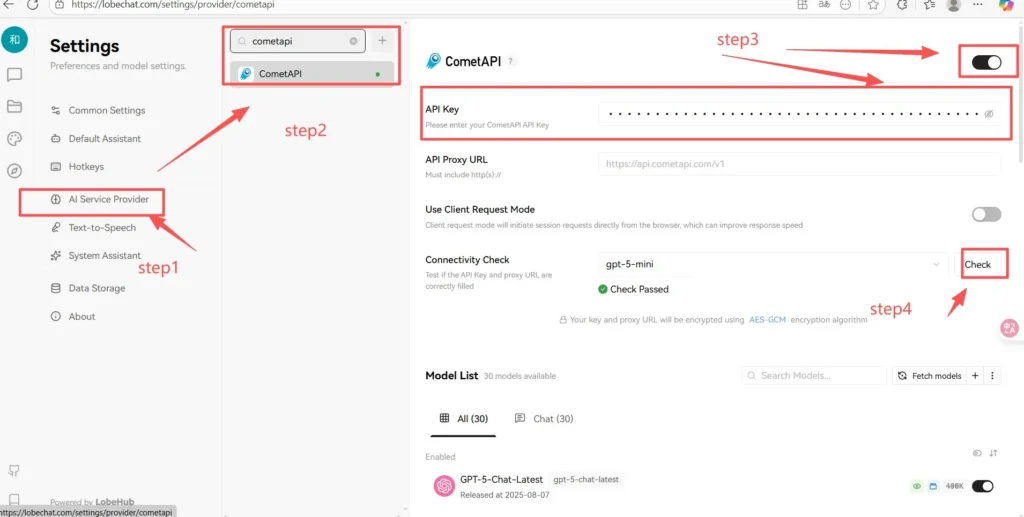

2) Configuración de CometAPI en LobeChat

- Ingresa al menú de configuración de Lobe-Chat, haz clic en el avatar, haz clic en la opción de configuración de la aplicación.

- Seleccione cometapi como proveedor de modelos.

- Pegue el sk-xxxxx de cometapi en el cuadro de entrada de la clave API y active el botón, seleccione un modelo para verificar

3) Probar la llamada

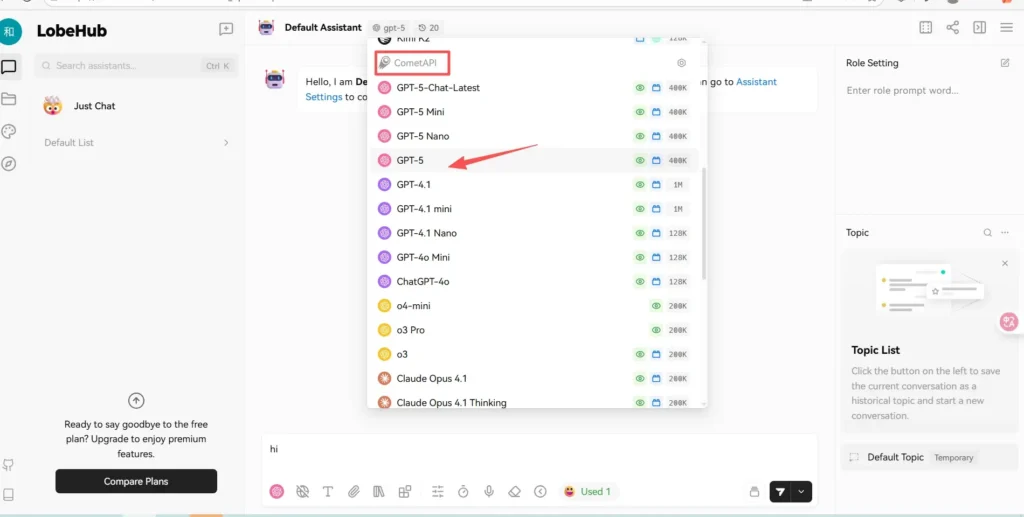

Seleccione el modelo de CometAPI que desea comprobar. Introduzca un comando de prueba sencillo en Lobe-Chat. Si la llamada es correcta, recibirá la respuesta correspondiente; si falla, compruebe si la configuración es correcta o contacte con el servicio de atención al cliente en línea de CometAPI.

Actualmente, cometapi ofrece más de 30 modelos más recientes de los principales desarrolladores (openAI, grok, claude, gemini) en lobechat.

¿Cómo se puede ampliar la integración (mejoras avanzadas)?

¿Quieres ir más allá de lo básico? Aquí tienes los siguientes pasos concretos que llevarán tu integración de funcional a producción.

Mejora 1: Orquestación de modelos dinámicos (agentes multimodelo)

Cree una lógica de agente en LobeChat que asigne subtareas dinámicamente a diferentes modelos de Comet (p. ej., un modelo de incrustación pequeño para recuperación, un modelo mediano para borrador y un modelo de alta capacidad para resumen). Utilice el sistema de llamadas a funciones/complementos de LobeChat para coordinar el flujo de trabajo y agregar las respuestas finales.

Mejora 2: Almacenamiento en caché de incrustaciones y respuestas

Al usar incrustaciones (para RAG), computarlas una vez y almacenarlas en caché para reducir la sobrecarga. Si llama a CometAPI para incrustaciones, almacene las representaciones vectoriales en su base de datos de vectores y vuelva a computarlas solo cuando haya cambios de contenido. Esto reduce los tokens y el coste.

Mejora 3: Configuración por inquilino y cuotas

Si ejecuta una instancia multiinquilino de LobeChat, controle los límites por inquilino (solicitudes/hora, niveles de modelo) mediante la creación de un middleware que asigne el ID del inquilino a la lista de modelos permitidos (usando los ID de modelo de CometAPI). Esto permite que los niveles premium tengan acceso a mejores modelos.

Mejora 4: Utilizar metadatos del modelo y comprobaciones de estado

Implemente comprobaciones del estado del proveedor que llamen a un "ping de modelo" ligero de CometAPI o a una llamada de chat mínima para garantizar que la latencia se ajuste a los SLA; de lo contrario, evite usar modelos de respaldo. Mantenga un monitor de latidos y presente el estado del proveedor en la interfaz de administración de LobeChat.

¿A qué peligros debemos prestar atención?

- Exposición de la clave APINunca guarde las claves de CometAPI en el código del cliente. Manténgalas siempre en el servidor (capa de servidor de LobeChat).

- Cambio de nombre del modeloCometAPI puede añadir o descontinuar identificadores de modelo. Utilice un mapeo de servidor y actualice

COMETAPI_MODEL_LISTcuando quieras exponer nuevos modelos. - Diferencias en el formato de respuesta:Si bien CometAPI busca la compatibilidad con OpenAI, algunos modelos o metacampos pueden diferir; siempre asigne y desinfecte las respuestas antes de mostrarlas a los usuarios.

Primeros Pasos

CometAPI es una plataforma API unificada que integra más de 500 modelos de IA de proveedores líderes, como la serie GPT de OpenAI, Gemini de Google, Claude de Anthropic, Midjourney, Suno y más, en una única interfaz intuitiva para desarrolladores. Al ofrecer autenticación, formato de solicitudes y gestión de respuestas consistentes, CometAPI simplifica drásticamente la integración de las capacidades de IA en sus aplicaciones. Ya sea que esté desarrollando chatbots, generadores de imágenes, compositores musicales o canales de análisis basados en datos, CometAPI le permite iterar más rápido, controlar costos y mantenerse independiente del proveedor, todo mientras aprovecha los últimos avances del ecosistema de IA.

Para comenzar, explore las capacidades del modelo en el Playground y consultar el Guía de API Para obtener instrucciones detalladas, consulte la sección "Antes de acceder, asegúrese de haber iniciado sesión en CometAPI y de haber obtenido la clave API". CometAPI Ofrecemos un precio muy inferior al oficial para ayudarte a integrarte.

¿Listo para ir?→ Regístrate en CometAPI hoy !

Conclusión

Integrar CometAPI en LobeChat es una forma práctica de obtener diversidad de modelos, flexibilidad de costos y una rápida capacidad de experimentación, manteniendo al mismo tiempo las características de UX y RAG perfeccionadas que ofrece LobeChat. La comunidad de LobeChat ya ha hecho un gran esfuerzo para añadir compatibilidad con CometAPI (tarjeta de proveedor, lista de modelos, adaptadores de tiempo de ejecución, pruebas y documentación), que puede aprovechar directamente o usar como inspiración para implementar un adaptador personalizado para necesidades específicas. Para conocer los pasos de integración más precisos y los ejemplos más recientes, consulte la documentación de CometAPI y la Documentación del proveedor de modelos de LobeChat y repositorio: los enlaces a los que se hace referencia a continuación le ayudarán a continuar.