El último modelo de razonamiento de OpenAI, o3-pro, representa un avance significativo en rendimiento y capacidad para aplicaciones basadas en IA. Lanzado a principios de junio de 2025, o3-pro ofrece a desarrolladores y empresas razonamiento avanzado, comprensión multimodal y uso de herramientas, todo a un precio premium. Este artículo sintetiza los anuncios, informes de usuarios y datos de referencia más recientes para ofrecer una visión general completa del rendimiento, los costos y la disponibilidad de o3-pro.

¿Qué es o3‑pro?

La última oferta de OpenAI, o3-pro, marca un hito significativo en los modelos de razonamiento de IA al combinar capacidades mejoradas con un precio superior. Lanzado el 11 de junio de 2025, o3-pro sucede al modelo estándar o3 y reemplaza a o1-pro en la línea de productos de OpenAI, dirigido a desarrolladores y empresas que priorizan el análisis profundo y la fiabilidad sobre la velocidad bruta. Basado en la misma arquitectura subyacente que o3 (presentado originalmente en abril de 2025), o3-pro integra búsqueda web en tiempo real, análisis de archivos, razonamiento visual, ejecución en Python y funciones avanzadas de memoria, abordando flujos de trabajo complejos en ciencia, programación, negocios y escritura. Sin embargo, el enfoque de razonamiento deliberado del modelo implica latencias más largas y un aumento sustancial de costes, lo que refleja su diseño de alto consumo de recursos.

¿Qué diferencia a o3‑pro del modelo o3 estándar?

Razonamiento multimodal avanzado

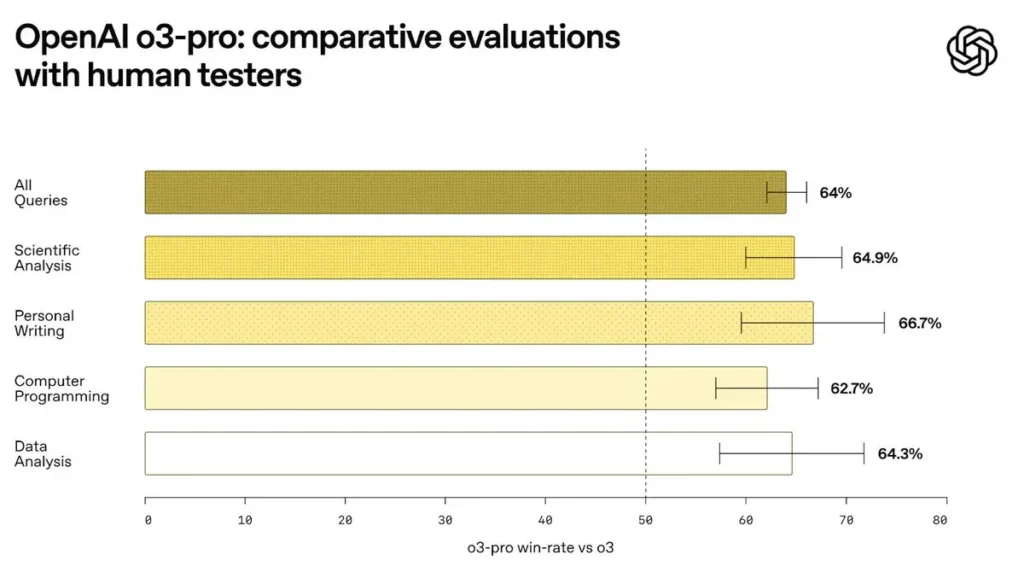

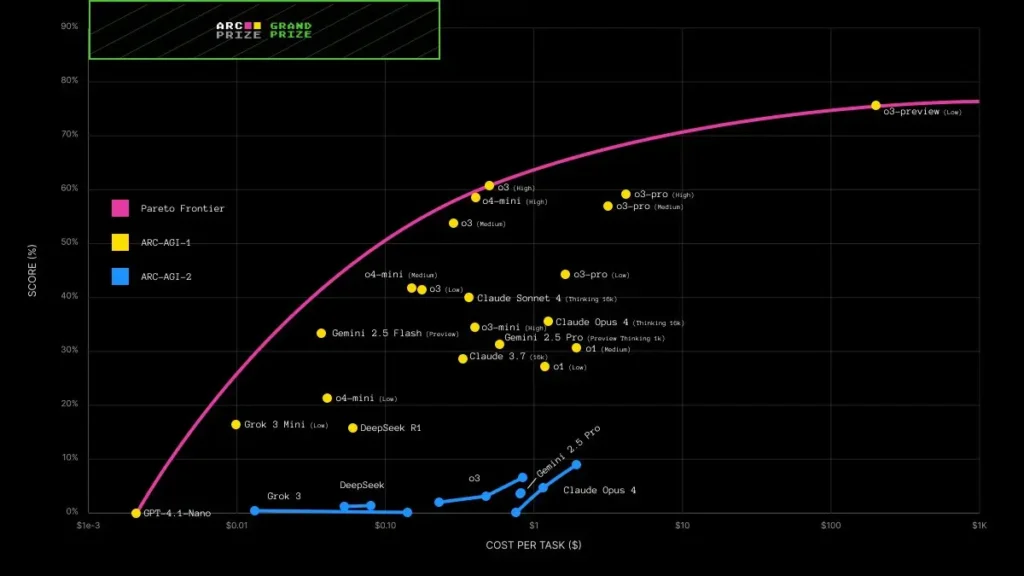

OpenAI ha evaluado rigurosamente o3-pro mediante múltiples evaluaciones estándar de IA para validar su capacidad de razonamiento. En el ámbito matemático, o3-pro supera a Gemini 2.5 Pro de Google en el benchmark AIME 2024, demostrando un razonamiento lógico superior y la resolución de ecuaciones complejas en condiciones de tiempo. De igual forma, en el benchmark GPQA Diamond, que mide la comprensión científica y la resolución de problemas a nivel de doctorado, o3-pro supera a Claude 4 Opus de Anthropic, lo que subraya su profundidad en el razonamiento científico avanzado.

o3-pro aprovecha las ventajas del modelo insignia o3 de OpenAI al integrar navegación web en tiempo real, análisis de archivos, comprensión visual y ejecución de Python sobre la marcha en una única interfaz. Según OpenAI, esta capacidad de razonamiento mejorada permite a o3-pro abordar tareas complejas, como la interpretación de datos científicos, la depuración de código extenso y la generación de contenido multimodal, con mayor fiabilidad que su predecesor.

Confiabilidad sobre latencia

Estas nuevas capacidades conllevan desventajas: los tiempos de respuesta de o3-pro son considerablemente más lentos que los de o3, lo que refleja los pasos adicionales de procesamiento de cómputo y contexto necesarios para el uso avanzado de herramientas. Los primeros usuarios informan latencias típicas de 1.5 a 2 veces la de o3 en solicitudes equivalentes, aunque las cifras exactas varían según la complejidad de la solicitud.

Limitaciones de funciones en el lanzamiento

Durante el lanzamiento, los usuarios de o3-pro notaron algunas limitaciones temporales: la generación de imágenes sigue sin estar disponible y ciertas funciones de ChatGPT, como las sesiones efímeras de "Canvas" y los hilos de chat temporales, están deshabilitadas mientras OpenAI adapta la infraestructura al nuevo modelo. Se espera que estas restricciones se alivien en los próximos meses a medida que se amplíe la capacidad.

¿Cómo se desempeña o3-pro en los puntos de referencia de la industria?

Pruebas de razonamiento estandarizadas

En pruebas internas, o3-pro superó a o3 por un margen considerable en conjuntos de razonamiento estandarizados que abarcan matemáticas, acertijos de lógica y desafíos de programación. Las puntuaciones informadas por la comunidad sitúan a o3 en torno a los 2,517 puntos, mientras que o3-pro se acerca a los 2,748, lo que representa una mejora aproximada del 9 %.

Evaluaciones de codificación en el mundo real

Los desarrolladores que ejecutan tareas de generación y depuración de código en vivo han observado que o3-pro produce resultados sintácticamente más correctos y semánticamente precisos en entornos de ejecución única y de ejecución limitada. Las pruebas de rendimiento en repositorios de código como CodeSearchNet muestran un aumento del 5-7 % en la corrección funcional en comparación con o3, especialmente en problemas de contexto extenso que superan los 4,000 tokens.

Rendimiento comparativo frente a la competencia

En pruebas directas, o3-pro no solo supera a Gemini 2.5 Pro y Claude 4 Opus en puntajes brutos, sino que también ofrece resultados más consistentes en pruebas de estrés adversariales. Al combinar el manejo de entrada multimodal y el uso dinámico de herramientas, o3-pro reduce la brecha con los modelos especializados de rivales como Google PaLM y Anthropic Claude X. Las primeras pruebas directas indican que o3-pro iguala o supera la precisión de la competencia en puntos de referencia de razonamiento complejos, aunque todavía se esperan informes completos de terceros.

¿Qué estructura de precios deberían esperar los desarrolladores?

Modelo de facturación basado en tokens

OpenAI continúa con su facturación basada en tokens: o3-pro cuesta 20 dólares por millón de tokens de entrada y 80 dólares por millón de tokens de salida, exactamente diez veces el coste del modelo estándar de o3 tras su reciente reducción de precio. En cambio, o3 ahora funciona a 2 dólares por millón de tokens de entrada y 8 dólares por millón de tokens de salida tras una reducción de precio del 80 % a principios de junio de 2025.

| Modelo | Precio del token de entrada | Precio del token de salida |

|---|---|---|

| o3 | $2 / 1 millón de tokens | $8 / 1 millón de tokens |

| o3-pro | $20 / 1 millón de tokens | $80 / 1 millón de tokens |

Justificación de la prima

Este aumento de precio de diez veces refleja los recursos computacionales adicionales, la infraestructura de alto rendimiento y la integración de herramientas especializadas que exige o3-pro. OpenAI posiciona a o3-pro como un modelo de misión crítica para aplicaciones donde la precisión y el razonamiento avanzado justifican el sobrecosto.

Descuentos por volumen y API por lotes

Las empresas que procesan grandes volúmenes de tokens aún pueden aprovechar la API Batch para ahorrar hasta un 50 % en entradas y salidas en caché. Si bien este mecanismo beneficia principalmente a los usuarios de alto volumen de las variantes de GPT-4.1, se espera que opciones de procesamiento por lotes similares se implementen para los modelos de la serie o a finales de 2025.

¿Cómo pueden los desarrolladores y equipos acceder a o3-pro?

Disponibilidad de API

En pruebas cara a cara, o3-pro no solo supera a Gemini 2.5 Pro y Claude 4 Opus en puntajes brutos, sino que también ofrece resultados más consistentes en pruebas de estrés adversariales.

OpenAI hizo accesible o3-pro a través de su API pública el 10 de junio de 2025, con soporte inmediato en los puntos finales de Finalizaciones y Chat. Los desarrolladores pueden especificar "o3-pro" modelo en sus llamadas API, sujeto a límites de velocidad y restricciones de cuota vinculadas a su nivel de suscripción.

POST https://api.openai.com/v1/chat/completions

{

"model": "o3-pro",

"messages": ,

"max_tokens": 1500

}

Planes ChatGPT Pro y Team

Los suscriptores de ChatGPT Pro y Team obtienen acceso directo a o3-pro desde la interfaz de ChatGPT. Los usuarios pueden alternar entre o3 y o3-pro en el selector de modelos, aunque la disponibilidad inicial está limitada a un subconjunto de clientes empresariales y probadores beta.

A través de la API CometAPI

Los desarrolladores pueden acceder API de o3-Pro(modelo: "o3-Pro"o"o3-pro-2025-06-10") a través de CometAPILos últimos modelos listados corresponden a la fecha de publicación del artículo. Para comenzar, explore las capacidades del modelo en el Playground y consultar el Guía de API Para obtener instrucciones detalladas, consulte la sección "Antes de acceder, asegúrese de haber iniciado sesión en CometAPI y de haber obtenido la clave API". CometAPI Ofrecemos un precio muy inferior al oficial para ayudarte a integrarte.

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.cometapi.com/v1",

api_key="<YOUR_API_KEY>",

)

response = client.chat.completions.create(

model="o3-Pro",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices.message.content

print(f"Assistant: {message}")

¿Qué casos de uso prácticos se benefician más de o3-pro?

Investigación científica y análisis de datos

Los investigadores que trabajan con grandes conjuntos de datos (que van desde genómica hasta simulaciones climáticas) pueden aprovechar las capacidades de análisis de archivos y ejecución de Python de o3-pro para automatizar las pruebas de hipótesis y generar conocimientos sin restricciones de longitud de contexto.

Flujos de trabajo de conocimiento empresarial

En sectores como las finanzas y los servicios jurídicos, donde la precisión y la auditabilidad son primordiales, la adherencia mejorada a las instrucciones y el razonamiento multimodal de o3-pro reducen los índices de error en las revisiones de contratos, modelos financieros y tareas de cumplimiento normativo.

Desarrollo de software y DevOps

Al combinar la comprensión de código de contexto largo con pruebas en vivo a través de la ejecución de Python, o3-pro agiliza la depuración y automatiza flujos de trabajo de refactorización complejos, acelerando los ciclos de entrega de proyectos de software a gran escala.

¿Qué deben considerar las organizaciones antes de actualizar?

Análisis costo-beneficio

Los equipos deben sopesar el aumento de precio de 10 veces frente a las mejoras de eficiencia proyectadas. Para tareas de alto valor y bajo volumen, como la elaboración de informes estratégicos o la construcción de sistemas de seguridad críticos, la precisión y el soporte de herramientas pueden justificar la prima de o3-pro. Para la generación de contenido masivo, mantener los modelos estándar de o3 u o4-mini podría ser más económico.

Preparación de la infraestructura

Debido a que o3-pro impone mayores demandas de latencia y rendimiento, las organizaciones deben auditar los límites de velocidad de su API, la capacidad de la red y las estrategias de reintento de errores para evitar cuellos de botella durante el uso pico.

En conclusión

El modelo o3-pro de OpenAI establece un nuevo estándar para el razonamiento avanzado, la comprensión multimodal y el uso integrado de herramientas en IA. Sus mejoras en los parámetros de referencia y fiabilidad lo convierten en una opción atractiva para aplicaciones de misión crítica, siempre que los presupuestos y la infraestructura permitan afrontar los elevados costes. A medida que evoluciona el panorama de la IA, el papel de o3-pro se consolidará en áreas que exigen los máximos niveles de precisión y profundidad contextual, mientras que las cargas de trabajo más sensibles a los costes podrían seguir aprovechando los modelos básicos de la serie o o las minivariantes emergentes.