Mistral 3 is de hoofdrelease van de modelfamilie van Mistral AI eind 2025. Het biedt een mix van compacte, snelle modellen gericht op lokale/edge‑implementatie en een zeer groot, sparse vlaggenschip dat de state‑of‑the‑art op het gebied van schaal en contextlengte oprekt. Dit artikel legt uit wat Mistral 3 is, hoe het is opgebouwd, waarom je het lokaal zou willen draaien, en drie praktische manieren om het op je machine of private server uit te voeren — van het “klik‑en‑draai”‑gemak van Ollama tot productie‑GPU‑serving met vLLM/TGI, tot CPU‑inference op kleine apparaten met GGUF + llama.cpp.

Wat is Mistral 3?

Mistral 3 is de nieuwste generatie open‑weight‑modellen van Mistral AI. De familie omvat zowel een enorme Mistral Large 3 (een sparse Mixture‑of‑Experts — MoE — model) als verschillende edge/“ministral” varianten (3B, 8B, 14B) afgestemd op instructie‑volgen en multimodale (tekst+visie) taken. Mistral positioneerde de release als breed inzetbaar: van high‑performance datacenter‑inference (met gespecialiseerde geoptimaliseerde checkpoints) tot edge‑ en laptopgebruik via gequantiseerde formats en kleinere varianten.

Belangrijkste praktische eigenschappen :

- Een Mixture‑of‑Experts (MoE)‑architectuur in de Large 3‑variant die een zeer grote “totale” parameteromvang oplevert terwijl slechts een subset van experts per token wordt geactiveerd — dit verbetert de efficiëntie op schaal.

- Een familie van Ministral 3‑modellen (3B / 8B / 14B) bedoeld voor edge‑ en lokaal gebruik, met instructie‑afgestemde en multimodale varianten.

- Officiële checkpoints en een set geoptimaliseerde checkpoints (NVFP4/FP8) voor versnelde runtimes zoals vLLM en NVIDIA‑platformen.

- Multimodaal + meertalig + lange context — ministers en grote varianten leggen de nadruk op beeld+tekst‑begrip en brede taaldekking. Voor toepassingen die afbeeldingen + lange documenten combineren, is dit van belang.

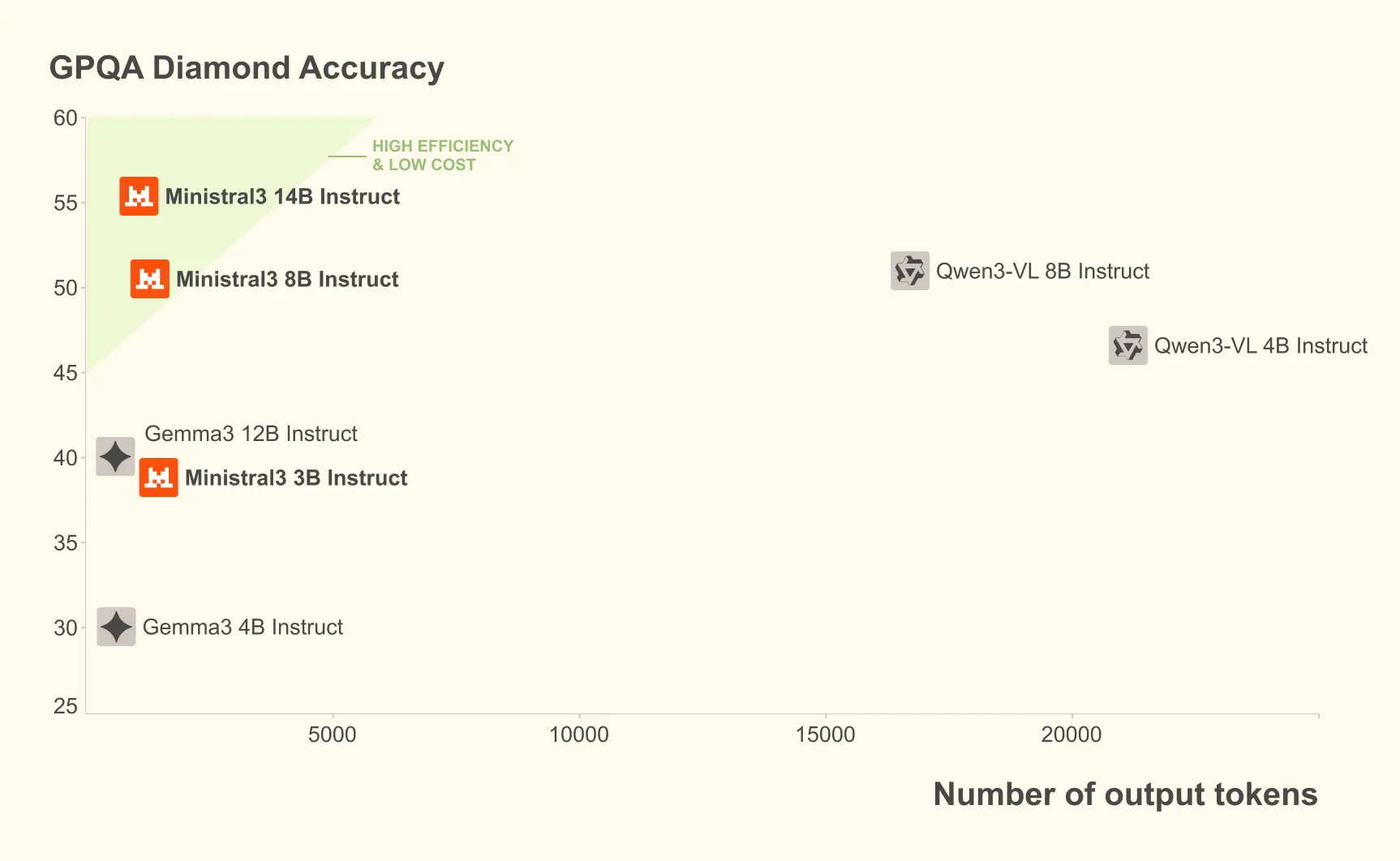

Op de GPQA Diamond‑dataset (een rigoureuze test van wetenschappelijke redenering) behouden verschillende varianten van Miniral 3 een hoge nauwkeurigheid, zelfs met toenemende aantallen uitvoertokens. Bijvoorbeeld: het Miniral 3B Instruct‑model behoudt 35–40% nauwkeurigheid bij het verwerken van tot 20.000 tokens, vergelijkbaar met grotere modellen zoals Gemma 2 9B, terwijl het minder resources gebruikt.

Wat is de architectuur van Mistral 3?

Mistral 3 is een familie in plaats van één architectuur, maar de twee architectuurpatronen die je moet begrijpen zijn:

Dense kleine modellen (Ministral 3)

- Standaard transformer‑stacks, geoptimaliseerd voor efficiëntie en edge‑inference.

- Beschikbaar in meerdere groottes (3B/8B/14B) en in verschillende fijn‑afgestemde varianten: base, instruct en reasoning; veel varianten bieden native multimodale (visie + tekst) ondersteuning en lange‑contextwerking. De Minstral‑modellen worden in sommige distributies uitgebracht met geoptimaliseerde FP8‑gewichten voor compactheid.

Sparse Mixture‑of‑Experts (Mistral Large 3)

- MoE‑architectuur: het model heeft veel experts (enorme totale parameteromvang), maar er wordt per token alleen een door routing geselecteerde subset geëvalueerd — dat levert een betere schaal‑voor‑compute‑afweging op.

- Mistral Large 3 vermeldt ~675B totale parameters met ~41B actieve parameters tijdens inference, wat deze MoE‑opzet weerspiegelt. Het model is getraind op moderne NVIDIA‑hardware en geoptimaliseerd voor efficiënte low‑precision uitvoering (NVFP4/TensorRT/large‑kernel‑optimalisaties).

Technische eigenschappen die lokaal relevant zijn:

- Lange context: sommige Mistral 3‑varianten ondersteunen zeer lange contexten (vLLM‑docs en Mistral‑docs noemen enorme contextvensters voor bepaalde varianten; bijvoorbeeld 256k in sommige Ministral‑varianten). Dat beïnvloedt geheugen en serveerpatronen.

- Gewichtsformats & quantization: Mistral levert gewichten in gecomprimeerde/geoptimaliseerde formats (FP8, NVFP4) en werkt met moderne quantization‑toolchains (BitsAndBytes, GPTQ, vendor‑toolchains) voor praktische lokale inference.

Waarom zou je Mistral 3 lokaal draaien?

LLM’s lokaal draaien is niet langer een nichehobby — het is een praktische optie voor teams en individuen die waarde hechten aan:

- Dataprivacy en compliance. Lokaal hosten houdt gevoelige input binnen je eigen infrastructuur (belangrijk voor finance, healthcare, legal). Reuters meldde dat prominente klanten kozen voor self‑hosting van Mistral‑modellen.

- Latentie en kostenbeheersing. Voor strakke latentie‑SLO’s en voorspelbare kosten kan lokale of private cluster‑inference beter presteren dan onaangename verrassingen op je cloud‑API‑rekening. Kleinere ministral‑varianten en gequantiseerde formats maken dit praktisch.

- Aanpassing en fine‑tuning. Wanneer je aangepaste functionaliteit, function calling of nieuwe modaliteiten nodig hebt, stelt lokaal beheer je in staat tot custom fine‑tuning en data‑afhandeling. Hugging Face‑ en vLLM‑integratie maken dit kant‑en‑klaar.

Als die redenen aansluiten bij je prioriteiten — privacy, controle, kostenvorspelbaarheid of onderzoek — is lokale deployment het overwegen waard.

Hoe kun je Mistral 3 lokaal draaien (drie praktische methoden)?

Er zijn veel manieren om Mistral 3 lokaal te draaien. Ik behandel drie benaderingen die de meest voorkomende gebruikersscenario’s afdekken:

- Ollama (zero‑config desktop / lokale server, voor veel gebruikers het makkelijkst)

- Hugging Face Transformers + PyTorch / vLLM (volledige controle, GPU‑clusters)

- llama.cpp / ggml / GGUF gequantiseerde CPU‑inference (lichtgewicht, draait op laptops/CPU)

Voor elke methode geef ik aan wanneer deze zinvol is, de vereisten, stapsgewijze commando’s en kleine codevoorbeelden.

1) Hoe kun je Mistral 3 draaien met Ollama (snelste route)?

Wanneer te gebruiken: je wilt een wrijvingsloze lokale ervaring (macOS/Linux/Windows), een toegankelijke CLI of GUI, en automatische downloads/gequantiseerde artefacten wanneer beschikbaar. Ollama heeft modelvermeldingen voor Ministral 3 en andere leden van de Mistral‑familie.

Vereisten

- Ollama geïnstalleerd (volg de installer op ollama.com). De Ollama‑bibliotheek geeft specifieke minimumversies aan voor sommige ministral‑releases.

- Voldoende schijfruimte om de modelartefacten op te slaan (modelgroottes verschillen — ministral 3B‑gequantiseerde versies zijn enkele GB’s; grotere BF16‑varianten zijn vele tientallen GB).

Stappen (voorbeeld)

- Installeer Ollama (macOS‑voorbeeld — pas aan per platform):

# macOS (Homebrew) example — see ollama.com for platform-specific installersbrew install ollama

- Draai een ministral‑model:

# Pull and run the model interactivelyollama run ministral-3

- Lokaal serven (API) en vanuit code aanroepen:

# Run Ollama server (default port shown in docs)ollama serve# Then curl against it (example)curl -s -X POST "http://localhost:11434/api/v1/generate" \ -H "Content-Type: application/json" \ -d '{"model":"ministral-3","prompt":"Summarize Mistral 3 in one sentence."}'

Notities & tips

- Ollama verzorgt modeldownload en (wanneer beschikbaar) lokale gequantiseerde varianten — erg handig om snel modellen uit te proberen.

- Als je het model in productie wilt gebruiken met veel gelijktijdige requests, is Ollama geweldig voor prototyping, maar evalueer schaalbaarheid en resource‑orkestratie voor constante belasting.

2) Hoe kun je Mistral 3 draaien met Hugging Face Transformers (GPU / vLLM‑integratie)?

Wanneer te gebruiken: je hebt programmatische controle nodig voor onderzoek of productie, wilt fine‑tunen, of wilt versnelde inference‑stacks zoals vLLM gebruiken op GPU‑clusters. Hugging Face biedt Transformers‑ondersteuning en Mistral biedt geoptimaliseerde checkpoints voor vLLM/NVIDIA.

Vereisten

- GPU met voldoende geheugen (verschilt per model en precisie). Ministral 3‑smalls (3B/8B) kunnen op een enkele mid‑range GPU draaien wanneer gequantiseerd; grotere varianten vereisen meerdere H100/A100 of geoptimaliseerde NVFP4‑checkpoints voor vLLM. NVIDIA‑ en Mistral‑documentatie bevelen specifieke node‑groottes aan voor de grote modellen.

- Python, PyTorch, transformers, accelerate (of vLLM als je die server wilt).

Python‑voorbeeld — basis Hugging Face‑pipeline (3B instruct‑variant, GPU):

# Example: CPU/GPU inference with transformers pipeline# Assumes you have CUDA and a compatible PyTorch build.import torchfrom transformers import pipelinemodel_name = "mistralai/Ministral-3-3B-Instruct-2512-BF16" # example HF model idgenerator = pipeline( "text-generation", model=model_name, device_map="auto", torch_dtype=torch.bfloat16, # use bfloat16 if your hardware supports it)prompt = "Explain how attention helps transformers, in 3 sentences."out = generator(prompt, max_new_tokens=120, do_sample=False)print(out[0]["generated_text"])

vLLM gebruiken voor productie‑GPU‑inference

vLLM is ontworpen om grote modellen efficiënt te serven, ondersteunt de Mistral 3‑familie, en Mistral publiceerde checkpoints die zijn geoptimaliseerd voor vLLM/NVIDIA‑hardware (NVFP4/FP8) om de geheugenvloot te verkleinen en te versnellen. Een vLLM‑server starten geeft je een low‑latency, gebatchte inference‑endpoint. Zie vLLM‑recepten en Mistral‑richtlijnen voor modelpaden en aanbevolen vlaggen.

Notities & tips

- Voor productie: geef de voorkeur aan geoptimaliseerde checkpoints (NVFP4/FP8) en draai op aanbevolen GPU’s (bijv. H100/A100) of gebruik een orkestratielaag die tensor/model‑parallelisme ondersteunt. Mistral en NVIDIA hebben documentatie en blogposts over geoptimaliseerde runtimes.

- Pin altijd de exacte modelcheckpoint op schijf (of een reproduceerbare HF‑snapshot) voor reproduceerbare resultaten en om stille modelupdates te vermijden.

3) Hoe kun je Mistral 3 op CPU draaien met llama.cpp / GGUF gequantiseerde modellen?

Wanneer te gebruiken: je hebt lokale, offline inference op CPU nodig (bijv. ontwikkelaarslaptop, beveiligde air‑gapped omgeving) en bent bereid wat nauwkeurigheid in te ruilen voor runtime‑ en geheugenefficiëntie. Deze methode gebruikt ggml/llama.cpp en GGUF‑gequantiseerde gewichten (q4/q5/etc.).

Vereisten

- Een GGUF‑gequantiseerde build van een Ministral‑model (veel communityleden publiceren gequantiseerde GGUF’s op Hugging Face of converteren BF16‑gewichten lokaal naar GGUF). Zoek naar

Ministral-3-3B-InstructGGUF‑varianten. - Gecompileerde llama.cpp‑binary (volg de project‑README).

Quantizen (als je originele gewichten hebt) — voorbeeld (conceptueel)

# Example: quantize from an FP16/BF16 model to a GGUF q4_K_M (syntax depends on llama.cpp version)./quantize /path/to/original/model.bin /path/to/out.gguf q4_k_m

Een GGUF draaien met llama.cpp

# run interactive inference with a quantized GGUF model./main -m /path/to/ministral-3-3b-instruct.gguf -t 8 -c 2048 --interactive# -t sets threads, -c sets context (tokens) if supported

Python‑clientvoorbeeld (lokale llama.cpp‑server of subprocess)

Je kunt llama.cpp als subprocess starten en prompts aanleveren, of een kleine wrapper‑client gebruiken. Veel communityprojecten bieden een eenvoudige HTTP‑serverwrapper rond llama.cpp voor integratie in lokale apps.

Notities & afwegingen

- Quantization reduceert VRAM en maakt CPU‑inference mogelijk maar kan kwaliteit verminderen (licht tot matig, afhankelijk van het quant‑format). Formats zoals q4_K_M of q5‑varianten zijn veelgebruikte compromissen voor CPU‑gebruik. Japanse en technische posts leggen Q4/Q5‑types en GGUF‑conversies in detail uit.

- Voor kleine tot middelgrote workloads is GGUF + llama.cpp vaak de goedkoopste en meest draagbare manier om lokale LLM’s te draaien.

Welke hardware‑ en geheugenoverwegingen zijn belangrijk?

Korte, praktische richtlijnen:

- 3B‑modellen: kunnen vaak gequantiseerd worden en draaien op een degelijke laptop‑CPU of een enkele GPU met 8–16 GB VRAM (afhankelijk van precisie/quantization). GGUF q4‑varianten draaien op veel moderne CPU’s.

- 8B en 14B ministers: hebben doorgaans een mid‑range GPU nodig (bijv. 24–80 GB afhankelijk van precisie en activatie‑caching) of quantization over meerdere devices.

- Mistral Large 3 (675B totaal, 41B actief): bedoeld voor datacenter‑deployment en draait meestal het best met multi‑GPU‑nodes (bijv. 8×A100 of H100) en gespecialiseerde formats (NVFP4/FP8) voor vLLM. Mistral heeft expliciet geoptimaliseerde checkpoints gepubliceerd om zulke deployments haalbaar te maken.

Als je prioriteit lokaal laptopgebruik is, mik dan op de ministral 3B gequantiseerde GGUF + llama.cpp‑route. Als je prioriteit productiedoorvoer is, kijk dan naar vLLM + NVFP4‑checkpoints op GPU’s. Als je gemak bij experimenteren wilt, is Ollama de snelste manier om te starten.

Hoe kies je quantization en precisie?

Quantization is een afweging: geheugen en snelheid versus ruwe modelkwaliteit. Veelvoorkomende keuzes:

- q4_0 / q4_1 / q4_K_M: populaire 4‑bit‑opties voor CPU‑inference; q4_K_M (k‑means‑variant) biedt vaak een betere kwaliteit/prestatie‑balans.

- q5 / q8 / imatrix‑varianten: tussenvormen die mogelijk meer fideliteit behouden tegen de prijs van omvang.

- FP16 / BF16 / FP8 / NVFP4: GPU‑precisies — BF16 en FP16 zijn gangbaar voor training/inference op moderne GPU’s; FP8/NVFP4 zijn opkomende formats die geheugen besparen voor zeer grote modellen en worden ondersteund door geoptimaliseerde runtimes en Mistral’s checkpoint‑releases.

Vuistregel: voor lokale CPU‑runs kies je q4_K_M of iets vergelijkbaars; voor GPU‑inference met hoge fideliteit gebruik je BF16/FP16 of vendorspecifieke FP8/NVFP4 wanneer ondersteund door de runtime.

Conclusie — moet je Mistral 3 lokaal draaien?

Als je privacy, lage latentie of maatwerk nodig hebt, ja: de Mistral 3‑familie geeft je een breed palet — kleine modellen voor edge‑CPU, middelgrote modellen voor een enkele GPU of een bescheiden cluster, en een grote MoE‑variant voor datacenterschaal — en het ecosysteem (Ollama, Hugging Face, vLLM, llama.cpp) ondersteunt al praktische lokale en private deployment‑patronen. Mistral werkte bovendien met NVIDIA en vLLM aan geoptimaliseerde checkpoints voor hoge throughput en verkleinde geheugenvoetafdrukken, wat productie‑self‑hosting realistischer maakt dan voorheen.

Om te beginnen, verken meer model (zoals Gemini 3 Pro) ’s mogelijkheden in de Playground en raadpleeg de API‑gids voor gedetailleerde instructies. Zorg er vóór toegang voor dat je bent ingelogd bij CometAPI en de API‑sleutel hebt verkregen. CometAPI biedt een prijs die veel lager is dan de officiële prijs om je te helpen integreren.

Ready to Go?→ Meld je vandaag aan voor CometAPI !