LobeChat et CometAPI sont deux projets en pleine expansion dans l'écosystème de l'IA ouverte. En septembre 2025, LobeChat a intégré un fournisseur CometAPI complet, simplifiant ainsi l'appel des points de terminaison unifiés et compatibles OpenAI de CometAPI depuis LobeChat. Cet article explique ce que sont LobeChat et CometAPI, pourquoi les intégrer, l'intégration et la configuration étape par étape (y compris une configuration de base du fournisseur TypeScript prête à l'emploi), des exemples d'exécution, des cas d'utilisation concrets et des conseils de production concernant le coût, la fiabilité et l'observabilité.

Qu'est-ce que LobeChat et quelles fonctionnalités offre-t-il ?

LobeChat est un framework de chat open source moderne, conçu pour héberger des applications de chat LLM multi-fournisseurs, avec une interface utilisateur optimisée et des outils de déploiement performants. Il est conçu pour prendre en charge les entrées multimodales (texte, images, audio), les workflows de base de connaissances/RAG, les conversations arborescentes et les visualisations de chaînes de pensée. Il dispose également d'un système extensible de fournisseurs/plugins permettant de changer de backend de modèle sans restructurer votre application. La documentation et le dépôt de LobeChat le présentent comme un framework prêt pour la production, pour les déploiements auto-hébergés et cloud, avec une configuration pilotée par l'environnement et une place de marché pour les intégrations MCP (Model Control Plan) tierces.

Aperçu des principales fonctionnalités de LobeChat

- Support multi-fournisseurs (OpenAI, Anthropic, Google Gemini, Ollama, etc.).

- Téléchargement de fichiers + base de connaissances pour les flux de travail RAG (documents, PDF, audio).

- Configuration conviviale pour les développeurs via des variables d'environnement et des paramètres - importation d'URL.

- Durée d'exécution extensible : les fournisseurs sont configurés avec de petits temps d'exécution d'adaptateur afin que les nouveaux backends soient connectables.

Qu'est-ce que CometAPI ?

CometAPI est une couche d'accès IA unifiée qui expose plus de 500 modèles de nombreux fournisseurs sous-jacents via une interface API unique et compatible OpenAI. Elle permet aux développeurs de choisir les points de terminaison des modèles en fonction de leurs performances, de leur coût ou de leurs capacités, sans verrouillage, et de centraliser la facturation, le routage et l'accès. CometAPI propose des points de terminaison unifiés pour le chat et les complétions, ainsi qu'une API de liste de modèles pour découvrir les identifiants de modèles disponibles.

Pourquoi CometAPI est attractif pour les équipes

- Choix du modèle et portabilité : basculer entre de nombreux modèles de pointe sans modifier de manière significative le code d'intégration.

- Points de terminaison compatibles OpenAI : De nombreuses bibliothèques clientes et frameworks qui attendent des points de terminaison HTTP de style OpenAI peuvent fonctionner avec CometAPI en modifiant l'URL de base + l'authentification. (Des exemples pratiques montrent

https://api.cometapi.com/v1/en tant que surface compatible OpenAI.) - Documentation et intégrations pour les développeurs : CometAPI publie des documents et des guides étape par étape pour l'intégration avec des outils tels que LlamaIndex et d'autres plates-formes low-code.

Pourquoi devriez-vous intégrer CometAPI dans LobeChat ?

Réponse courte: flexibilité, contrôle des coûts et accès rapide aux nouveaux modèlesLobeChat est conçu pour être indépendant des fournisseurs ; l'intégration de CometAPI permet à votre déploiement LobeChat d'appeler de nombreux modèles différents via le même chemin de code, ce qui permet de changer de modèle en fonction du débit, de la latence, du coût ou des fonctionnalités, sans modifier l'interface utilisateur ni les flux d'invite. De plus, la communauté et les mainteneurs ont activement intégré la prise en charge du fournisseur CometAPI à LobeChat, facilitant ainsi l'intégration.

Avantages commerciaux et techniques

- Diversité des modèles sans changement de code. Besoin d'évaluer Gemini, Claude ou un modèle d'image spécialisé ? CometAPI peut exposer ces identifiants de modèle via une API unique. Cela réduit la complexité liée à chaque fournisseur dans LobeChat.

- Optimisation des coûts. CometAPI vous permet d'acheminer vers des modèles moins chers ou de sélectionner dynamiquement des fournisseurs à moindre coût, ce qui peut réduire considérablement les coûts par conversation pour les déploiements à volume élevé.

- Gestion des secrets plus simple. Une seule clé API à gérer dans les paramètres de LobeChat ou dans l'environnement Docker, au lieu de plusieurs clés de fournisseur. La plateforme LobeChat prend déjà en charge l'activation d'un fournisseur via

ENABLED_<PROVIDER>et un modèle de variable d'environnement de clé de fournisseur, de sorte que l'intégration est opérationnellement cohérente. - Maintient la base de code LobeChat minimale : la logique du fournisseur est encapsulée et configurée avec des variables d'environnement.

Comment configurer et intégrer CometAPI dans LobeChat ?

Cette section propose une méthode pratique, étape par étape : obtenir les clés, définir les variables d'environnement, ajouter le fournisseur à LobeChat (exemple de configuration du fournisseur) et afficher l'utilisation à l'exécution (appel de chat). Les exemples suivent les modèles de fournisseur de LobeChat et les points de terminaison CometAPI compatibles OpenAI.

1) Obtenez un compte CometAPI et une clé API

Inscrivez-vous sur CometAPI et ouvrez la console API. Pour créer un compte CometAPI, vous devrez utiliser une adresse e-mail ou vous connecter directement avec Google One-Click.

Après avoir terminé l'inscription, accédez à l'aire de jeux et cliquez sur Ajouter une nouvelle clé secrète pour créer une nouvelle clé API :

Obtenez une clé API.

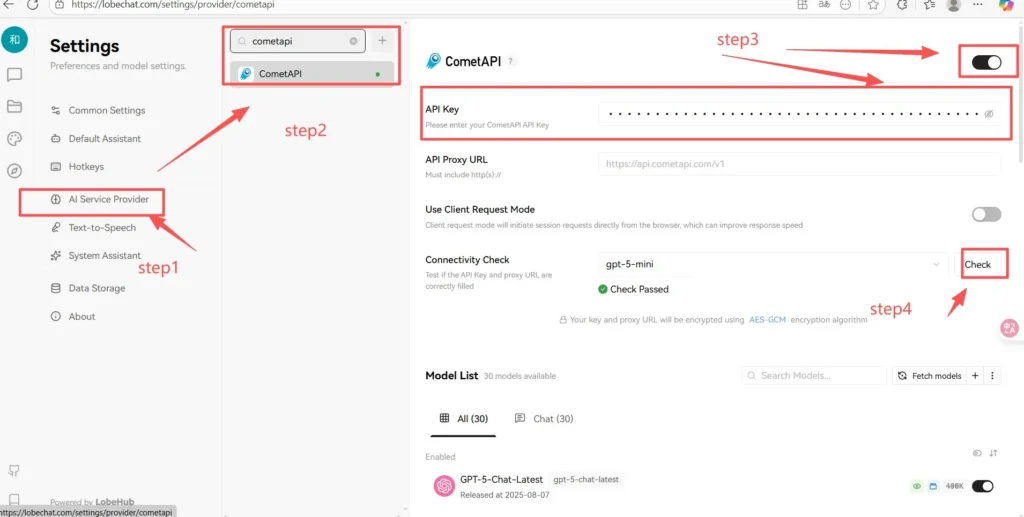

2) Configuration de CometAPI dans LobeChat

- Entrez dans le menu des paramètres de Lobe-Chat, cliquez sur l'avatar, cliquez sur l'option Paramètres de l'application.

- Sélectionnez cometapi comme fournisseur de modèles.

- Collez le sk-xxxxx de cometapi dans la zone de saisie de la clé API et activez le bouton, sélectionnez un modèle à vérifier

3) Tester l'appel

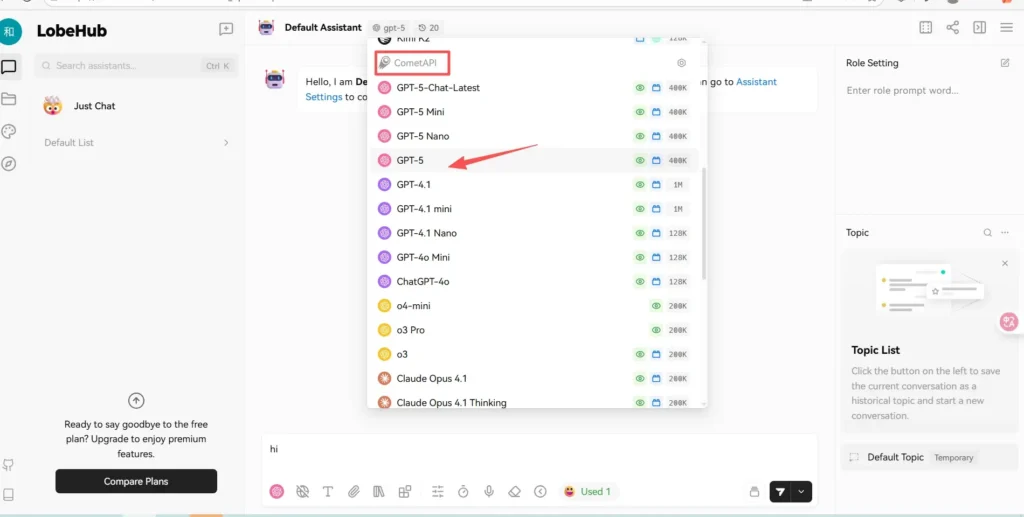

Sélectionnez le modèle CometAPI à vérifier et saisissez une commande de test simple dans Lobe-Chat. Si l'appel réussit, vous recevrez une réponse ; en cas d'échec, vérifiez la configuration ou contactez le service client en ligne de CometAPI.

Actuellement, cometapi propose plus de 30 modèles récents de développeurs majeurs (openAI, grok, claude, gemini) sur lobechat.

Comment pouvez-vous étendre l’intégration (améliorations avancées) ?

Vous souhaitez aller au-delà des bases ? Voici des étapes concrètes pour faire passer votre intégration du stade fonctionnel à celui de production.

Amélioration 1 : Orchestration de modèles dynamiques (agents multi-modèles)

Créez une logique d'agent dans LobeChat qui répartit dynamiquement les sous-tâches selon différents modèles Comet (par exemple, un petit modèle d'intégration pour la récupération, un modèle moyen pour la rédaction, un modèle hautes performances pour la synthèse). Utilisez le système d'appels de fonctions et de plugins de LobeChat pour coordonner le flux de travail et agréger les réponses finales.

Amélioration 2 : Mise en cache des intégrations et des réponses

Lorsque vous utilisez des représentations vectorielles continues (pour RAG), calculez-les une seule fois et mettez-les en cache pour réduire la charge. Si vous appelez CometAPI pour les représentations vectorielles continues, stockez les représentations vectorielles dans votre base de données vectorielle et ne recalculez qu'en cas de modification de contenu. Cela réduit les jetons et les coûts.

Amélioration 3 : Configuration et quotas par locataire

Si vous exécutez une instance LobeChat multi-locataire, contrôlez les limites par locataire (requêtes/heure, niveaux de modèle) en développant un middleware qui associe l'identifiant du locataire à la liste des modèles autorisés (à l'aide des identifiants de modèle CometAPI). Cela permet d'accéder à des niveaux premium avec accès à des modèles plus performants.

Amélioration 4 : Utiliser les métadonnées du modèle et les contrôles de santé

Implémentez des contrôles d'intégrité des fournisseurs qui appellent un « ping de modèle » CometAPI léger ou un appel de chat minimal pour garantir le respect des SLA ; sinon, évitez de recourir à des modèles de secours. Surveillez les pulsations et présentez l'état des fournisseurs dans l'interface d'administration de LobeChat.

À quels pièges faut-il faire attention ?

- Exposition de la clé APINe stockez jamais les clés CometAPI dans le code client. Conservez-les toujours côté serveur (couche serveur de LobeChat).

- Dérive du nom du modèleCometAPI peut ajouter ou supprimer des identifiants de modèle. Utilisez un mappage de serveur et mettez à jour.

COMETAPI_MODEL_LISTlorsque vous souhaitez exposer de nouveaux modèles. - Différences de format de réponse:Bien que CometAPI vise la compatibilité avec OpenAI, certains modèles ou champs méta peuvent différer ; mappez et nettoyez toujours les réponses avant de les montrer aux utilisateurs.

Pour commencer

CometAPI est une plateforme d'API unifiée qui regroupe plus de 500 modèles d'IA provenant de fournisseurs leaders, tels que la série GPT d'OpenAI, Gemini de Google, Claude d'Anthropic, Midjourney, Suno, etc., au sein d'une interface unique et conviviale pour les développeurs. En offrant une authentification, un formatage des requêtes et une gestion des réponses cohérents, CometAPI simplifie considérablement l'intégration des fonctionnalités d'IA dans vos applications. Que vous développiez des chatbots, des générateurs d'images, des compositeurs de musique ou des pipelines d'analyse pilotés par les données, CometAPI vous permet d'itérer plus rapidement, de maîtriser les coûts et de rester indépendant des fournisseurs, tout en exploitant les dernières avancées de l'écosystème de l'IA.

Pour commencer, explorez les capacités du modèle dans le cour de récréation et consultez le Guide de l'API Pour des instructions détaillées, veuillez vous connecter à CometAPI et obtenir la clé API avant d'y accéder. API Comet proposer un prix bien inférieur au prix officiel pour vous aider à vous intégrer.

Prêt à partir ?→ Inscrivez-vous à CometAPI dès aujourd'hui !

Conclusion

L'intégration de CometAPI dans LobeChat est un moyen pratique de diversifier les modèles, de réduire les coûts et d'accélérer les expérimentations, tout en conservant l'expérience utilisateur et les fonctionnalités RAG de LobeChat. La communauté LobeChat a déjà déployé des efforts considérables pour intégrer la prise en charge de CometAPI (carte fournisseur, liste de modèles, adaptateurs d'exécution, tests et documentation). Vous pouvez l'exploiter directement ou vous en inspirer pour implémenter un adaptateur personnalisé répondant à vos besoins spécifiques. Pour connaître les étapes d'intégration les plus précises et consulter les derniers exemples, consultez la documentation de CometAPI et le Documentation du fournisseur de modèles LobeChat et les liens de dépôt référencés ci-dessous vous aideront à continuer.