Le dernier modèle de raisonnement d'OpenAI, o3‑pro, représente une avancée significative en termes de performances et de capacités pour les applications pilotées par l'IA. Lancé début juin 2025, o3‑pro offre aux développeurs et aux entreprises un raisonnement avancé, une compréhension multimodale et l'utilisation d'outils, le tout à un prix avantageux. Cet article synthétise les annonces les plus récentes, les rapports d'utilisateurs et les données de référence afin de fournir un aperçu complet des performances, des coûts et de la disponibilité d'o3‑pro.

Qu'est-ce que o3-pro ?

La dernière offre d'OpenAI, o3‑pro, marque une étape importante dans les modèles de raisonnement d'IA en alliant des fonctionnalités améliorées à un prix élevé. Lancé le 11 juin 2025, o3‑pro succède au modèle standard o3 et remplace o1‑pro dans la gamme de produits OpenAI. Il cible les développeurs et les entreprises qui privilégient l'analyse approfondie et la fiabilité à la vitesse brute. Construit sur la même architecture sous-jacente qu'o3, initialement lancé en avril 2025, o3‑pro intègre la recherche web en temps réel, l'analyse de fichiers, le raisonnement visuel, l'exécution Python et des fonctionnalités de mémoire avancées, répondant aux flux de travail complexes en sciences, programmation, commerce et rédaction. Cependant, l'approche de raisonnement délibéré du modèle entraîne des latences plus longues et une augmentation substantielle des coûts, reflétant sa conception gourmande en ressources de calcul.

Qu'est-ce qui distingue le modèle o3-pro du modèle o3 standard ?

Raisonnement multimodal avancé

OpenAI a rigoureusement évalué o3-pro à travers plusieurs évaluations d'IA standard afin de valider ses capacités de raisonnement. En mathématiques, o3-pro surpasse Gemini 2.5 Pro de Google lors du benchmark AIME 2024, démontrant une supériorité en raisonnement logique et en résolution d'équations complexes dans des conditions chronométrées. De même, lors du benchmark GPQA Diamond, qui mesure la compréhension scientifique et la résolution de problèmes au niveau du doctorat, o3-pro surpasse Claude 4 Opus d'Anthropic, soulignant ainsi sa profondeur en raisonnement scientifique avancé.

o3‑pro s'appuie sur les atouts du modèle phare d'OpenAI, o3, en intégrant la navigation web en temps réel, l'analyse de fichiers, la compréhension visuelle et l'exécution Python à la volée dans une interface unique. Selon OpenAI, cette capacité de raisonnement améliorée permet à o3‑pro d'aborder des tâches complexes, telles que l'interprétation de données scientifiques, le débogage de code long et la génération de contenu multimodal, avec une fiabilité supérieure à celle de son prédécesseur.

Fiabilité plutôt que latence

Ces nouvelles fonctionnalités impliquent des compromis : les temps de réponse d'o3-pro sont sensiblement plus lents que ceux d'o3, ce qui reflète les étapes de calcul et de traitement contextuel supplémentaires requises pour l'utilisation avancée de l'outil. Les premiers utilisateurs signalent des latences typiques de 1.5 à 2 fois supérieures à celles d'o3 pour des requêtes équivalentes, bien que les chiffres précis varient en fonction de la complexité de la requête.

Limitations des fonctionnalités au lancement

Au lancement, les utilisateurs d'o3-pro ont constaté quelques limitations temporaires : la génération d'images reste indisponible et certaines fonctionnalités de ChatGPT, telles que les sessions « Canvas » éphémères et les fils de discussion temporaires, sont désactivées pendant qu'OpenAI adapte son infrastructure au nouveau modèle. Ces restrictions devraient s'assouplir au cours des prochains mois, à mesure que les capacités augmentent.

Comment o3-pro se comporte-t-il par rapport aux benchmarks du secteur ?

Tests de raisonnement standardisés

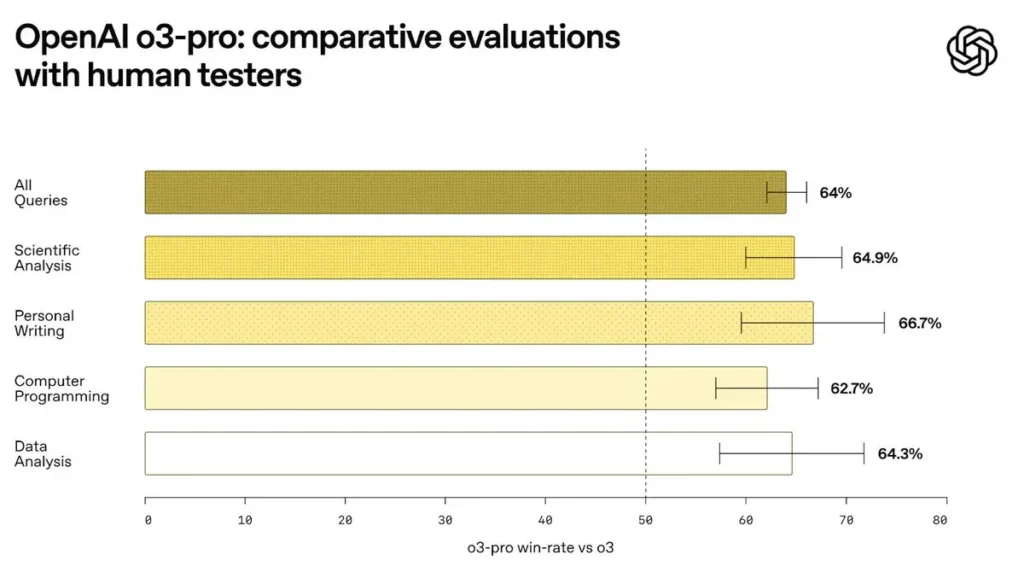

Lors des tests internes, o3-pro a largement surpassé o3 dans les suites de raisonnement standardisées couvrant les mathématiques, les énigmes logiques et les défis de programmation. Les scores rapportés par la communauté placent o3 à environ 2,517 3 points, tandis qu'o2,748-pro atteint près de 9 XNUMX, soit une amélioration d'environ XNUMX %.

Évaluations de codage en situation réelle

Les développeurs effectuant des tâches de génération et de débogage de code en direct ont constaté qu'o3-pro produit des résultats syntaxiquement plus corrects et sémantiquement plus précis dans les configurations mono-coup et multi-coup. Les tests de performance sur des référentiels de code comme CodeSearchNet montrent une amélioration de 5 à 7 % de la correction fonctionnelle par rapport à o3, en particulier pour les problèmes à contexte long dépassant 4,000 XNUMX jetons.

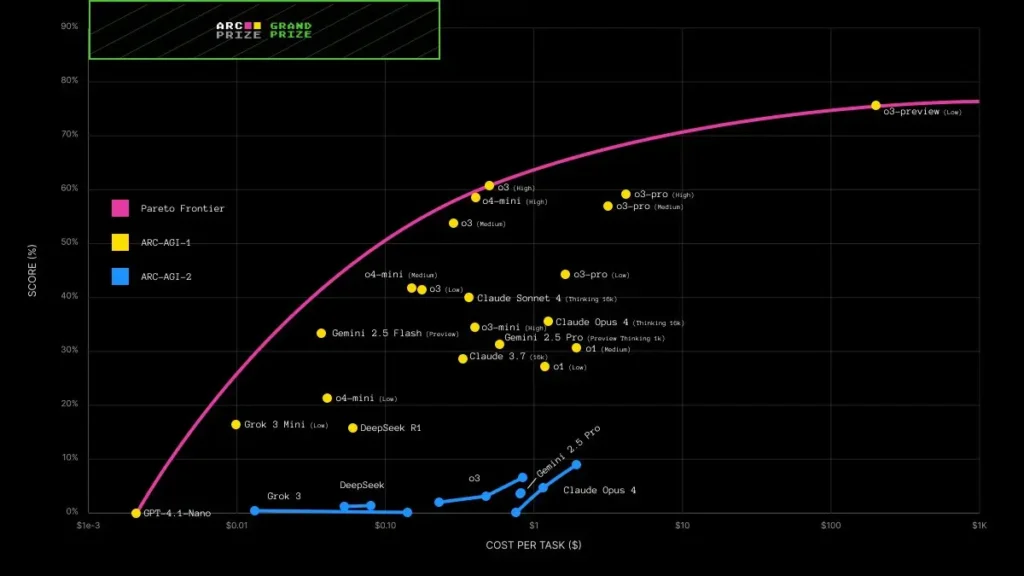

Performances comparatives par rapport aux concurrents

Lors des tests comparatifs, o3-pro bat non seulement Gemini 2.5 Pro et Claude 4 Opus sur les scores bruts, mais fournit également des résultats plus cohérents lors de tests de stress contradictoires. En combinant la gestion des entrées multimodales et l'utilisation d'outils dynamiques, o3-pro réduit l'écart avec les modèles spécialisés de concurrents tels que Google PaLM et Anthropic Claude X. Les premiers tests comparatifs indiquent qu'o3-pro égale ou dépasse la précision des concurrents sur des benchmarks de raisonnement complexes, bien que des rapports tiers complets soient encore à venir.

À quelle structure tarifaire les développeurs doivent-ils s’attendre ?

Modèle de facturation basé sur des jetons

OpenAI maintient sa facturation basée sur les jetons : o3-pro coûte 20 $ par million de jetons d'entrée et 80 $ par million de jetons de sortie, soit exactement dix fois le prix du modèle o3 standard après sa récente baisse de prix. En revanche, o3 coûte désormais 2 $ par million de jetons d'entrée et 8 $ par million de jetons de sortie, suite à une baisse de prix de 80 % début juin 2025.

| Modèle | Prix du jeton d'entrée | Prix du jeton de sortie |

|---|---|---|

| o3 | 2 $ / 1 M de jetons | 8 $ / 1 M de jetons |

| o3-pro | 20 $ / 1 M de jetons | 80 $ / 1 M de jetons |

Justification de la prime

Cette multiplication par dix du prix reflète les ressources de calcul supplémentaires, l'infrastructure à haut débit et les intégrations d'outils spécialisés qu'exige o3-pro. OpenAI positionne o3-pro comme un modèle « critique » pour les applications où la précision et le raisonnement avancé justifient le surcoût.

Remises sur volume et API par lots

Les entreprises traitant de gros volumes de jetons peuvent toujours exploiter l'API Batch pour économiser jusqu'à 50 % sur les entrées et sorties mises en cache. Bien que ce mécanisme profite principalement aux utilisateurs intensifs des versions GPT-4.1, des options de traitement par lots similaires devraient être déployées pour les modèles de la série O courant 2025.

Comment les développeurs et les équipes peuvent-ils accéder à o3-pro ?

Disponibilité des API

Lors des tests comparatifs, o3-pro bat non seulement Gemini 2.5 Pro et Claude 4 Opus sur les scores bruts, mais fournit également des résultats plus cohérents lors de tests de stress contradictoires.

OpenAI a rendu o3-pro accessible via son API publique le 10 juin 2025, avec une prise en charge immédiate des points de terminaison Complétions et Chat. Les développeurs peuvent spécifier les "o3-pro" modèle dans leurs appels API, soumis à des limites de débit et à des contraintes de quota liées à leur niveau d'abonnement.

POST https://api.openai.com/v1/chat/completions

{

"model": "o3-pro",

"messages": ,

"max_tokens": 1500

}

Formules ChatGPT Pro et Team

Les abonnés ChatGPT Pro et Team bénéficient d'un accès direct à o3-pro depuis l'interface ChatGPT. Les utilisateurs peuvent basculer entre o3 et o3-pro via le sélecteur de modèles, mais la disponibilité initiale est limitée à un sous-ensemble de clients professionnels et de bêta-testeurs.

Via l'API CometAPI

Les développeurs peuvent accéder API o3-Pro(modèle: "o3-Pro"ou alors"o3-pro-2025-06-10") à travers API CometLes derniers modèles listés sont ceux en vigueur à la date de publication de l'article. Pour commencer, explorez les fonctionnalités du modèle dans la section cour de récréation et consultez le Guide de l'API Pour des instructions détaillées, veuillez vous connecter à CometAPI et obtenir la clé API avant d'y accéder. API Comet proposer un prix bien inférieur au prix officiel pour vous aider à vous intégrer.

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.cometapi.com/v1",

api_key="<YOUR_API_KEY>",

)

response = client.chat.completions.create(

model="o3-Pro",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices.message.content

print(f"Assistant: {message}")

Quels cas d’utilisation pratiques bénéficient le plus d’o3-pro ?

Recherche scientifique et analyse de données

Les chercheurs travaillant avec de grands ensembles de données, allant de la génomique aux simulations climatiques, peuvent tirer parti des capacités d'analyse de fichiers et d'exécution Python d'o3-pro pour automatiser les tests d'hypothèses et générer des informations sans contraintes de longueur de contexte.

Flux de travail des connaissances d'entreprise

Dans des secteurs comme la finance et les services juridiques, où la précision et l'auditabilité sont primordiales, l'amélioration du respect des instructions et le raisonnement multimodal d'o3-pro réduisent les taux d'erreur dans les examens de contrats, la modélisation financière et les tâches de conformité réglementaire.

Développement de logiciels et DevOps

En combinant la compréhension de code à long contexte avec des tests en direct via l'exécution Python, o3-pro rationalise le débogage et automatise les flux de travail de refactorisation complexes, accélérant ainsi les cycles de livraison des projets logiciels à grande échelle.

Que doivent prendre en compte les organisations avant de procéder à une mise à niveau ?

Analyse coûts-avantages

Les équipes doivent évaluer la multiplication par 10 du prix par rapport aux gains d'efficacité prévus. Pour les tâches à forte valeur ajoutée et à faible volume, comme la rédaction de rapports stratégiques ou la création de systèmes de sécurité critiques, la précision et la prise en charge des outils peuvent justifier le prix élevé d'o3-pro. Pour la génération de contenu en masse, il peut être plus économique de conserver les modèles o3 ou o4-mini standard.

État de préparation des infrastructures

Étant donné qu'o3-pro impose des exigences de latence et de débit plus élevées, les organisations doivent auditer leurs limites de débit API, leur capacité réseau et leurs stratégies de nouvelle tentative d'erreur pour éviter les goulots d'étranglement pendant les pics d'utilisation.

En conclusion

Le modèle o3-pro d'OpenAI établit de nouvelles normes en matière de raisonnement avancé, de compréhension multimodale et d'utilisation intégrée d'outils en IA. Ses gains de référence et ses améliorations de fiabilité en font une option attractive pour les applications critiques, à condition que les budgets et l'infrastructure puissent supporter des coûts élevés. À mesure que le paysage de l'IA évolue, le rôle d'o3-pro se consolidera dans les domaines exigeant les plus hauts niveaux de précision et de profondeur contextuelle, tandis que les charges de travail plus sensibles aux coûts pourront continuer à s'appuyer sur les modèles de base de la série o ou sur les mini-variantes émergentes.