Mistral 3 er hovedlanseringen i Mistral AIs modellfamilie mot slutten av 2025. Den kombinerer kompakte, raske modeller rettet mot lokal/edge‑utrulling og et svært stort, sparsomt flaggskip som flytter grenser for skala og kontekstkapsitet. Denne artikkelen forklarer hva Mistral 3 er, hvordan den er bygget, hvorfor du kan ville kjøre den lokalt, og tre praktiske måter å kjøre den på maskinen din eller privat server — fra “klikk‑for‑å‑kjøre”‑bekvemmeligheten i Ollama til produksjons‑GPU‑serving med vLLM/TGI, til CPU‑inferens på små enheter ved hjelp av GGUF + llama.cpp.

Hva er Mistral 3?

Mistral 3 er den nyeste generasjonen av open‑weight‑modeller fra Mistral AI. Familien inkluderer både en massiv Mistral Large 3 (en sparsom Mixture‑of‑Experts — MoE — modell) og flere edge/“ministral”‑varianter (3B, 8B, 14B) justert for instruksjonsfølge og multimodale (tekst+visjon) oppgaver. Mistral har posisjonert lanseringen for bred bruk: fra høyytelses datasenter‑inferens (med spesialiserte optimaliserte sjekkpunkter) til edge‑ og laptop‑bruk via kvantiserte formater og mindre varianter.

Viktige praktiske egenskaper :

- En Mixture‑of‑Experts (MoE)‑arkitektur i Large 3‑varianten som gir et svært stort “totalt” antall parametere, men aktiverer bare et delsett av eksperter per token — dette forbedrer effektivitet i stor skala.

- En familie av Ministral 3‑modeller (3B / 8B / 14B) beregnet for edge og lokal bruk, med instruksjons‑tuned og multimodale varianter.

- Offisielle sjekkpunkter og et sett med optimaliserte sjekkpunkter (NVFP4/FP8) for akselererte kjøretider som vLLM og NVIDIA‑plattformer.

- Multimodal + flerspråklig + lang kontekst — Ministral‑ og Large‑variantene vektlegger bilde+tekst‑forståelse og bred språkdekning. For applikasjoner som blander bilder + lange dokumenter, er dette viktig.

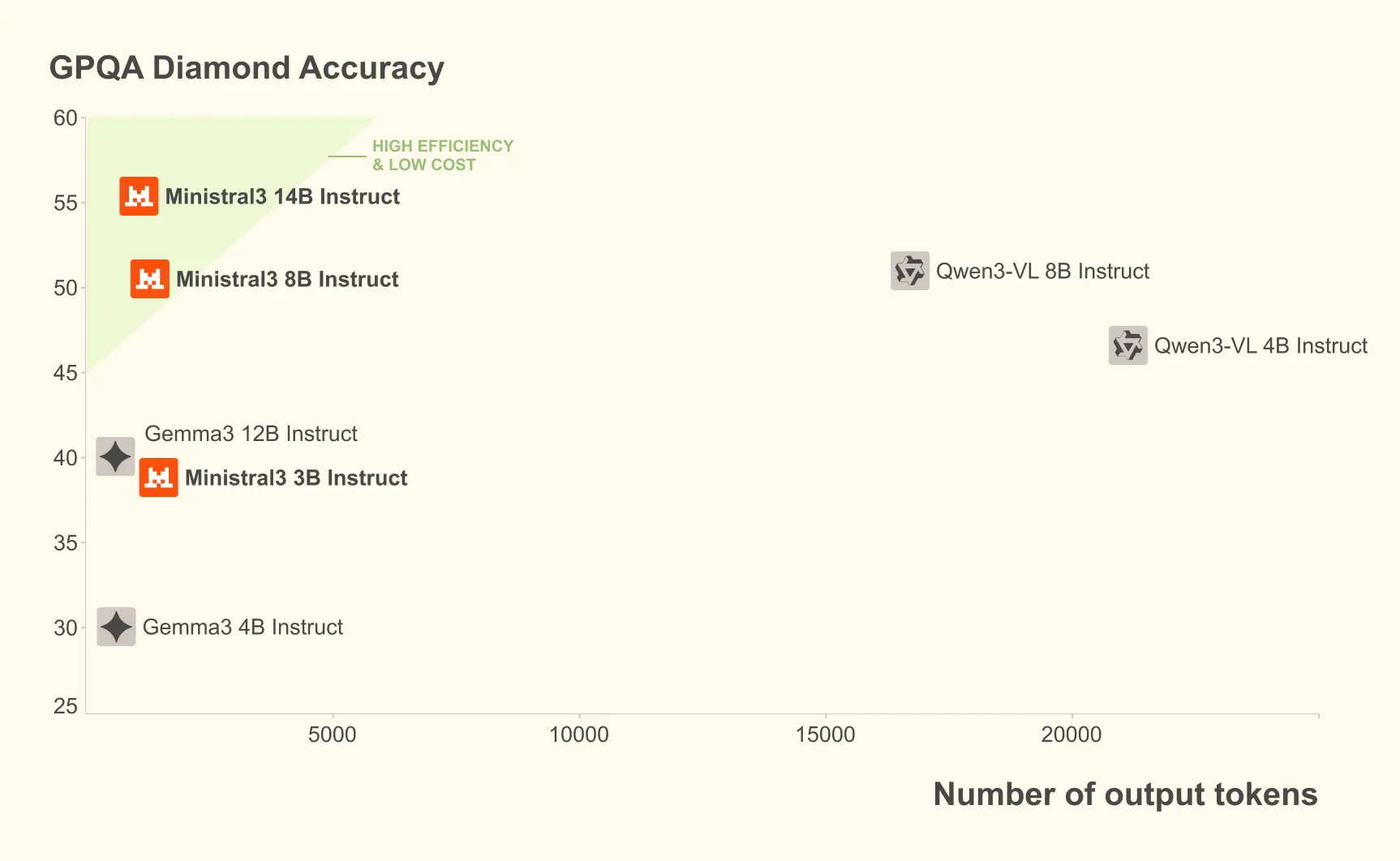

På GPQA Diamond‑datasettet (en streng test av vitenskapelig resonnering) opprettholder ulike varianter av Ministral 3 høy nøyaktighet selv med økende antall utgangstoken. For eksempel opprettholder Ministral 3B Instruct‑modellen 35–40% nøyaktighet når den håndterer opptil 20 000 token, sammenlignbart med større modeller som Gemma 2 9B, samtidig som den bruker færre ressurser.

Hva er arkitekturen til Mistral 3?

Mistral 3 er en familie snarere enn én enkelt arkitektur, men de to arkitektoniske mønstrene du bør forstå er:

Tette småmodeller (Ministral 3)

- Standard transformer‑stakker, optimalisert for effektivitet og edge‑inferens.

- Tilbys i flere størrelser (3B/8B/14B) og i forskjellige finjusterte varianter: base, instruct og reasoning; mange varianter inkluderer innebygd multimodal (visjon + tekst) støtte og langkontekst‑drift. Ministral‑modellene slippes med optimaliserte FP8‑vekter for kompakthet i enkelte distribusjoner.

Glissen Mixture‑of‑Experts (Mistral Large 3)

- MoE‑arkitektur: modellen har mange eksperter (stort totalt antall parametere), men bare et routing‑valgt delsett evalueres per token — det gir bedre forhold mellom skala og beregning.

- Mistral Large 3 oppgir ~675B totale parametere med ~41B aktive parametere under inferens, som reflekterer denne MoE‑designen. Modellen ble trent på moderne NVIDIA‑maskinvare og optimalisert for effektiv lavpresisjonskjøring (NVFP4/TensorRT/stor‑kjerne‑optimaliseringer).

Tekniske egenskaper som betyr noe ved lokal kjøring:

- Lang kontekst: noen Mistral 3‑varianter støtter svært lange kontekster (vLLM‑dokumenter og Mistral‑dokumenter nevner massive kontekstvinduer for enkelte varianter; f.eks. 256k i noen Ministral‑varianter). Det påvirker minne og serveringsmønstre.

- Vektformater og kvantisering: Mistral leverer vekter i komprimerte/optimaliserte formater (FP8, NVFP4) og fungerer med moderne kvantiseringsverktøykjeder (BitsAndBytes, GPTQ, leverandørverktøy) for praktisk lokal inferens.

Hvorfor kjøre Mistral 3 lokalt?

Å kjøre LLM‑er lokalt er ikke lenger en nisjehobby — det er et praktisk alternativ for team og enkeltpersoner som bryr seg om:

- Datapersonvern og etterlevelse. Lokal hosting holder sensitive innganger innenfor din infrastruktur (viktig for finans, helsevesen, juridisk). Reuters rapporterte om høyt profilerte kunder som velger å selv‑hoste Mistral‑modeller.

- Latens og kostnadskontroll. For stramme latens‑SLO‑er og forutsigbare kostnader kan lokal eller privat klynge‑inferens slå dyre sky‑API‑regninger. Mindre ministral‑varianter og kvantiserte formater gjør dette praktisk.

- Tilpasning og finjustering. Når du trenger skreddersydd atferd, funksjonskalling eller nye modaliteter, muliggjør lokal kontroll egen finjustering og datahåndtering. Hugging Face og vLLM‑integrasjon gjør dette mer “turn‑key”.

Hvis disse grunnene samsvarer med dine prioriteringer — personvern, kontroll, kostnadsforutsigbarhet eller forskning — er lokal utrulling verdt å vurdere.

Hvordan kan du kjøre Mistral 3 lokalt (tre praktiske metoder)?

Det finnes mange måter å kjøre Mistral 3 lokalt på. Jeg dekker tre tilnærminger som favner de vanligste bruker‑scenarioene:

- Ollama (null‑konfig desktop/lokal server, enklest for mange brukere)

- Hugging Face Transformers + PyTorch / vLLM (full kontroll, GPU‑klynger)

- llama.cpp / ggml / GGUF kvantisert CPU‑inferens (lettvekts, kjører på bærbar/CPU)

For hver metode lister jeg når det gir mening, forutsetninger, steg‑for‑steg‑kommandoer og små kodeeksempler.

1) Hvordan kjøre Mistral 3 med Ollama (raskeste vei)?

Når bør du bruke dette: du vil ha en friksjonsfri lokal opplevelse (macOS/Linux/Windows), en tilgjengelig CLI eller GUI, og automatiske nedlastinger/kvantiserte artefakter når tilgjengelig. Ollama har oppføringer for Ministral 3 og andre medlemmer av Mistral‑familien.

Forutsetninger

- Ollama installert (følg installasjonsprogrammet på ollama.com). Ollama‑biblioteket angir spesifikke minstekrav til versjoner for enkelte ministral‑utgivelser.

- Nok diskplass til å lagre modellartefakter (modellstørrelser varierer — ministral 3B kvantiserte versjoner kan være noen GB; større BF16‑varianter er mange titalls GB).

Trinn (eksempel)

- Installer Ollama (macOS‑eksempel — erstatt per plattform):

# macOS (Homebrew) example — see ollama.com for platform-specific installersbrew install ollama

- Kjør en ministral‑modell:

# Pull and run the model interactivelyollama run ministral-3

- Tjen lokalt (API) og kall fra kode:

# Run Ollama server (default port shown in docs)ollama serve# Then curl against it (example)curl -s -X POST "http://localhost:11434/api/v1/generate" \ -H "Content-Type: application/json" \ -d '{"model":"ministral-3","prompt":"Summarize Mistral 3 in one sentence."}'

Notater og tips

- Ollama håndterer modelnedlasting og (når tilgjengelig) lokale kvantiserte varianter — svært praktisk for rask utprøving av modeller.

- Hvis du planlegger å bruke modellen i produksjon med mange samtidige forespørsler, er Ollama flott for prototyping, men evaluer skalering og ressursorientering for jevn last.

2) Hvordan kjøre Mistral 3 med Hugging Face Transformers (GPU / vLLM‑integrasjon)?

Når bør du bruke dette: du trenger programmatisk kontroll for forskning eller produksjon, vil finjustere, eller vil bruke akselererte inferensstakker som vLLM på GPU‑klynger. Hugging Face tilbyr Transformers‑støtte og Mistral tilbyr optimaliserte sjekkpunkter for vLLM/NVIDIA.

Forutsetninger

- GPU med tilstrekkelig minne (varierer etter modell og presisjon). Ministral 3‑små (3B/8B) kan kjøre på én enkelt mellomklasse‑GPU når kvantisert; større varianter krever flere H100/A100 eller optimaliserte NVFP4‑sjekkpunkter for vLLM. NVIDIA‑ og Mistral‑dokumentasjon anbefaler spesifikke node‑størrelser for de store modellene.

- Python, PyTorch, transformers, accelerate (eller vLLM hvis du ønsker den serveren).

Python‑eksempel — grunnleggende Hugging Face‑pipeline (3B instruct‑variant, GPU):

# Example: CPU/GPU inference with transformers pipeline# Assumes you have CUDA and a compatible PyTorch build.import torchfrom transformers import pipelinemodel_name = "mistralai/Ministral-3-3B-Instruct-2512-BF16" # example HF model idgenerator = pipeline( "text-generation", model=model_name, device_map="auto", torch_dtype=torch.bfloat16, # use bfloat16 if your hardware supports it)prompt = "Explain how attention helps transformers, in 3 sentences."out = generator(prompt, max_new_tokens=120, do_sample=False)print(out[0]["generated_text"])

Bruke vLLM for produksjons‑GPU‑inferens

vLLM er designet for å serve store modeller effektivt, støtter Mistral 3‑familien, og Mistral har publisert sjekkpunkter optimalisert for vLLM/NVIDIA‑maskinvare (NVFP4/FP8) for å redusere minnefotavtrykk og øke hastighet. Å starte en vLLM‑server gir deg et lavlatens, batch‑inferensendepunkt. Se vLLM‑oppskrifter og Mistral‑veiledning for modellstier og anbefalte flagg.

Notater og tips

- For produksjon, foretrekk optimaliserte sjekkpunkter (NVFP4/FP8) og kjør på anbefalte GPU‑er (f.eks. H100/A100) eller bruk et orkestreringslag som støtter tensor/modell‑parallellisme. Mistral og NVIDIA har dokumentasjon og blogginnlegg om optimaliserte kjøretider.

- Fest alltid nøyaktig modell‑sjekkpunkt på disk (eller et reproduserbart HF‑snapshot) for reproduserbare resultater og for å unngå stille modelloppdateringer.

3) Hvordan kjøre Mistral 3 på CPU med llama.cpp / GGUF kvantiserte modeller?

Når bør du bruke dette: du trenger lokal, offline‑inferens på CPU (f.eks. utviklerlaptop, sikker luftgapet miljø) og er villig til å ofre noe nøyaktighet for kjøretid og minneeffektivitet. Denne metoden bruker ggml/llama.cpp og GGUF‑kvantiserte vekter (q4/q5/etc.).

Forutsetninger

- En GGUF‑kvantisert build av en Ministral‑modell (mange i miljøet publiserer kvantiserte GGUF‑er på Hugging Face eller konverterer BF16‑vekter til GGUF lokalt). Søk etter

Ministral-3-3B-Instruct‑GGUF‑varianter. - Kompilert llama.cpp‑binær (følg prosjektets README).

Kvantiser (hvis du har originale vekter) — eksempel (konseptuelt)

# Example: quantize from an FP16/BF16 model to a GGUF q4_K_M (syntax depends on llama.cpp version)./quantize /path/to/original/model.bin /path/to/out.gguf q4_k_m

Kjør en GGUF med llama.cpp

# run interactive inference with a quantized GGUF model./main -m /path/to/ministral-3-3b-instruct.gguf -t 8 -c 2048 --interactive# -t sets threads, -c sets context (tokens) if supported

Eksempel på Python‑klient (lokal llama.cpp‑server eller underprosess)

Du kan starte llama.cpp som en underprosess og sende inn forespørsler, eller bruke en liten wrapper‑klient. Mange prosjekter i miljøet tilbyr en enkel HTTP‑server‑wrapper rundt llama.cpp for lokal app‑integrasjon.

Notater og avveininger

- Kvantisering reduserer VRAM og muliggjør CPU‑inferens, men kan senke kvaliteten (mild til moderat, avhengig av kvantformat). Formater som q4_K_M eller q5‑varianter er vanlige kompromisser for CPU‑bruk. Japanske og tekniske innlegg forklarer Q4/Q5‑typer og GGUF‑konverteringer i detalj.

- For små til middels arbeidsmengder er GGUF + llama.cpp ofte den billigste og mest portable måten å kjøre lokale LLM‑er på.

Hvilke maskinvare‑ og minnehensyn betyr noe?

Kort, praktisk veiledning:

- 3B‑modeller: kan ofte kvantiseres og kjøres på en brukbar bærbar‑CPU eller en enkelt GPU med 8–16 GB VRAM (avhengig av presisjon/kvantisering). GGUF q4‑varianter kan kjøres på mange moderne CPU‑er.

- 8B og 14B‑ministral: trenger typisk en mellomklasse‑GPU (f.eks. 24–80 GB avhengig av presisjon og aktiveringscache) eller kvantisering over flere enheter.

- Mistral Large 3 (675B totalt, 41B aktiv): beregnet for datasenterutrulling og kjører vanligvis best med multi‑GPU‑noder (f.eks. 8×A100 eller H100) og spesialiserte formater (NVFP4/FP8) for vLLM. Mistral har eksplisitt publisert optimaliserte sjekkpunkter for å gjøre slike utrullinger håndterbare.

Hvis prioriteten din er lokal laptop‑bruk, sikt mot ministral 3B kvantisert GGUF + llama.cpp. Hvis prioriteten din er produksjons‑gjennomstrømning, se på vLLM + NVFP4‑sjekkpunkter på GPU‑er. Hvis du vil ha lett eksperimentering, er Ollama den raskeste måten å komme i gang på.

Hvordan bør du velge kvantisering og presisjon?

Kvantisering er en avveining: minne og hastighet vs. rå modellkvalitet. Vanlige valg:

q4_0/q4_1/q4_K_M: populære 4‑bit‑alternativer brukt for CPU‑inferens;q4_K_M(k‑means‑variant) tilbyr ofte en bedre balanse mellom kvalitet og ytelse.q5/q8/imatrix‑varianter: mellomliggende formater som kan bevare mer fidelitet til kostnad av størrelse.- FP16 / BF16 / FP8 / NVFP4: GPU‑presisjoner — BF16 og FP16 er vanlige for trening/inferens på moderne GPU‑er; FP8/NVFP4 er nye formater som sparer minne for svært store modeller og støttes av optimaliserte kjøretider og Mistrals sjekkpunktutgivelser.

Tommelregel: for lokale CPU‑kjøringer velg q4_K_M eller lignende; for GPU‑inferens med høy fidelitet bruk BF16/FP16 eller leverandørspesifikke FP8/NVFP4 når runtime støtter det.

Konklusjon — bør du kjøre Mistral 3 lokalt?

Hvis du trenger personvern, lav latens eller tilpasning, ja: Mistral 3‑familien gir deg et bredt spekter — små modeller for edge‑CPU, mellomstore modeller for én GPU eller en beskjeden klynge, og en stor MoE‑variant for datasenter‑skala — og økosystemet (Ollama, Hugging Face, vLLM, llama.cpp) støtter allerede praktiske lokale og private utrullingsmønstre. Mistral har også samarbeidet med NVIDIA og vLLM for å tilby optimaliserte sjekkpunkter for høy gjennomstrømning og redusert minnefotavtrykk, noe som gjør produksjons‑selvhosting mer realistisk enn før.

For å begynne, utforsk flere modellers (slik som Gemini 3 Pro) kapabiliteter i Playground og se API‑veiledningen for detaljerte instruksjoner. Før du får tilgang, må du sørge for at du har logget inn på CometAPI og hentet API‑nøkkelen. CometAPI tilbyr en pris som er langt lavere enn den offisielle prisen for å hjelpe deg å integrere.

Klar til å komme i gang?→ Registrer deg for CometAPI i dag !