LobeChat dan CometAPI adalah dua proyek yang berkembang pesat dalam ekosistem AI terbuka. Pada bulan September 2025, LobeChat menggabungkan integrasi penyedia CometAPI secara penuh yang memudahkan pemanggilan titik akhir CometAPI terpadu yang kompatibel dengan OpenAI dari LobeChat. Artikel ini menjelaskan apa itu LobeChat dan CometAPI, alasan integrasinya, integrasi dan konfigurasi langkah demi langkah (termasuk konfigurasi basis penyedia TypeScript yang siap pakai), contoh runtime, kasus penggunaan konkret, dan kiat produksi untuk biaya, keandalan, dan observabilitas.

Apa itu LobeChat dan fitur apa saja yang ditawarkannya?

LobeChat adalah kerangka kerja obrolan modern sumber terbuka yang dirancang untuk menghosting aplikasi obrolan LLM multi-penyedia dengan UI dan alat penerapan yang canggih. LobeChat dirancang untuk mendukung input multimoda (teks, gambar, audio), alur kerja basis pengetahuan/RAG, percakapan bercabang, dan visualisasi "rantai pemikiran", ditambah sistem penyedia/plugin yang dapat diperluas sehingga Anda dapat menukar backend model yang berbeda tanpa perlu merancang ulang aplikasi Anda. Dokumen dan repositori LobeChat menyajikannya sebagai kerangka kerja siap produksi untuk penerapan yang dihosting sendiri maupun cloud, dengan konfigurasi berbasis lingkungan dan pasar untuk integrasi MCP (model control plane) pihak ketiga.

Sekilas tentang kemampuan utama LobeChat

- Dukungan multi-penyedia (OpenAI, Anthropic, Google Gemini, Ollama, dll.).

- Unggah berkas + basis pengetahuan untuk alur kerja RAG (dokumen, PDF, audio).

- Konfigurasi yang ramah pengembang melalui variabel lingkungan dan impor URL pengaturan.

- Runtime yang dapat diperluas: penyedia dikonfigurasikan dengan runtime adaptor kecil sehingga backend baru dapat dipasang.

Apa itu CometAPI?

CometAPI adalah lapisan akses AI terpadu yang mengekspos lebih dari 500 model dari berbagai penyedia melalui satu permukaan API yang kompatibel dengan OpenAI. Lapisan ini dirancang untuk memungkinkan pengembang memilih titik akhir model berdasarkan performa, biaya, atau kapabilitas tanpa ketergantungan, serta untuk memusatkan penagihan, perutean, dan akses. CometAPI mengiklankan titik akhir terpadu untuk obrolan/penyelesaian dan API daftar model untuk menemukan ID model yang tersedia.

Mengapa CometAPI menarik bagi tim

- Pilihan model & portabilitas: beralih di antara banyak model mutakhir tanpa mengubah kode integrasi secara signifikan.

- Titik akhir yang kompatibel dengan OpenAI: banyak pustaka dan kerangka kerja klien yang mengharapkan titik akhir HTTP bergaya OpenAI dapat bekerja dengan CometAPI dengan mengubah URL dasar + autentikasi. (Contoh praktis menunjukkan

https://api.cometapi.com/v1/sebagai permukaan yang kompatibel dengan OpenAI.) - Dokumen & integrasi pengembang: CometAPI menerbitkan dokumen dan panduan langkah demi langkah untuk integrasi dengan alat seperti LlamaIndex dan platform kode rendah lainnya.

Mengapa Anda harus mengintegrasikan CometAPI ke LobeChat?

Jawaban singkat: fleksibilitas, pengendalian biaya, dan akses cepat ke model baruLobeChat dirancang untuk bersifat agnostik terhadap penyedia; dengan menambahkan CometAPI, penerapan LobeChat Anda dapat memanggil banyak model berbeda melalui jalur kode yang sama — menukar model berdasarkan throughput, latensi, biaya, atau kapabilitas tanpa mengubah UI atau alur perintah Anda. Selain itu, komunitas dan pengelola telah secara aktif menambahkan dukungan penyedia CometAPI ke LobeChat, sehingga integrasi menjadi lebih lancar.

Manfaat bisnis dan teknis

- Keberagaman model tanpa pergantian kode. Perlu mengevaluasi Gemini, Claude, atau model gambar niche? CometAPI dapat menampilkan ID model tersebut melalui satu API. Hal ini mengurangi jumlah pemrosesan per penyedia di LobeChat.

- Optimalisasi biaya. CometAPI memungkinkan Anda merutekan ke model yang lebih murah atau memilih penyedia berbiaya rendah secara dinamis, yang secara substansial dapat mengurangi biaya per percakapan untuk penerapan volume tinggi.

- Manajemen rahasia yang lebih sederhana. Satu kunci API untuk dikelola di pengaturan LobeChat atau lingkungan Docker, alih-alih beberapa kunci penyedia. Platform LobeChat sudah mendukung pengaktifan penyedia melalui

ENABLED_<PROVIDER>dan pola variabel env kunci penyedia, sehingga integrasinya konsisten secara operasional. - Menjaga basis kode LobeChat tetap minimal: logika penyedia dienkapsulasi dan dikonfigurasi dengan variabel env.

Bagaimana cara mengatur dan mengintegrasikan CometAPI di LobeChat?

Bagian ini memberikan resep langkah demi langkah yang dapat ditindaklanjuti: dapatkan kunci, atur variabel lingkungan, tambahkan penyedia ke LobeChat (contoh konfigurasi penyedia), dan tampilkan penggunaan runtime (panggilan obrolan). Contoh-contoh ini mengikuti pola penyedia LobeChat dan titik akhir yang kompatibel dengan CometAPI OpenAI.

1) Dapatkan akun CometAPI dan kunci API

Daftar di CometAPI dan buka konsol API. Untuk mendaftarkan akun CometAPI, Anda perlu menggunakan alamat email atau masuk langsung dengan Google One-Click.

Setelah menyelesaikan pendaftaran, buka taman bermain dan klik tambahkan kunci rahasia baru untuk membuat kunci API baru:

Dapatkan Kunci API.

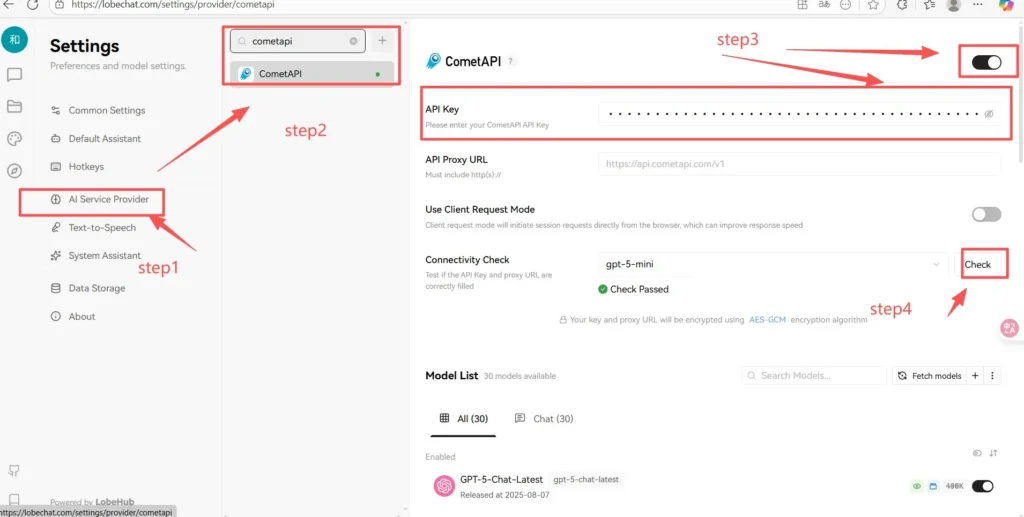

2) Mengonfigurasi CometAPI di LobeChat

- Masuk ke menu pengaturan Lobe-Chat, klik avatar, klik opsi pengaturan aplikasi.

- Pilih cometapi sebagai penyedia model.

- Tempel sk-xxxxx dari cometapi di kotak input kunci API dan nyalakan tombol, pilih satu model untuk diperiksa

3) Menguji Panggilan

Pilih salah satu model CometAPI untuk diperiksa. Masukkan perintah uji sederhana di Lobe-Chat. Jika panggilan berhasil, Anda akan menerima balasan yang sesuai. Jika gagal, periksa apakah konfigurasinya sudah benar atau hubungi layanan pelanggan online CometAPI.

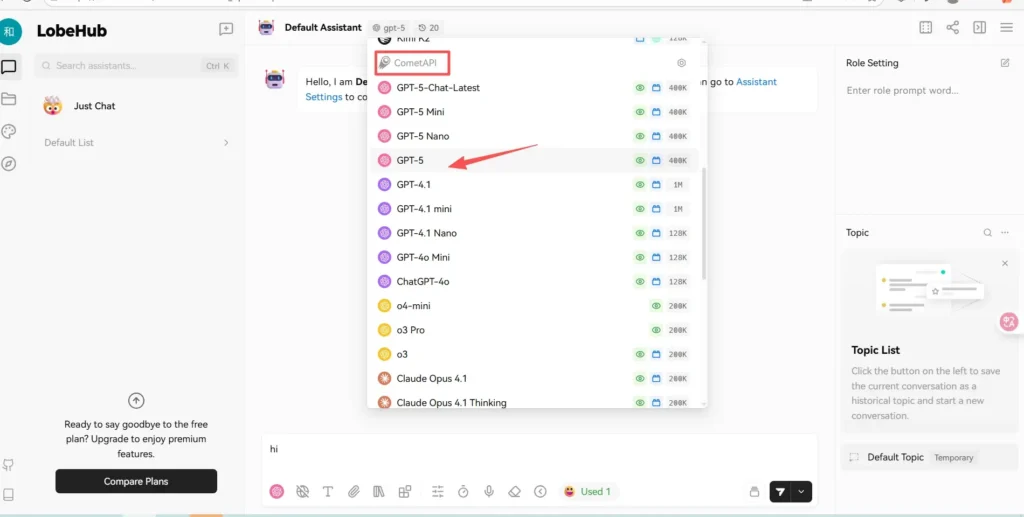

Saat ini, cometapi menyediakan lebih dari 30 model terbaru dari pengembang utama (openAI, grok, claude, gemini) di lobechat.

Bagaimana Anda dapat memperluas integrasi (peningkatan lanjutan)?

Ingin melampaui dasar-dasar? Berikut langkah-langkah penting selanjutnya yang akan membawa integrasi Anda dari fungsional ke tingkat produksi.

Peningkatan 1: Orkestrasi model dinamis (agen multi-model)

Buat logika agen di LobeChat yang secara dinamis mengolah subtugas ke berbagai model Comet (misalnya, model embedding kecil untuk pengambilan, model sedang untuk penyusunan, model berkemampuan tinggi untuk peringkasan). Gunakan sistem pemanggilan fungsi/plugin LobeChat untuk mengoordinasikan alur kerja dan mengagregasi respons akhir.

Peningkatan 2: Menyimpan embedding dan respons dalam cache

Saat menggunakan embedding (untuk RAG), hitung embedding sekali dan simpan dalam cache untuk mengurangi overhead. Jika Anda memanggil CometAPI untuk embedding, simpan representasi vektor dalam basis data vektor Anda dan hitung ulang hanya pada perubahan konten. Ini mengurangi token dan biaya.

Peningkatan 3: Konfigurasi dan kuota per penyewa

Jika Anda menjalankan instans LobeChat multi-penyewa, kendalikan batasan per penyewa (permintaan/jam, tingkatan model) dengan menulis middleware yang memetakan ID penyewa → daftar model yang diizinkan (menggunakan ID model CometAPI). Hal ini memungkinkan tingkatan premium dengan akses ke model yang lebih baik.

Peningkatan 4: Gunakan metadata model dan pemeriksaan kesehatan

Terapkan pemeriksaan kesehatan penyedia yang memanggil "ping model" CometAPI ringan atau panggilan obrolan minimal untuk memastikan latensi sesuai SLA; jika tidak, batalkan model fallback dengan anggun. Pantau detak jantung dan tampilkan status penyedia di UI admin LobeChat.

Perangkap apa saja yang perlu diwaspadai?

- Paparan kunci APIJangan pernah menyimpan kunci CometAPI dalam kode klien. Selalu simpan di sisi server (lapisan server LobeChat).

- Nama model melayangCometAPI dapat menambahkan atau menghentikan penggunaan ID model. Gunakan pemetaan server dan perbarui

COMETAPI_MODEL_LISTketika Anda ingin mengekspos model baru. - Perbedaan format respons:Meskipun CometAPI ditujukan untuk kompatibilitas OpenAI, beberapa model atau bidang meta mungkin berbeda; selalu petakan dan bersihkan respons sebelum menampilkannya kepada pengguna.

Mulai

CometAPI adalah platform API terpadu yang menggabungkan lebih dari 500 model AI dari penyedia terkemuka—seperti seri GPT OpenAI, Gemini Google, Claude Anthropic, Midjourney, Suno, dan lainnya—menjadi satu antarmuka yang ramah bagi pengembang. Dengan menawarkan autentikasi yang konsisten, pemformatan permintaan, dan penanganan respons, CometAPI secara drastis menyederhanakan integrasi kapabilitas AI ke dalam aplikasi Anda. Baik Anda sedang membangun chatbot, generator gambar, komposer musik, atau alur kerja analitik berbasis data, CometAPI memungkinkan Anda melakukan iterasi lebih cepat, mengendalikan biaya, dan tetap tidak bergantung pada vendor—semuanya sambil memanfaatkan terobosan terbaru di seluruh ekosistem AI.

Untuk memulai, jelajahi kemampuan model di tempat bermain dan konsultasikan Panduan API untuk petunjuk terperinci. Sebelum mengakses, pastikan Anda telah masuk ke CometAPI dan memperoleh kunci API. API Komet menawarkan harga yang jauh lebih rendah dari harga resmi untuk membantu Anda berintegrasi.

Siap untuk berangkat?→ Daftar ke CometAPI hari ini !

Kesimpulan

Mengintegrasikan CometAPI ke dalam LobeChat merupakan cara praktis untuk mendapatkan keragaman model, fleksibilitas biaya, dan kemampuan eksperimen yang cepat, sekaligus mempertahankan fitur UX dan RAG yang telah disempurnakan yang disediakan LobeChat. Komunitas LobeChat telah melakukan upaya signifikan untuk menambahkan dukungan CometAPI (kartu penyedia, daftar model, adaptor runtime, pengujian, dan dokumen), yang dapat Anda manfaatkan secara langsung atau sebagai inspirasi untuk mengimplementasikan adaptor khusus untuk kebutuhan khusus. Untuk langkah-langkah integrasi yang paling akurat dan contoh-contoh terbaru, silakan lihat dokumen CometAPI dan Dokumen penyedia model LobeChat dan repo—tautan yang dirujuk di bawah ini akan membantu Anda melanjutkan.