Model penalaran terbaru OpenAI, o3‑pro, menunjukkan lompatan signifikan dalam performa dan kapabilitas untuk aplikasi yang digerakkan oleh AI. Diluncurkan pada awal Juni 2025, o3‑pro menawarkan penalaran tingkat lanjut, pemahaman multimoda, dan penggunaan alat kepada pengembang dan perusahaan—semuanya dengan harga premium. Artikel ini merangkum pengumuman terbaru, laporan pengguna, dan data tolok ukur untuk memberikan gambaran menyeluruh tentang performa, pertimbangan biaya, dan ketersediaan o3‑pro.

Apa itu o3‑pro?

Penawaran terbaru OpenAI, o3‑pro, menandai tonggak penting dalam model penalaran AI dengan menggabungkan kemampuan yang ditingkatkan dengan label harga premium. Diluncurkan pada 11 Juni 2025, o3‑pro menggantikan model o3 standar dan menggantikan o1‑pro dalam jajaran produk OpenAI, yang menargetkan pengembang dan perusahaan yang memprioritaskan analisis mendalam dan keandalan daripada kecepatan mentah. Dibangun di atas arsitektur dasar yang sama dengan o3—yang awalnya diperkenalkan pada April 2025—o3‑pro mengintegrasikan pencarian web waktu nyata, analisis file, penalaran visual, eksekusi Python, dan fitur memori tingkat lanjut, yang menangani alur kerja kompleks dalam sains, pemrograman, bisnis, dan penulisan. Namun, pendekatan penalaran yang disengaja dari model tersebut menimbulkan latensi yang lebih lama dan peningkatan biaya yang substansial, yang mencerminkan desainnya yang intensif komputasi.

Apa yang membedakan o3‑pro dari model o3 standar?

Penalaran Multimodal Tingkat Lanjut

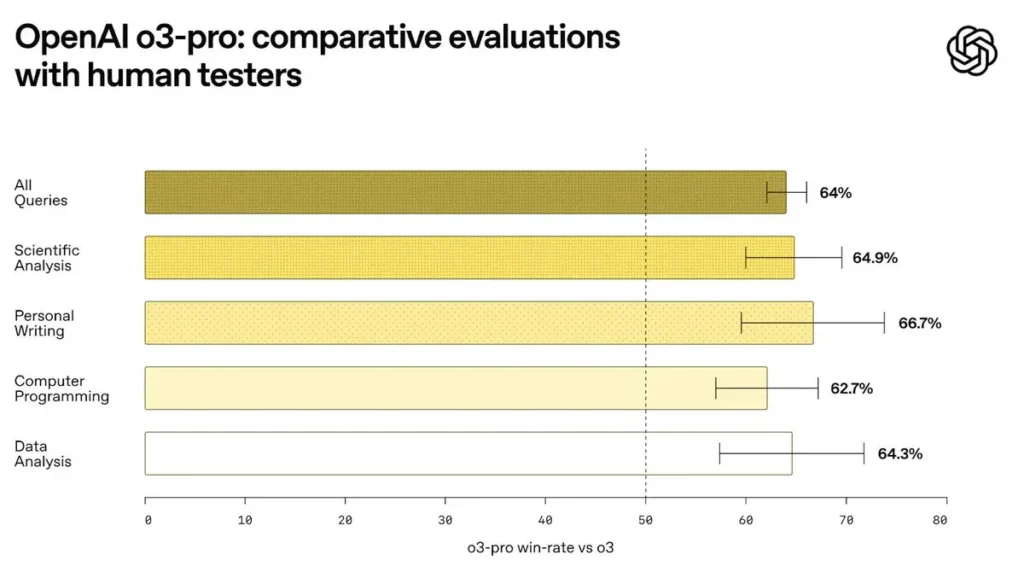

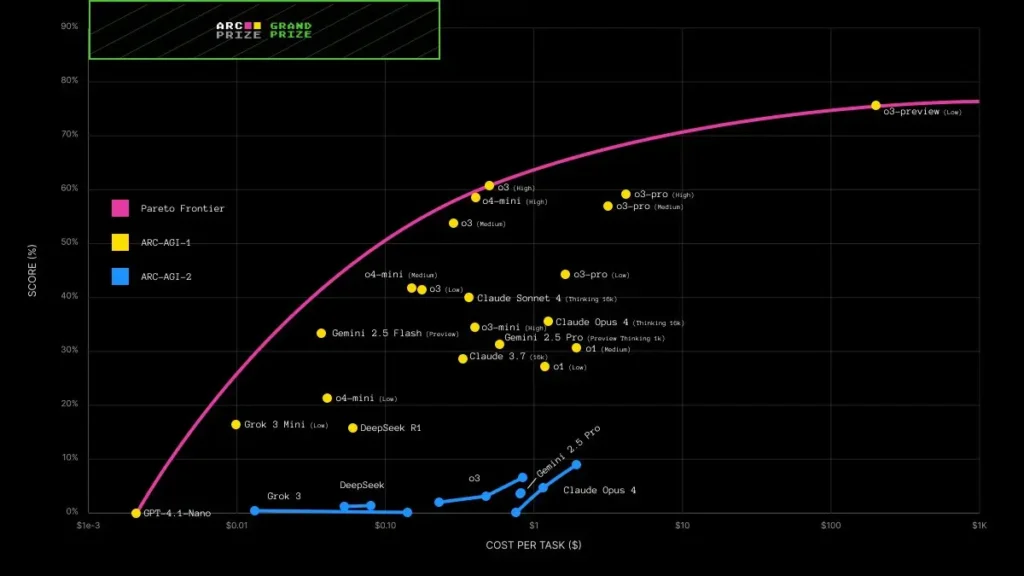

OpenAI telah mengevaluasi o3-pro secara ketat di berbagai penilaian AI standar untuk memvalidasi kecakapan penalarannya. Dalam ranah matematika, o3-pro mengungguli Gemini 2.5 Pro milik Google pada tolok ukur AIME 2024, menunjukkan penalaran logis yang unggul dan penyelesaian persamaan kompleks dalam kondisi waktu tertentu. Demikian pula, pada tolok ukur GPQA Diamond—yang mengukur pemahaman ilmiah dan pemecahan masalah tingkat PhD—o3-pro melampaui Claude 4 Opus milik Anthropic, yang menggarisbawahi kedalamannya dalam penalaran ilmiah tingkat lanjut.

o3‑pro dibangun berdasarkan kekuatan model o3 andalan OpenAI dengan mengintegrasikan penjelajahan web secara real-time, analisis berkas, pemahaman visual, dan eksekusi Python secara langsung ke dalam satu antarmuka. Menurut OpenAI, kemampuan penalaran yang ditingkatkan ini memungkinkan o3‑pro untuk menangani tugas-tugas yang rumit—seperti interpretasi data ilmiah, penelusuran kesalahan kode bentuk panjang, dan pembuatan konten multimoda—dengan keandalan yang lebih baik daripada pendahulunya.

Keandalan atas Latensi

Kemampuan baru ini disertai dengan kekurangan: waktu respons o3‑pro jauh lebih lambat daripada o3, yang mencerminkan langkah komputasi dan pemrosesan konteks tambahan yang diperlukan untuk penggunaan alat tingkat lanjut. Pengguna awal melaporkan latensi tipikal sebesar 1.5–2x lebih tinggi dari o3 pada perintah yang setara, meskipun angka pastinya bervariasi berdasarkan kompleksitas permintaan.

Batasan Fitur saat Peluncuran

Saat peluncuran, pengguna o3‑pro menyadari beberapa keterbatasan sementara: pembuatan gambar tetap tidak tersedia, dan fitur ChatGPT tertentu—seperti sesi “Canvas” sementara dan utas obrolan sementara—dinonaktifkan sementara OpenAI meningkatkan skala infrastruktur untuk model baru. Pembatasan ini diharapkan akan berkurang dalam beberapa bulan mendatang seiring dengan peningkatan kapasitas.

Bagaimana kinerja o3‑pro pada tolok ukur industri?

Tes Penalaran Standar

Dalam pengujian internal, o3‑pro mengungguli o3 dengan margin yang signifikan pada rangkaian penalaran standar yang mencakup matematika, teka-teki logika, dan tantangan pemrograman. Skor yang dilaporkan komunitas menempatkan o3 pada sekitar 2,517 poin, sementara skor o3‑pro mendekati 2,748—peningkatan sekitar 9%.

Evaluasi Pengkodean Dunia Nyata

Pengembang yang menjalankan tugas pembuatan kode langsung dan debugging telah mengamati bahwa o3‑pro menghasilkan keluaran yang lebih benar secara sintaksis dan akurat secara semantik dalam pengaturan single‑shot dan few‑shot. Tolok ukur pada repositori pengodean seperti CodeSearchNet menunjukkan peningkatan 5–7% dalam kebenaran fungsional dibandingkan o3, khususnya pada masalah konteks panjang yang melebihi 4,000 token.

Kinerja Komparatif Terhadap Pesaing

Dalam uji head-to-head, o3-pro tidak hanya mengalahkan Gemini 2.5 Pro dan Claude 4 Opus dalam skor mentah tetapi juga memberikan output yang lebih konsisten dalam uji stres adversarial. Dengan menggabungkan penanganan masukan multimoda dan penggunaan alat yang dinamis, o3-pro mempersempit kesenjangan dengan model khusus dari para pesaing seperti Google PaLM dan Anthropic Claude X. Uji head-to-head awal menunjukkan bahwa o3-pro menyamai atau melampaui akurasi pesaing pada tolok ukur penalaran kompleks, meskipun laporan pihak ketiga yang komprehensif masih akan datang.

Struktur harga apa yang seharusnya diharapkan pengembang?

Model Penagihan Berbasis Token

OpenAI melanjutkan penagihan berbasis token: o3‑pro berharga $20 per juta token input dan $80 per juta token output—tepat sepuluh kali lipat biaya model o3 standar setelah pemotongan harga baru-baru ini. Sebaliknya, o3 sekarang berjalan pada harga $2 per juta token input dan $8 per juta token output setelah pengurangan harga sebesar 80% pada awal Juni 2025.

| Pilih Model | Input Harga Token | Harga Token Keluaran |

|---|---|---|

| o3 | $2 / 1 juta token | $8 / 1 juta token |

| o3‑pro | $20 / 1 juta token | $80 / 1 juta token |

Alasan Dibalik Premi

Kenaikan harga sepuluh kali lipat ini mencerminkan sumber daya komputasi tambahan, infrastruktur dengan throughput tinggi, dan integrasi perkakas khusus yang dibutuhkan o3‑pro. OpenAI memposisikan o3‑pro sebagai model "misi kritis" untuk aplikasi yang akurasi dan penalaran tingkat lanjutnya membenarkan biaya premium.

Diskon Volume dan API Batch

Perusahaan yang memproses token dalam jumlah besar masih dapat memanfaatkan Batch API untuk menghemat hingga 50% pada input dan output yang di-cache. Meskipun mekanisme ini terutama menguntungkan pengguna varian GPT‑4.1 dengan volume tinggi, opsi batching serupa diharapkan akan diluncurkan untuk model seri-o pada akhir tahun 2025.

Bagaimana pengembang dan tim dapat mengakses o3‑pro?

Ketersediaan API

Dalam pengujian head-to-head, o3-pro tidak hanya mengalahkan Gemini 2.5 Pro dan Claude 4 Opus pada skor mentah tetapi juga memberikan hasil yang lebih konsisten dalam pengujian stres yang kompetitif.

OpenAI membuat o3‑pro dapat diakses melalui API publiknya pada 10 Juni 2025, dengan dukungan langsung di titik akhir Completions dan Chat. Pengembang dapat menentukan "o3-pro" model dalam panggilan API mereka, tunduk pada batasan tarif dan kendala kuota yang terkait dengan tingkatan langganan mereka.

POST https://api.openai.com/v1/chat/completions

{

"model": "o3-pro",

"messages": ,

"max_tokens": 1500

}

Paket ChatGPT Pro & Tim

Pelanggan ChatGPT Pro dan Team memperoleh akses langsung ke o3‑pro dalam antarmuka ChatGPT. Pengguna dapat beralih antara o3 dan o3‑pro dalam pemilih model, meskipun ketersediaan awal terbatas pada sebagian kecil pelanggan perusahaan dan penguji beta.

Melalui CometAPI API

Pengembang dapat mengakses API o3-Pro(modelnya: ”o3-Pro"atau"o3-pro-2025-06-10") melalui API Komet, model terbaru yang tercantum adalah pada tanggal publikasi artikel. Untuk memulai, jelajahi kemampuan model di tempat bermain dan konsultasikan Panduan API untuk petunjuk terperinci. Sebelum mengakses, pastikan Anda telah masuk ke CometAPI dan memperoleh kunci API. API Komet menawarkan harga yang jauh lebih rendah dari harga resmi untuk membantu Anda berintegrasi.

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.cometapi.com/v1",

api_key="<YOUR_API_KEY>",

)

response = client.chat.completions.create(

model="o3-Pro",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices.message.content

print(f"Assistant: {message}")

Kasus penggunaan praktis apa yang paling diuntungkan dari o3‑pro?

Penelitian Ilmiah & Analisis Data

Peneliti yang bekerja dengan kumpulan data besar—mulai dari genomik hingga simulasi iklim—dapat memanfaatkan analisis file o3‑pro dan kemampuan eksekusi Python untuk mengotomatiskan pengujian hipotesis dan menghasilkan wawasan tanpa batasan panjang konteks.

Alur Kerja Pengetahuan Perusahaan

Di sektor seperti keuangan dan layanan hukum, di mana presisi dan auditabilitas menjadi yang terpenting, kepatuhan instruksi dan penalaran multimodal o3‑pro yang ditingkatkan mengurangi tingkat kesalahan dalam tinjauan kontrak, pemodelan keuangan, dan tugas kepatuhan regulasi.

Pengembangan Perangkat Lunak & DevOps

Dengan menggabungkan pemahaman kode konteks panjang dengan pengujian langsung melalui eksekusi Python, o3‑pro menyederhanakan proses debugging dan mengotomatiskan alur kerja refactoring yang rumit, mempercepat siklus pengiriman untuk proyek perangkat lunak skala besar.

Apa yang harus dipertimbangkan organisasi sebelum melakukan peningkatan?

Analisis Biaya-Manfaat

Tim harus mempertimbangkan kenaikan harga 10x terhadap proyeksi keuntungan efisiensi. Untuk tugas bernilai tinggi namun bervolume rendah—seperti menyusun laporan strategis atau membangun sistem keselamatan penting—akurasi dan dukungan perkakas dapat membenarkan premium o3‑pro. Untuk pembuatan konten massal, tetap menggunakan model o3 atau o4‑mini standar bisa jadi lebih ekonomis.

Kesiapan Infrastruktur

Karena o3‑pro memaksakan latensi dan tuntutan throughput yang lebih tinggi, organisasi harus mengaudit batas kecepatan API, kapasitas jaringan, dan strategi percobaan ulang kesalahan untuk menghindari kemacetan selama penggunaan puncak.

Sbg penutup

Model o3‑pro OpenAI menetapkan standar baru untuk penalaran tingkat lanjut, pemahaman multimoda, dan penggunaan alat terpadu dalam AI. Peningkatan tolok ukur dan keandalannya menjadikannya pilihan yang menarik untuk aplikasi misi kritis, asalkan anggaran dan infrastruktur dapat mendukung biaya yang tinggi. Seiring berkembangnya lanskap AI, peran o3‑pro akan menguat di area yang menuntut tingkat akurasi dan kedalaman kontekstual tertinggi, sementara beban kerja yang lebih sensitif terhadap biaya dapat terus memanfaatkan model dasar o‑series atau varian mini yang baru muncul.