Al Google I/O 2025, tenutosi a Mountain View, in California, i team di Google DeepMind e Google AI hanno presentato miglioramenti significativi alla loro serie di modelli di grandi dimensioni Gemini 2.5. Questi aggiornamenti riguardano sia Gemelli 2.5 Pro e al Gemelli 2.5 Flash varianti, introducendo funzionalità di ragionamento avanzate, output audio nativo, supporto multilingue, misure di sicurezza e notevoli miglioramenti in termini di efficienza. Nel complesso, questi miglioramenti mirano a fornire a sviluppatori, aziende e utenti finali servizi di intelligenza artificiale più affidabili, naturali ed economici su Google AI Studio, l'API Gemini e Vertex AI.

Miglioramenti di Gemini 2.5 Pro

Deep Think: Ragionamento multi-ipotesi migliorato

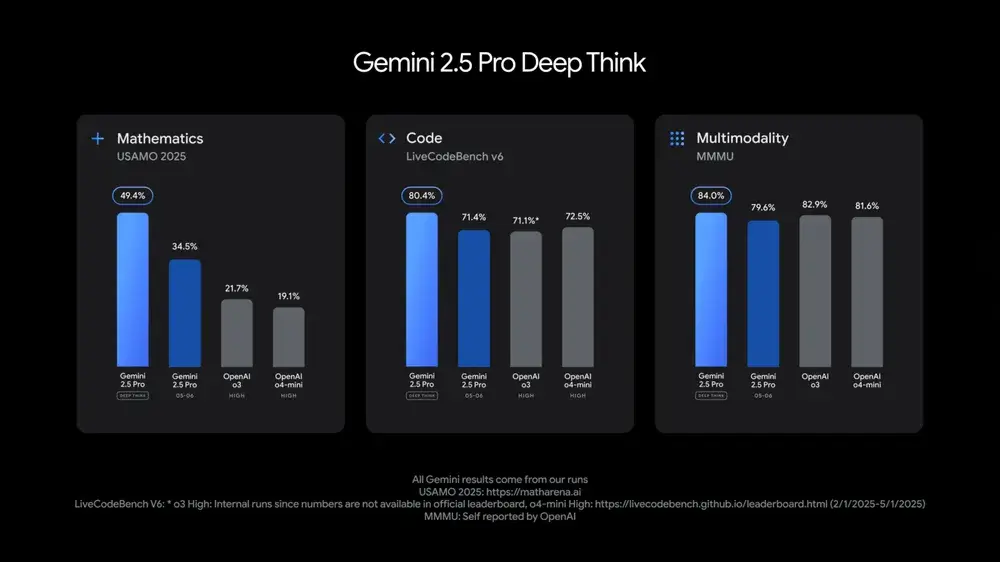

Una caratteristica importante per 2.5 Pro è Pensiero profondo, una modalità di ragionamento sperimentale che consente al modello di generare, confrontare e perfezionare internamente diversi percorsi di soluzione prima di produrre l'output finale. I primi benchmark dimostrano l'eccellenza di Deep Think: si è classificato al primo posto nell'esame di matematica USAMO del 2025, in cima al LiveCodeBench per la programmazione a livello competitivo e ha ottenuto un punteggio dell'84.0% nel test di ragionamento multimodale MMMU.

A partire da questo mese, Deep Think sarà disponibile per i "tester attendibili" tramite l'API Gemini. Google ha affermato di aver bisogno di più tempo per le valutazioni di sicurezza prima di rendere Deep Think più ampiamente disponibile.

Audio nativo e dialogo multilingue

Basandosi sulle sue capacità di testo, Gemini 2.5 Pro ora supporta uscita audio nativa in 24 lingue. Questa funzionalità offre una prosodia contestualizzata e un'inflessione emotiva, rendendo le interazioni con l'IA più umane. Oltre all'audio, il sistema di dialogo del modello adatta dinamicamente il tono, amplificando l'empatia nelle applicazioni di assistenza clienti e nel settore educativo. Le prime demo includevano chat vocali in tempo reale con enfasi sfumata e guide di codice multilingue, evidenziando la spinta di Google verso un'IA veramente conversazionale.

Sicurezza e affidabilità

I miglioramenti alla sicurezza nella versione 2.5 Pro si concentrano sulla mitigazione degli attacchi indiretti di tipo prompt injection. Il framework aggiornato utilizza una sanificazione degli input più rigorosa e un filtro dinamico del contesto, essenziali per i settori regolamentati che gestiscono dati sensibili. Secondo il blog degli sviluppatori di Google, queste misure di sicurezza riducono la vulnerabilità fino al 40% nelle valutazioni interne dei red team, gettando le basi per una più ampia adozione a livello aziendale.

Ottimizzazioni Flash di Gemini 2.5

Efficienza e velocità

Gemini 2.5 Flash, il fratello ottimizzato per la latenza di 2.5 Pro, è stato revisionato per Efficienza computazionale superiore del 22% e tempi di risposta più rapidi. Durante il keynote, Demis Hassabis ha osservato che Flash ora "offre prestazioni migliori in quasi ogni dimensione" rispetto al suo predecessore, con la disponibilità in anteprima per gli sviluppatori in Google AI Studio, Vertex AI e nell'app mobile Gemini. Il lancio generale è previsto per l'inizio di giugno 2025. L'ultima versione di Gemini 2.5 Flash è attualmente disponibile. gemini-2.5-flash-preview-05-20 al Google I/O 2025.

Capacità multimodali ampliate

Sia le varianti Flash che Pro condividono nuove capacità di ragionamento multimodale, consentendo agli utenti di interagire con input di testo, immagini, audio e persino video. Tra i casi d'uso più significativi presentati all'I/O figurano visualizzazioni frattali generate da un singolo prompt e pipeline "Video to Learning App" che convertono video didattici in esperienze educative interattive.

Aggiornamenti dell'ecosistema degli sviluppatori

Integrazione di Google AI Studio

Google AI Studio offre ora un accesso fluido sia a Gemini 2.5 Pro che a Flash. L'editor di codice nativo incorpora direttamente i modelli, consentendo agli sviluppatori di generare app web pronte per la produzione tramite semplici prompt. I modelli di avvio mostrano attività che spaziano dagli agenti conversazionali con audio alle dashboard di analisi dei dati in tempo reale, riducendo i cicli di prototipazione da settimane a minuti.

Avanzamenti dell'API Gemini

. API Gemelli ricevuto diversi aggiornamenti:

- Chiamata di funzioni semplificata: Le definizioni di schema semplificate riducono lo sforzo di integrazione del 30%.

- Controllo del budget di pensiero:Gli sviluppatori possono ora impostare un ragionamento approfondito per trovare il compromesso tra costi e prestazioni.

- Flussi di lavoro agentici: I nuovi endpoint supportano l'orchestrazione degli agenti in più fasi tramite Progetto Mariner, consentendo all'IA di eseguire in modo autonomo fino a 10 attività collegate (ad esempio, recupero dati, riepilogo e generazione di report) con un'unica chiamata.

Disponibilità generale di Gemini Code Assist

Gemelli 2.5 poteri Assistenza al codice Gemini Per utenti singoli e integrazioni con GitHub, ora generalmente disponibili sia a livello gratuito che a pagamento. Questo strumento eccelle nella trasformazione del codice, nella generazione di interfacce utente front-end e nel refactoring automatizzato, soddisfacendo le esigenze sia dei programmatori alle prime armi che degli ingegneri esperti.

Disponibilità e prezzi

. Serie Gemini 2.5 è accessibile a tutti i clienti Google Cloud tramite Vertex AI, con livelli di prestazioni determinati dal livello di abbonamento:

- Professionista dell'intelligenza artificiale ($ 19.99/mese) garantisce l'accesso alle funzionalità Flash di Gemini 2.5 e standard di 2.5 Pro.

- IA Ultra ($ 249.99/mese) sblocca Deep Think, throughput prioritario e la suite completa di funzionalità multimodali e agentiche, insieme a servizi in bundle come 30 TB di spazio di archiviazione cloud e YouTube Premium.

Conclusione e Outlook

Con gli ultimi aggiornamenti di Gemini 2.5 Pro e Flash, Google sta definendo un nuovo punto di riferimento per il ragionamento, l'interattività e la produttività degli sviluppatori nell'ambito dell'intelligenza artificiale. La valutazione multi-ipotesi di Deep Think, combinata con l'audio nativo, i progressi in termini di sicurezza e i miglioramenti in termini di efficienza, apre la strada a sistemi di intelligenza artificiale più intelligenti, affidabili e accessibili. Con il lancio di questi modelli a giugno, la loro integrazione in Google AI Studio, nell'API Gemini e in Vertex AI accelererà l'innovazione, dagli assistenti di programmazione più intelligenti agli strumenti didattici immersivi, rimodellando il modo in cui individui e organizzazioni sfruttano l'intelligenza artificiale.

Iniziamo

CometAPI fornisce un'interfaccia REST unificata che aggrega centinaia di modelli di intelligenza artificiale, inclusa la famiglia Gemini, in un endpoint coerente, con gestione integrata delle chiavi API, quote di utilizzo e dashboard di fatturazione. Questo significa che non dovrete più destreggiarvi tra URL e credenziali di più fornitori.

Gli sviluppatori possono accedere Pre-API Flash Gemini 2.5 (modello:gemini-2.5-flash-preview-05-20) e API di Gemini 2.5 Pro (modello:gemini-2.5-pro-preview-05-06)ecc. attraverso CometaAPIPer iniziare, esplora le capacità del modello nel Playground e consulta il Guida API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l'accesso a CometAPI e di aver ottenuto la chiave API.