LobeChat e CometAPI sono due progetti in rapida evoluzione nell'ecosistema dell'intelligenza artificiale aperta. A settembre 2025, LobeChat ha integrato completamente il provider CometAPI, semplificando la chiamata degli endpoint unificati e compatibili con OpenAI di CometAPI da LobeChat. Questo articolo spiega cosa sono LobeChat e CometAPI, perché integrarli, l'integrazione e la configurazione passo passo (inclusa una configurazione di base del provider TypeScript pronta all'uso), esempi di runtime, casi d'uso concreti e suggerimenti di produzione per costi, affidabilità e osservabilità.

Cos'è LobeChat e quali funzionalità offre?

LobeChat è un framework di chat moderno e open source, progettato per ospitare applicazioni di chat LLM multi-provider con un'interfaccia utente ottimizzata e strumenti di deployment. È progettato per supportare input multimodali (testo, immagini, audio), flussi di lavoro basati su knowledge base/RAG, conversazioni ramificate e visualizzazioni "chain of thought", oltre a un sistema estensibile di provider/plugin che consente di sostituire diversi backend di modelli senza dover riprogettare l'app. La documentazione e il repository di LobeChat lo presentano come un framework pronto per la produzione, sia per distribuzioni self-hosted che cloud, con configurazione basata sull'ambiente e un marketplace per integrazioni MCP (Model Control Plane) di terze parti.

Panoramica delle funzionalità principali di LobeChat

- Supporto multi-provider (OpenAI, Anthropic, Google Gemini, Ollama, ecc.).

- Caricamento file + knowledge base per flussi di lavoro RAG (documenti, PDF, audio).

- Configurazione intuitiva per gli sviluppatori tramite variabili di ambiente e importazione di URL delle impostazioni.

- Runtime estensibile: i provider sono configurati con runtime di adattatori ridotti, in modo che i nuovi backend siano collegabili.

Che cos'è CometAPI?

CometAPI è un livello di accesso AI unificato che espone oltre 500 modelli da numerosi provider sottostanti attraverso un'unica superficie API compatibile con OpenAI. È posizionata in modo da consentire agli sviluppatori di scegliere gli endpoint dei modelli in base a prestazioni, costi o capacità senza vincoli, e di centralizzare fatturazione, routing e accesso. CometAPI pubblicizza endpoint unificati per chat/completamenti e un'API per l'elenco dei modelli per scoprire gli ID dei modelli disponibili.

Perché CometAPI è attraente per i team

- Scelta del modello e portabilità: passare da un modello all'altro senza modificare in modo significativo il codice di integrazione.

- Endpoint compatibili con OpenAI: Molte librerie client e framework che si aspettano endpoint HTTP in stile OpenAI possono funzionare con CometAPI modificando l'URL di base + autenticazione. (Esempi pratici mostrano

https://api.cometapi.com/v1/come superficie compatibile con OpenAI.) - Documentazione e integrazioni per sviluppatori: CometAPI pubblica documenti e guide dettagliate per l'integrazione con strumenti come LlamaIndex e altre piattaforme low-code.

Perché dovresti integrare CometAPI in LobeChat?

Risposta breve: flessibilità, controllo dei costi e rapido accesso a nuovi modelliLobeChat è progettato per essere indipendente dal provider; l'integrazione di CometAPI offre alla distribuzione di LobeChat la possibilità di richiamare molti modelli diversi tramite lo stesso percorso di codice, scambiando i modelli per throughput, latenza, costi o capacità senza modificare l'interfaccia utente o i flussi di prompt. Inoltre, la community e i manutentori hanno attivamente aggiunto il supporto del provider CometAPI a LobeChat, rendendo l'integrazione più fluida.

Vantaggi aziendali e tecnici

- Diversificazione del modello senza ricambio di codice. Hai bisogno di valutare Gemini, Claude o un modello di immagine di nicchia? CometAPI può esporre gli ID di questi modelli tramite un'unica API. Questo riduce la quantità di lavoro di plumbing per provider in LobeChat.

- Ottimizzazione dei costi. CometAPI consente di indirizzare verso modelli più economici o di selezionare dinamicamente provider a costi inferiori, il che può ridurre notevolmente i costi per conversazione per distribuzioni ad alto volume.

- Gestione più semplice dei segreti. Una sola chiave API da gestire nelle impostazioni di LobeChat o nell'ambiente Docker, anziché più chiavi provider. La piattaforma LobeChat supporta già l'abilitazione di un provider tramite

ENABLED_<PROVIDER>e un modello env var della chiave del provider, in modo che l'integrazione sia coerente a livello operativo. - Mantiene la base di codice di LobeChat minima: la logica del provider è incapsulata e configurata con variabili di ambiente.

Come posso configurare e integrare CometAPI in LobeChat?

Questa sezione fornisce una ricetta pratica e dettagliata: ottenere le chiavi, impostare le variabili di ambiente, aggiungere il provider a LobeChat (esempio di configurazione del provider) e visualizzare l'utilizzo in fase di esecuzione (chiamata chat). Gli esempi seguono i pattern dei provider di LobeChat e gli endpoint compatibili con CometAPI OpenAI.

1) Ottieni un account CometAPI e una chiave API

Registrati su CometAPI e apri la console API. Per registrare un account CometAPI, dovrai utilizzare un indirizzo email o accedere direttamente con Google One-Click.

Dopo aver completato la registrazione, vai al playground e clicca su aggiungi nuova chiave segreta per creare una nuova chiave API:

Ottieni una chiave API.

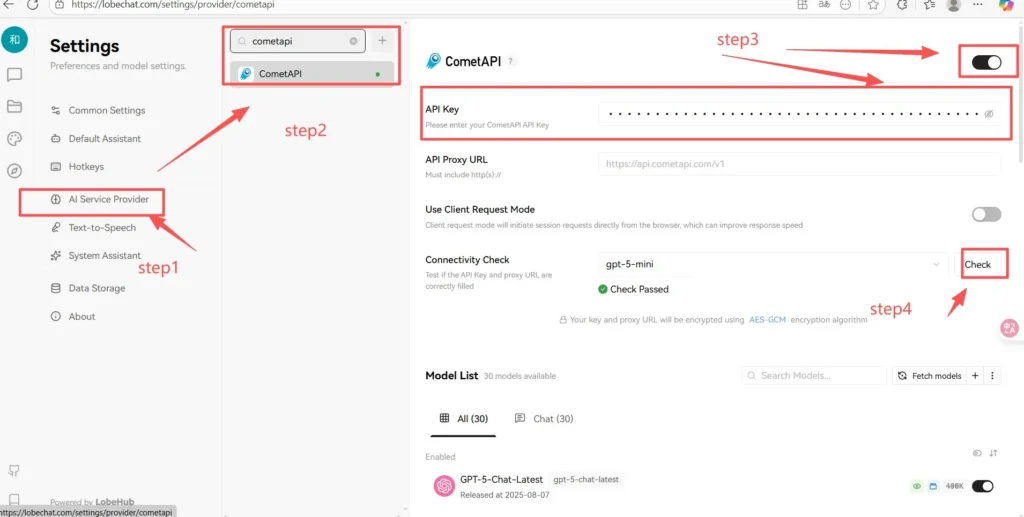

2) Configurazione di CometAPI in LobeChat

- Accedi al menu delle impostazioni di Lobe-Chat, clicca sull'avatar, clicca sull'opzione delle impostazioni dell'applicazione.

- Seleziona cometapi come fornitore del modello.

- Incolla sk-xxxxx da cometapi nella casella di input della chiave API e attiva il pulsante, seleziona un modello da controllare

3) Test della chiamata

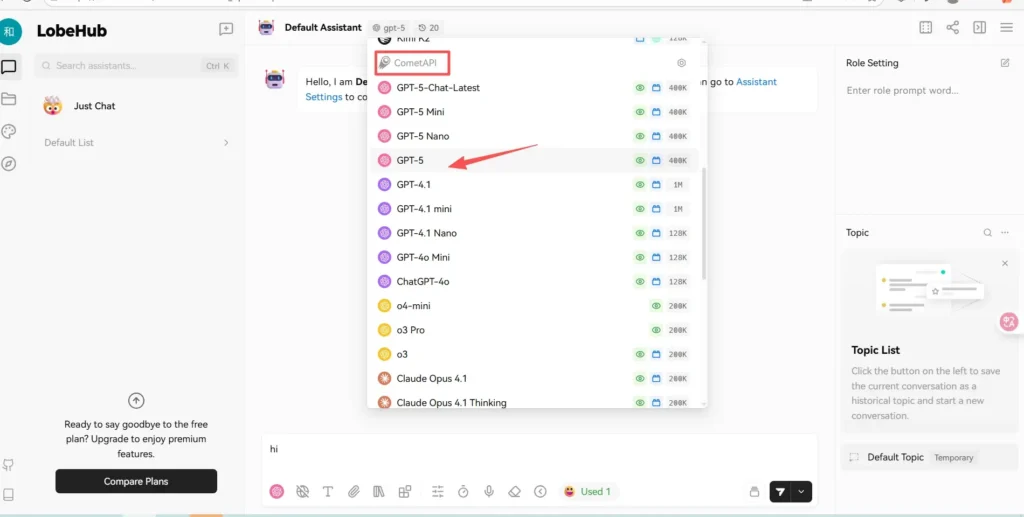

Seleziona un modello di CometAPI da verificare, inserisci un semplice comando di prova in Lobe-Chat. Se la chiamata ha esito positivo, riceverai una risposta corrispondente; in caso contrario, verifica la correttezza della configurazione o contatta il servizio clienti online di CometAPI.

Attualmente, cometapi fornisce più di 30 modelli più recenti dei principali sviluppatori (openAI, grok, claude, gemini) su lobechat.

Come è possibile estendere l'integrazione (miglioramenti avanzati)?

Vuoi andare oltre le basi? Ecco i passaggi successivi che porteranno la tua integrazione da funzionale a produttiva.

Miglioramento 1: Orchestrazione dinamica del modello (agenti multi-modello)

Crea una logica di agente in LobeChat che distribuisca dinamicamente le sottoattività a diversi modelli Comet (ad esempio, un modello di incorporamento di piccole dimensioni per il recupero, un modello di medie dimensioni per la stesura, un modello ad alta capacità per la sintesi). Utilizza il sistema di chiamate di funzione/plugin di LobeChat per coordinare il flusso di lavoro e aggregare le risposte finali.

Miglioramento 2: Memorizzazione nella cache di incorporamenti e risposte

Quando si utilizzano gli embedding (per RAG), calcolarli una sola volta e memorizzarli nella cache per ridurre il sovraccarico. Se si richiama CometAPI per gli embedding, memorizzare le rappresentazioni vettoriali nel database vettoriale e rielaborarle solo in caso di modifiche al contenuto. Questo riduce token e costi.

Miglioramento 3: Configurazione e quote per tenant

Se esegui un'istanza LobeChat multi-tenant, controlla i limiti per tenant (richieste/ora, livelli di modello) scrivendo un middleware che mappa l'ID tenant → l'elenco dei modelli consentiti (utilizzando gli ID modello CometAPI). Ciò consente livelli premium con accesso a modelli migliori.

Miglioramento 4: utilizzare i metadati del modello e i controlli di integrità

Implementare controlli di integrità del provider che richiamino un "ping del modello" CometAPI leggero o una chiamata chat minima per garantire che la latenza rientri negli SLA; in caso contrario, evitare di eseguire il fallback dei modelli. Mantenere un heartbeat monitor e presentare lo stato del provider nell'interfaccia utente di amministrazione di LobeChat.

A quali insidie bisogna fare attenzione?

- Esposizione della chiave API: Non memorizzare mai le chiavi CometAPI nel codice client. Conservale sempre sul lato server (livello server di LobeChat).

- Nome del modello drift: CometAPI potrebbe aggiungere o deprecare ID modello. Utilizzare un mapping del server e aggiornarlo

COMETAPI_MODEL_LISTquando vuoi esporre nuovi modelli. - Differenze nel formato di risposta: Sebbene CometAPI miri alla compatibilità con OpenAI, alcuni modelli o metacampi potrebbero differire; mappare e ripulire sempre le risposte prima di mostrarle agli utenti.

Iniziamo

CometAPI è una piattaforma API unificata che aggrega oltre 500 modelli di intelligenza artificiale (IA) di provider leader, come la serie GPT di OpenAI, Gemini di Google, Claude di Anthropic, Midjourney, Suno e altri, in un'unica interfaccia intuitiva per gli sviluppatori. Offrendo autenticazione, formattazione delle richieste e gestione delle risposte coerenti, CometAPI semplifica notevolmente l'integrazione delle funzionalità di IA nelle tue applicazioni. Che tu stia sviluppando chatbot, generatori di immagini, compositori musicali o pipeline di analisi basate sui dati, CometAPI ti consente di iterare più velocemente, controllare i costi e rimanere indipendente dal fornitore, il tutto sfruttando le più recenti innovazioni nell'ecosistema dell'IA.

Per iniziare, esplora le capacità del modello in Parco giochi e consultare il Guida API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l'accesso a CometAPI e di aver ottenuto la chiave API. CometaAPI offrire un prezzo molto più basso rispetto al prezzo ufficiale per aiutarti a integrarti.

Pronti a partire? → Iscriviti oggi a CometAPI !

Conclusione

Integrare CometAPI in LobeChat è un modo pratico per ottenere diversità di modelli, flessibilità dei costi e capacità di sperimentazione rapida, mantenendo al contempo le funzionalità UX e RAG ottimizzate di LobeChat. La community di LobeChat ha già fatto notevoli sforzi per aggiungere il supporto a CometAPI (scheda provider, elenco modelli, adattatori runtime, test e documentazione), che è possibile sfruttare direttamente o utilizzare come ispirazione per implementare un adattatore personalizzato per esigenze specifiche. Per i passaggi di integrazione più accurati e gli esempi più recenti, consultare la documentazione di CometAPI e il sito web. Documentazione del fornitore di modelli LobeChat e repo: i link indicati di seguito ti aiuteranno a continuare.