L'ultimo modello di ragionamento di OpenAI, o3-pro, rappresenta un significativo passo avanti in termini di prestazioni e capacità per le applicazioni basate sull'intelligenza artificiale. Lanciato all'inizio di giugno 2025, o3-pro offre a sviluppatori e aziende capacità di ragionamento avanzate, comprensione multimodale e utilizzo di strumenti, il tutto a un prezzo premium. Questo articolo sintetizza gli annunci più recenti, i report degli utenti e i dati di benchmark per fornire una panoramica completa delle prestazioni, dei costi e della disponibilità di o3-pro.

Che cosa è o3-pro?

L'ultima offerta di OpenAI, o3-pro, segna una pietra miliare significativa nei modelli di ragionamento AI, combinando funzionalità avanzate con un prezzo premium. Lanciato l'11 giugno 2025, o3-pro succede al modello o3 standard e sostituisce o1-pro nella gamma di prodotti OpenAI, rivolgendosi a sviluppatori e aziende che privilegiano l'analisi approfondita e l'affidabilità rispetto alla velocità pura. Basato sulla stessa architettura di o3, originariamente introdotto nell'aprile 2025, o3-pro integra ricerca web in tempo reale, analisi dei file, ragionamento visivo, esecuzione Python e funzionalità di memoria avanzate, per gestire flussi di lavoro complessi in ambito scientifico, di programmazione, aziendale e di scrittura. Tuttavia, l'approccio di ragionamento deliberato del modello comporta latenze più lunghe e un aumento sostanziale dei costi, riflettendo la sua progettazione ad alta intensità di calcolo.

Cosa distingue o3-pro dal modello o3 standard?

Ragionamento multimodale avanzato

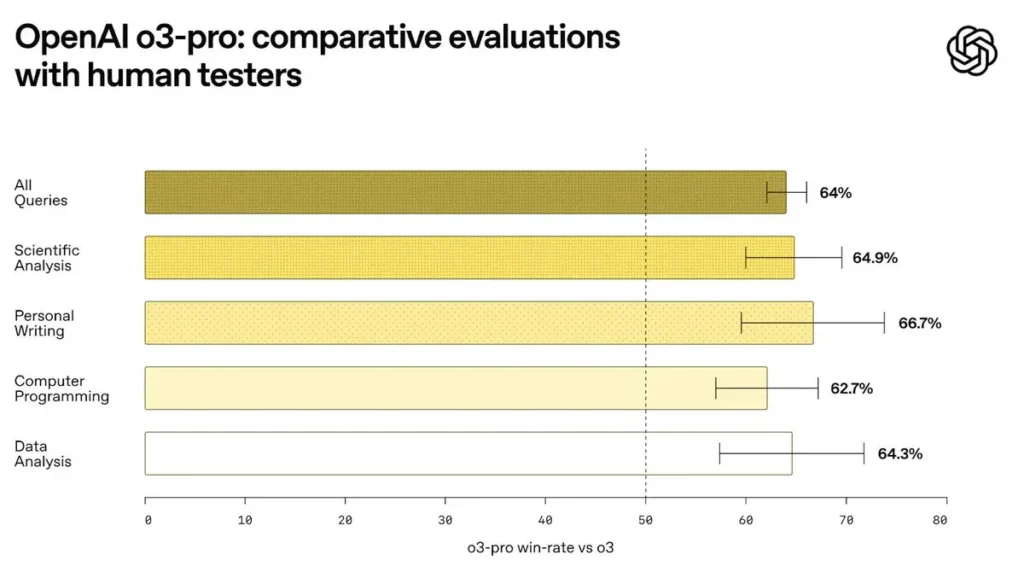

OpenAI ha rigorosamente valutato o3‑pro attraverso diverse valutazioni standard di intelligenza artificiale per convalidarne le capacità di ragionamento. In ambito matematico, o3‑pro supera Gemini 2.5 Pro di Google nel benchmark AIME 2024, dimostrando un ragionamento logico superiore e una risoluzione di equazioni complesse in condizioni temporizzate. Analogamente, nel benchmark GPQA Diamond, che misura la comprensione scientifica e la risoluzione di problemi a livello di dottorato, o3‑pro supera Claude 4 Opus di Anthropic, sottolineando la sua profondità nel ragionamento scientifico avanzato.

o3-pro si basa sui punti di forza del modello di punta o3 di OpenAI, integrando navigazione web in tempo reale, analisi dei file, comprensione visiva ed esecuzione Python al volo in un'unica interfaccia. Secondo OpenAI, questa capacità di ragionamento avanzata consente a o3-pro di affrontare attività complesse, come l'interpretazione di dati scientifici, il debug di codice esteso e la generazione di contenuti multimodali, con maggiore affidabilità rispetto al suo predecessore.

Affidabilità sulla latenza

Queste nuove funzionalità presentano dei compromessi: i tempi di risposta di o3-pro sono sensibilmente più lenti rispetto a o3, a causa dei passaggi di elaborazione e contesto aggiuntivi necessari per l'utilizzo avanzato dello strumento. I primi utilizzatori segnalano latenze tipiche pari a 1.5-2 volte quelle di o3 su prompt equivalenti, sebbene i valori precisi varino in base alla complessità della richiesta.

Limitazioni delle funzionalità al lancio

Al lancio, gli utenti di o3-pro hanno notato alcune limitazioni temporanee: la generazione di immagini rimane non disponibile e alcune funzionalità di ChatGPT, come le sessioni "Canvas" effimere e i thread di chat temporanei, sono disabilitate mentre OpenAI scala l'infrastruttura per il nuovo modello. Si prevede che queste limitazioni si attenueranno nei prossimi mesi con l'espansione della capacità.

Come si comporta o3‑pro nei benchmark di settore?

Test di ragionamento standardizzati

Nei test interni, o3-pro ha superato o3 con un margine notevole nelle suite di ragionamento standardizzate che includono matematica, puzzle logici e sfide di programmazione. I punteggi riportati dalla community attestano o3 a circa 2,517 punti, mentre o3-pro si avvicina a 2,748, con un miglioramento di circa il 9%.

Valutazioni di codifica nel mondo reale

Gli sviluppatori che eseguono attività di generazione e debug di codice in tempo reale hanno osservato che o3-pro produce output sintatticamente più corretti e semanticamente accurati in contesti single-shot e few-shot. I benchmark su repository di codice come CodeSearchNet mostrano un aumento del 5-7% nella correttezza funzionale rispetto a o3, in particolare su problemi di contesto lungo che superano i 4,000 token.

Prestazioni comparative rispetto ai concorrenti

Nei test comparativi, o3-pro non solo supera Gemini 2.5 Pro e Claude 4 Opus nei punteggi grezzi, ma fornisce anche output più coerenti nei test di stress avversari. Combinando la gestione degli input multimodale e l'uso dinamico degli strumenti, o3-pro riduce il divario con i modelli specializzati dei rivali come Google PaLM e Anthropic Claude X. I primi test comparativi indicano che o3-pro eguaglia o supera la precisione della concorrenza nei benchmark di ragionamento complesso, sebbene siano ancora in arrivo report completi di terze parti.

Quale struttura tariffaria dovrebbero aspettarsi gli sviluppatori?

Modello di fatturazione basato su token

OpenAI continua la sua fatturazione basata sui token: o3-pro costa 20 dollari per milione di token in input e 80 dollari per milione di token in output, esattamente dieci volte il costo del modello o3 standard dopo il recente taglio di prezzo. Al contrario, o3 ora costa 2 dollari per milione di token in input e 8 dollari per milione di token in output, dopo una riduzione di prezzo dell'80% all'inizio di giugno 2025.

| Modello | Inserisci il prezzo del token | Prezzo del token di output |

|---|---|---|

| o3 | $2 / 1 milione di token | $8 / 1 milione di token |

| o3‑pro | $20 / 1 milione di token | $80 / 1 milione di token |

Motivazione del premio

Questo aumento di prezzo di dieci volte riflette le risorse di elaborazione aggiuntive, l'infrastruttura ad alta produttività e l'integrazione di strumenti specializzati richiesti da o3-pro. OpenAI posiziona o3-pro come modello "mission-critical" per applicazioni in cui l'accuratezza e il ragionamento avanzato giustificano il sovrapprezzo.

Sconti sul volume e API batch

Le aziende che elaborano grandi volumi di token possono comunque sfruttare l'API Batch per risparmiare fino al 50% su input e output memorizzati nella cache. Sebbene questo meccanismo sia principalmente vantaggioso per gli utenti ad alto volume delle varianti GPT-4.1, si prevede che opzioni di batching simili saranno implementate per i modelli della serie O entro la fine del 2025.

Come possono sviluppatori e team accedere a o3-pro?

Disponibilità dell'API

Nei test comparativi, o3-pro non solo supera Gemini 2.5 Pro e Claude 4 Opus nei punteggi grezzi, ma offre anche risultati più costanti nei test di stress avversari.

OpenAI ha reso o3‑pro accessibile tramite la sua API pubblica il 10 giugno 2025, con supporto immediato sia per gli endpoint Completamenti che per quelli Chat. Gli sviluppatori possono specificare "o3-pro" modello nelle loro chiamate API, soggetto a limiti di frequenza e vincoli di quota legati al loro livello di abbonamento.

POST https://api.openai.com/v1/chat/completions

{

"model": "o3-pro",

"messages": ,

"max_tokens": 1500

}

Piani ChatGPT Pro e Team

Gli abbonati a ChatGPT Pro e Team hanno accesso diretto a o3-pro dall'interfaccia di ChatGPT. Gli utenti possono passare da o3 a o3-pro nel selettore del modello, sebbene la disponibilità iniziale sia limitata a un sottoinsieme di clienti aziendali e beta tester.

Tramite API CometAPI

Gli sviluppatori possono accedere API o3-Pro(modello: ”o3-Pro"o"o3-pro-2025-06-10") Attraverso CometaAPI, gli ultimi modelli elencati sono quelli aggiornati alla data di pubblicazione dell'articolo. Per iniziare, esplora le capacità del modello in Parco giochi e consultare il Guida API per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l'accesso a CometAPI e di aver ottenuto la chiave API. CometaAPI offrire un prezzo molto più basso rispetto al prezzo ufficiale per aiutarti a integrarti.

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.cometapi.com/v1",

api_key="<YOUR_API_KEY>",

)

response = client.chat.completions.create(

model="o3-Pro",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices.message.content

print(f"Assistant: {message}")

Quali sono i casi d'uso pratici che traggono i maggiori vantaggi da o3-pro?

Ricerca scientifica e analisi dei dati

I ricercatori che lavorano con grandi set di dati, che spaziano dalla genomica alle simulazioni climatiche, possono sfruttare le capacità di analisi dei file e di esecuzione Python di o3-pro per automatizzare i test delle ipotesi e generare informazioni senza vincoli di lunghezza del contesto.

Flussi di lavoro della conoscenza aziendale

In settori come la finanza e i servizi legali, dove precisione e verificabilità sono fondamentali, la maggiore aderenza alle istruzioni e il ragionamento multimodale di o3-pro riducono i tassi di errore nelle revisioni contrattuali, nella modellazione finanziaria e nelle attività di conformità normativa.

Sviluppo software e DevOps

Combinando la comprensione del codice a contesto lungo con test live tramite l'esecuzione di Python, o3-pro semplifica il debug e automatizza flussi di lavoro di refactoring complessi, accelerando i cicli di distribuzione per progetti software su larga scala.

Cosa dovrebbero considerare le organizzazioni prima di effettuare l'aggiornamento?

Analisi costi-benefici

I team devono valutare l'aumento di prezzo di 10 volte rispetto ai guadagni di efficienza previsti. Per attività di alto valore e basso volume, come la redazione di report strategici o la creazione di sistemi di sicurezza critici, la precisione e il supporto degli strumenti potrebbero giustificare il prezzo premium di o3-pro. Per la generazione di contenuti in grandi quantità, attenersi ai modelli standard o3 o o4-mini potrebbe essere più economico.

Preparazione dell'infrastruttura

Poiché o3-pro impone requisiti di latenza e produttività più elevati, le organizzazioni dovrebbero verificare i limiti di velocità delle API, la capacità di rete e le strategie di ripetizione degli errori per evitare colli di bottiglia durante i picchi di utilizzo.

In conclusione

Il modello o3-pro di OpenAI stabilisce un nuovo standard per il ragionamento avanzato, la comprensione multimodale e l'utilizzo di strumenti integrati nell'IA. I suoi miglioramenti nei benchmark e nell'affidabilità lo rendono un'opzione interessante per applicazioni mission-critical, a condizione che budget e infrastrutture siano in grado di supportare i costi elevati. Con l'evoluzione del panorama dell'IA, il ruolo di o3-pro si consoliderà nelle aree che richiedono i massimi livelli di accuratezza e profondità contestuale, mentre i carichi di lavoro più sensibili ai costi potranno continuare a sfruttare i modelli base della serie o o le varianti mini emergenti.