LobeChatとCometAPIは、オープンAIエコシステムにおいて急速に発展している2025つのプロジェクトです。XNUMX年XNUMX月、LobeChatはCometAPIプロバイダーの完全な統合を統合しました。これにより、LobeChatからCometAPIの統合されたOpenAI互換エンドポイントを簡単に呼び出すことができます。この記事では、LobeChatとCometAPIとは何か、なぜ統合するのか、段階的な統合と設定(すぐに使えるTypeScriptプロバイダーの基本設定を含む)、ランタイム例、具体的なユースケース、そしてコスト、信頼性、可観測性に関するプロダクションのヒントについて説明します。

LobeChat とは何ですか? また、どのような機能がありますか?

LobeChatは、洗練されたUIとデプロイメントツールを備え、マルチプロバイダーLLMチャットアプリケーションをホストするために設計された、オープンソースの最新チャットフレームワークです。マルチモーダル入力(テキスト、画像、音声)、ナレッジベース/RAGワークフロー、分岐型会話、思考の連鎖(Chain of Thought)可視化をサポートするように構築されています。さらに、拡張可能なプロバイダー/プラグインシステムを備えているため、アプリを再設計することなく、異なるモデルバックエンドを交換できます。LobeChatのドキュメントとリポジトリでは、環境駆動型の設定とサードパーティ製MCP(モデルコントロールプレーン)統合のためのマーケットプレイスを備え、セルフホスト型とクラウド型の両方のデプロイメントに対応した本番環境対応フレームワークとして紹介されています。

LobeChatの主な機能の概要

- マルチプロバイダーのサポート (OpenAI、Anthropic、Google Gemini、Ollama など)。

- RAG ワークフローのファイルアップロード + ナレッジ ベース (ドキュメント、PDF、オーディオ)。

- 環境変数と設定 URL のインポートによる開発者向けの構成。

- 拡張可能なランタイム: プロバイダーは小さなアダプター ランタイムで構成されているため、新しいバックエンドをプラグインできます。

CometAPI とは何ですか?

CometAPIは、OpenAI互換の単一のAPIサーフェスを通じて、多くの基盤プロバイダーが提供する500以上のモデルを公開する統合AIアクセスレイヤーです。開発者がパフォーマンス、コスト、機能に基づいてモデルエンドポイントをロックインなしに選択できるようにし、課金、ルーティング、アクセスを一元化します。CometAPIは、チャット/補完のための統合エンドポイントと、利用可能なモデルIDを見つけるためのモデルリストAPIを提供しています。

CometAPIがチームにとって魅力的な理由

- モデルの選択と移植性: 統合コードを大幅に変更することなく、多くの最先端モデルを切り替えることができます。

- OpenAI互換エンドポイント: OpenAIスタイルのHTTPエンドポイントを期待する多くのクライアントライブラリとフレームワークは、ベースURLと認証を変更することでCometAPIで動作することができます。(実際の例を示します。

https://api.cometapi.com/v1/OpenAI 互換のサーフェスとして。 - 開発者向けドキュメントと統合: CometAPI は、LlamaIndex などのツールやその他のローコード プラットフォームとの統合に関するドキュメントとステップバイステップ ガイドを公開しています。

CometAPI を LobeChat に統合する必要があるのはなぜですか?

短い答え: 柔軟性、コスト管理、新しいモデルへの迅速なアクセスLobeChatはプロバイダに依存しない設計になっています。CometAPIをプラグインすることで、LobeChatのデプロイメントで同じコードパスから様々なモデルを呼び出すことができるようになります。つまり、UIやプロンプトフローを変更することなく、スループット、レイテンシ、コスト、機能などに応じてモデルを切り替えることができます。また、コミュニティとメンテナーはLobeChatにCometAPIプロバイダのサポートを積極的に追加しており、統合がよりスムーズになっています。

ビジネスと技術のメリット

- コードの変更なしでモデルの多様性を実現します。 Gemini、Claude、あるいはニッチな画像モデルを評価する必要がありますか?CometAPIは、これらのモデルIDを単一のAPIで公開できます。これにより、LobeChatにおけるプロバイダごとの設定作業が軽減されます。

- コストの最適化。 CometAPI を使用すると、より安価なモデルにルーティングしたり、低コストのプロバイダーを動的に選択したりできるため、大規模な展開における会話ごとのコストを大幅に削減できます。

- よりシンプルな秘密管理。 複数のプロバイダーキーの代わりに、LobeChatの設定またはDocker環境で管理する1つのAPIキー。LobeChatプラットフォームは、プロバイダーの有効化を既にサポートしています。

ENABLED_<PROVIDER>プロバイダー キー env var パターンも含まれているため、統合は操作的に一貫しています。 - LobeChat のコードベースを最小限に抑えます。プロバイダー ロジックはカプセル化され、env 変数を使用して構成されます。

LobeChat で CometAPI を設定して統合するにはどうすればよいですか?

このセクションでは、実用的な手順をステップバイステップで説明します。キーの取得、環境変数の設定、プロバイダーをLobeChatに追加(プロバイダー設定例)、ランタイムでの使用状況の表示(チャット呼び出し)などです。これらの例は、LobeChatのプロバイダーパターンとCometAPI OpenAI互換エンドポイントに準拠しています。

1) CometAPIアカウントとAPIキーを取得する

CometAPI にサインアップし、API コンソールを開いてください。CometAPI アカウントを登録するには、メールアドレスを使用するか、Google One-Click で直接ログインする必要があります。

登録が完了したら、プレイグラウンドに移動し、「新しい秘密キーを追加」をクリックして新しい API キーを作成します。

API キーを取得します。

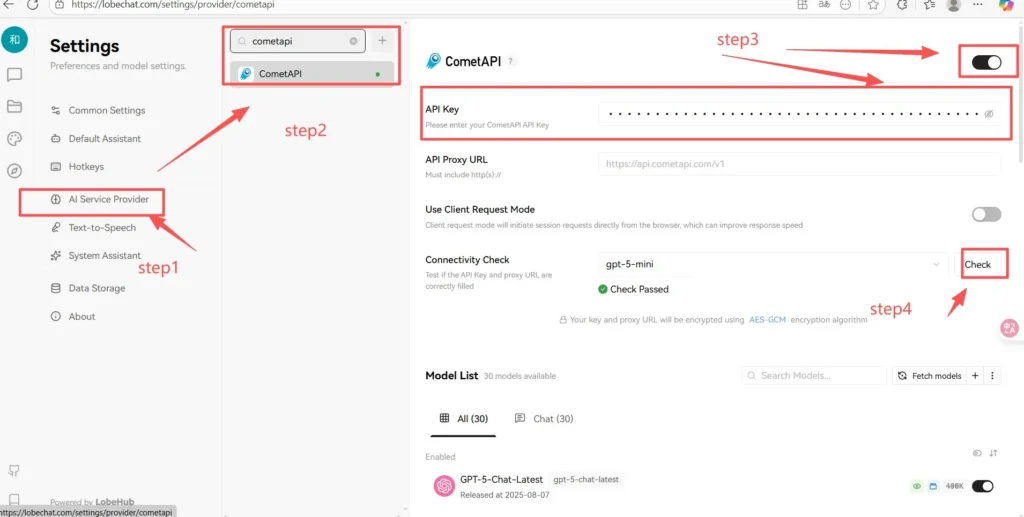

2) LobeChatでCometAPIを設定する

- Lobe-Chat 設定メニューに入り、アバターをクリックして、アプリケーション設定オプションをクリックします。

- モデルプロバイダーとして cometapi を選択します。

- APIキー入力ボックスにcometapiのsk-xxxxxを貼り付けてボタンをオンにし、チェックするモデルを1つ選択します。

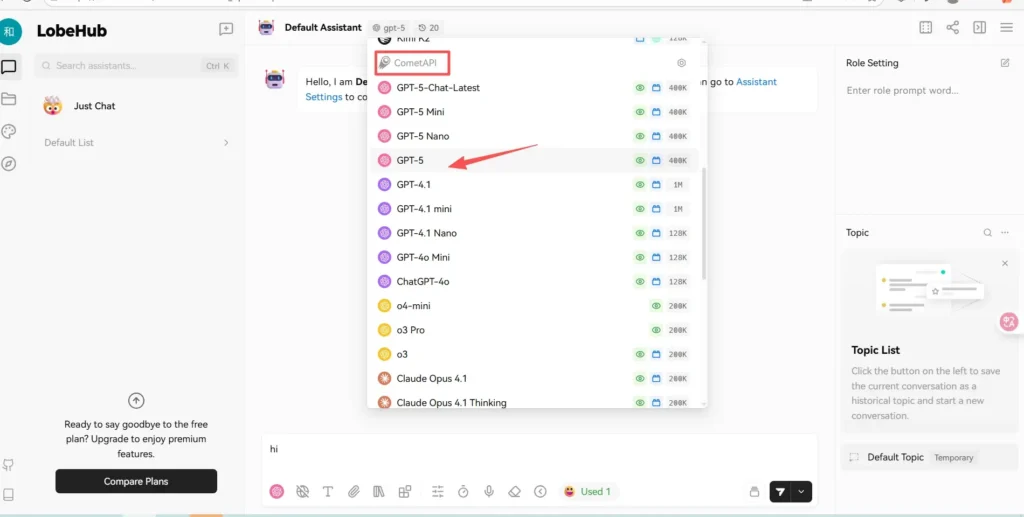

3) 通話のテスト

CometAPIのモデルを1つ選択し、Lobe-Chatで簡単なテストコマンドを入力してください。通話が成功した場合は、対応する応答が返されます。失敗した場合は、設定が正しいか確認するか、CometAPIのオンラインカスタマーサービスにお問い合わせください。

現在、cometapi は lobechat 上で主要な開発者 (openAI、grok、claude、gemini) の最新モデルを 30 以上提供しています。

統合を拡張するにはどうすればよいですか (高度な機能強化)?

基本をさらに進めたいですか?統合を機能レベルから本番レベルにまで引き上げる確実な次のステップをご紹介します。

機能強化1: 動的モデルオーケストレーション(マルチモデルエージェント)

LobeChat にエージェントロジックを作成し、サブタスクを異なる Comet モデル(例:検索用の小規模埋め込みモデル、下書き用の中規模モデル、要約用の高機能モデル)に動的に割り当てます。LobeChat の関数呼び出し/プラグインシステムを使用して、ワークフローを調整し、最終的な回答を集約します。

機能強化2: 埋め込みとレスポンスのキャッシュ

RAG用の埋め込みを使用する場合は、埋め込みを一度計算してキャッシュすることでオーバーヘッドを削減します。埋め込みのためにCometAPIを呼び出す場合は、ベクター表現をベクターDBに保存し、コンテンツが変更された場合にのみ再計算します。これにより、トークンとコストを削減できます。

機能強化3: テナントごとの構成とクォータ

マルチテナントのLobeChatインスタンスを実行する場合は、テナントIDと許可されたモデルリスト(CometAPIモデルIDを使用)をマッピングするミドルウェアを作成することで、テナントごとの制限(リクエスト数/時間、モデル階層)を制御できます。これにより、より優れたモデルにアクセスできるプレミアム階層が有効になります。

機能強化4: モデルメタデータとヘルスチェックを使用する

プロバイダーのヘルスチェックを実装し、軽量なCometAPI「モデルping」または最小限のチャットコールを呼び出すことで、レイテンシがSLAの範囲内であることを確認します。そうでない場合は、フォールバックモデルに切り替えます。ハートビートモニターを維持し、プロバイダーのステータスをLobeChat管理UIに表示します。

どのような落とし穴に注意すべきでしょうか?

- APIキーの公開: CometAPIキーをクライアントコードに保存しないでください。常にサーバー側(LobeChatのサーバー層)に保存してください。

- モデル名ドリフトCometAPIはモデルIDを追加または廃止する可能性があります。サーバーマッピングを使用して更新してください。

COMETAPI_MODEL_LIST新しいモデルを公開したいとき。 - 応答形式の違い: CometAPI は OpenAI との互換性を目指していますが、一部のモデルまたはメタ フィールドは異なる場合があります。ユーザーに表示する前に、必ず応答をマッピングしてサニタイズしてください。

スタートガイド

CometAPIは、OpenAIのGPTシリーズ、GoogleのGemini、AnthropicのClaude、Midjourney、Sunoなど、主要プロバイダーの500以上のAIモデルを、開発者にとって使いやすい単一のインターフェースに統合する統合APIプラットフォームです。一貫した認証、リクエストフォーマット、レスポンス処理を提供することで、CometAPIはAI機能をアプリケーションに統合することを劇的に簡素化します。チャットボット、画像ジェネレーター、音楽作曲ツール、データドリブン分析パイプラインなど、どのようなアプリケーションを構築する場合でも、CometAPIを利用することで、反復処理を高速化し、コストを抑え、ベンダーに依存しない環境を実現できます。同時に、AIエコシステム全体の最新のブレークスルーを活用できます。

まず、モデルの機能を調べてみましょう。 プレイグラウンド そして相談する APIガイド 詳細な手順についてはこちらをご覧ください。アクセスする前に、CometAPIにログインし、APIキーを取得していることを確認してください。 コメットAPI 統合を支援するために、公式価格よりもはるかに低い価格を提供します。

準備はいいですか?→ 今すぐCometAPIに登録しましょう !

結論

CometAPIをLobeChatに統合することは、LobeChatが提供する洗練されたUXとRAG機能を維持しながら、モデルの多様性、コストの柔軟性、迅速な実験能力を獲得するための実用的な方法です。LobeChatコミュニティは既にCometAPIサポート(プロバイダーカード、モデルリスト、ランタイムアダプター、テスト、ドキュメント)の追加に向けて大きな努力を払っており、これらを直接活用することも、特殊なニーズに合わせてカスタムアダプターを実装するためのヒントとして活用することもできます。最も正確な統合手順と最新の例については、CometAPIのドキュメントと LobeChat モデルプロバイダーのドキュメント およびリポジトリ - 下記のリンクが続行に役立ちます。