OpenAIの最新推論モデルであるo3-proは、AI駆動型アプリケーションのパフォーマンスと機能を大幅に向上させます。2025年3月初旬にリリースされるo3-proは、開発者や企業に高度な推論、マルチモーダル理解、そしてツール活用を、プレミアム価格で提供します。この記事では、最新の発表、ユーザーレポート、ベンチマークデータを統合し、oXNUMX-proのパフォーマンス、コストに関する考慮事項、そして可用性に関する包括的な概要を提供します。

o3-proとは何ですか?

OpenAIの最新製品であるo3-proは、強化された機能とプレミアム価格を組み合わせることで、AI推論モデルにおける重要なマイルストーンをマークします。11年2025月3日に発売されたo3-proは、標準のo1モデルの後継であり、OpenAIの製品ラインナップにおいてo3-proに取って代わり、純粋な速度よりも詳細な分析と信頼性を優先する開発者や企業を対象としています。2025年3月に最初に導入されたoXNUMXと同じ基盤アーキテクチャ上に構築されたoXNUMX-proは、リアルタイムWeb検索、ファイル分析、視覚的推論、Python実行、高度なメモリ機能を統合し、科学、プログラミング、ビジネス、執筆における複雑なワークフローに対応します。ただし、このモデルの意図的な推論アプローチは、そのコンピューティング集約型設計を反映して、レイテンシの延長と大幅なコスト増加を招きます。

o3-pro と標準の o3 モデルの違いは何ですか?

高度なマルチモーダル推論

OpenAIは、o3-proの推論能力を検証するため、複数の標準的なAI評価基準においてo3-proを厳密に評価しました。数学分野では、o2.5-proはAIME 2024ベンチマークにおいてGoogleのGemini 3 Proを上回り、制限時間内での優れた論理的推論能力と複雑な方程式の解法を示しました。同様に、博士レベルの科学的理解と問題解決能力を測定するGPQA Diamondベンチマークにおいても、o4-proはAnthropicのClaude XNUMX Opusを上回り、高度な科学的推論能力の高さを際立たせています。

o3-proは、OpenAIの主力モデルであるo3の強みを基盤とし、リアルタイムのウェブブラウジング、ファイル分析、視覚的理解、そしてオンザフライのPython実行を単一のインターフェースに統合しています。OpenAIによると、この強化された推論能力により、o3-proは科学的データの解釈、長文コードのデバッグ、マルチモーダルコンテンツ生成といった複雑なタスクを、従来モデルよりも高い信頼性で実行できるようになります。

遅延よりも信頼性

これらの新機能にはトレードオフが伴います。o3-proの応答時間はo3よりも明らかに遅く、これは高度なツールの使用に必要な追加の計算処理とコンテキスト処理のステップを反映しています。早期導入者によると、同等のプロンプトに対する典型的なレイテンシはo1.5の2~3倍ですが、正確な数値はリクエストの複雑さによって異なります。

リリース時の機能制限

o3-proのリリース当初、ユーザーはいくつかの一時的な制限に気付きました。画像生成は引き続き利用できず、OpenAIが新モデル向けのインフラを拡張している間は、ChatGPTの一部の機能(一時的な「Canvas」セッションや一時的なチャットスレッドなど)が無効になっています。これらの制限は、今後数か月で容量が拡大するにつれて緩和される予定です。

o3-pro は業界ベンチマークでどのように機能しますか?

標準化推論テスト

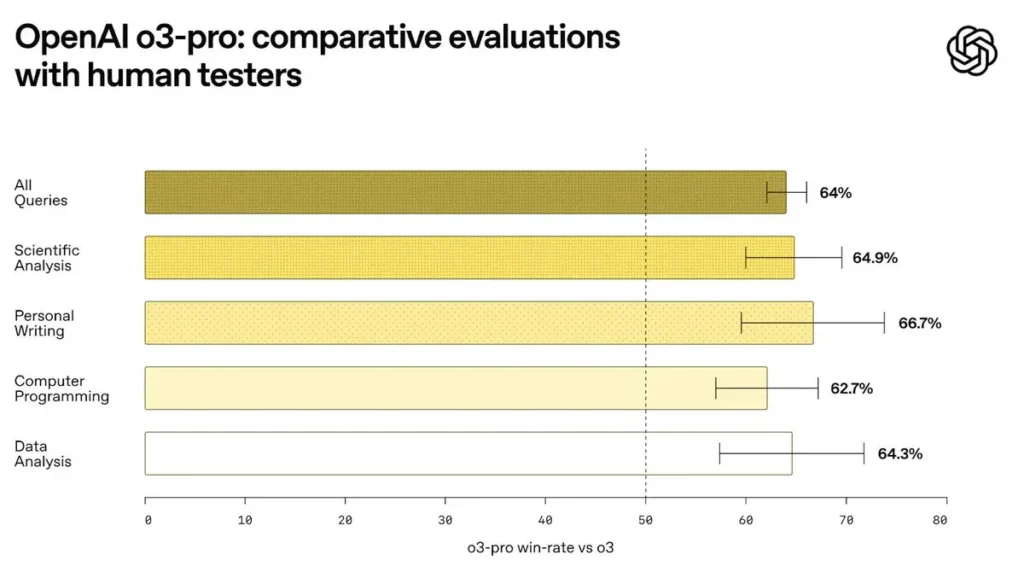

社内テストでは、o3-proは数学、論理パズル、プログラミング課題を含む標準化された推論スイートにおいて、o3を大幅に上回りました。コミュニティから報告されたスコアでは、o3は約2,517ポイント、o3-proは約2,748ポイントで、約9%の向上が見られました。

実世界コーディング評価

ライブコード生成およびデバッグタスクを実行している開発者は、o3-pro がシングルショットおよび少数ショットの設定において、より構文的に正確で意味的に正確な出力を生成することを観察しています。CodeSearchNet などのコーディングリポジトリのベンチマークでは、特に5トークンを超えるロングコンテキスト問題において、o7 と比較して機能的正確性が3~4,000%向上することが示されています。

競合他社との比較パフォーマンス

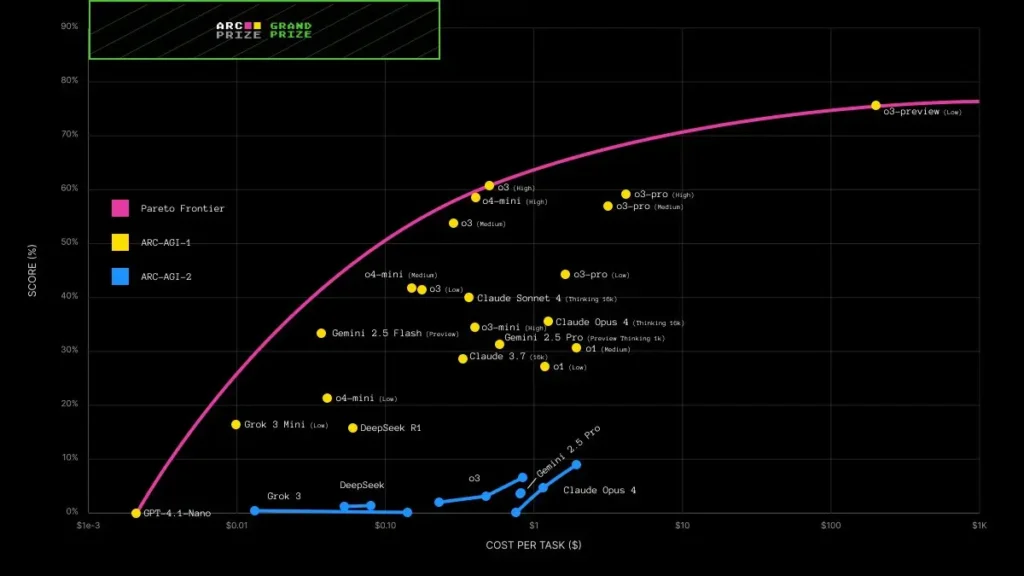

直接対決テストでは、o3-pro は生のスコアで Gemini 2.5 Pro や Claude 4 Opus に勝っているだけでなく、敵対的ストレステストでもより一貫性のある出力を実現しています。 マルチモーダル入力処理と動的なツールの使用を組み合わせることで、o3-pro は Google PaLM や Anthropic Claude X などのライバルの特殊モデルとの差を縮めています。 初期の直接対決テストでは、o3-pro が複雑な推論ベンチマークで競合他社の精度に匹敵するか上回っていることが示されていますが、包括的なサードパーティレポートはまだ発表されていません。

開発者はどのような価格体系を期待すべきでしょうか?

トークンベースの課金モデル

OpenAIはトークンベースの課金を継続しています。o3-proの料金は、入力トークン20万個あたり80ドル、出力トークン3万個あたり3ドルです。これは、最近の値下げ後の標準o2モデルのちょうど8倍の料金です。一方、o80は2025年XNUMX月初旬にXNUMX%の値下げが行われ、現在は入力トークンXNUMX万個あたりXNUMXドル、出力トークンXNUMX万個あたりXNUMXドルとなっています。

| モデル | 入力トークン価格 | 出力トークン価格 |

|---|---|---|

| o3 | $2 / 1万トークン | $8 / 1万トークン |

| o3プロ | $20 / 1万トークン | $80 / 1万トークン |

プレミアムの根拠

この3倍の価格上昇は、o3-proが要求する追加のコンピューティングリソース、高スループットのインフラストラクチャ、そして特殊なツール統合を反映しています。OpenAIは、oXNUMX-proを、精度と高度な推論が価格プレミアムを正当化するアプリケーション向けの「ミッションクリティカル」モデルと位置付けています。

ボリューム割引とバッチAPI

大量のトークンを処理する企業は、Batch APIを活用することで、キャッシュされた入出力を最大50%削減できます。このメカニズムは主にGPT-4.1バリアントの大量ユーザーにメリットをもたらしますが、同様のバッチ処理オプションは2025年後半にOシリーズモデルにも展開される予定です。

開発者やチームはどのように o3-pro にアクセスできますか?

API の可用性

直接比較テストでは、o3-pro は生のスコアで Gemini 2.5 Pro や Claude 4 Opus に勝るだけでなく、敵対的ストレステストでもより一貫した出力を実現します。

OpenAIは3年10月2025日にoXNUMX-proをパブリックAPI経由で利用可能にし、補完とチャットのエンドポイントの両方で即時サポートを開始しました。開発者は "o3-pro" API 呼び出しでモデルを使用することはできませんが、サブスクリプション レベルに関連付けられたレート制限とクォータ制約が適用されます。

POST https://api.openai.com/v1/chat/completions

{

"model": "o3-pro",

"messages": ,

"max_tokens": 1500

}

ChatGPTプロ&チームプラン

ChatGPT ProおよびTeamのサブスクリプションメンバーは、ChatGPTインターフェース内でo3-proに直接アクセスできます。モデルセレクターでo3とo3-proを切り替えることができますが、当初の提供は一部のエンタープライズ顧客とベータテスターに限定されます。

CometAPI API経由

開発者はアクセスできる o3-Pro API(モデル: "o3-Pro"または"o3-pro-2025-06-10") を通して コメットAPI掲載されている最新モデルは、記事公開日時点のものです。まずは、モデルの機能をご確認ください。 プレイグラウンド そして相談する APIガイド 詳細な手順についてはこちらをご覧ください。アクセスする前に、CometAPIにログインし、APIキーを取得していることを確認してください。 コメットAPI 統合を支援するために、公式価格よりもはるかに低い価格を提供します。

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.cometapi.com/v1",

api_key="<YOUR_API_KEY>",

)

response = client.chat.completions.create(

model="o3-Pro",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices.message.content

print(f"Assistant: {message}")

o3-pro から最も恩恵を受ける実際の使用例は何ですか?

科学研究とデータ分析

ゲノミクスから気候シミュレーションに至るまで、大規模なデータセットを扱う研究者は、o3-pro のファイル分析と Python 実行機能を活用して、仮説検定を自動化し、コンテキストの長さの制約なしに洞察を生み出すことができます。

エンタープライズナレッジワークフロー

金融や法律サービスなど、精度と監査可能性が最も重要となる分野では、o3-pro の改善された指示遵守とマルチモーダル推論により、契約レビュー、財務モデリング、規制遵守タスクにおけるエラー率が低減します。

ソフトウェア開発とDevOps

o3-pro は、ロングコンテキスト コードの理解と Python 実行によるライブ テストを組み合わせることで、デバッグを効率化し、複雑なリファクタリング ワークフローを自動化し、大規模なソフトウェア プロジェクトの配信サイクルを加速します。

組織はアップグレード前に何を考慮すべきでしょうか?

費用便益分析

チームは、10倍の価格上昇と予想される効率性の向上を比較検討する必要があります。戦略レポートの作成や重要な安全システムの構築など、高価値で低ボリュームのタスクの場合、精度とツールサポートがo3-proのプレミアム価格を正当化する可能性があります。大量のコンテンツ生成には、標準のo3またはo4-miniモデルを使用する方が経済的かもしれません。

インフラの準備

o3-pro はより高いレイテンシとスループットの要求を課すため、組織はピーク使用時のボトルネックを回避するために、API レート制限、ネットワーク容量、およびエラー再試行戦略を監査する必要があります。

結論として

OpenAIのo3-proモデルは、AIにおける高度な推論、マルチモーダル理解、そして統合ツール利用の新たな基準を打ち立てます。ベンチマークにおける向上と信頼性の向上により、予算とインフラがコスト増に対応できるのであれば、ミッションクリティカルなアプリケーションにとって魅力的な選択肢となります。AI環境が進化するにつれ、o3-proは最高レベルの精度とコンテキストの深度が求められる分野で確固たる役割を担うようになるでしょう。一方で、よりコスト重視のワークロードでは、oシリーズのベースモデルや新たに登場したミニバリアントモデルが引き続き活用される可能性があります。