17年2025月1日、上海に拠点を置くAIリーダー企業MiniMax(別名Xiyu Technology)は、世界初のオープンウェイト、大規模、ハイブリッドアテンション推論モデルであるMiniMax-M1(以下「M1」)を正式にリリースしました。Mixture-of-Experts(MoE)アーキテクチャと革新的なLightning Attentionメカニズムを組み合わせたM1は、生産性重視のタスクにおいて業界をリードするパフォーマンスを実現し、トップクラスのクローズドソースシステムに匹敵しながらも、比類のないコスト効率を維持しています。本稿では、MXNUMXとは何か、その仕組み、特徴、そしてモデルへのアクセスと使用に関する実践的なガイダンスを詳細に解説します。

MiniMax-M1とは何ですか?

MiniMax-M1は、スケーラブルで効率的なアテンションメカニズムに関するMiniMaxAIの研究の集大成です。MiniMax-Text-01を基盤として、M1イテレーションはライトニングアテンションとMoEフレームワークを統合し、学習と推論の両方でかつてない効率性を実現しています。この組み合わせにより、モデルは非常に長いシーケンスを処理する場合でも高いパフォーマンスを維持できます。これは、大規模なコードベース、法務文書、科学文献を扱うタスクにとって重要な要件です。

コアアーキテクチャとパラメータ化

MiniMax-M1の中核は、ハイブリッドMoEシステムを活用し、エキスパートサブネットワークのサブセットを介してトークンを動的にルーティングします。このモデルは合計456億個のパラメータで構成されていますが、各トークンに対して有効になるのは45.9億個のみで、リソース使用を最適化します。この設計は、以前のMoE実装から着想を得ていますが、ルーティングロジックを改良することで、分散推論中のGPU間の通信オーバーヘッドを最小限に抑えています。

ライトニングアテンションとロングコンテキストサポート

MiniMax-M1の特徴的な特徴は、長いシーケンスにおける自己注意の計算負荷を大幅に軽減するライトニングアテンションメカニズムです。ローカルカーネルとグローバルカーネルの組み合わせで注意行列を近似することで、このモデルは75万トークンのシーケンスを処理する際に、従来のトランスフォーマーと比較してFLOPを最大100%削減します。この効率性は推論を高速化するだけでなく、ハードウェア要件を過度に高くすることなく、最大XNUMX万トークンのコンテキストウィンドウを処理できるようになります。

MiniMax-M1 はどのようにして計算効率を実現するのでしょうか?

MiniMax-M1の効率性向上は、XNUMXつの主要なイノベーション、すなわちハイブリッドMixture-of-Expertsアーキテクチャと、学習中に使用される革新的なCISPO強化学習アルゴリズムによって実現されています。これらの要素を組み合わせることで、学習時間と推論コストの両方が削減され、迅速な実験と展開が可能になります。

ハイブリッド専門家混合ルーティング

MoEコンポーネントは32個のエキスパートサブネットワークを採用しており、それぞれが推論の異なる側面またはドメイン固有のタスクに特化しています。推論中は、学習済みのゲーティングメカニズムが各トークンに最も関連性の高いエキスパートを動的に選択し、入力処理に必要なサブネットワークのみをアクティブ化します。この選択的なアクティブ化により、冗長な計算が削減され、メモリ帯域幅の要件が軽減されるため、MiniMax-M1はモノリシックなトランスフォーマーモデルと比較してコスト効率において大きな優位性を獲得しています。

CISPO: 新しい強化学習アルゴリズム

MiniMaxAIは、学習効率をさらに高めるため、トークンレベルの重み更新を重要度サンプリングベースのクリッピングに置き換えるRLアルゴリズム、CISPO(Clipped Importance Sampling with Partial Overrides)を開発しました。CISPOは、大規模なRL環境でよく見られる重み爆発の問題を軽減し、収束を加速し、多様なベンチマークにおいて安定したポリシー改善を実現します。その結果、MiniMax-M1の512個のH800 GPUを用いた完全なRL学習はわずか534,700週間で完了し、費用は約4ドルに抑えられました。これは、同等のGPT-XNUMX学習実行で報告されている費用のほんの一部です。

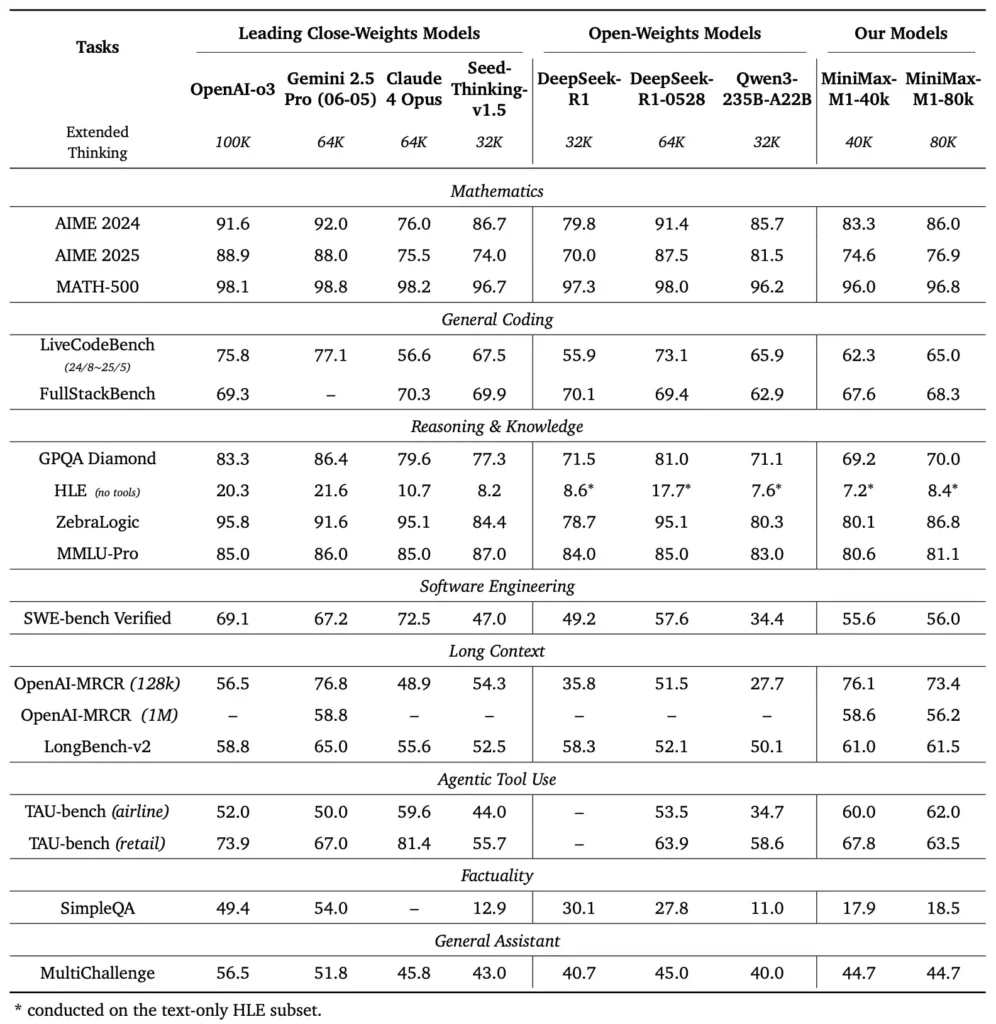

MiniMax-M1 のパフォーマンスベンチマークは何ですか?

MiniMax-M1 は、さまざまな標準およびドメイン固有のベンチマークで優れており、長期コンテキスト推論、数学的問題解決、コード生成の処理能力に優れています。

長文推論課題

MiniMax-M1は、広範な文書理解テストにおいて、最大1,000,000万トークンのコンテキストウィンドウを処理し、最大コンテキスト長においてDeepSeek-R1の100倍の性能を発揮し、XNUMX万トークンのシーケンスに対する計算要件を半分に削減しました。NarrativeQA拡張コンテキスト評価などのベンチマークでは、このモデルは最先端の理解スコアを達成しており、これは、ローカルおよびグローバルな依存関係を効率的に捕捉するライトニングアテンションの能力によるものです。

ソフトウェアエンジニアリングとツールの活用

MiniMax-M1は、大規模強化学習を用いたサンドボックス化されたソフトウェアエンジニアリング環境で特別にトレーニングされており、驚異的な精度でコードを生成・デバッグすることができます。HumanEvalやMBPPなどのコーディングベンチマークにおいて、このモデルはQwen3-235BやDeepSeek-R1と同等かそれ以上の合格率を達成しており、特に複数ファイルのコードベースや長いコードセグメントの相互参照を必要とするタスクにおいて顕著です。さらに、MiniMaxAIの初期デモでは、CI/CDパイプラインの生成から自動ドキュメント作成ワークフローまで、開発ツールとの統合能力が実証されています。

開発者はどのようにして MiniMax-M1 にアクセスできますか?

MiniMaxAIは、幅広い普及を促進するため、MiniMax-M1をオープンウェイトモデルとして無料で公開しました。開発者は、公式GitHubリポジトリから、事前学習済みのチェックポイント、モデルの重み、推論コードにアクセスできます。

GitHubでのオープンウェイトリリース

MiniMaxAIは、MiniMax-M1のモデルファイルと付属スクリプトを、GitHub上で寛容なオープンソースライセンスの下で公開しました。興味のあるユーザーは、https://github.com/MiniMax-AI/MiniMax-M1 でリポジトリをクローンできます。このリポジトリには、40Kトークンバジェットと80Kトークンバジェットの両方のチェックポイントに加え、PyTorchやTensorFlowなどの一般的なMLフレームワークの統合例も含まれています。

APIエンドポイントとクラウド統合

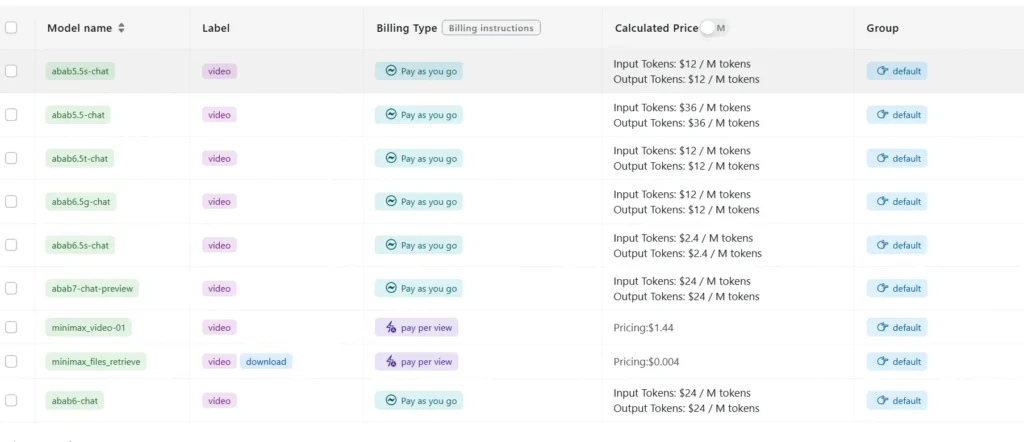

MiniMaxAIは、ローカルデプロイメントに加え、主要なクラウドプロバイダーと提携してマネージドAPIサービスを提供しています。これらの提携を通じて、開発者はRESTfulエンドポイント経由でMiniMax-M1を呼び出すことができ、Python、JavaScript、Java向けのSDKも利用可能です。APIには、コンテキスト長、エキスパートルーティングのしきい値、トークンバジェットなどの設定可能なパラメータが含まれており、ユーザーはコンピューティング消費量をリアルタイムで監視しながら、ユースケースに合わせてパフォーマンスを調整できます。

MiniMax-M1 を実際のアプリケーションに統合して使用するにはどうすればよいですか?

MiniMax-M1 の機能を活用するには、API パターン、ロングコンテキスト プロンプトのベスト プラクティス、ツール オーケストレーションの戦略を理解する必要があります。

基本的なAPIの使用例

典型的なAPI呼び出しでは、入力テキストとオプションの設定オーバーライドを含むJSONペイロードを送信します。例えば、

POST /v1/minimax-m1/generate

{

"input": "Analyze the following 500K token legal document and summarize the key obligations:",

"max_output_tokens": 1024,

"context_window": 500000,

"expert_threshold": 0.6

}

レスポンスでは、生成されたテキスト、トークンの使用統計、ルーティング ログを含む構造化された JSON が返され、エキスパートのアクティベーションをきめ細かく監視できるようになります。

ツールの使用とMiniMaxエージェント

MiniMaxAIは、コアモデルに加え、コード実行環境からウェブスクレイパーに至るまで、外部ツールを内部的に呼び出すことができるベータ版エージェントフレームワーク、MiniMax Agentを導入しました。開発者は、モデル推論とツール呼び出しを連携させるエージェントセッションをインスタンス化することで、例えばリアルタイムデータの取得、計算の実行、データベースの更新などを行うことができます。このエージェントパラダイムは、エンドツーエンドのアプリケーション開発を簡素化し、MiniMax-M1を複雑なワークフローにおけるオーケストレーターとして機能させることを可能にします。

ベストプラクティスと落とし穴

- 長いコンテキストのための迅速なエンジニアリング入力を首尾一貫したセグメントに分割し、論理的な間隔で要約を埋め込み、「要約してから推論する」戦略を活用してモデルの焦点を維持します。

- コンピューティングとパフォーマンスのトレードオフ: レイテンシに敏感なアプリケーションの場合は、エキスパートしきい値を下げたり、思考予算を減らしたりして実験します (例: 40K バリアント)。

- 監視とガバナンス: ルーティング ログとトークン統計を使用して、専門家の使用状況を監査し、特に実稼働環境でコスト予算に準拠していることを確認します。

これらのガイドラインに従うことで、開発者は、大規模なモデルの展開に関連するリスクを軽減しながら、MiniMax-M1 の強み (広範なコンテキスト処理と効率的な推論) を活用できます。

MiniMax-M1はどのように使用しますか?

インストールが完了すると、M1 はシンプルな Python スクリプトまたはインタラクティブなノートブックから呼び出すことができます。

基本的な推論スクリプトはどのようなものですか?

from minimax_m1 import MiniMaxM1Tokenizer, MiniMaxM1ForCausalLM

tokenizer = MiniMaxM1Tokenizer.from_pretrained("MiniMax-AI/MiniMax-M1-40k")

model = MiniMaxM1ForCausalLM.from_pretrained("MiniMax-AI/MiniMax-M1-40k")

inputs = tokenizer("Translate the following paragraph to French: ...", return_tensors="pt")

outputs = model.generate(**inputs, max_new_tokens=200)

print(tokenizer.decode(outputs))

このサンプルは40k予算バリアントを呼び出します。 "MiniMax-AI/MiniMax-M1-80k" 80kの推論予算を完全に解除します()。

非常に長いコンテキストをどのように処理しますか?

通常のバッファサイズを超える入力に対して、M1はストリーミングトークン化をサポートします。 stream=True トークナイザーにフラグを設定してトークンをチャンクで供給し、チェックポイント再開推論を活用して 100 万トークンのシーケンスにわたってパフォーマンスを維持します。

M1 を微調整または適応するにはどうすればよいでしょうか?

基本チェックポイントはほとんどのタスクに十分ですが、研究者はリポジトリに含まれるCISPOコードを使用してRLの微調整を行うことができます。コードの正確性から意味の忠実度に至るまで、カスタム報酬関数を提供することで、実践者はM1をドメイン固有のワークフローに適応させることができます。

結論

MiniMax-M1は、長コンテキスト言語理解と推論の限界を押し広げる画期的なAIモデルとして際立っています。ハイブリッドMoEアーキテクチャ、ライトニングアテンションメカニズム、そしてCISPO認定の学習計画を備えたこのモデルは、法務分析からソフトウェアエンジニアリングまで、幅広いタスクで高いパフォーマンスを発揮すると同時に、計算コストを大幅に削減します。オープンウェイトリリースとクラウドAPIの提供により、MiniMax-M1は、次世代AI搭載アプリケーションの構築に意欲的な幅広い開発者や組織に利用可能です。AIコミュニティが大規模コンテキストモデルの可能性を探求し続ける中、MiniMax-M1のイノベーションは、業界全体の将来の研究と製品開発に影響を与える可能性を秘めています。

スタートガイド

CometAPIは、ChatGPTファミリーを含む数百のAIモデルを一貫したエンドポイントに集約する統合RESTインターフェースを提供します。APIキー管理、使用量制限、課金ダッシュボードが組み込まれているため、複数のベンダーURLと認証情報を管理する手間が省けます。

まず、モデルの機能を調べてみましょう。 プレイグラウンド そして相談する APIガイド 詳細な手順についてはこちらをご覧ください。アクセスする前に、CometAPIにログインし、APIキーを取得していることを確認してください。

最新の統合MiniMax-M1 APIはまもなくCometAPIに登場しますので、お楽しみに!MiniMax-M1モデルのアップロードが完了するまで、他のモデルもご覧ください。 モデルページ または、 AI プレイグラウンドMiniMaxのCometAPIの最新モデルは Minimax ABAB7 プレビュー API および ミニマックスビデオ-01 API 参照: