Mistral 3 — Mistral AI-дің 2025 жылдың соңындағы модельдер отбасының басты релизі. Ол жергілікті/edge орналастыруға бағытталған ықшам, жылдам модельдердің қоспасын және ауқым мен контекст ұзындығының ең озық деңгейін жылжытатын өте үлкен сиретілген флагманды ұсынады. Бұл мақалада Mistral 3 деген не, ол қалай жасалған, оны неге жергілікті іске қосқыңыз келуі мүмкін және оны компьютеріңізде немесе жеке серверіңізде іске қосудың үш практикалық тәсілі түсіндіріледі — Ollama-ның “бір рет басып іске қосу” ыңғайынан бастап vLLM/TGI арқылы өндірістік GPU сервингке дейін, GGUF + llama.cpp көмегімен шағын құрылғыларда CPU инференсіне дейін.

Mistral 3 деген не?

Mistral 3 — Mistral AI-ден шыққан ашық салмақты модельдердің жаңа буыны. Бұл отбасы өте ірі Mistral Large 3 (сиретілген Mixture-of-Experts — MoE — моделі) мен нұсқаулыққа бапталған және мультимодалды (мәтін+көрініс) тапсырмаларға лайықталған бірнеше edge/“Ministral” нұсқаларын (3B, 8B, 14B) қамтиды. Mistral бұл релизді кең ауқымды қолдануға бағыттады: деректер орталығында жоғары өнімді инференс (арнайы оңтайландырылған чекпойнттармен) мүмкіндігінен бастап, квантталған форматтар және шағын нұсқалар арқылы edge пен ноутбуктерде пайдалануға дейін.

Негізгі практикалық қасиеттері:

- Large 3 нұсқасындағы Mixture-of-Experts (MoE) архитектурасы: жалпы параметрлер саны өте үлкен, бірақ әр токен үшін сарапшылардың тек бір бөлігі ғана іске қосылады — бұл ауқымда тиімділікті арттырады.

- Ministral 3 модельдер отбасы (3B / 8B / 14B) edge және жергілікті пайдалану үшін, нұсқаулыққа бапталған және мультимодалды нұсқалармен.

- Ресми чекпойнттар және vLLM мен NVIDIA платформалары сияқты жеделдетілген орындау орталар үшін оңтайландырылған чекпойнттар (NVFP4/FP8).

- Мультимодалды + көптілді + ұзақ контекст — Ministral және Large нұсқалары кескін+мәтінді түсінуге және тілдердің кең қамтылуына екпін береді. Суреттер мен ұзақ құжаттарды біріктіретін қолданбалар үшін бұл маңызды.

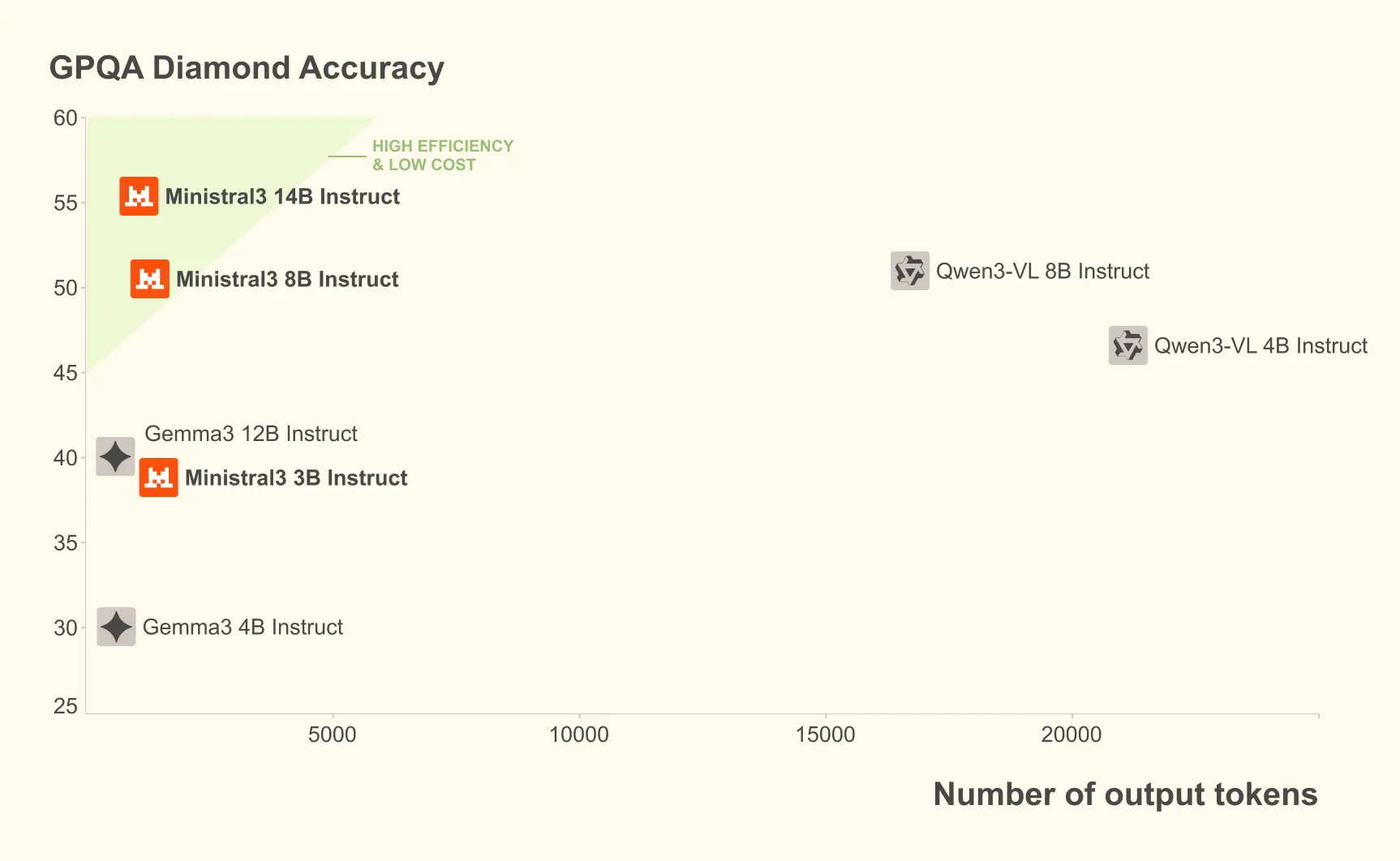

GPQA Diamond деректер жинағында (қатаң ғылыми пайымдау тесті) Ministral 3-тің түрлі нұсқалары шығыс токендерінің саны артса да жоғары дәлдікті сақтайды. Мысалы, Ministral 3B Instruct моделі 20 000 токенге дейін өңдегенде 35–40% дәлдікті сақтайды, бұл Gemma 2 9B сияқты үлкенірек модельдерге ұқсас, бірақ ресурстарды азырақ пайдаланады.

Mistral 3 архитектурасы қандай?

Mistral 3 — бір ғана архитектура емес, тұтас отбасы, бірақ түсінуіңіз қажет екі архитектуралық үлгі бар:

Тығыз шағын модельдер (Ministral 3)

- Трансформердің стандартты стектерi, тиімділік пен edge инференсіне оңтайландырылған.

- Бірнеше өлшемде (3B/8B/14B) және әртүрлі fine-tune нұсқаларында ұсынылады: base, instruct және reasoning; көптеген нұсқаларда табиғи мультимодалдылық (көрініс + мәтін) және ұзақ контекст қолдауы бар. Ministral модельдері кейбір дистрибуцияларда ықшамдық үшін FP8 салмақтарымен шығарылады.

Сиретілген Mixture-of-Experts (Mistral Large 3)

- MoE архитектурасы: модельде көп сарапшы бар (жалпы параметрлер саны орасан), бірақ әр токен үшін бағдарлау арқылы таңдалған кіші жиын ғана есептеледі — бұл есептеу-қуат теңгерімін жақсартады.

- Mistral Large 3 шамамен ~675B жалпы параметрге ие және инференс кезінде ~41B белсенді параметрді қолданады, бұл MoE дизайнын көрсетеді. Модель заманауи NVIDIA жабдығында оқытылған және тиімді төмен дәлдікті орындауға (NVFP4/TensorRT/Large-kernel оңтайландырулары) бейімделген.

Жергілікті орындағанда маңызды техникалық мүмкіндіктер:

- Ұзақ контекст: кейбір Mistral 3 нұсқалары өте ұзын контексті қолдайды (vLLM құжаттары мен Mistral құжаттамасы кейбір нұсқаларда 256k сияқты үлкен контекст терезелерін атайды). Бұл жадқа және сервинг үлгілеріне әсер етеді.

- Салмақ форматтары және кванттау: Mistral сығылған/оңтайландырылған форматтарда (FP8, NVFP4) салмақтар ұсынады және практикалық жергілікті инференс үшін заманауи кванттау құралдарымен (BitsAndBytes, GPTQ, вендорлық құралдар) жұмыс істейді.

Неліктен Mistral 3-ті жергілікті іске қосу керек?

LLM-дерді жергілікті іске қосу енді тар шеңберлі әуестенушілік емес — бұл мынаған мән беретін командалар мен жеке тұлғалар үшін практикалық таңдау:

- Деректер құпиялығы және сәйкестік. Жергілікті хостинг сезімтал енгізулерді сіздің инфрақұрылымыңыздың ішінде сақтайды (қаржы, денсаулық сақтау, құқық салалары үшін маңызды). Reuters Mistral модельдерін өзін-өзі хосттайтын ірі тапсырыс берушілерді хабарлады.

- Кідіріс пен құнды бақылау. Қатаң кідіріс SLO және құнын болжамды ұстау үшін жергілікті немесе жеке кластер инференсі бұлтты API-дың күтпеген шығындарынан артық болуы мүмкін. Шағын Ministral нұсқалары мен квантталған форматтар бұл мүмкіндікті практикалық етеді.

- Баптау және fine-tune. Арнайы мінез-құлық, функция шақыру немесе жаңа модальділіктер қажет болғанда, жергілікті бақылау жеке fine-tune мен деректерді өңдеуге мүмкіндік береді. Hugging Face және vLLM интеграциясы мұны анағұрлым оңай етеді.

Егер бұл себептер сіздің басымдықтарыңызбен — құпиялылық, бақылау, құнның болжамдылығы немесе зерттеу — сәйкес келсе, жергілікті орналастыруды қарастырған жөн.

Mistral 3-ті жергілікті қалай іске қосуға болады (үш практикалық әдіс)?

Mistral 3-ті жергілікті іске қосудың көптеген жолдары бар. Мұнда ең жиі сценарийлерді қамтитын үш тәсілді қарастырамын:

- Ollama (нөлдік баптау, десктоп/жергілікті сервер — көп қолданушыға ең оңай)

- Hugging Face Transformers + PyTorch / vLLM (толық бақылау, GPU кластерлері)

- llama.cpp / ggml / GGUF квантталған CPU инференсі (жеңіл, ноутбук/CPU-де жұмыс істейді)

Әр әдіс үшін қашан орынды екенін, алғышарттарды, қадамдық командаларды және шағын код мысалдарын келтіремін.

1) Mistral 3-ті Ollama арқылы қалай іске қосуға болады (ең жылдам жол)?

Қашан қолдану керек: сізге үйкеліссіз жергілікті тәжірибе (macOS/Linux/Windows), ыңғайлы CLI немесе GUI және қолжетімді болса, автоматты жүктеу/квантталған артефакттар керек. Ollama-да Ministral 3 және Mistral отбасының басқа мүшелері үшін модель жазбалары бар.

Алғышарттар

- Ollama орнатылған (ollama.com сайтындағы орнатқышты қолданыңыз). Ollama кітапханасы кейбір Ministral релиздері үшін минималды нұсқаларды көрсетеді.

- Модель артефакттарын сақтауға жеткілікті диск кеңістігі (өлшемдер әртүрлі — квантталған Ministral 3B нұсқалары бірнеше ГБ болуы мүмкін; үлкен BF16 нұсқалары ондаған ГБ).

Қадамдар (мысал)

- Ollama орнату (macOS мысалы — платформаныза сәйкес ауыстырыңыз):

# macOS (Homebrew) example — see ollama.com for platform-specific installersbrew install ollama

- Ministral моделін іске қосу:

# Pull and run the model interactivelyollama run ministral-3

- Жергілікті сервинг (API) және кодтан шақыру:

# Run Ollama server (default port shown in docs)ollama serve# Then curl against it (example)curl -s -X POST "http://localhost:11434/api/v1/generate" \ -H "Content-Type: application/json" \ -d '{"model":"ministral-3","prompt":"Summarize Mistral 3 in one sentence."}'

Ескертпелер мен кеңестер

- Ollama модельді жүктеуді және (қолжетімді болса) жергілікті квантталған нұсқаларды өзі басқарады — модельдерді тез сынап көруге өте қолайлы.

- Егер сіз модельді көптеген бір мезгілдегі сұраныстармен өндірісте қолдануды жоспарласаңыз, Ollama прототиптеу үшін тамаша, бірақ тұрақты жүктеме үшін масштабтау мен ресурстарды оркестрациялауды бағалаңыз.

2) Mistral 3-ті Hugging Face Transformers арқылы қалай іске қосуға болады (GPU / vLLM интеграциясы)?

Қашан қолдану керек: зерттеу немесе өндіріс үшін бағдарламалық бақылау қажет, fine-tune жасағыңыз келеді немесе GPU кластерлерінде vLLM сияқты жеделдетілген инференс стекін пайдаланғыңыз келеді. Hugging Face Transformers қолдауын береді, ал Mistral vLLM/NVIDIA үшін оңтайландырылған чекпойнттарды ұсынады.

Алғышарттар

- Жеткілікті жадты GPU (модель мен дәлдікке байланысты). Шағын Ministral 3 (3B/8B) квантталған кезде орта деңгейлі бір GPU-да жұмыс істей алады; үлкенірек нұсқалар бірнеше H100/A100 немесе vLLM үшін оңтайландырылған NVFP4 чекпойнттарын талап етеді. NVIDIA және Mistral құжаттамасы үлкен модельдер үшін нақты түйін өлшемдерін ұсынады.

- Python, PyTorch, transformers, accelerate (немесе vLLM сервер қажет болса).

Python мысалы — базалық Hugging Face pipeline (3B instruct нұсқасы, GPU):

# Example: CPU/GPU inference with transformers pipeline# Assumes you have CUDA and a compatible PyTorch build.import torchfrom transformers import pipelinemodel_name = "mistralai/Ministral-3-3B-Instruct-2512-BF16" # example HF model idgenerator = pipeline( "text-generation", model=model_name, device_map="auto", torch_dtype=torch.bfloat16, # use bfloat16 if your hardware supports it)prompt = "Explain how attention helps transformers, in 3 sentences."out = generator(prompt, max_new_tokens=120, do_sample=False)print(out[0]["generated_text"])

Өндірістік GPU инференсі үшін vLLM пайдалану

vLLM үлкен модельдерді тиімді сервингке арналған, Mistral 3 отбасын қолдайды және Mistral жадты азайтып, жылдамдықты арттыру үшін vLLM/NVIDIA жабдығына оңтайландырылған (NVFP4/FP8) чекпойнттар жариялады. vLLM серверін іске қосу кідірісі аз, топталған инференс API соңғы нүктесін береді. Модель жолдары мен ұсынылатын жалаушалар үшін vLLM рецептері мен Mistral нұсқаулығын қараңыз.

Ескертпелер мен кеңестер

- Өндіріс үшін оңтайландырылған чекпойнттарды (NVFP4/FP8) және ұсынылатын GPU-ларды (мысалы, H100/A100) таңдаңыз немесе тензорлық/модельдік параллелизмді қолдайтын оркестрация қабатын қолданыңыз. Mistral мен NVIDIA оңтайландырылған орындау ортасы туралы құжаттар мен блог жазбаларын ұсынады.

- Қайталанатын нәтижелер үшін және үнсіз модель жаңартуларынан сақтану үшін дискідегі дәл модель чекпойнтын (немесе қайталанатын HF snapshot) бекітіп қойыңыз.

3) Mistral 3-ті CPU-де llama.cpp / GGUF квантталған модельдерімен қалай іске қосуға болады?

Қашан қолдану керек: сізге жергілікті, офлайн инференс CPU-де (мысалы, әзірлеуші ноутбукі, оқшауланған орта) қажет және өнімділік пен жад тиімділігі үшін сапаның біршама төмендеуіне келісесіз. Бұл әдіс ggml/llama.cpp және GGUF квантталған салмақтарды (q4/q5/etc.) пайдаланады.

Алғышарттар

- Ministral моделінің GGUF квантталған жинағы (қауымдастық мүшелері Hugging Face-те көптеген GGUF квантталғандарын жариялайды немесе BF16 салмақтарын жергілікті GGUF-қа түрлендіреді).

Ministral-3-3B-InstructGGUF нұсқаларын іздеңіз. - Компиляцияланған llama.cpp бинарі (жоба README-н ұстаныңыз).

Кванттау (егер бастапқы салмақтар болса) — мысал (тұжырымдамалық)

# Example: quantize from an FP16/BF16 model to a GGUF q4_K_M (syntax depends on llama.cpp version)./quantize /path/to/original/model.bin /path/to/out.gguf q4_k_m

GGUF-ты llama.cpp арқылы іске қосу

# run interactive inference with a quantized GGUF model./main -m /path/to/ministral-3-3b-instruct.gguf -t 8 -c 2048 --interactive# -t sets threads, -c sets context (tokens) if supported

Python клиент мысалы (жергілікті llama.cpp сервері немесе subprocess)

llama.cpp-ты subprocess ретінде іске қосып, оған prompt беруіңізге болады немесе шағын орауыш клиентті пайдаланыңыз. Қауымдастықта жергілікті қолданбаларға интеграция үшін llama.cpp-қа арналған қарапайым HTTP сервер орағыштары бар.

Ескертпелер мен ымыралар

- Кванттау VRAM-ды азайтады және CPU инференсін мүмкін етеді, бірақ сапаны төмендетуі мүмкін (кванттау форматына байланысты шамалы немесе орташа). q4_K_M немесе q5 сияқты форматтар CPU үшін жиі қолданылатын ымыралы нұсқалар. Жапон және техникалық жазбалар Q4/Q5 түрлері мен GGUF түрлендірулерін егжей-тегжейлі түсіндіреді.

- Шағын және орташа жүктемелер үшін GGUF + llama.cpp жергілікті LLM-дерді іске қосудың ең арзан әрі портативті тәсілі болып саналады.

Қандай жабдық және жад бойынша ойлар маңызды?

Қысқаша, практикалық нұсқаулық:

- 3B модельдер: жиі квантталып, лайықты ноутбук CPU-сында немесе 8–16 GB VRAM-ы бар бір GPU-да (дәлдік/кванттауға байланысты) іске қосылады. GGUF q4 нұсқалары көптеген заманауи CPU-ларда жұмыс істей алады.

- 8B және 14B Ministral: әдетте орта деңгейлі GPU қажет (мысалы, дәлдік пен активацияны кэштеуге байланысты 24–80 GB) немесе бірнеше құрылғыға квантталған орналастыру.

- Mistral Large 3 (675B жалпы, 41B белсенді): деректер орталығына арналған және әдетте көп-GPU түйіндерінде (мысалы, 8×A100 немесе H100) және vLLM үшін арнайы форматтармен (NVFP4/FP8) ең жақсы жұмыс істейді. Mistral мұндай орналастыруларды іске асыруға болатын ету үшін оңтайландырылған чекпойнттарды әдейі жариялады.

Егер сіздің басымдықңыз жергілікті ноутбукта пайдалану болса, Ministral 3B квантталған GGUF + llama.cpp жолын таңдаңыз. Егер басымдық өндірістік өткізу қабілеті болса, GPU-да vLLM + NVFP4 чекпойнттарын қарастырыңыз. Эксперимент жасау жеңілдігі керек болса, бастау үшін ең тезі — Ollama.

Кванттау мен дәлдікті қалай таңдау керек?

Кванттау — жад пен жылдамдық пен модель сапасының арасындағы айырбас. Жиі қолданылатын таңдаулар:

- q4_0 / q4_1 / q4_K_M: CPU инференсі үшін кең тараған 4-биттік опциялар; q4_K_M (k-means нұсқасы) жиі сапа/өнімділік тепе-теңдігін жақсы береді.

- q5 / q8 / imatrix нұсқалары: аралық форматтар, көбірек дәлдікті сақтауы мүмкін, бірақ өлшемі үлкен.

- FP16 / BF16 / FP8 / NVFP4: GPU дәлдіктері — BF16 және FP16 заманауи GPU-ларда оқыту/инференс үшін кең таралған; FP8 / NVFP4 — өте үлкен модельдер үшін жадты үнемдейтін жаңа форматтар және оңтайландырылған орындау орталарымен және Mistral чекпойнттарымен қолданылады.

Жалпы ереже: жергілікті CPU іске қосудар үшін q4_K_M немесе соған ұқсасын таңдаңыз; жоғары дәлдік керек GPU инференсі үшін BF16/FP16 таңдаңыз немесе орындау ортасы қолдаса, вендорға тән FP8/NVFP4 пайдаланыңыз.

Қорытынды — Mistral 3-ті жергілікті іске қосу керек пе?

Егер сізге құпиялылық, төмен кідіріс немесе баптау қажет болса — иә: Mistral 3 отбасы сізге кең таңдау береді — edge CPU үшін шағын модельдер, бір GPU немесе шағын кластер үшін орташа модельдер және деректер орталығы ауқымына арналған үлкен MoE нұсқасы — әрі экожүйе (Ollama, Hugging Face, vLLM, llama.cpp) жергілікті және жеке орналастыру үлгілерін іс жүзінде қолдайды. Mistral сонымен қатар NVIDIA және vLLM-пен бірге жоғары өткізу қабілеті мен төмен жад ізіне арналған оңтайландырылған чекпойнттар әзірледі, бұл өндірістік өзін-өзі хосттауды бұрынғыдан да шынайы етеді.

Бастау үшін Gemini 3 Pro мүмкіндіктерін Playground ішінде зерттеңіз және егжей-тегжейлі нұсқаулар үшін API нұсқаулығын қараңыз. Қол жеткізбестен бұрын, CometAPI қызметіне кіргеніңізге және API кілтін алғаныңызға көз жеткізіңіз. CometAPI интеграцияға көмектесу үшін ресми бағадан әлдеқайда төмен баға ұсынады.

Дайынсыз ба?→ Бүгін CometAPI қызметіне тіркеліңіз !