Mistral 3는 Mistral AI의 2025년 하반기 모델 패밀리의 대표 출시작입니다. 로컬/엣지 배포에 적합한 소형·고속 모델과 최신 수준의 규모와 컨텍스트 길이를 확장하는 매우 큰 희소 플래그십을 함께 제공합니다. 이 글은 Mistral 3가 무엇인지, 어떻게 구축되었는지, 로컬로 실행해야 하는 이유, 그리고 개인용 머신이나 프라이빗 서버에서 실행하는 세 가지 실용적인 방법 — Ollama의 “클릭 한 번으로 실행” 편의성부터 vLLM/TGI를 이용한 프로덕션 GPU 서빙, GGUF + llama.cpp를 통한 초소형 디바이스 CPU 추론까지 — 를 설명합니다.

Mistral 3란 무엇인가요?

Mistral 3는 Mistral AI의 최신 세대 오픈 웨이트 모델입니다. 이 패밀리에는 거대한 Mistral Large 3(희소 Mixture-of-Experts — MoE — 모델)와 지시 따르기 및 멀티모달(텍스트+비전) 작업에 맞춰 튜닝된 여러 엣지/“ministral” 변형(3B, 8B, 14B)이 포함됩니다. Mistral은 이번 릴리스를 폭넓게 활용 가능하도록 포지셔닝했습니다: 특화된 최적화 체크포인트를 이용한 고성능 데이터센터 추론부터, 양자화 포맷과 더 작은 변형을 통한 엣지 및 노트북 사용까지.

핵심 실용 특성:

- Large 3 변형의 Mixture-of-Experts(MoE) 아키텍처는 매우 큰 “총” 파라미터 수를 제공하면서도 토큰당 일부 전문가만 활성화해 규모 대비 효율을 개선합니다.

- 엣지 및 로컬 사용을 위한 Ministral 3 모델군(3B / 8B / 14B)으로, 지시 튜닝 및 멀티모달 변형을 제공합니다.

- vLLM 및 NVIDIA 플랫폼 같은 가속 런타임을 위해 공식 체크포인트와 최적화 체크포인트(NVFP4/FP8) 를 제공합니다.

- 멀티모달 + 다국어 + 긴 컨텍스트 — Ministral 및 Large 변형은 이미지+텍스트 이해와 폭넓은 언어 커버리지에 중점을 둡니다. 이미지와 긴 문서를 함께 다루는 애플리케이션에서 중요합니다.

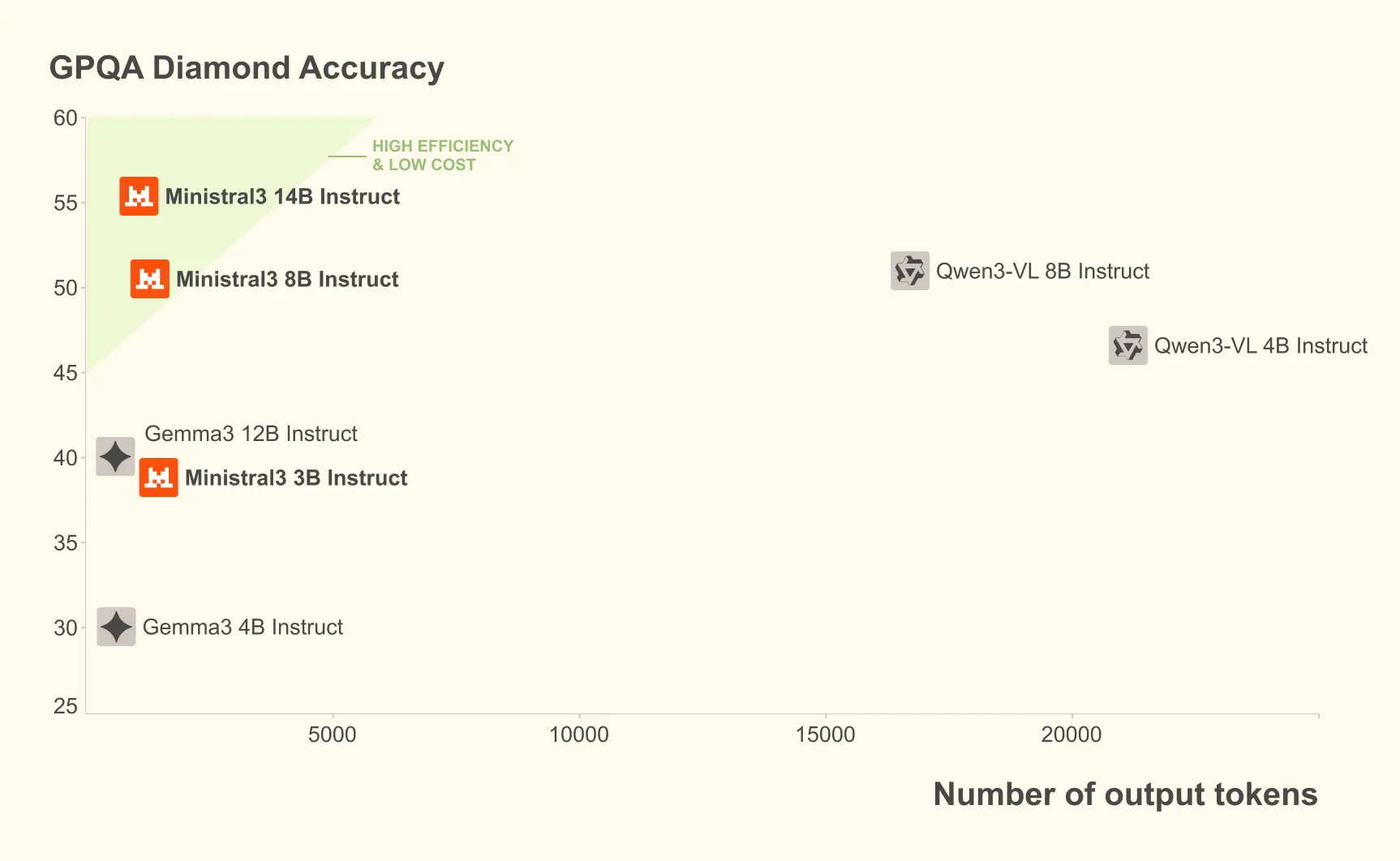

GPQA Diamond 데이터셋(엄격한 과학적 추론 평가)에서, 다양한 Ministral 3 변형은 출력 토큰 수가 늘어나도 높은 정확도를 유지합니다. 예를 들어, Ministral 3B Instruct 모델은 최대 20,000 토큰을 처리할 때도 35-40% 정확도를 유지하며, 더 적은 리소스로 Gemma 2 9B 같은 더 큰 모델에 견줄 만합니다.

Mistral 3의 아키텍처는 무엇인가요?

Mistral 3는 단일 아키텍처가 아닌 패밀리이며, 이해해야 할 두 가지 아키텍처 패턴은 다음과 같습니다:

밀집 소형 모델(Ministral 3)

- 표준 트랜스포머 스택을 기반으로 효율성과 엣지 추론에 최적화되어 있습니다.

- 여러 크기(3B/8B/14B)와 다양한 파인튜닝 변형: base, instruct, reasoning; 다수 변형이 네이티브 멀티모달(비전 + 텍스트) 지원과 긴 컨텍스트 동작을 포함합니다. Ministral 모델은 일부 배포에서 컴팩트함을 위해 최적화된 FP8 가중치로 제공됩니다.

희소 Mixture-of-Experts(Mistral Large 3)

- MoE 아키텍처: 모델은 많은 전문가(총 파라미터 수가 매우 큼)를 보유하지만, 라우팅으로 선택된 일부 전문가만 토큰별로 평가되어 계산 대비 확장성이 향상됩니다.

- Mistral Large 3는 총 파라미터 ~675B, 추론 시 활성 파라미터 ~41B로 보고되며, 이러한 MoE 설계를 반영합니다. 모델은 최신 NVIDIA 하드웨어에서 학습되었고, 효율적인 저정밀 실행(NVFP4/TensorRT/Large-kernel 최적화)을 위해 최적화되었습니다.

로컬 실행 시 중요한 기술적 특성:

- 긴 컨텍스트: 일부 Mistral 3 변형은 매우 긴 컨텍스트를 지원합니다(vLLM 문서와 Mistral 문서에 특정 변형의 방대한 컨텍스트 윈도우 언급; 예: 일부 Ministral 변형에서 256k). 이는 메모리와 서빙 패턴에 영향을 줍니다.

- 가중치 포맷 & 양자화: Mistral은 압축/최적화 포맷(FP8, NVFP4)으로 가중치를 제공하며, 실용적인 로컬 추론을 위해 최신 양자화 툴체인(BitsAndBytes, GPTQ, 벤더 툴체인)과 협업합니다.

왜 Mistral 3를 로컬로 실행할까요?

로컬에서 LLM을 실행하는 일은 더 이상 취미가 아닙니다 — 금융, 의료, 법률 등에서 다음 요소를 중시하는 팀과 개인에게 실용적인 선택입니다:

- 데이터 프라이버시와 컴플라이언스. 로컬 호스팅은 민감한 입력을 인프라 내부에 유지합니다(중요). Reuters는 유명 고객들이 Mistral 모델을 자체 호스팅한다고 보도했습니다.

- 지연시간과 비용 통제. 엄격한 지연시간 SLO와 예측 가능한 비용을 위해 로컬 또는 프라이빗 클러스터 추론은 클라우드 API 비용 폭탄보다 나을 수 있습니다. 더 작은 Ministral 변형과 양자화 포맷이 이를 가능하게 합니다.

- 커스터마이징과 파인튜닝. 맞춤 동작, 함수 호출, 새로운 모달리티가 필요할 때, 로컬 제어는 커스텀 파인튜닝과 데이터 핸들링을 가능하게 합니다. Hugging Face와 vLLM 통합이 이를 더 손쉽게 만듭니다.

이러한 이유가 프라이버시, 통제, 비용 예측 가능성 또는 연구 우선순위와 맞다면, 로컬 배포를 고려할 가치가 있습니다.

Mistral 3를 로컬로 실행하는 방법(세 가지 실용 접근법)?

Mistral 3를 로컬로 실행하는 방법은 다양합니다. 가장 일반적인 사용자 시나리오를 포괄하는 세 가지 접근법을 소개합니다:

- Ollama(제로 설정 데스크톱/로컬 서버, 많은 사용자에게 가장 쉬움)

- Hugging Face Transformers + PyTorch / vLLM(완전한 제어, GPU 클러스터)

- llama.cpp / ggml / GGUF 양자화 CPU 추론(라이트웨이트, 노트북/CPU에서 실행)

각 방법에 대해 적합한 경우, 사전 준비, 단계별 명령어와 작은 코드 예제를 제시합니다.

1) Ollama로 Mistral 3 실행(가장 빠른 경로)?

이럴 때 사용하세요: macOS/Linux/Windows에서 마찰 없는 로컬 경험, 접근하기 쉬운 CLI 또는 GUI, 가능할 때 자동 다운로드/양자화 아티팩트가 필요합니다. Ollama에는 Ministral 3 및 Mistral 패밀리의 다른 모델 항목이 있습니다.

사전 준비

- Ollama 설치(ollama.com의 인스톨러를 따르세요). Ollama 라이브러리는 일부 Ministral 릴리스에 대해 특정 최소 버전을 안내합니다.

- 모델 아티팩트를 저장할 충분한 디스크 공간(모델 크기는 다릅니다 — Ministral 3B 양자화 버전은 수 GB일 수 있고, 더 큰 BF16 변형은 수십 GB입니다).

단계(예시)

- Ollama 설치(macOS 예시 — 플랫폼별로 대체):

# macOS (Homebrew) example — see ollama.com for platform-specific installersbrew install ollama

- Ministral 모델 실행:

# Pull and run the model interactivelyollama run ministral-3

- 로컬(API)로 서빙하고 코드에서 호출:

# Run Ollama server (default port shown in docs)ollama serve# Then curl against it (example)curl -s -X POST "http://localhost:11434/api/v1/generate" \ -H "Content-Type: application/json" \ -d '{"model":"ministral-3","prompt":"Summarize Mistral 3 in one sentence."}'

참고 및 팁

- Ollama는 모델 다운로드와(가능할 때) 로컬 양자화 변형을 처리합니다 — 빠르게 모델을 시험해 보기 매우 편리합니다.

- 많은 동시 요청이 있는 프로덕션 사용을 계획한다면, Ollama는 프로토타이핑에 훌륭하지만 지속적인 부하에 대한 스케일링과 리소스 오케스트레이션을 평가하세요.

2) Hugging Face Transformers로 Mistral 3 실행(GPU / vLLM 통합)?

이럴 때 사용하세요: 연구 또는 프로덕션을 위한 프로그래밍적 제어가 필요하거나 파인튜닝을 원하거나, GPU 클러스터에서 vLLM 같은 가속 추론 스택을 쓰고 싶을 때. Hugging Face는 Transformers 지원을 제공하며 Mistral은 vLLM/NVIDIA용 최적화 체크포인트를 제공합니다.

사전 준비

- 충분한 메모리를 갖춘 GPU(모델과 정밀도에 따라 다름). Ministral 3 소형(3B/8B)은 양자화 시 단일 중급 GPU에서도 실행 가능하며, 더 큰 변형은 H100/A100 다수 또는 vLLM용 최적화 NVFP4 체크포인트가 필요합니다. NVIDIA와 Mistral 문서는 대형 모델에 권장 노드 크기를 안내합니다.

- Python, PyTorch, transformers, accelerate(또는 vLLM 서버).

Python 예시 — 기본 Hugging Face 파이프라인(3B instruct 변형, GPU):

# Example: CPU/GPU inference with transformers pipeline# Assumes you have CUDA and a compatible PyTorch build.import torchfrom transformers import pipelinemodel_name = "mistralai/Ministral-3-3B-Instruct-2512-BF16" # example HF model idgenerator = pipeline( "text-generation", model=model_name, device_map="auto", torch_dtype=torch.bfloat16, # use bfloat16 if your hardware supports it)prompt = "Explain how attention helps transformers, in 3 sentences."out = generator(prompt, max_new_tokens=120, do_sample=False)print(out[0]["generated_text"])

프로덕션 GPU 추론을 위한 vLLM 사용

vLLM은 대형 모델을 효율적으로 서빙하도록 설계되었고, Mistral 3 패밀리를 지원합니다. Mistral은 메모리 사용을 줄이고 속도를 높이기 위해 vLLM/NVIDIA 하드웨어(NVFP4/FP8)에 최적화된 체크포인트를 공개했습니다. vLLM 서버를 시작하면 저지연, 배치 추론 엔드포인트를 사용할 수 있습니다. 모델 경로와 권장 플래그는 vLLM 레시피와 Mistral 가이드를 참고하세요.

참고 및 팁

- 프로덕션에서는 최적화 체크포인트(NVFP4/FP8)를 선호하고 권장 GPU(예: H100/A100)를 사용하거나 텐서/모델 병렬을 지원하는 오케스트레이션 레이어를 사용하세요. Mistral과 NVIDIA는 최적화 런타임에 관한 문서와 블로그 글을 제공합니다.

- 재현성을 위해 디스크의 정확한 모델 체크포인트(또는 재현 가능한 HF 스냅샷)를 고정하세요. 조용한 모델 업데이트를 피하는 데 필요합니다.

3) llama.cpp / GGUF 양자화 모델로 CPU에서 Mistral 3 실행

이럴 때 사용하세요: CPU(예: 개발자 노트북, 보안 격리 환경)에서 로컬 오프라인 추론이 필요하고, 런타임과 메모리 효율을 위해 어느 정도 정확도 저하를 감수할 의향이 있을 때. 이 방법은 ggml/llama.cpp와 GGUF 양자화 가중치(q4/q5/etc.)를 사용합니다.

사전 준비

- Ministral 모델의 GGUF 양자화 빌드(Hugging Face에서 많은 커뮤니티 구성원이 GGUF 양자화본을 게시하거나 BF16 가중치를 로컬에서 GGUF로 변환합니다).

Ministral-3-3B-InstructGGUF 변형을 검색하세요. - 컴파일된 llama.cpp 바이너리(프로젝트 README를 따르세요).

양자화(원본 가중치가 있을 경우) — 예시(개념적)

# Example: quantize from an FP16/BF16 model to a GGUF q4_K_M (syntax depends on llama.cpp version)./quantize /path/to/original/model.bin /path/to/out.gguf q4_k_m

llama.cpp로 GGUF 실행

# run interactive inference with a quantized GGUF model./main -m /path/to/ministral-3-3b-instruct.gguf -t 8 -c 2048 --interactive# -t sets threads, -c sets context (tokens) if supported

Python 클라이언트 예시(로컬 llama.cpp 서버 또는 서브프로세스)

llama.cpp를 서브프로세스로 실행해 프롬프트를 전달하거나, 작은 래퍼 클라이언트를 사용할 수 있습니다. 많은 커뮤니티 프로젝트가 로컬 앱 통합을 위한 간단한 HTTP 서버 래퍼를 제공합니다.

참고 및 트레이드오프

- 양자화는 VRAM을 줄이고 CPU 추론을 가능하게 하지만, 양자화 포맷에 따라 품질이(경미~중간 수준으로) 떨어질 수 있습니다. q4_K_M 또는 q5 변형 같은 포맷은 CPU 용도에서 흔한 절충안입니다. 일본어 및 기술 게시물에서 Q4/Q5 유형과 GGUF 변환을 자세히 설명합니다.

- 소형~중간 규모 워크로드에서는 GGUF + llama.cpp가 로컬 LLM을 실행하는 가장 저렴하고 휴대성 높은 방법인 경우가 많습니다.

어떤 하드웨어와 메모리 고려사항이 중요할까요?

짧고 실용적인 가이드:

- 3B 모델: 정량화하면 준수한 노트북 CPU나 8–16 GB VRAM의 단일 GPU에서도 종종 실행할 수 있습니다(정밀도/양자화에 따라). GGUF q4 변형은 많은 최신 CPU에서 실행됩니다.

- 8B 및 14B Ministral: 일반적으로 중급 GPU(예: 정밀도와 활성화 캐싱에 따라 24–80 GB) 또는 여러 디바이스에 걸친 양자화가 필요합니다.

- Mistral Large 3(총 675B, 활성 41B): 데이터센터 배포를 의도했으며 일반적으로 다중 GPU 노드(예: 8×A100 또는 H100)와 vLLM용 특화 포맷(NVFP4/FP8)에서 가장 잘 동작합니다. Mistral은 이러한 배포를 현실적으로 만들기 위해 최적화 체크포인트를 명시적으로 공개했습니다.

우선순위가 로컬 노트북 사용이라면, Ministral 3B 양자화 GGUF + llama.cpp 경로를 목표로 하세요. 우선순위가 프로덕션 처리량이라면, GPU에서 vLLM + NVFP4 체크포인트를 검토하세요. 실험의 용이성을 원한다면, Ollama가 가장 빠른 시작점입니다.

양자화와 정밀도는 어떻게 선택해야 할까요?

양자화는 메모리/속도와 원시 모델 품질 간의 트레이드입니다. 일반적인 선택:

- q4_0 / q4_1 / q4_K_M: CPU 추론에 사용되는 인기 있는 4비트 옵션; q4_K_M(k-means 변형)은 종종 품질/성능 균형이 더 좋습니다.

- q5 / q8 / imatrix 변형: 더 큰 용량을 대가로 더 많은 충실도를 보존할 수 있는 중간 포맷.

- FP16 / BF16 / FP8 / NVFP4: GPU 정밀도 — BF16과 FP16은 최신 GPU에서 학습/추론에 흔히 사용되며, FP8/NVFP4는 매우 큰 모델의 메모리를 절약하는 최신 포맷으로 최적화 런타임과 Mistral 체크포인트가 지원합니다.

경험칙: 로컬 CPU 실행에는 q4_K_M 등을 선택하고, 높은 충실도의 GPU 추론에는 BF16/FP16 또는 런타임이 지원하는 경우 벤더 특화 FP8/NVFP4를 사용하세요.

결론 — Mistral 3를 로컬로 실행해야 할까요?

프라이버시, 저지연, 커스터마이징이 필요하다면, 예: Mistral 3 패밀리는 매우 폭넓은 선택지를 제공합니다 — 엣지 CPU용 초소형 모델, 단일 GPU 또는 소규모 클러스터용 중형 모델, 데이터센터 규모용 대형 MoE 변형 — 그리고 생태계(Ollama, Hugging Face, vLLM, llama.cpp)는 이미 실용적인 로컬 및 프라이빗 배포 패턴을 지원합니다. Mistral은 NVIDIA와 vLLM과 협력해 처리량을 높이고 메모리 사용을 줄이는 최적화 체크포인트도 제공하여, 프로덕션 자체 호스팅을 과거보다 훨씬 현실적으로 만들었습니다.

시작하려면, Gemini 3 Pro 등 더 많은 모델의 기능을 Playground에서 탐색하고, 자세한 안내는 API 가이드를 참고하세요. 접근하기 전에 CometAPI에 로그인하고 API 키를 발급받았는지 확인하세요. CometAPI는 공식 가격보다 훨씬 저렴한 가격을 제공하여 통합을 돕습니다.

시작할 준비가 되셨나요?→ 오늘 CometAPI에 가입하세요 !