17년 2025월 1일, 상하이에 본사를 둔 AI 선도 기업 미니맥스(이하 시위 테크놀로지)는 세계 최초의 개방형, 대규모, 하이브리드 어텐션 추론 모델인 미니맥스-M1(이하 "M1")을 공식 출시했습니다. 전문가 혼합(MoE) 아키텍처와 혁신적인 라이트닝 어텐션 메커니즘을 결합한 M1은 생산성 중심 작업에서 업계 최고의 성능을 달성하여, 최고의 폐쇄형 소스 시스템과 경쟁하는 동시에 탁월한 비용 효율성을 유지합니다. 이 심층 분석에서는 MXNUMX의 정의, 작동 방식, 주요 특징, 그리고 모델 접근 및 사용에 대한 실질적인 지침을 살펴봅니다.

MiniMax-M1이란 무엇인가요?

MiniMax-M1은 MiniMaxAI의 확장 가능하고 효율적인 어텐션 메커니즘 연구의 정점을 보여줍니다. MiniMax-Text-01 기반을 기반으로 하는 M1 버전은 초고속 어텐션과 MoE 프레임워크를 통합하여 학습 및 추론 과정에서 전례 없는 효율성을 달성합니다. 이러한 조합을 통해 모델은 매우 긴 시퀀스를 처리할 때에도 높은 성능을 유지할 수 있습니다. 이는 방대한 코드베이스, 법률 문서 또는 과학 문헌을 포함하는 작업에 필수적인 요소입니다.

핵심 아키텍처 및 매개변수화

MiniMax-M1은 핵심적으로 전문가 하위 네트워크의 하위 집합을 통해 토큰을 동적으로 라우팅하는 하이브리드 MoE 시스템을 활용합니다. 이 모델은 총 456억 개의 매개변수로 구성되지만, 각 토큰에 대해 45.9억 개의 매개변수만 활성화되어 리소스 사용을 최적화합니다. 이 설계는 이전 MoE 구현에서 영감을 얻었지만, 분산 추론 중 GPU 간 통신 오버헤드를 최소화하기 위해 라우팅 로직을 개선했습니다.

번개 주의 및 긴 컨텍스트 지원

MiniMax-M1의 가장 큰 특징은 번개처럼 빠른 어텐션 메커니즘으로, 긴 시퀀스에 대한 셀프 어텐션의 계산 부담을 대폭 줄여줍니다. 로컬 커널과 글로벌 커널을 결합하여 어텐션 행렬을 근사함으로써, 이 모델은 75만 개의 토큰 시퀀스를 처리할 때 기존 변환기 대비 최대 100%의 FLOP(플롭)를 절감합니다. 이러한 효율성은 추론 속도를 높일 뿐만 아니라, 과도한 하드웨어 요구 사항 없이 최대 XNUMX만 개의 토큰으로 구성된 컨텍스트 윈도우를 처리할 수 있는 가능성을 열어줍니다.

MiniMax-M1은 어떻게 컴퓨팅 효율성을 달성합니까?

MiniMax-M1의 효율성 향상은 두 가지 주요 혁신에서 비롯됩니다. 바로 하이브리드 Mixture-of-Experts 아키텍처와 학습 과정에 사용되는 혁신적인 CISPO 강화 학습 알고리즘입니다. 이러한 요소들이 결합되어 학습 시간과 추론 비용을 모두 줄여 신속한 실험과 배포를 가능하게 합니다.

전문가 혼합 하이브리드 라우팅

MoE 구성 요소는 32개의 전문가 하위 네트워크를 사용하며, 각 하위 네트워크는 추론 또는 도메인별 작업의 다양한 측면에 특화되어 있습니다. 추론 과정에서 학습된 게이팅 메커니즘은 각 토큰에 대해 가장 관련성이 높은 전문가를 동적으로 선택하여 입력 처리에 필요한 하위 네트워크만 활성화합니다. 이러한 선택적 활성화는 중복 계산을 대폭 줄이고 메모리 대역폭 요구를 줄여 MiniMax-M1이 모놀리식 변환기 모델에 비해 비용 효율성 측면에서 상당한 우위를 점하게 합니다.

CISPO: 새로운 강화 학습 알고리즘

MiniMaxAI는 훈련 효율성을 더욱 높이기 위해 토큰 수준 가중치 업데이트를 중요도 샘플링 기반 클리핑으로 대체하는 강화 학습 알고리즘인 CISPO(Clipped Importance Sampling with Partial Overrides)를 개발했습니다. CISPO는 대규모 강화 학습 환경에서 흔히 발생하는 가중치 폭발 문제를 완화하고, 수렴 속도를 높이며, 다양한 벤치마크에서 안정적인 정책 개선을 보장합니다. 결과적으로 MiniMax-M1은 512개의 H800 GPU를 사용하여 전체 강화 학습을 단 534,700주 만에 완료하며, 비용은 약 4달러로, 이는 유사한 GPT-XNUMX 훈련 실행 비용의 극히 일부에 불과합니다.

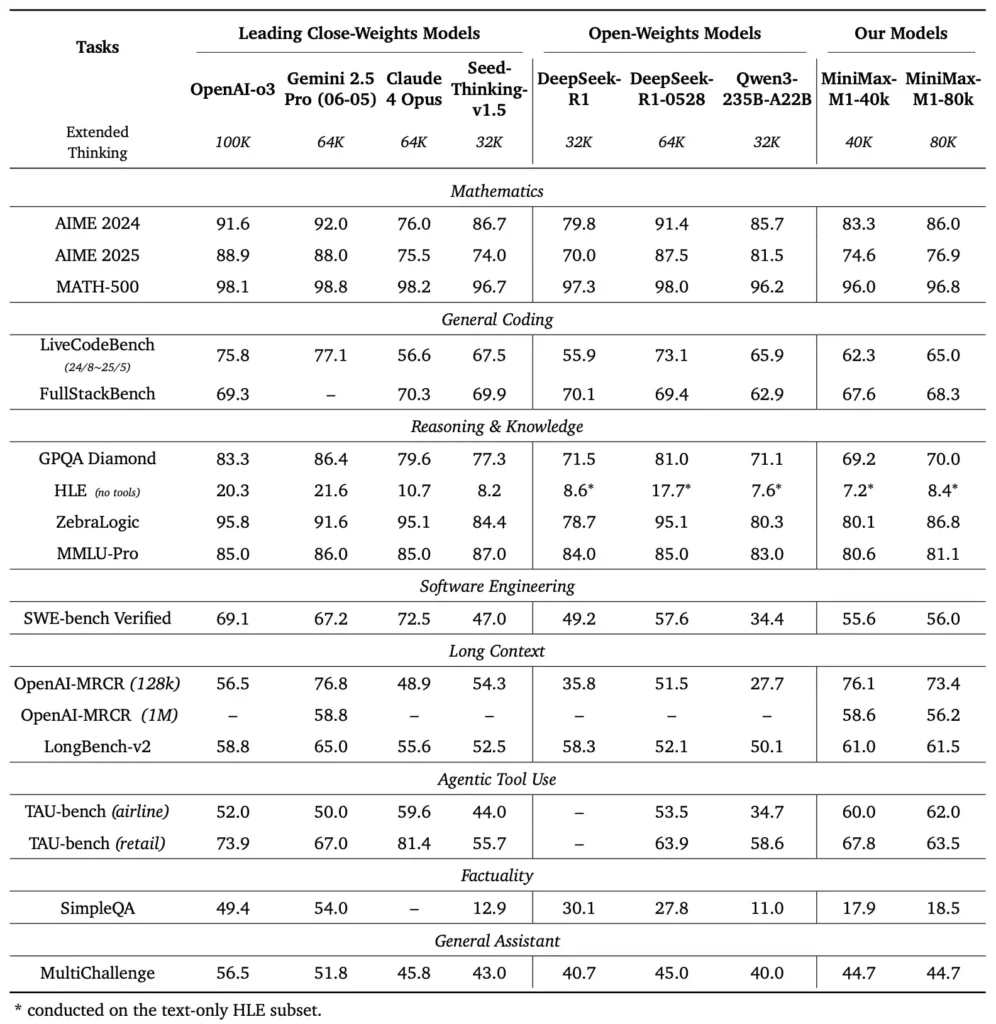

MiniMax-M1의 성능 벤치마크는 무엇입니까?

MiniMax-M1은 다양한 표준 및 도메인별 벤치마크에서 탁월한 성능을 보이며 장기 맥락 추론, 수학적 문제 해결 및 코드 생성을 처리하는 능력이 뛰어나다는 것을 보여줍니다.

장문 맥락 추론 과제

광범위한 문서 이해 테스트에서 MiniMax-M1은 최대 1,000,000개 토큰의 컨텍스트 윈도우를 처리하여 DeepSeek-R1보다 최대 컨텍스트 길이에서 100배 더 뛰어난 성능을 발휘하고 XNUMX개 토큰 시퀀스에 대한 컴퓨팅 요구 사항을 절반으로 줄였습니다. NarrativeQA 확장 컨텍스트 평가와 같은 벤치마크에서 이 모델은 최고 수준의 이해 점수를 달성했는데, 이는 로컬 및 글로벌 종속성을 모두 효율적으로 포착하는 뛰어난 집중력 덕분입니다.

소프트웨어 엔지니어링 및 도구 활용

MiniMax-M1은 대규모 강화학습을 사용하는 샌드박스 소프트웨어 엔지니어링 환경에서 특별히 학습되어 놀라운 정확도로 코드를 생성하고 디버깅할 수 있습니다. HumanEval 및 MBPP와 같은 코딩 벤치마크에서 이 모델은 Qwen3-235B 및 DeepSeek-R1과 동등하거나 그 이상의 통과율을 달성하며, 특히 다중 파일 코드베이스와 긴 코드 세그먼트의 교차 참조가 필요한 작업에서 뛰어난 성능을 보입니다. 또한, MiniMaxAI의 초기 데모는 CI/CD 파이프라인 생성부터 자동 문서화 워크플로까지 개발자 도구와 통합 가능한 모델의 역량을 보여줍니다.

개발자는 MiniMax-M1에 어떻게 접근할 수 있나요?

광범위한 도입을 촉진하기 위해 MiniMaxAI는 MiniMax-M1을 오픈 가중치 모델로 무료로 제공합니다. 개발자는 공식 GitHub 저장소를 통해 사전 학습된 체크포인트, 모델 가중치 및 추론 코드에 접근할 수 있습니다.

GitHub에서 오픈웨이트 릴리스

MiniMaxAI는 MiniMax-M1의 모델 파일과 관련 스크립트를 GitHub에 관대한 오픈소스 라이선스로 게시했습니다. 관심 있는 사용자는 https://github.com/MiniMax-AI/MiniMax-M1에서 저장소를 복제할 수 있습니다. 이 저장소에는 40K 및 80K 토큰 예산 변형에 대한 체크포인트와 PyTorch 및 TensorFlow와 같은 일반적인 ML 프레임워크에 대한 통합 예제가 호스팅됩니다.

API 엔드포인트 및 클라우드 통합

MiniMaxAI는 로컬 배포 외에도 주요 클라우드 제공업체와 협력하여 관리형 API 서비스를 제공합니다. 이러한 파트너십을 통해 개발자는 Python, JavaScript, Java용 SDK를 통해 RESTful 엔드포인트를 통해 MiniMax-M1을 호출할 수 있습니다. API에는 컨텍스트 길이, 전문가 라우팅 임계값, 토큰 예산에 대한 구성 가능한 매개변수가 포함되어 있어 사용자는 컴퓨팅 사용량을 실시간으로 모니터링하면서 사용 사례에 맞게 성능을 조정할 수 있습니다.

실제 애플리케이션에서 MiniMax-M1을 통합하고 사용하는 방법은 무엇입니까?

MiniMax-M1의 기능을 활용하려면 API 패턴, 장문 컨텍스트 프롬프트에 대한 모범 사례, 도구 오케스트레이션 전략을 이해해야 합니다.

기본 API 사용 예

일반적인 API 호출에는 입력 텍스트와 선택적 구성 재정의를 포함하는 JSON 페이로드를 전송하는 작업이 포함됩니다. 예를 들면 다음과 같습니다.

POST /v1/minimax-m1/generate

{

"input": "Analyze the following 500K token legal document and summarize the key obligations:",

"max_output_tokens": 1024,

"context_window": 500000,

"expert_threshold": 0.6

}

응답은 생성된 텍스트, 토큰 사용 통계, 라우팅 로그가 포함된 구조화된 JSON을 반환하여 전문가 활성화에 대한 세부적인 모니터링을 가능하게 합니다.

도구 사용 및 MiniMax Agent

MiniMaxAI는 핵심 모델과 함께 코드 실행 환경부터 웹 스크래퍼에 이르기까지 다양한 외부 도구를 호출할 수 있는 베타 에이전트 프레임워크인 MiniMax Agent를 출시했습니다. 개발자는 모델 추론과 도구 호출을 연결하는 에이전트 세션을 인스턴스화하여 실시간 데이터 검색, 계산 수행 또는 데이터베이스 업데이트 등을 수행할 수 있습니다. 이 에이전트 패러다임은 엔드투엔드 애플리케이션 개발을 간소화하여 MiniMax-M1이 복잡한 워크플로에서 오케스트레이터 역할을 수행할 수 있도록 합니다.

모범 사례와 함정

- 장기적 맥락을 위한 신속한 엔지니어링: 입력 내용을 일관된 세그먼트로 나누고, 논리적인 간격으로 요약을 삽입하고, "요약 후 추론" 전략을 활용하여 모델 초점을 유지합니다.

- 컴퓨팅과 성능의 균형: 지연에 민감한 애플리케이션의 경우 더 낮은 전문가 임계값이나 줄어든 사고 예산(예: 40K 변형)으로 실험해 보세요.

- 모니터링 및 거버넌스: 라우팅 로그와 토큰 통계를 사용하여 전문가 활용도를 감사하고 특히 프로덕션 환경에서 비용 예산을 준수하는지 확인합니다.

이러한 가이드라인을 따르면 개발자는 MiniMax-M1의 장점(광범위한 컨텍스트 처리 및 효율적인 추론)을 활용하는 동시에 대규모 모델 배포와 관련된 위험을 완화할 수 있습니다.

MiniMax-M1은 어떻게 사용하나요?

M1을 설치하면 간단한 Python 스크립트나 대화형 노트북을 통해 호출할 수 있습니다.

기본 추론 스크립트는 어떻게 생겼나요?

from minimax_m1 import MiniMaxM1Tokenizer, MiniMaxM1ForCausalLM

tokenizer = MiniMaxM1Tokenizer.from_pretrained("MiniMax-AI/MiniMax-M1-40k")

model = MiniMaxM1ForCausalLM.from_pretrained("MiniMax-AI/MiniMax-M1-40k")

inputs = tokenizer("Translate the following paragraph to French: ...", return_tensors="pt")

outputs = model.generate(**inputs, max_new_tokens=200)

print(tokenizer.decode(outputs))

이 샘플은 40k 예산 변형을 호출합니다. "MiniMax-AI/MiniMax-M1-80k" 전체 80k 추론 예산을 잠금 해제합니다().

매우 긴 맥락을 어떻게 처리하시나요?

일반적인 버퍼 크기를 초과하는 입력의 경우 M1은 스트리밍 토큰화를 지원합니다. stream=True 토크나이저에서 플래그를 사용하여 토큰을 청크로 공급하고 체크포인트 재시작 추론을 활용하여 백만 개의 토큰 시퀀스에 대한 성능을 유지합니다.

M1을 어떻게 미세 조정하거나 적용할 수 있나요?

기본 체크포인트만으로도 대부분의 작업에 충분하지만, 연구자들은 저장소에 포함된 CISPO 코드를 사용하여 강화학습(RL) 미세 조정을 적용할 수 있습니다. 코드 정확성부터 의미 충실도까지 다양한 범위의 맞춤형 보상 함수를 제공함으로써, 실무자들은 M1을 도메인별 워크플로에 맞게 조정할 수 있습니다.

결론

MiniMax-M1은 장문맥 언어 이해 및 추론의 경계를 넓히는 획기적인 AI 모델로 자리매김했습니다. 하이브리드 MoE 아키텍처, 라이트닝 어텐션 메커니즘, 그리고 CISPO 기반 학습 방식을 통해 법률 분석부터 소프트웨어 엔지니어링까지 다양한 작업에서 높은 성능을 제공하는 동시에 연산 비용을 획기적으로 절감합니다. 개방형 릴리스 및 클라우드 API 제공 덕분에 MiniMax-M1은 차세대 AI 기반 애플리케이션 구축을 원하는 다양한 개발자와 조직에서 활용할 수 있습니다. AI 커뮤니티가 대규모 문맥 모델의 잠재력을 지속적으로 탐구함에 따라, MiniMax-M1의 혁신은 업계 전반의 미래 연구 및 제품 개발에 영향을 미칠 것으로 예상됩니다.

시작 가이드

CometAPI는 ChatGPT 제품군을 포함한 수백 개의 AI 모델을 일관된 엔드포인트로 통합하는 통합 REST 인터페이스를 제공하며, 내장된 API 키 관리, 사용 할당량 및 청구 대시보드를 통해 여러 공급업체 URL과 사용자 인증 정보를 일일이 관리할 필요가 없습니다.

시작하려면 모델의 기능을 탐색하세요. 운동장 그리고 상담하십시오 API 가이드 자세한 내용은 CometAPI를 참조하세요. 접속하기 전에 CometAPI에 로그인하고 API 키를 발급받았는지 확인하세요.

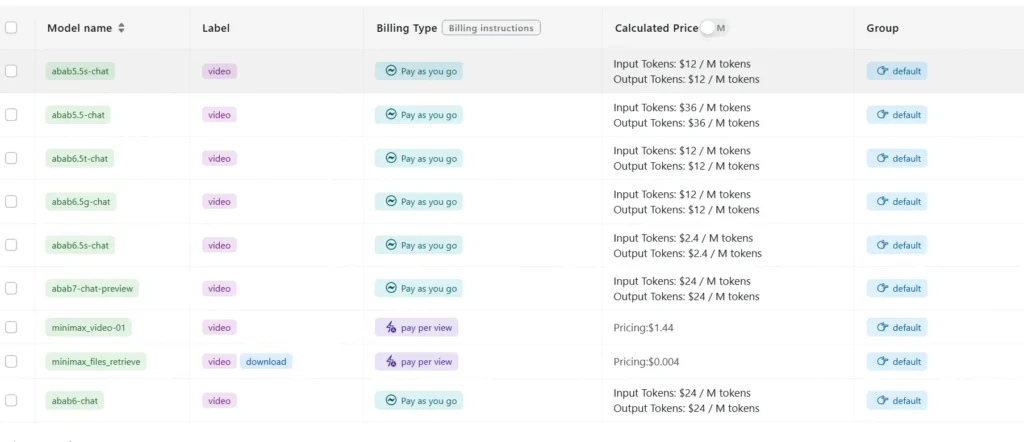

최신 통합 MiniMax‑M1 API가 곧 CometAPI에 등장할 예정이므로 계속 지켜봐 주세요! MiniMax‑M1 모델 업로드를 마무리하는 동안 다른 모델을 살펴보세요. 모델 페이지 또는 다음을 시도해 보세요. AI 놀이터. MiniMax의 CometAPI 최신 모델은 다음과 같습니다. Minimax ABAB7-미리보기 API 및 미니맥스 비디오-01 API ,참조: