Model penaakulan terkini OpenAI, o3‑pro, mewakili lonjakan ketara dalam prestasi dan keupayaan untuk aplikasi dipacu AI. Dilancarkan pada awal Jun 2025, o3‑pro menawarkan penaakulan lanjutan, pemahaman pelbagai mod dan penggunaan alat kepada pembangun dan perusahaan—semuanya pada harga premium. Artikel ini mensintesis pengumuman terkini, laporan pengguna dan data penanda aras untuk memberikan gambaran keseluruhan yang komprehensif tentang prestasi, pertimbangan kos dan ketersediaan o3‑pro.

Apakah o3‑pro?

Tawaran terbaharu OpenAI, o3‑pro, menandakan peristiwa penting dalam model penaakulan AI dengan menggabungkan keupayaan yang dipertingkatkan dengan tanda harga premium. Dilancarkan pada 11 Jun 2025, o3‑pro menjayakan model o3 standard dan menggantikan o1‑pro dalam barisan produk OpenAI, menyasarkan pembangun dan perusahaan yang mengutamakan analisis mendalam dan kebolehpercayaan berbanding kelajuan mentah. Dibina pada seni bina asas yang sama seperti o3—yang mula-mula diperkenalkan pada April 2025—o3‑pro menyepadukan carian web masa nyata, analisis fail, penaakulan visual, pelaksanaan Python dan ciri ingatan lanjutan, menangani aliran kerja yang kompleks dalam sains, pengaturcaraan, perniagaan dan penulisan. Walau bagaimanapun, pendekatan penaakulan model yang disengajakan menimbulkan kependaman yang lebih lama dan peningkatan kos yang besar, mencerminkan reka bentuk intensif pengiraannya.

Apakah yang membezakan o3‑pro daripada model o3 standard?

Penaakulan Multimodal Lanjutan

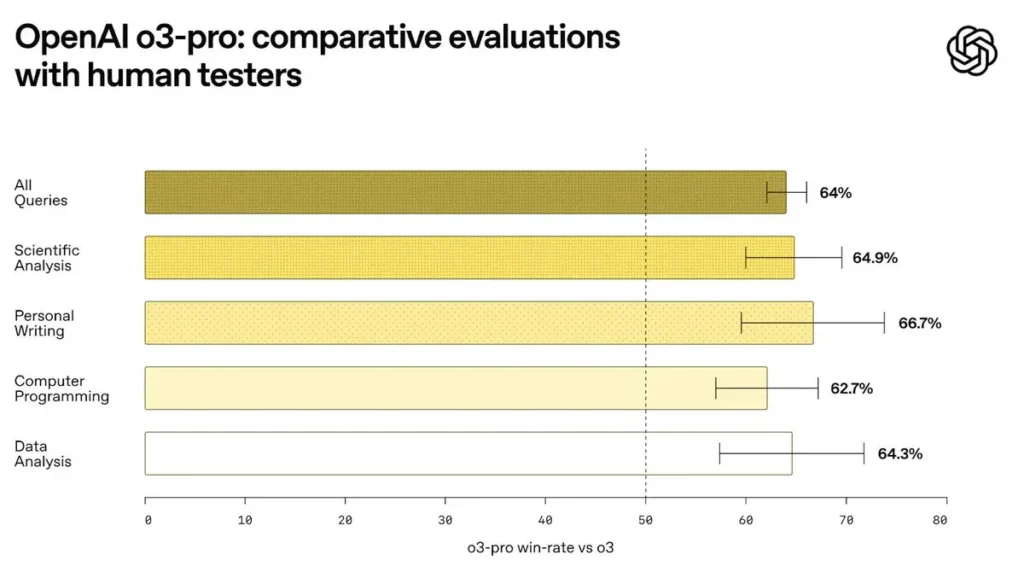

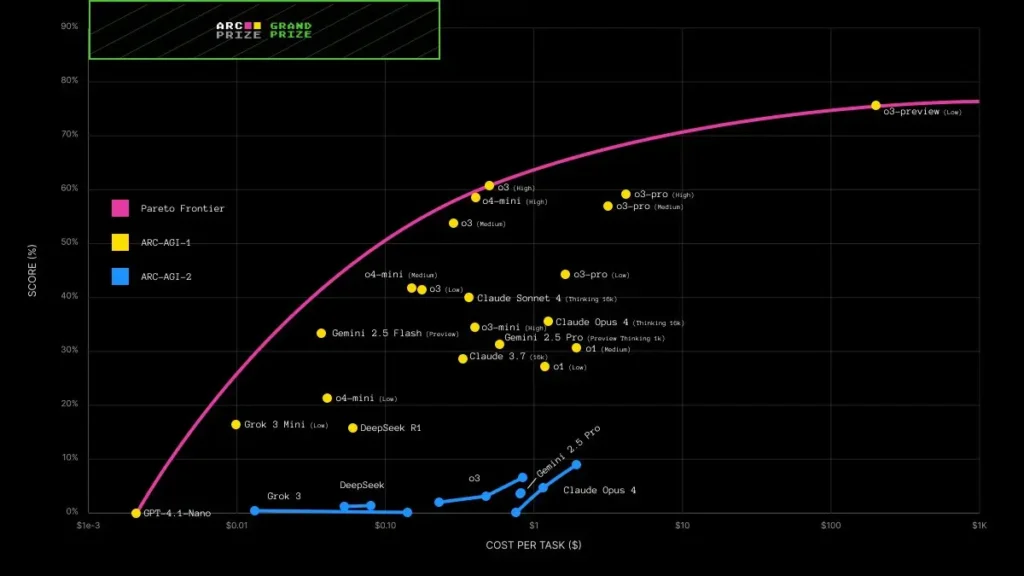

OpenAI telah menilai dengan teliti o3‑pro merentas pelbagai penilaian AI standard untuk mengesahkan kehebatan penaakulannya. Dalam domain matematik, o3‑pro mengatasi prestasi Google Gemini 2.5 Pro pada penanda aras AIME 2024, menunjukkan penaakulan logik yang unggul dan penyelesaian persamaan kompleks dalam keadaan bermasa . Begitu juga, pada penanda aras GPQA Diamond—yang mengukur pemahaman saintifik peringkat PhD dan penyelesaian masalah—o3‑pro mengatasi Claude 4 Opus Anthropic, menggariskan kedalamannya dalam penaakulan saintifik lanjutan.

o3‑pro membina kekuatan model o3 perdana OpenAI dengan menyepadukan penyemakan imbas web masa nyata, analisis fail, pemahaman visual dan pelaksanaan Python semasa penerbangan ke dalam antara muka tunggal. Menurut OpenAI, keupayaan penaakulan yang dipertingkatkan ini membolehkan o3‑pro menangani tugas yang rumit—seperti tafsiran data saintifik, penyahpepijatan kod bentuk panjang dan penjanaan kandungan berbilang mod—dengan kebolehpercayaan yang lebih tinggi daripada pendahulunya.

Kebolehpercayaan berbanding Latensi

Keupayaan baharu ini disertakan dengan pertukaran: masa tindak balas o3‑pro adalah lebih perlahan daripada o3, mencerminkan langkah pengiraan dan pemprosesan konteks tambahan yang diperlukan untuk penggunaan alat lanjutan. Pengguna awal melaporkan latensi tipikal 1.5–2× latensi o3 pada gesaan yang setara, walaupun angka tepat berbeza-beza berdasarkan kerumitan permintaan.

Had Ciri semasa Pelancaran

Semasa pelancaran, pengguna o3‑pro melihat beberapa pengehadan sementara: penjanaan imej kekal tidak tersedia, dan ciri ChatGPT tertentu—seperti sesi “Kanvas” yang tidak lama dan urutan sembang sementara—dilumpuhkan manakala OpenAI menskalakan infrastruktur untuk model baharu . Sekatan ini dijangka berkurangan dalam beberapa bulan akan datang apabila kapasiti berkembang.

Bagaimanakah prestasi o3‑pro pada penanda aras industri?

Ujian Penaakulan Piawai

Dalam ujian dalaman, o3‑pro mengatasi o3 dengan margin yang ketara pada suite penaakulan piawai yang meliputi matematik, teka-teki logik dan cabaran pengaturcaraan. Markah yang dilaporkan oleh komuniti meletakkan o3 pada kira-kira 2,517 mata, manakala skor o3-pro menghampiri 2,748—anggaran 9% peningkatan .

Penilaian Pengekodan Dunia Sebenar

Pembangun yang menjalankan tugas penjanaan kod langsung dan penyahpepijatan telah memerhatikan bahawa o3‑pro menghasilkan output yang lebih tepat dari segi sintaksis dan semantik dalam tetapan satu tangkapan dan beberapa tangkapan. Penanda aras pada repositori pengekodan seperti CodeSearchNet menunjukkan peningkatan 5–7% dalam ketepatan fungsi berbanding o3, terutamanya pada masalah konteks panjang melebihi 4,000 token.

Prestasi Perbandingan Menentang Pesaing

Dalam ujian head-to-head, o3‑pro bukan sahaja mengalahkan Gemini 2.5 Pro dan Claude 4 Opus pada skor mentah tetapi juga memberikan output yang lebih konsisten di bawah ujian tekanan lawan .Dengan menggabungkan pengendalian input berbilang mod dan penggunaan alat dinamik, o3‑pro mengecilkan jurang dengan model khusus Google Claude seperti Pascal Claude dan Anthropic. ujian head-to-head menunjukkan bahawa o3‑pro sepadan atau melebihi ketepatan pesaing pada penanda aras penaakulan yang kompleks, walaupun laporan pihak ketiga yang komprehensif masih akan dikeluarkan.

Apakah struktur harga yang sepatutnya dijangkakan oleh pembangun?

Model Pengebilan Berasaskan Token

OpenAI meneruskan pengebilan berasaskan tokennya: o3‑pro berharga $20 setiap juta token input dan $80 setiap juta token keluaran—tepat sepuluh kali ganda kos model o3 standard selepas potongan harganya baru-baru ini. Sebaliknya, o3 kini berjalan pada $2 setiap juta token input dan $8 setiap juta token keluaran berikutan pengurangan harga sebanyak 80% pada awal Jun 2025.

| model | Harga Token Input | Harga Token Output |

|---|---|---|

| o3 | $2 / 1J token | $8 / 1J token |

| o3‑pro | $20 / 1J token | $80 / 1J token |

Rasional Di Sebalik Premium

Kenaikan harga sepuluh kali ganda ini mencerminkan sumber pengiraan tambahan, infrastruktur pemprosesan tinggi dan penyepaduan alatan khusus permintaan o3‑pro. OpenAI meletakkan o3‑pro sebagai model “kritikal misi” untuk aplikasi yang ketepatan dan penaakulan lanjutan membenarkan premium kos.

Diskaun Kelantangan dan API Kelompok

Perusahaan memproses volum besar token masih boleh memanfaatkan API Batch untuk menjimatkan sehingga 50% pada input dan output yang dicache. Walaupun mekanisme ini memberi manfaat terutamanya kepada pengguna volum tinggi varian GPT‑4.1, pilihan batching yang serupa dijangka akan dilancarkan untuk model o‑siri kemudian pada tahun 2025.

Bagaimanakah pembangun dan pasukan boleh mengakses o3‑pro?

Ketersediaan API

Dalam ujian head-to-head, o3‑pro bukan sahaja mengalahkan Gemini 2.5 Pro dan Claude 4 Opus pada skor mentah tetapi juga memberikan output yang lebih konsisten di bawah ujian tekanan lawan.

OpenAI menjadikan o3‑pro boleh diakses melalui API awamnya pada 10 Jun 2025, dengan sokongan segera dalam kedua-dua titik akhir Completions dan Chat. Pemaju boleh menentukan "o3-pro" model dalam panggilan API mereka, tertakluk pada had kadar dan kekangan kuota yang terikat pada peringkat langganan mereka.

POST https://api.openai.com/v1/chat/completions

{

"model": "o3-pro",

"messages": ,

"max_tokens": 1500

}

ChatGPT Pro & Rancangan Pasukan

Pelanggan ChatGPT Pro dan Pasukan mendapat akses terus kepada o3‑pro dalam antara muka ChatGPT. Pengguna boleh menogol antara o3 dan o3‑pro dalam pemilih model, walaupun ketersediaan awal terhad kepada subset pelanggan perusahaan dan penguji beta .

Melalui API CometAPI

Pembangun boleh mengakses API o3-Pro(model: ”o3-Pro"Atau"o3-pro-2025-06-10”) melalui CometAPI, model terkini yang disenaraikan adalah pada tarikh penerbitan artikel. Untuk memulakan, terokai keupayaan model dalam Taman Permainan dan berunding dengan Panduan API untuk arahan terperinci. Sebelum mengakses, sila pastikan anda telah log masuk ke CometAPI dan memperoleh kunci API. CometAPI menawarkan harga yang jauh lebih rendah daripada harga rasmi untuk membantu anda menyepadukan.

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.cometapi.com/v1",

api_key="<YOUR_API_KEY>",

)

response = client.chat.completions.create(

model="o3-Pro",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices.message.content

print(f"Assistant: {message}")

Apakah kes penggunaan praktikal yang paling mendapat manfaat daripada o3‑pro?

Penyelidikan Saintifik & Analisis Data

Penyelidik yang bekerja dengan set data yang besar—bermula daripada genomik hingga simulasi iklim—boleh memanfaatkan analisis fail o3‑pro dan keupayaan pelaksanaan Python untuk mengautomasikan ujian hipotesis dan menjana cerapan tanpa kekangan panjang konteks.

Aliran Kerja Pengetahuan Perusahaan

Dalam sektor seperti kewangan dan perkhidmatan perundangan, di mana ketepatan dan kebolehauditan adalah terpenting, pematuhan arahan yang dipertingkatkan dan penaakulan pelbagai mod mengurangkan kadar ralat dalam semakan kontrak, pemodelan kewangan dan tugas pematuhan peraturan.

Pembangunan Perisian & DevOps

Dengan menggabungkan pemahaman kod konteks panjang dengan ujian langsung melalui pelaksanaan Python, o3‑pro memperkemas penyahpepijatan dan mengautomasikan aliran kerja pemfaktoran semula yang kompleks, mempercepatkan kitaran penghantaran untuk projek perisian berskala besar.

Apakah yang perlu dipertimbangkan oleh organisasi sebelum menaik taraf?

Analisis Kos Faedah

Pasukan mesti menimbang kenaikan harga 10× berbanding unjuran keuntungan kecekapan. Untuk tugasan bernilai tinggi, volum rendah—seperti merangka laporan strategik atau membina sistem keselamatan kritikal—ketepatan dan sokongan perkakasan mungkin membenarkan premium o3‑pro. Untuk penjanaan kandungan pukal, menggunakan model o3 atau o4‑mini standard mungkin lebih menjimatkan.

Kesediaan Infrastruktur

Oleh kerana o3‑pro mengenakan kependaman dan permintaan pemprosesan yang lebih tinggi, organisasi harus mengaudit had kadar API, kapasiti rangkaian dan strategi cuba semula ralat mereka untuk mengelakkan kesesakan semasa penggunaan puncak .

Kesimpulannya

Model o3‑pro OpenAI menetapkan bar baharu untuk penaakulan lanjutan, pemahaman pelbagai mod dan penggunaan alat bersepadu dalam AI. Keuntungan penanda aras dan peningkatan kebolehpercayaannya menjadikannya pilihan yang menarik untuk aplikasi kritikal misi, dengan syarat belanjawan dan infrastruktur boleh menyokong kos yang meningkat. Apabila landskap AI berkembang, peranan o3‑pro akan semakin kukuh dalam bidang yang menuntut tahap ketepatan dan kedalaman kontekstual tertinggi, manakala beban kerja yang lebih sensitif kos mungkin terus memanfaatkan model siri asas atau varian mini yang muncul.