LobeChat en CometAPI zijn twee snelgroeiende projecten in het open AI-ecosysteem. In september 2025 voegde LobeChat een volledige CometAPI-providerintegratie toe, waardoor het eenvoudig is om de uniforme, OpenAI-compatibele eindpunten van CometAPI vanuit LobeChat aan te roepen. Dit artikel legt uit wat LobeChat en CometAPI zijn, waarom je ze zou integreren, stapsgewijze integratie en configuratie (inclusief een gebruiksklare TypeScript-providerbasisconfiguratie), runtimevoorbeelden, concrete use cases en productietips voor kosten, betrouwbaarheid en observeerbaarheid.

Wat is LobeChat en welke functies biedt het?

LobeChat is een open-source, modern chatframework, ontworpen om multi-provider LLM-chatapplicaties te hosten met een verfijnde gebruikersinterface en implementatietools. Het is gebouwd om multimodale input (tekst, afbeeldingen, audio), kennisbank-/RAG-workflows, vertakkende conversaties en 'chain of thought'-visualisaties te ondersteunen, plus een uitbreidbaar provider-/plug-insysteem, zodat u verschillende modelbackends kunt gebruiken zonder uw app opnieuw te hoeven ontwerpen. De documentatie en repository van LobeChat presenteren het als een productieklaar framework voor zowel zelfgehoste als cloudimplementaties, met omgevingsgestuurde configuratie en een marktplaats voor MCP-integraties (Model Control Plane) van derden.

Belangrijkste LobeChat-mogelijkheden in één oogopslag

- Ondersteuning voor meerdere providers (OpenAI, Anthropic, Google Gemini, Ollama, enz.).

- Bestanden uploaden + kennisbank voor RAG-workflows (documenten, PDF's, audio).

- Ontwikkelaarsvriendelijke configuratie via omgevingsvariabelen en instellingen-URL-import.

- Uitbreidbare runtime: providers worden geconfigureerd met kleine adapter-runtimes, zodat nieuwe backends pluggable zijn.

Wat is CometAPI?

CometAPI is een uniforme AI-toegangslaag die meer dan 500 modellen van vele onderliggende providers beschikbaar stelt via één, OpenAI-compatibel API-platform. Het is zo gepositioneerd dat ontwikkelaars modeleindpunten kunnen selecteren op basis van prestaties, kosten of mogelijkheden zonder dat ze ergens aan vastzitten, en om facturering, routering en toegang te centraliseren. CometAPI adverteert uniforme eindpunten voor chat/voltooiingen en een API voor modellenlijsten om beschikbare model-ID's te ontdekken.

Waarom CometAPI aantrekkelijk is voor teams

- Modelkeuze en draagbaarheid: Schakelen tussen vele geavanceerde modellen zonder de integratiecode significant te veranderen.

- OpenAI-compatibele eindpunten: Veel clientbibliotheken en frameworks die HTTP-eindpunten in OpenAI-stijl verwachten, kunnen met CometAPI werken door de basis-URL + auth te wijzigen. (Praktische voorbeelden laten zien

https://api.cometapi.com/v1/(als een OpenAI-compatibel oppervlak.) - Ontwikkelaarsdocumentatie en integraties: CometAPI publiceert documentatie en stapsgewijze handleidingen voor integratie met tools zoals LlamaIndex en andere low-codeplatformen.

Waarom zou u CometAPI in LobeChat integreren?

Kort antwoord: flexibiliteit, kostenbeheersing en snelle toegang tot nieuwe modellenLobeChat is gebouwd om provideronafhankelijk te zijn; door CometAPI te integreren, kan uw LobeChat-implementatie veel verschillende modellen via hetzelfde codepad aanroepen. U kunt modellen verwisselen voor doorvoer, latentie, kosten of functionaliteit zonder uw gebruikersinterface of promptflows te wijzigen. Bovendien hebben de community en beheerders actief CometAPI-providerondersteuning aan LobeChat toegevoegd, waardoor de integratie soepeler verloopt.

Zakelijke en technische voordelen

- Modeldiversiteit zonder code-verloop. Moet je Gemini, Claude of een niche-imagemodel evalueren? CometAPI kan die model-ID's via één API beschikbaar stellen. Dit vermindert de hoeveelheid per-provider-pipeline in LobeChat.

- Kostenoptimalisatie. Met CometAPI kunt u routeren naar goedkopere modellen of dynamisch goedkopere providers selecteren, wat de kosten per gesprek bij implementaties met een groot volume aanzienlijk kan verlagen.

- Eenvoudiger geheimbeheer. Eén API-sleutel om te beheren in de instellingen van LobeChat of de Docker-omgeving in plaats van meerdere providersleutels. Het LobeChat-platform ondersteunt al het inschakelen van een provider via

ENABLED_<PROVIDER>en een provider key env var-patroon, zodat de integratie operationeel consistent is. - Houdt de LobeChat-codebase minimaal: providerlogica is ingekapseld en geconfigureerd met env-variabelen.

Hoe stel ik CometAPI in en integreer ik deze in LobeChat?

Deze sectie biedt een uitvoerbaar, stapsgewijs recept: sleutels verkrijgen, omgevingsvariabelen instellen, de provider toevoegen aan LobeChat (voorbeeld van providerconfiguratie) en runtimegebruik weergeven (chatgesprek). De voorbeelden volgen de providerpatronen van LobeChat en de OpenAI-compatibele eindpunten van CometAPI.

1) Vraag een CometAPI-account en API-sleutel aan

Meld je aan bij CometAPI en open de API-console. Om een CometAPI-account te registreren, moet je een e-mailadres gebruiken of rechtstreeks inloggen met Google One-Click.

Nadat u de registratie hebt voltooid, gaat u naar de speeltuin en klikt u op 'Nieuwe geheime sleutel toevoegen' om een nieuwe API-sleutel aan te maken:

Vraag een API-sleutel aan.

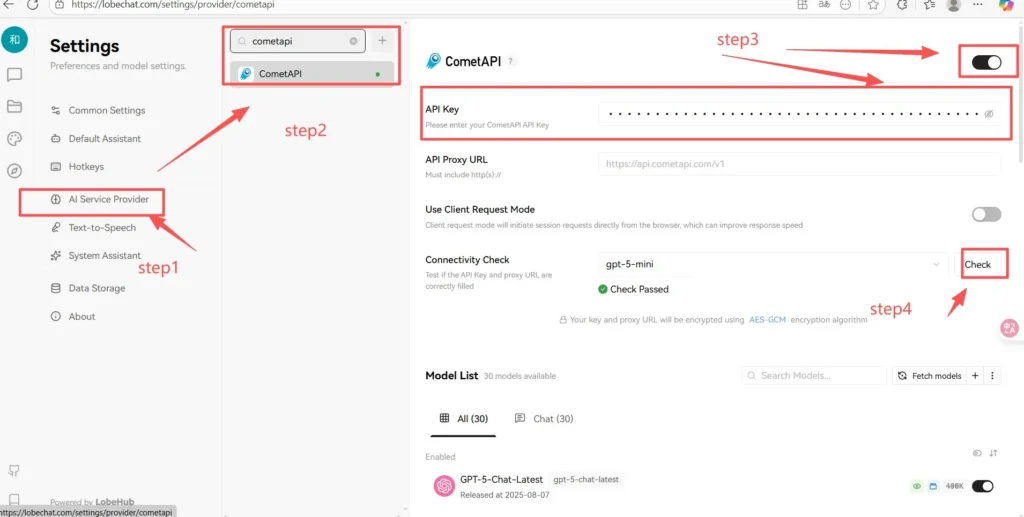

2) CometAPI configureren in LobeChat

- Ga naar het instellingenmenu van Lobe-Chat, klik op de avatar en klik op de optie Toepassingsinstellingen.

- Selecteer cometapi als modelaanbieder.

- Plak de sk-xxxxx van cometapi in het invoerveld van de API-sleutel en schakel de knop in. Selecteer één model om te controleren.

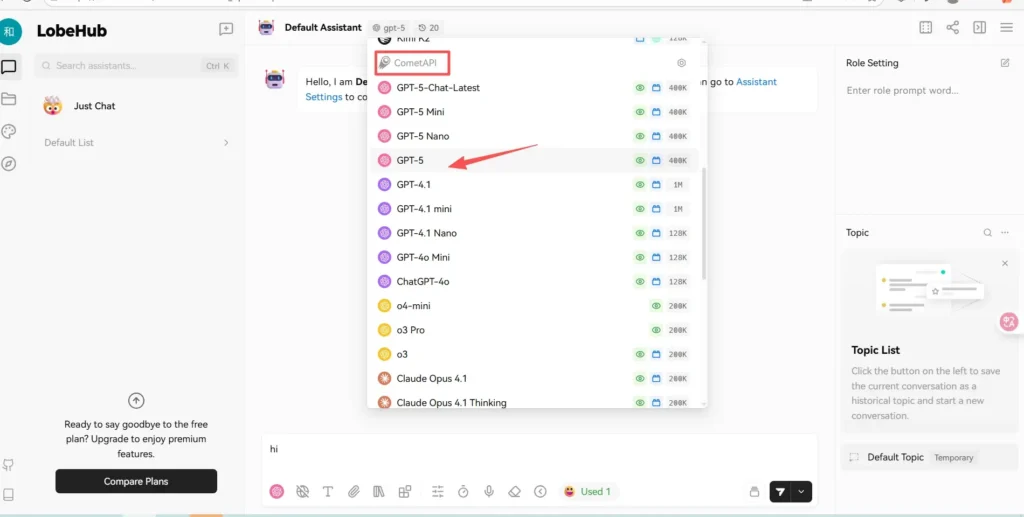

3) Het gesprek testen

Selecteer het model van CometAPI dat u wilt controleren. Voer een eenvoudige testopdracht in Lobe-Chat in. Als de verbinding succesvol is, ontvangt u een bijbehorend antwoord. Als de verbinding mislukt, controleer dan of de configuratie correct is of neem contact op met de online klantenservice van CometAPI.

Momenteel biedt cometapi meer dan 30 nieuwste modellen van grote ontwikkelaars (openAI, grok, claude, gemini) aan op lobechat.

Hoe kunt u de integratie uitbreiden (geavanceerde verbeteringen)?

Wilt u verder gaan dan de basis? Hier zijn solide vervolgstappen die uw integratie van functioneel naar productieniveau tillen.

Verbetering 1: Dynamische modelorkestratie (multi-model agents)

Creëer agentlogica in LobeChat die subtaken dynamisch toewijst aan verschillende Comet-modellen (bijv. een klein inbeddingsmodel voor ophalen, een middelgroot model voor opstellen, een model met hoge capaciteit voor samenvattingen). Gebruik het functieaanroep-/plug-insysteem van LobeChat om de workflow te coördineren en definitieve antwoorden te verzamelen.

Verbetering 2: Inbeddingen en reacties cachen

Wanneer u embeddings gebruikt (voor RAG), bereken de embeddings dan één keer en cache ze om de overhead te verminderen. Als u CometAPI aanroept voor embeddings, sla dan vectorrepresentaties op in uw vectordatabase en bereken ze alleen opnieuw bij inhoudelijke wijzigingen. Dit verlaagt het aantal tokens en de kosten.

Verbetering 3: Configuratie en quota per huurder

Als u een LobeChat-instantie met meerdere tenants uitvoert, kunt u de limieten per tenant (aanvragen/uur, modelniveaus) beheren door middleware te schrijven die de tenant-id → de lijst met toegestane modellen koppelt (met behulp van CometAPI-model-ID's). Dit maakt premiumniveaus mogelijk met toegang tot betere modellen.

Verbetering 4: Gebruik modelmetadata en statuscontroles

Implementeer provider-statuscontroles die een lichtgewicht CometAPI "model ping" of een minimale chatoproep aanroepen om ervoor te zorgen dat de latentie binnen de SLA's blijft; voorkom anders dat modellen terugvallen. Houd een heartbeatmonitor bij en presenteer de providerstatus in de LobeChat-beheerinterface.

Voor welke valkuilen moet je oppassen?

- API-sleutelblootstelling: Sla CometAPI-sleutels nooit op in clientcode. Bewaar ze altijd aan de serverzijde (de serverlaag van LobeChat).

- Modelnaam drift: CometAPI kan model-ID's toevoegen of afschaffen. Gebruik een servertoewijzing en update

COMETAPI_MODEL_LISTwanneer u nieuwe modellen wilt exposeren. - Verschillen in antwoordformatenHoewel CometAPI streeft naar OpenAI-compatibiliteit, kunnen sommige modellen of metagegevens afwijken. Breng daarom altijd reacties in kaart en desinfecteer ze voordat u ze aan gebruikers toont.

Beginnen

CometAPI is een uniform API-platform dat meer dan 500 AI-modellen van toonaangevende aanbieders – zoals de GPT-serie van OpenAI, Gemini van Google, Claude, Midjourney en Suno van Anthropic – samenvoegt in één, gebruiksvriendelijke interface voor ontwikkelaars. Door consistente authenticatie, aanvraagopmaak en responsverwerking te bieden, vereenvoudigt CometAPI de integratie van AI-mogelijkheden in uw applicaties aanzienlijk. Of u nu chatbots, beeldgenerators, muziekcomponisten of datagestuurde analysepipelines bouwt, met CometAPI kunt u sneller itereren, kosten beheersen en leveranciersonafhankelijk blijven – en tegelijkertijd profiteren van de nieuwste doorbraken in het AI-ecosysteem.

Om te beginnen, verken de mogelijkheden van het model in de Speeltuin en raadpleeg de API-gids voor gedetailleerde instructies. Zorg ervoor dat u bent ingelogd op CometAPI en de API-sleutel hebt verkregen voordat u toegang krijgt. KomeetAPI bieden een prijs die veel lager is dan de officiële prijs om u te helpen integreren.

Klaar om te gaan?→ Meld u vandaag nog aan voor CometAPI !

Conclusie

Het integreren van CometAPI in LobeChat is een praktische manier om modeldiversiteit, kostenflexibiliteit en snelle experimenteermogelijkheden te verkrijgen, terwijl de verfijnde UX- en RAG-functies van LobeChat behouden blijven. De LobeChat-community heeft al een flinke stap gezet om CometAPI-ondersteuning toe te voegen (providerkaart, modellijst, runtime-adapters, tests en documentatie), die u direct kunt gebruiken of als inspiratie kunt gebruiken om een aangepaste adapter voor specifieke behoeften te implementeren. Raadpleeg de documentatie van CometAPI en de LobeChat model-provider documentatie en repo - de onderstaande links helpen u verder.