Het nieuwste redeneermodel van OpenAI, o3-pro, vertegenwoordigt een aanzienlijke sprong voorwaarts in prestaties en mogelijkheden voor AI-gestuurde applicaties. o2025-pro, gelanceerd begin juni 3, biedt ontwikkelaars en bedrijven geavanceerde redeneermogelijkheden, multimodaal inzicht en toolgebruik – en dat alles tegen een premiumprijs. Dit artikel vat de meest recente aankondigingen, gebruikersrapporten en benchmarkgegevens samen om een uitgebreid overzicht te geven van de prestaties, kostenoverwegingen en beschikbaarheid van o3-pro.

Wat is o3‑pro?

OpenAI's nieuwste aanbod, o3-pro, markeert een belangrijke mijlpaal in AI-redeneringsmodellen door verbeterde mogelijkheden te combineren met een premium prijskaartje. o11-pro, gelanceerd op 2025 juni 3, is de opvolger van het standaard o3-model en vervangt de o1-pro in de productlijn van OpenAI. Het is gericht op ontwikkelaars en bedrijven die diepgaande analyse en betrouwbaarheid belangrijker vinden dan pure snelheid. Gebaseerd op dezelfde onderliggende architectuur als o3, oorspronkelijk geïntroduceerd in april 2025, integreert o3-pro realtime webzoekopdrachten, bestandsanalyse, visueel redeneren, Python-uitvoering en geavanceerde geheugenfuncties, waarmee complexe workflows in de wetenschap, programmering, bedrijfskunde en schrijftechnologie worden aangepakt. De doelbewuste redeneringsaanpak van het model brengt echter langere latenties en een aanzienlijke kostenstijging met zich mee, wat het rekenintensieve ontwerp weerspiegelt.

Wat onderscheidt de o3‑pro van het standaard o3-model?

Geavanceerd multimodaal redeneren

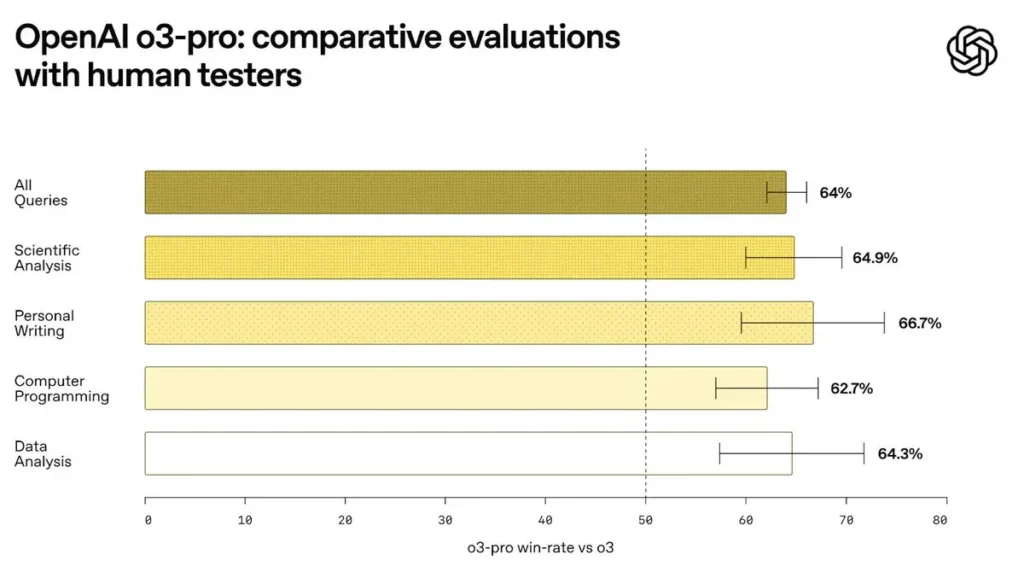

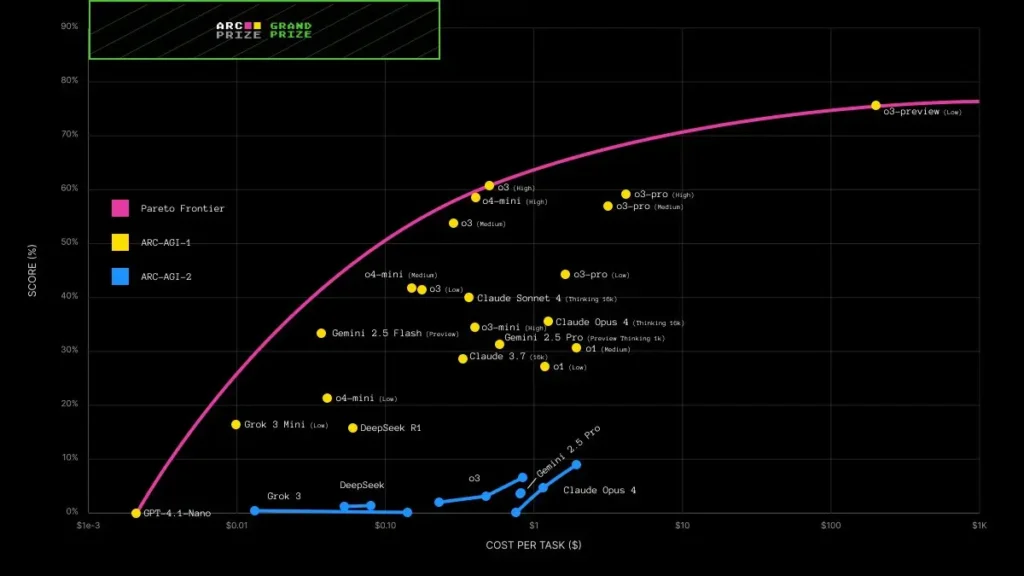

OpenAI heeft o3-pro grondig geëvalueerd aan de hand van meerdere standaard AI-beoordelingen om de redeneervaardigheden te valideren. Op wiskundig gebied presteert o3-pro beter dan Google's Gemini 2.5 Pro in de AIME 2024-benchmark, met superieure logische redenering en het oplossen van complexe vergelijkingen onder tijdsgebonden omstandigheden. Evenzo overtreft o3-pro Claude 4 Opus van Anthropic in de GPQA Diamond-benchmark – die wetenschappelijk inzicht en probleemoplossing op PhD-niveau meet – wat de diepgang van geavanceerd wetenschappelijk redeneren onderstreept.

o3-pro bouwt voort op de sterke punten van OpenAI's vlaggenschip o3-model door realtime webbrowsen, bestandsanalyse, visueel begrip en on-the-fly Python-uitvoering te integreren in één interface. Volgens OpenAI stelt deze verbeterde redeneercapaciteit o3-pro in staat om complexe taken – zoals wetenschappelijke data-interpretatie, het debuggen van lange code en het genereren van multimodale content – met een grotere betrouwbaarheid uit te voeren dan zijn voorganger.

Betrouwbaarheid boven latentie

Deze nieuwe mogelijkheden hebben nadelen: de responstijden van o3-pro zijn meetbaar trager dan die van o3, wat de extra reken- en contextverwerkingsstappen weerspiegelt die nodig zijn voor geavanceerd gebruik van de tool. Early adopters melden typische latenties van 1.5 tot 2 keer die van o3 bij equivalente prompts, hoewel de precieze cijfers variëren afhankelijk van de complexiteit van de aanvraag.

Functiebeperkingen bij de lancering

Bij de lancering merkten o3-pro-gebruikers een aantal tijdelijke beperkingen op: het genereren van afbeeldingen blijft onbeschikbaar en bepaalde ChatGPT-functies – zoals tijdelijke "Canvas"-sessies en tijdelijke chatthreads – zijn uitgeschakeld terwijl OpenAI de infrastructuur voor het nieuwe model opschaalt. Deze beperkingen zullen naar verwachting de komende maanden afnemen naarmate de capaciteit toeneemt.

Hoe presteert o3‑pro in industriële benchmarks?

Gestandaardiseerde redeneertesten

In interne tests presteerde o3-pro aanzienlijk beter dan o3 bij gestandaardiseerde redeneerpakketten voor wiskunde, logische puzzels en programmeeruitdagingen. Volgens de communityscores ligt o3 rond de 2,517 punten, terwijl o3-pro rond de 2,748 punten scoort – een verbetering van ongeveer 9%.

Evaluaties van real-world codering

Ontwikkelaars die live codegeneratie- en debugtaken uitvoeren, hebben opgemerkt dat o3-pro syntactisch correctere en semantisch nauwkeurigere outputs produceert in single-shot en few-shot-omgevingen. Benchmarks op codeerrepositories zoals CodeSearchNet laten een verbetering van 5-7% in functionele correctheid zien ten opzichte van o3, met name bij problemen met een lange context van meer dan 4,000 tokens.

Vergelijkbare prestaties ten opzichte van concurrenten

In directe tests verslaat o3‑pro niet alleen Gemini 2.5 Pro en Claude 4 Opus op basis van ruwe scores, maar levert het ook consistentere uitkomsten bij stresstests met tegengestelde factoren. Door multimodale invoerverwerking en dynamisch toolgebruik te combineren, verkleint o3‑pro de kloof met speciale modellen van concurrenten zoals Google PaLM en Anthropic Claude X. Uit eerdere directe tests blijkt dat o3‑pro de nauwkeurigheid van concurrenten evenaart of overtreft op het gebied van complexe redeneerbenchmarks, hoewel er nog uitgebreide rapporten van derden beschikbaar moeten komen.

Welke prijsstructuur mogen ontwikkelaars verwachten?

Token-gebaseerd factureringsmodel

OpenAI blijft tokengebaseerde facturering hanteren: o3-pro kost $ 20 per miljoen inputtokens en $ 80 per miljoen outputtokens – precies tien keer de kosten van het standaard o3-model na de recente prijsverlaging. O3 daarentegen draait nu op $ 2 per miljoen inputtokens en $ 8 per miljoen outputtokens, na een prijsverlaging van 80% eerder in juni 2025.

| Model | Input Token Prijs | Uitvoertokenprijs |

|---|---|---|

| o3 | $2 / 1 miljoen tokens | $8 / 1 miljoen tokens |

| o3‑pro | $20 / 1 miljoen tokens | $80 / 1 miljoen tokens |

Reden achter de premie

Deze vertienvoudiging van de prijs weerspiegelt de extra rekenkracht, high-throughput infrastructuur en gespecialiseerde toolingintegraties die o3-pro nodig heeft. OpenAI positioneert o3-pro als een "missiekritisch" model voor toepassingen waar nauwkeurigheid en geavanceerde redenering de hogere kosten rechtvaardigen.

Volumekortingen en batch-API

Bedrijven die grote hoeveelheden tokens verwerken, kunnen de Batch API nog steeds gebruiken om tot 50% te besparen op gecachte invoer en uitvoer. Hoewel dit mechanisme vooral voordelen biedt aan gebruikers met een groot volume aan GPT-4.1-varianten, worden vergelijkbare batchingopties naar verwachting later in 2025 uitgerold voor modellen uit de o-serie.

Hoe krijgen ontwikkelaars en teams toegang tot o3‑pro?

API-beschikbaarheid

Bij directe tests verslaat o3‑pro niet alleen Gemini 2.5 Pro en Claude 4 Opus op basis van de ruwe scores, maar levert het ook consistentere uitkomsten bij stresstests met tegengestelde factoren.

OpenAI maakte o3-pro op 10 juni 2025 toegankelijk via zijn publieke API, met directe ondersteuning in zowel de Completions- als Chat-eindpunten. Ontwikkelaars kunnen de "o3-pro" model in hun API-aanroepen, onderworpen aan tarieflimieten en quotabeperkingen die gekoppeld zijn aan hun abonnementsniveau.

POST https://api.openai.com/v1/chat/completions

{

"model": "o3-pro",

"messages": ,

"max_tokens": 1500

}

ChatGPT Pro & Team-abonnementen

ChatGPT Pro- en Team-abonnees krijgen direct toegang tot o3-pro binnen de ChatGPT-interface. Gebruikers kunnen in de modelselector schakelen tussen o3 en o3-pro, hoewel de initiële beschikbaarheid beperkt is tot een subgroep zakelijke klanten en bètatesters.

Via CometAPI API

Ontwikkelaars hebben toegang tot o3-Pro API(model: ”o3-Pro"of"o3-pro-2025-06-10") door KomeetAPIDe nieuwste modellen die in dit artikel worden vermeld, gelden vanaf de publicatiedatum van het artikel. Om te beginnen, verken de mogelijkheden van het model in de Speeltuin en raadpleeg de API-gids voor gedetailleerde instructies. Zorg ervoor dat u bent ingelogd op CometAPI en de API-sleutel hebt verkregen voordat u toegang krijgt. KomeetAPI bieden een prijs die veel lager is dan de officiële prijs om u te helpen integreren.

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.cometapi.com/v1",

api_key="<YOUR_API_KEY>",

)

response = client.chat.completions.create(

model="o3-Pro",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices.message.content

print(f"Assistant: {message}")

Welke praktische use cases profiteren het meest van o3‑pro?

Wetenschappelijk onderzoek en data-analyse

Onderzoekers die met grote datasets werken, van genomica tot klimaatsimulaties, kunnen gebruikmaken van de bestandsanalyse- en Python-uitvoeringsmogelijkheden van o3‑pro om hypothesetests te automatiseren en inzichten te genereren zonder beperkingen qua contextlengte.

Enterprise Knowledge Workflows

In sectoren als financiën en juridische dienstverlening, waar nauwkeurigheid en controleerbaarheid van het grootste belang zijn, zorgen de verbeterde naleving van instructies en multimodale redenering van o3‑pro voor een vermindering van de foutpercentages bij contractbeoordelingen, financiële modellen en taken op het gebied van naleving van wet- en regelgeving.

Softwareontwikkeling en DevOps

Door het combineren van lange-context codebegrip met live testen via Python-uitvoering, stroomlijnt o3-pro het debuggen en automatiseert het complexe refactoring-workflows, waardoor de leveringscycli voor grootschalige softwareprojecten worden versneld.

Waar moeten organisaties rekening mee houden voordat ze upgraden?

Kosten-batenanalyse

Teams moeten de prijsstijging van 10x afwegen tegen de verwachte efficiëntiewinst. Voor taken met een hoge waarde en een laag volume – zoals het opstellen van strategische rapporten of het bouwen van kritieke veiligheidssystemen – kunnen de nauwkeurigheid en tooling-ondersteuning de meerprijs van o3-pro rechtvaardigen. Voor het genereren van bulkcontent kan het voordeliger zijn om vast te houden aan standaard o3- of o4-mini-modellen.

Gereedheid van de infrastructuur

Omdat o3‑pro hogere eisen stelt aan latentie en doorvoer, moeten organisaties hun API-snelheidslimieten, netwerkcapaciteit en strategieën voor het opnieuw proberen van fouten controleren om knelpunten tijdens piekgebruik te voorkomen.

Concluderend

Het o3-pro-model van OpenAI legt de lat hoger voor geavanceerd redeneren, multimodaal begrip en geïntegreerd toolgebruik in AI. De benchmarkwinsten en verbeterde betrouwbaarheid maken het een aantrekkelijke optie voor bedrijfskritische applicaties, mits budgetten en infrastructuur de verhoogde kosten kunnen dragen. Naarmate het AI-landschap evolueert, zal de rol van o3-pro zich versterken in gebieden die de hoogste nauwkeurigheid en contextuele diepgang vereisen, terwijl meer kostengevoelige workloads mogelijk basismodellen uit de o-serie of opkomende minivarianten blijven gebruiken.