LobeChat og CometAPI er to raskt utviklende prosjekter i det åpne AI-økosystemet. I september 2025 slo LobeChat sammen en fullstendig CometAPI-leverandørintegrasjon som gjør det enkelt å kalle CometAPIs enhetlige, OpenAI-kompatible endepunkter fra LobeChat. Denne artikkelen forklarer hva LobeChat og CometAPI er, hvorfor du bør integrere dem, trinnvis integrasjon og konfigurasjon (inkludert en ferdiglaget TypeScript-leverandørbasiskonfigurasjon), kjøretidseksempler, konkrete brukstilfeller og produksjonstips for kostnad, pålitelighet og observerbarhet.

Hva er LobeChat, og hvilke funksjoner tilbyr det?

LobeChat er et moderne chat-rammeverk med åpen kildekode, designet for å være vert for LLM-chatapplikasjoner med flere leverandører, med et polert brukergrensesnitt og distribusjonsverktøy. Det er bygget for å støtte multimodale inndata (tekst, bilder, lyd), kunnskapsbase-/RAG-arbeidsflyter, forgreningssamtaler og "tankekjede"-visualiseringer, pluss et utvidbart leverandør-/plugin-system slik at du kan bytte mellom forskjellige modell-backends uten å måtte omstrukturere appen din. LobeChats dokumenter og repo presenterer det som et produksjonsklart rammeverk for både selvhostede og skybaserte distribusjoner, med miljødrevet konfigurasjon og en markedsplass for tredjeparts MCP-integrasjoner (modellkontrollplan).

Viktige LobeChat-funksjoner på et øyeblikk

- Støtte for flere leverandører (OpenAI, Anthropic, Google Gemini, Ollama, osv.).

- Filopplasting + kunnskapsbase for RAG-arbeidsflyter (dokumenter, PDF-er, lyd).

- Utviklervennlig konfigurasjon via miljøvariabler og import av URL-innstillinger.

- Utvidbar kjøretid: Leverandører er konfigurert med korte adapterkjøretider slik at nye backend-er kan plugges inn.

Hva er CometAPI?

CometAPI er et enhetlig AI-tilgangslag som eksponerer over 500 modeller fra mange underliggende leverandører gjennom en enkelt, OpenAI-kompatibel API-overflate. Det er posisjonert for å la utviklere velge modellendepunkter for ytelse, kostnad eller kapasitet uten bindingstid, og for å sentralisere fakturering, ruting og tilgang. CometAPI annonserer enhetlige endepunkter for chat/fullføringer og et modellliste-API for å oppdage tilgjengelige modell-ID-er.

Hvorfor CometAPI er attraktivt for team

- Modellvalg og bærbarhet: bytte mellom mange banebrytende modeller uten å endre integrasjonskoden vesentlig.

- OpenAI-kompatible endepunkter: Mange klientbiblioteker og rammeverk som forventer HTTP-endepunkter i OpenAI-stil kan fungere med CometAPI ved å endre basis-URL + autentisering. (Praktiske eksempler viser

https://api.cometapi.com/v1/som en OpenAI-kompatibel overflate.) - Utviklerdokumentasjon og integrasjoner: CometAPI publiserer dokumenter og trinnvise veiledninger for integrering med verktøy som LlamaIndex og andre lavkodeplattformer.

Hvorfor bør du integrere CometAPI i LobeChat?

Kort svar: fleksibilitet, kostnadskontroll og rask tilgang til nye modellerLobeChat er bygget for å være leverandøruavhengig. Ved å koble til CometAPI får LobeChat-distribusjonen din muligheten til å kalle mange forskjellige modeller gjennom samme kodebane – bytte modeller for gjennomstrømning, latens, kostnad eller kapasitet uten å endre brukergrensesnittet eller ledetekstflyten. I tillegg har fellesskapet og vedlikeholderne aktivt lagt til CometAPI-leverandørstøtte til LobeChat, noe som gjør integrasjonen smidigere.

Forretningsmessige og tekniske fordeler

- Modellmangfold uten kodekvilling. Trenger du å evaluere Gemini, Claude eller en nisjebasert bildemodell? CometAPI kan eksponere disse modell-ID-ene gjennom et enkelt API. Dette reduserer mengden leverandøravhengig manipulering i LobeChat.

- Kostnadsoptimalisering. CometAPI lar deg rute til billigere modeller eller velge rimeligere leverandører dynamisk, noe som kan redusere kostnadene per samtale betydelig for distribusjoner med stort volum.

- Enklere hemmelig håndtering. Én API-nøkkel som skal administreres i LobeChats innstillinger eller Docker-miljøet i stedet for flere leverandørnøkler. LobeChat-plattformen støtter allerede aktivering av en leverandør via

ENABLED_<PROVIDER>og et leverandørnøkkelmiljøvariabelmønster, slik at integrasjonen er driftsmessig konsistent. - Holder LobeChat-kodebasen minimal: leverandørlogikk er innkapslet og konfigurert med miljøvariabler.

Hvordan setter jeg opp og integrerer CometAPI i LobeChat?

Denne delen gir en handlingsrettet, trinnvis oppskrift: hent nøkler, angi miljøvariabler, legg til leverandøren i LobeChat (eksempel på leverandørkonfigurasjon), og vis kjøretidsbruk (chat-anrop). Eksemplene følger LobeChats leverandørmønstre og CometAPI OpenAI-kompatible endepunkter.

1) Skaff deg en CometAPI-konto og API-nøkkel

Registrer deg på CometAPI og åpne API-konsollen. For å registrere en CometAPI-konto må du bruke en e-postadresse eller logge inn direkte med Google One-Click.

Etter at du har fullført registreringen, gå til lekeplassen og klikk på legg til ny hemmelig nøkkel for å opprette en ny API-nøkkel:

Skaff deg en API-nøkkel.

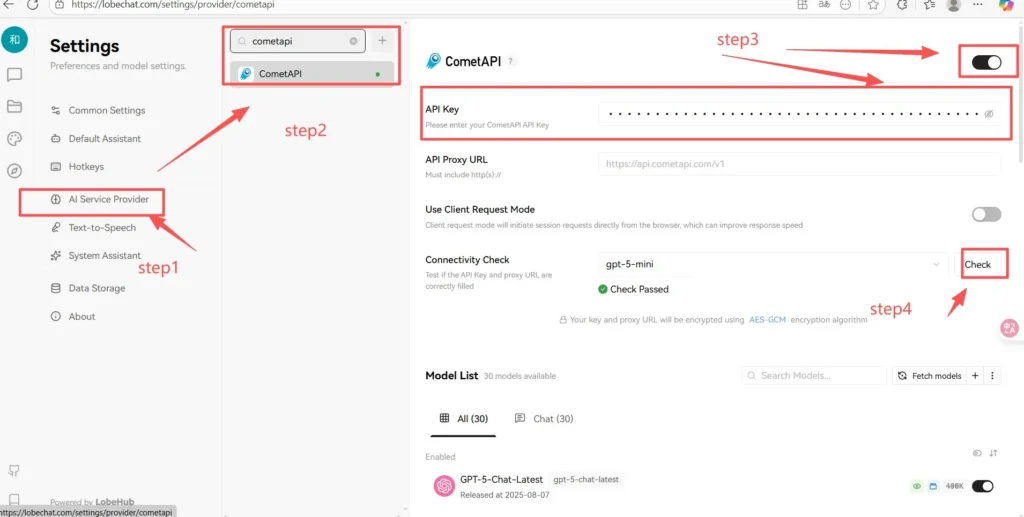

2) Konfigurering av CometAPI i LobeChat

- Gå inn i Lobe-Chat-innstillingsmenyen, klikk på avataren, og klikk på alternativet for programinnstillinger.

- Velg cometapi som modellleverandør.

- Lim inn sk-xxxxx fra cometapi i API-nøkkelfeltet og slå på knappen. Velg én modell du vil sjekke.

3) Testing av samtalen

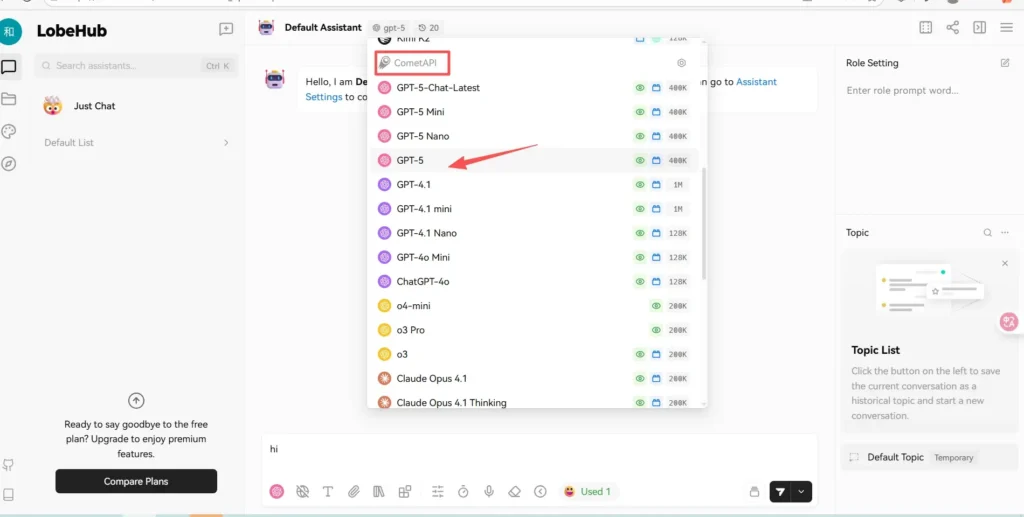

Velg CometAPIs modell for å sjekke. Skriv inn en enkel testkommando i Lobe-Chat. Hvis samtalen er vellykket, vil du motta et tilsvarende svar. Hvis den mislykkes, sjekk om konfigurasjonen er riktig eller kontakt cometapis kundeservice på nett.

For øyeblikket tilbyr cometapi mer enn 30 av de nyeste modellene fra store utviklere (OpenAI, Grok, Claude, Gemini) på Lobechat.

Hvordan kan du utvide integrasjonen (avanserte forbedringer)?

Vil du gå utover det grunnleggende? Her er solide neste steg som tar integrasjonen din fra funksjonell til produksjonsnivå.

Forbedring 1: Dynamisk modellorkestrering (multimodellagenter)

Lag agentlogikk i LobeChat som dynamisk farmer deloppgaver til forskjellige Comet-modeller (f.eks. liten innebyggingsmodell for henting, middels modell for utkast, høykapasitetsmodell for oppsummering). Bruk LobeChats funksjonskall/plugin-system for å koordinere arbeidsflyten og aggregere endelige svar.

Forbedring 2: Bufring av innebygde elementer og svar

Når du bruker innebygginger (for RAG), beregn innebyggingene én gang og mellomlagr dem for å redusere overhead. Hvis du kaller CometAPI for innebygginger, lagre vektorrepresentasjoner i vektordatabasen din og beregn bare på nytt ved innholdsendringer. Dette reduserer tokens og kostnader.

Forbedring 3: Konfigurasjon og kvoter per leietaker

Hvis du kjører en LobeChat-instans med flere leietakere, kan du kontrollere grensene per leietaker (forespørsler/time, modellnivåer) ved å skrive en mellomvare som kartlegger leietaker-ID → tillatt modellliste (ved hjelp av CometAPI-modell-IDer). Dette gir premiumnivåer tilgang til bedre modeller.

Forbedring 4: Bruk modellmetadata og tilstandskontroller

Implementer helsesjekker for leverandøren som kaller en lett CometAPI-"modellping" eller et minimalt chat-kall for å sikre at latensen er innenfor tjenestenivåavtalene; ellers må du ikke bruke fallback-modeller på en elegant måte. Overvåk pulsen og presenter leverandørstatusen i LobeChat-administratorgrensesnittet.

Hvilke fallgruver bør du være oppmerksom på?

- API-nøkkeleksponeringLagre aldri CometAPI-nøkler i klientkode. Oppbevar dem alltid på serversiden (LobeChats serverlag).

- ModellnavndriftCometAPI kan legge til eller avvikle modell-ID-er. Bruk en servertilordning og oppdatering.

COMETAPI_MODEL_LISTnår du vil vise frem nye modeller. - Forskjeller i svarformatSelv om CometAPI sikter mot OpenAI-kompatibilitet, kan noen modeller eller metafelt variere; kartlegg og rengjør alltid svar før du viser dem til brukerne.

Komme i gang

CometAPI er en enhetlig API-plattform som samler over 500 AI-modeller fra ledende leverandører – som OpenAIs GPT-serie, Googles Gemini, Anthropics Claude, Midjourney, Suno og flere – i ett enkelt, utviklervennlig grensesnitt. Ved å tilby konsistent autentisering, forespørselsformatering og svarhåndtering, forenkler CometAPI dramatisk integreringen av AI-funksjoner i applikasjonene dine. Enten du bygger chatboter, bildegeneratorer, musikkomponister eller datadrevne analysepipeliner, lar CometAPI deg iterere raskere, kontrollere kostnader og forbli leverandøruavhengig – alt samtidig som du utnytter de nyeste gjennombruddene på tvers av AI-økosystemet.

For å begynne, utforsk modellens muligheter i lekeplass og konsulter API-veiledning for detaljerte instruksjoner. Før du får tilgang, må du sørge for at du har logget inn på CometAPI og fått API-nøkkelen. CometAPI tilby en pris som er langt lavere enn den offisielle prisen for å hjelpe deg med å integrere.

Klar til å dra? → Registrer deg for CometAPI i dag !

Konklusjon

Å integrere CometAPI i LobeChat er en praktisk måte å oppnå modellmangfold, kostnadsfleksibilitet og rask eksperimenteringsmulighet, samtidig som man beholder de polerte UX- og RAG-funksjonene som LobeChat tilbyr. LobeChat-fellesskapet har allerede gjort et betydelig arbeid for å legge til CometAPI-støtte (leverandørkort, modellliste, runtime-adaptere, tester og dokumenter), som du kan utnytte direkte eller bruke som inspirasjon til å implementere en tilpasset adapter for spesialiserte behov. For de mest nøyaktige integrasjonstrinnene og de nyeste eksemplene, se CometAPIs dokumenter og Dokumentasjon for LobeChat-modellleverandør og repo – lenkene som er referert til nedenfor vil hjelpe deg med å fortsette.