OpenAIs nyeste resonneringsmodell, o3-pro, representerer et betydelig sprang i ytelse og kapasitet for AI-drevne applikasjoner. O2025-pro ble lansert tidlig i juni 3 og tilbyr utviklere og bedrifter avansert resonnering, multimodal forståelse og verktøybruk – alt til en premiumpris. Denne artikkelen sammenfatter de nyeste kunngjøringene, brukerrapportene og referansedataene for å gi en omfattende oversikt over O3-Pros ytelse, kostnadsvurderinger og tilgjengelighet.

Hva er o3-pro?

OpenAIs nyeste tilbud, o3-pro, markerer en betydelig milepæl innen AI-resonnementsmodeller ved å kombinere forbedrede funksjoner med en premiumpris. O11-pro ble lansert 2025. juni 3 og etterfølger standard o3-modellen og erstatter o1-pro i OpenAIs produktsortiment, og retter seg mot utviklere og bedrifter som prioriterer dyp analyse og pålitelighet fremfor rå hastighet. O3-pro er bygget på samme underliggende arkitektur som o2025 – opprinnelig introdusert i april 3 – og integrerer sanntids nettsøk, filanalyse, visuell resonnering, Python-kjøring og avanserte minnefunksjoner, og håndterer komplekse arbeidsflyter innen vitenskap, programmering, forretningsdrift og skriving. Modellens bevisste resonnementstilnærming medfører imidlertid lengre forsinkelser og en betydelig kostnadsøkning, noe som gjenspeiler dens beregningsintensive design.

Hva skiller o3‑pro fra standard o3-modellen?

Avansert multimodal resonnering

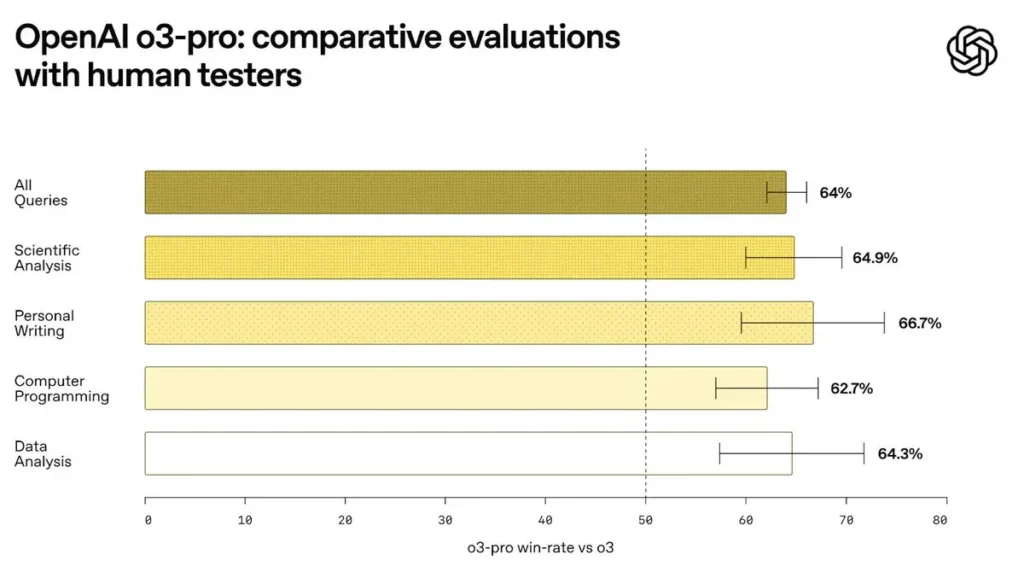

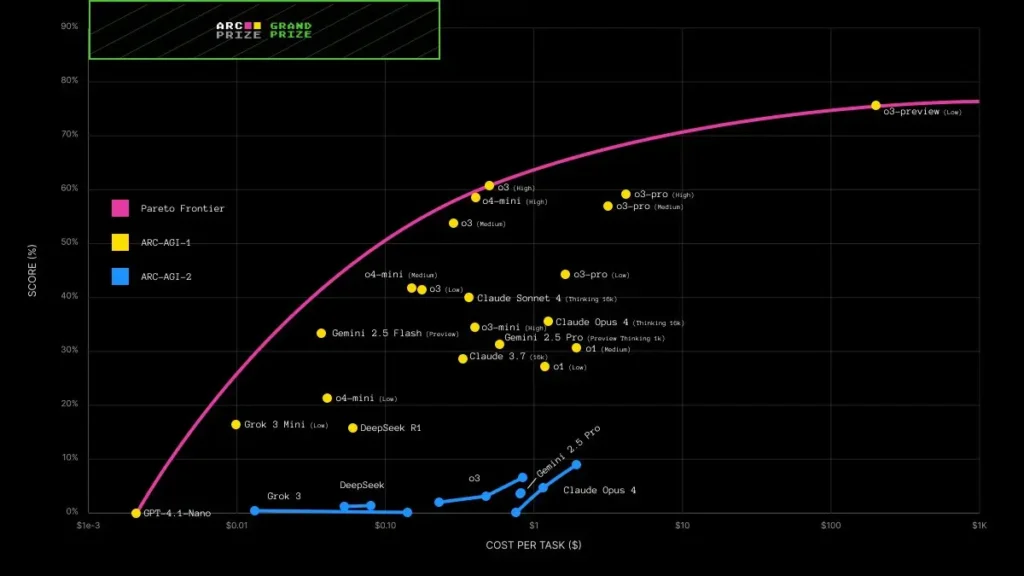

OpenAI har grundig evaluert o3-pro på tvers av flere standard AI-vurderinger for å validere dens resonneringsevner. Innen matematikk overgår o3-pro Googles Gemini 2.5 Pro på AIME 2024-referanseindeksen, og demonstrerer overlegen logisk resonnering og kompleks ligningsløsning under tidsbestemte forhold. På samme måte overgår o3-pro Anthropics Claude 4 Opus på GPQA Diamond-referanseindeksen – som måler vitenskapelig forståelse og problemløsning på PhD-nivå, og understreker dens dybde innen avansert vitenskapelig resonnering.

o3-pro bygger på styrkene til OpenAIs flaggskipmodell o3 ved å integrere sanntids nettsurfing, filanalyse, visuell forståelse og Python-kjøring underveis i ett enkelt grensesnitt. Ifølge OpenAI lar denne forbedrede resonneringsevnen o3-pro takle komplekse oppgaver – som tolkning av vitenskapelige data, feilsøking av langformatkode og generering av multimodal innhold – med større pålitelighet enn forgjengeren.

Pålitelighet fremfor latens

Disse nye funksjonene kommer med kompromisser: o3-pros responstider er målbart langsommere enn o3, noe som gjenspeiler de ekstra beregnings- og kontekstbehandlingstrinnene som kreves for avansert verktøybruk. Tidlige brukere rapporterer typiske latenser på 1.5–2 ganger o3s på tilsvarende ledetekster, selv om de nøyaktige tallene varierer basert på forespørselskompleksitet.

Funksjonsbegrensninger ved lansering

Ved lanseringen la o3-pro-brukere merke til noen midlertidige begrensninger: bildegenerering er fortsatt utilgjengelig, og visse ChatGPT-funksjoner – som flyktige «Canvas»-økter og midlertidige chattetråder – er deaktivert mens OpenAI skalerer infrastruktur for den nye modellen. Disse begrensningene forventes å lette i løpet av de kommende månedene etter hvert som kapasiteten utvides.

Hvordan presterer o3‑pro på bransjestandarder?

Standardiserte resonneringstester

I interne tester overgikk o3-pro o3 med betydelig margin på standardiserte resonneringspakker som dekker matematikk, logiske oppgaver og programmeringsutfordringer. Poengsummer rapportert av lokalsamfunnet plasserer o3 på rundt 2,517 poeng, mens o3-pro scorer nær 2,748 – en forbedring på omtrent 9 %.

Evalueringer av koding i den virkelige verden

Utviklere som kjører live kodegenerering og feilsøkingsoppgaver har observert at o3-pro produserer mer syntaktisk korrekte og semantisk nøyaktige resultater i single-shot og few-shot settinger. Referansetester på kodelagre som CodeSearchNet viser en økning på 5–7 % i funksjonell korrekthet i forhold til o3, spesielt på langkontekstproblemer som overstiger 4,000 tokens.

Sammenlignende ytelse mot konkurrenter

I direkte tester slår ikke o3-pro bare Gemini 2.5 Pro og Claude 4 Opus på rå poengsummer, men leverer også mer konsistente resultater under kontradiktoriske stresstester. Ved å kombinere multimodal inputhåndtering og dynamisk verktøybruk, reduserer o3-pro gapet til spesialmodeller fra konkurrenter som Google PaLM og Anthropic Claude X. Tidlige direkte tester indikerer at o3-pro matcher eller overgår konkurrentenes nøyaktighet på komplekse resonnementsbenchmarks, selv om omfattende tredjepartsrapporter fortsatt er under utvikling.

Hvilken prisstruktur bør utviklere forvente?

Tokenbasert faktureringsmodell

OpenAI fortsetter sin tokenbaserte fakturering: o3-pro koster 20 dollar per million input-tokens og 80 dollar per million output-tokens – nøyaktig ti ganger prisen for standard o3-modellen etter det nylige priskuttet. Til sammenligning koster o3 nå 2 dollar per million input-tokens og 8 dollar per million output-tokens etter en prisreduksjon på 80 % tidligere i juni 2025.

| Modell | Input token-pris | Output Token Pris |

|---|---|---|

| o3 | $2 / 1 million tokens | $8 / 1 million tokens |

| o3-pro | $20 / 1 million tokens | $80 / 1 million tokens |

Begrunnelse bak premien

Denne tidoblingen av prisøkningen gjenspeiler de ekstra dataressursene, infrastrukturen med høy gjennomstrømning og spesialiserte verktøyintegrasjoner som o3-pro krever. OpenAI posisjonerer o3-pro som en «virksomhetskritisk» modell for applikasjoner der nøyaktighet og avansert resonnement rettferdiggjør kostnadspremien.

Volumrabatter og batch-API

Bedrifter som behandler store mengder tokener kan fortsatt bruke Batch API for å spare opptil 50 % på hurtigbufrede input og output. Selv om denne mekanismen først og fremst gagner brukere med høyt volum av GPT-4.1-varianter, forventes lignende batchalternativer å bli rullet ut for O-seriemodeller senere i 2025.

Hvordan kan utviklere og team få tilgang til o3‑pro?

API-tilgjengelighet

I direkte tester slår ikke bare o3-pro Gemini 2.5 Pro og Claude 4 Opus på rå poengsummer, men leverer også mer konsistente resultater under kontradiktoriske stresstester.

OpenAI gjorde o3-pro tilgjengelig via sitt offentlige API 10. juni 2025, med umiddelbar støtte i både fullførings- og chat-endepunktene. Utviklere kan spesifisere "o3-pro" modell i API-kallene sine, underlagt hastighetsgrenser og kvotebegrensninger knyttet til abonnementsnivået deres.

POST https://api.openai.com/v1/chat/completions

{

"model": "o3-pro",

"messages": ,

"max_tokens": 1500

}

ChatGPT Pro- og teamabonnementer

ChatGPT Pro- og Team-abonnenter får direkte tilgang til o3-pro i ChatGPT-grensesnittet. Brukere kan veksle mellom o3 og o3-pro i modellvelgeren, men den innledende tilgjengeligheten er begrenset til et delsett av bedriftskunder og betatestere.

Via CometAPI API

Utviklere har tilgang o3-Pro API(modell: ”o3-Pro"eller"o3-pro-2025-06-10) gjennom CometAPI, de nyeste modellene som er oppført er per artikkelens publiseringsdato. For å begynne, utforsk modellens muligheter i lekeplass og konsulter API-veiledning for detaljerte instruksjoner. Før du får tilgang, må du sørge for at du har logget inn på CometAPI og fått API-nøkkelen. CometAPI tilby en pris som er langt lavere enn den offisielle prisen for å hjelpe deg med å integrere.

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.cometapi.com/v1",

api_key="<YOUR_API_KEY>",

)

response = client.chat.completions.create(

model="o3-Pro",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices.message.content

print(f"Assistant: {message}")

Hvilke praktiske bruksområder drar mest nytte av o3‑pro?

Vitenskapelig forskning og dataanalyse

Forskere som jobber med store datasett – alt fra genomikk til klimasimuleringer – kan utnytte o3-pros filanalyse- og Python-utførelsesmuligheter for å automatisere hypotesetesting og generere innsikt uten begrensninger knyttet til kontekstlengde.

Kunnskapsarbeidsflyter for bedrifter

I sektorer som finans og juridiske tjenester, der presisjon og reviderbarhet er avgjørende, reduserer o3-pros forbedrede instruksjonsoverholdelse og multimodale resonnement feilrater i kontraktsgjennomganger, økonomisk modellering og oppgaver som oppfyller regelverket.

Programvareutvikling og DevOps

Ved å kombinere forståelse av lang kontekstkode med live-testing gjennom Python-kjøring, effektiviserer o3-pro feilsøking og automatiserer komplekse refaktoreringsarbeidsflyter, noe som akselererer leveringssykluser for store programvareprosjekter.

Hva bør organisasjoner vurdere før de oppgraderer?

Kost-nytte-analyse

Teamene må veie 10 ganger prisøkningen mot forventede effektivitetsgevinster. For oppgaver med høy verdi og lavt volum – som å utarbeide strategiske rapporter eller bygge kritiske sikkerhetssystemer – kan nøyaktigheten og verktøystøtten rettferdiggjøre o3-pros premium. For generering av bulkinnhold kan det være mer økonomisk å holde seg til standard o3- eller o4-mini-modeller.

Infrastrukturberedskap

Fordi o3-pro krever høyere latens og gjennomstrømning, bør organisasjoner revidere API-hastighetsgrensene, nettverkskapasiteten og strategiene for feilsøking for å unngå flaskehalser under toppbruk.

I konklusjonen

OpenAIs o3-pro-modell setter en ny standard for avansert resonnement, multimodal forståelse og integrert verktøybruk i AI. Dens referanseindeksgevinster og pålitelighetsforbedringer gjør den til et attraktivt alternativ for forretningskritiske applikasjoner, forutsatt at budsjetter og infrastruktur kan støtte de økte kostnadene. Etter hvert som AI-landskapet utvikler seg, vil o3-pros rolle styrkes i områder som krever høyest mulig nøyaktighet og kontekstuell dybde, mens mer kostnadssensitive arbeidsbelastninger kan fortsette å utnytte basismodeller i o-serien eller nye minivarianter.