Mistral 3 هو الإصدار البارز من عائلة نماذج Mistral AI في أواخر عام 2025. يجلب مزيجًا من النماذج المدمجة والسريعة الموجهة للنشر المحلي/على الحافة، إضافةً إلى نموذج رئيسي متناثر وكبير جدًا يدفع حدود الحالة الفنية في الحجم وطول السياق. يشرح هذا المقال ما هو Mistral 3، وكيف بُني، ولماذا قد ترغب في تشغيله محليًا، وثلاث طرق عملية لتشغيله على جهازك أو خادمك الخاص — من سهولة “النقر للتشغيل” مع Ollama إلى خدمة الإنتاج على وحدات GPU باستخدام vLLM/TGI، إلى استدلال CPU على الأجهزة الصغيرة باستخدام GGUF + llama.cpp.

ما هو Mistral 3؟

يُعد Mistral 3 الجيل الأحدث من النماذج ذات الأوزان المفتوحة من Mistral AI. تضم العائلة كِلا من Mistral Large 3 الضخم (نموذج متناثر من نوع Mixture‑of‑Experts — MoE) وعدة نسخ موجهة للحافة/“ministral” (3B و8B و14B) مضبوطة على اتباع التعليمات والمهام متعددة الوسائط (نص+رؤية). وضعت Mistral هذا الإصدار ليكون واسع الاستخدام: من استدلال عالي الأداء في مراكز البيانات (مع نقاط تحقق محسّنة متخصصة) إلى الاستخدام على الحافة وأجهزة اللابتوب عبر صيغ مُكمَّمة ومتغيرات أصغر.

الخصائص العملية الرئيسية :

- بنية Mixture‑of‑Experts (MoE) في نسخة Large 3 تؤدي إلى عدد “إجمالي” كبير جدًا من المعاملات مع تفعيل جزء فرعي من الخبراء لكل رمز فقط — ما يحسّن الكفاءة على نطاق واسع.

- عائلة نماذج Ministral 3 (3B / 8B / 14B) مخصصة للاستخدام على الحافة ومحليًا، مع نسخ مضبوطة على التعليمات ونسخ متعددة الوسائط.

- نقاط تحقق رسمية ومجموعة نقاط تحقق مُحسّنة (NVFP4/FP8) لبيئات تشغيل مسرّعة مثل vLLM ومنصات NVIDIA.

- متعدد الوسائط + متعدد اللغات + سياق طويل — تركز نسخ “ministral” والنسخ الكبيرة على فهم الصور+النص وعلى تغطية لغوية واسعة. هذا مهم للتطبيقات التي تمزج الصور مع الوثائق الطويلة.

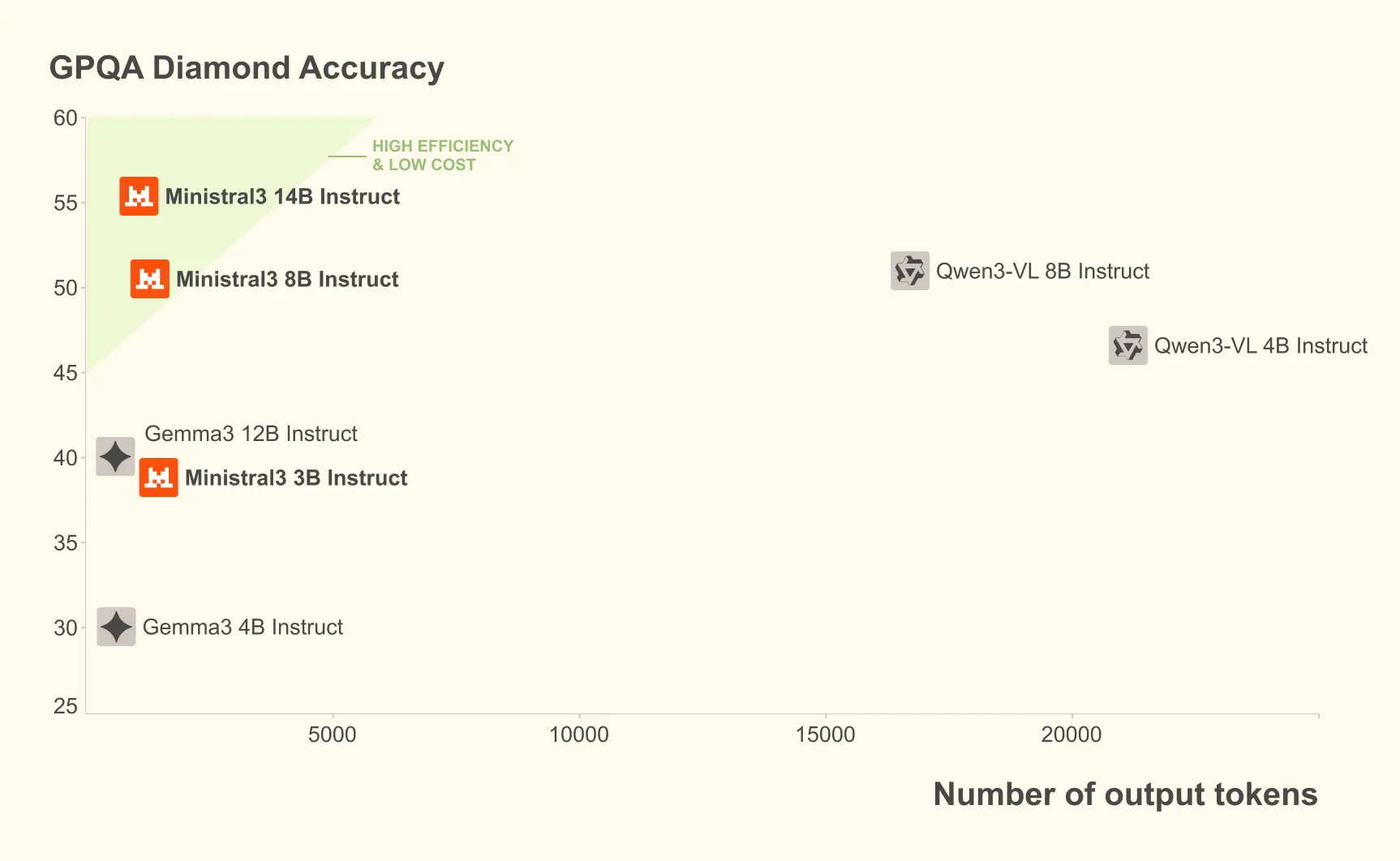

على مجموعة بيانات GPQA Diamond (اختبار صارم للاستدلال العلمي)، تحافظ نسخ مختلفة من Miniral 3 على دقة عالية حتى مع زيادة عدد رموز المخرجات. على سبيل المثال، يحافظ نموذج Miniral 3B Instruct على دقة 35–40% عند التعامل مع ما يصل إلى 20,000 رمز، وهو أداء قابل للمقارنة مع نماذج أكبر مثل Gemma 2 9B، مع استخدام موارد أقل.

ما هي بنية Mistral 3؟

Mistral 3 عائلة وليس بنية واحدة، لكن نمطا البنية اللذان ينبغي فهمهما هما:

نماذج صغيرة كثيفة (Ministral 3)

- طبقات Transformer قياسية، مُحسّنة للكفاءة والاستدلال على الحافة.

- تُقدَّم بأحجام متعددة (3B/8B/14B) وبنسخ مضبوطة مختلفة: base وinstruct وreasoning؛ تتضمن الكثير من النسخ دعمًا أصيلًا متعدد الوسائط (رؤية + نص) وتشغيل سياق طويل. تُصدَر نماذج Minstral بأوزان FP8 مُحسّنة للدمج في بعض التوزيعات.

Mixture‑of‑Experts متناثرة (Mistral Large 3)

- بنية MoE: يضم النموذج عددًا كبيرًا من الخبراء (عدد إجمالي ضخم من المعاملات)، لكن يتم تقييم جزء فرعي مُختار عبر التوجيه لكل رمز — ما يحقق مقايضة أفضل بين الحجم والحوسبة.

- يذكر Mistral Large 3 نحو ~675B من المعاملات الإجمالية مع نحو ~41B معاملات نشطة أثناء الاستدلال، انعكاسًا لتصميم MoE. تم تدريب النموذج على عتاد NVIDIA حديث وتم تحسينه للتنفيذ بكفاءة بدقة منخفضة (NVFP4/TensorRT/تحسينات Large‑kernel).

ميزات تقنية مهمة عند التشغيل محليًا:

- سياق طويل: تدعم بعض نسخ Mistral 3 سياقات طويلة جدًا (تشير وثائق vLLM ووثائق Mistral إلى نوافذ سياق ضخمة لنسخ معينة؛ مثل 256k في بعض نسخ Ministral). يؤثر ذلك في الذاكرة وأنماط الخدمة.

- صيغ الأوزان والكمّ: توفر Mistral الأوزان بصيغ مضغوطة/محسّنة (FP8، NVFP4) وتعمل مع أدوات كمّ حديثة (BitsAndBytes، GPTQ، أدوات البائعين) للاستدلال المحلي العملي.

لماذا قد تشغّل Mistral 3 محليًا؟

تشغيل نماذج اللغة الكبيرة محليًا لم يعد هوايةً متخصصة — بل خيار عملي للفرق والأفراد الذين يهتمون بـ:

- خصوصية البيانات والامتثال. الاستضافة المحلية تُبقي المدخلات الحساسة داخل بنيتك التحتية (مهم للقطاع المالي والرعاية الصحية والقانون). ذكرت Reuters أن عملاء بارزين اختاروا استضافة نماذج Mistral ذاتيًا.

- زمن الاستجابة والتحكم بالتكاليف. من أجل أهداف زمن استجابة صارمة وتكاليف متوقعة، قد يتفوق الاستدلال المحلي أو على عنقود خاص على صدمة فواتير واجهات برمجة التطبيقات السحابية. تجعل النسخ الأصغر من ministral والصيغ المُكمَّمة ذلك عمليًا.

- التخصيص والضبط الدقيق. عندما تحتاج إلى سلوك مخصص أو استدعاء وظائف أو وسائط جديدة، يتيح التحكم المحلي الضبط الدقيق المخصص والتعامل مع البيانات. تكامل Hugging Face وvLLM يجعل ذلك أقرب إلى الحل الجاهز.

إذا كانت هذه الأسباب تتوافق مع أولوياتك — الخصوصية، التحكم، إمكانية توقع التكلفة، أو البحث — فإن النشر المحلي يستحق النظر.

كيف تشغّل Mistral 3 محليًا (ثلاث طرق عملية)؟

هناك طرق عديدة لتشغيل Mistral 3 محليًا. سأعرض ثلاث مقاربات تغطي السيناريوهات الأكثر شيوعًا للمستخدمين:

- Ollama (سطح مكتب بلا إعداد / خادم محلي، الأسهل لكثير من المستخدمين)

- Hugging Face Transformers + PyTorch / vLLM (تحكم كامل، عناقيد GPU)

- llama.cpp / ggml / GGUF للاستدلال المُكمَّم على CPU (خفيف الوزن، يعمل على اللابتوبات/المعالجات)

لكل طريقة سأذكر وقت استخدامها المنطقي، والمتطلبات المسبقة، والأوامر خطوة بخطوة، وأمثلة شيفرة صغيرة.

1) كيف تشغّل Mistral 3 مع Ollama (أسرع مسار)؟

متى تستخدمها: تريد تجربة محلية سلسة (macOS/Linux/Windows)، وواجهة سطر أوامر أو رسومية سهلة، وتنزيلات تلقائية/حِزم مُكمَّمة عند توفرها. لدى Ollama إدخالات نماذج لـ Ministral 3 وأعضاء آخرين من عائلة Mistral.

المتطلبات المسبقة

- تثبيت Ollama (اتبع المُثبّت على ollama.com). تُشير مكتبة Ollama إلى حد أدنى محدد للإصدارات لبعض إصدارات ministral.

- مساحة قرص كافية لتخزين حِزم النموذج (تختلف أحجام النماذج — قد تكون نسخ ministal 3B المُكمَّمة بضعة جيجابايت؛ أما النسخ الأكبر BF16 فهي عشرات الجيجابايت).

الخطوات (مثال)

- تثبيت Ollama (مثال macOS — استبدل حسب النظام):

# macOS (Homebrew) example — see ollama.com for platform-specific installersbrew install ollama

- تشغيل نموذج ministral:

# Pull and run the model interactivelyollama run ministral-3

- خدمة محلية (API) واستدعاؤها من الشيفرة:

# Run Ollama server (default port shown in docs)ollama serve# Then curl against it (example)curl -s -X POST "http://localhost:11434/api/v1/generate" \ -H "Content-Type: application/json" \ -d '{"model":"ministral-3","prompt":"Summarize Mistral 3 in one sentence."}'

ملاحظات ونصائح

- يتكفّل Ollama بتنزيل النماذج و(عند توفرها) النسخ المُكمَّمة المحلية — وهذا مريح جدًا لتجربة النماذج بسرعة.

- إذا كنت تخطط لاستخدام النموذج في الإنتاج مع طلبات متزامنة كثيرة، فإن Ollama مناسب للنمذجة الأولى، لكن قيِّم التوسّع وتنظيم الموارد للحمل المستمر.

2) كيف تشغّل Mistral 3 مع Hugging Face Transformers (GPU / تكامل vLLM)؟

متى تستخدمها: تحتاج إلى تحكم برمجي لأغراض البحث أو الإنتاج، وترغب في الضبط الدقيق، أو استخدام حِزم استدلال مسرّعة مثل vLLM على عناقيد GPU. يوفر Hugging Face دعم Transformers وتقدّم Mistral نقاط تحقق مُحسّنة لـ vLLM/NVIDIA.

المتطلبات المسبقة

- وحدة GPU بذاكرة كافية (تختلف حسب النموذج والدقة). يمكن تشغيل النسخ الصغيرة من Ministral 3 (3B/8B) على وحدة GPU متوسطة واحدة عند الكمّ؛ أما النسخ الأكبر فتتطلب عدة H100/A100 أو نقاط تحقق NVFP4 مُحسّنة لـ vLLM. توصي وثائق NVIDIA وMistral بأحجام عقد محددة للنماذج الكبيرة.

- Python، PyTorch، transformers، accelerate (أو vLLM إن أردت ذلك الخادم).

مثال Python — خط أنابيب أساسي لـ Hugging Face (نسخة 3B instruct، GPU):

# Example: CPU/GPU inference with transformers pipeline# Assumes you have CUDA and a compatible PyTorch build.import torchfrom transformers import pipelinemodel_name = "mistralai/Ministral-3-3B-Instruct-2512-BF16" # example HF model idgenerator = pipeline( "text-generation", model=model_name, device_map="auto", torch_dtype=torch.bfloat16, # use bfloat16 if your hardware supports it)prompt = "Explain how attention helps transformers, in 3 sentences."out = generator(prompt, max_new_tokens=120, do_sample=False)print(out[0]["generated_text"])

استخدام vLLM لاستدلال الإنتاج على GPU

تم تصميم vLLM لخدمة النماذج الكبيرة بكفاءة، ويدعم عائلة Mistral 3، وقد نشرت Mistral نقاط تحقق مُحسّنة لعتاد vLLM/NVIDIA (NVFP4/FP8) لتقليل البصمة الذاكرية وزيادة السرعة. بدء خادم vLLM يمنحك نقطة نهاية للاستدلال منخفضة زمن الاستجابة مع تجميع الدُفعات. راجع وصفات vLLM وإرشادات Mistral لمسارات النماذج والخيارات الموصى بها.

ملاحظات ونصائح

- للإنتاج، فضّل نقاط التحقق المُحسّنة (NVFP4/FP8) وشغّل على وحدات GPU الموصى بها (مثل H100/A100) أو استخدم طبقة تنظيم تدعم التوازي القِطْعي/النموذجي. لدى Mistral وNVIDIA وثائق وتدوينات حول بيئات تشغيل مُحسّنة.

- ثبّت دائمًا نقطة تحقق النموذج الدقيقة على القرص (أو لقطة HF قابلة لإعادة الإنتاج) للحصول على نتائج قابلة لإعادة الإنتاج وتجنب تحديثات النموذج الصامتة.

3) كيف تشغّل Mistral 3 على CPU باستخدام نماذج GGUF مُكمَّمة مع llama.cpp؟

متى تستخدمها: تحتاج إلى استدلال محلي وغير متصل على CPU (مثل لابتوب المطوّر، بيئة معزولة آمنـًا) وتقبل مقايضة بعض الدقة مقابل كفاءة زمن التشغيل والذاكرة. تستخدم هذه الطريقة ggml/llama.cpp وأوزان GGUF مُكمَّمة (q4/q5/etc.).

المتطلبات المسبقة

- نسخة GGUF مُكمَّمة من نموذج Ministral (ينشر كثير من أعضاء المجتمع نماذج GGUF مُكمَّمة على Hugging Face أو يحوّلون أوزان BF16 إلى GGUF محليًا). ابحث عن نسخ GGUF لـ

Ministral-3-3B-Instruct. - نسخة تنفيذية مُترجَمة من llama.cpp (اتبع ملف README للمشروع).

الكمّ (إن كانت لديك الأوزان الأصلية) — مثال (تصوري)

# Example: quantize from an FP16/BF16 model to a GGUF q4_K_M (syntax depends on llama.cpp version)./quantize /path/to/original/model.bin /path/to/out.gguf q4_k_m

تشغيل GGUF مع llama.cpp

# run interactive inference with a quantized GGUF model./main -m /path/to/ministral-3-3b-instruct.gguf -t 8 -c 2048 --interactive# -t sets threads, -c sets context (tokens) if supported

مثال عميل Python (خادم llama.cpp محلي أو عملية فرعية)

يمكنك تشغيل llama.cpp كعملية فرعية وتمرير المطالبات إليه، أو استخدام عميل تغليف صغير. توفر العديد من مشاريع المجتمع غلاف خادم HTTP بسيط حول llama.cpp لدمج التطبيقات محليًا.

ملاحظات ومقايضات

- الكمّ يقلّل ذاكرة الرسوميات ويتيح الاستدلال على CPU لكنه قد يُنقص الجودة (طفيف إلى متوسط بحسب صيغة الكمّ). تُعد صيغ مثل q4_K_M أو نسخ q5 مقايضات شائعة للاستخدام على CPU. تشرح منشورات تقنية ويابانية أنواع Q4/Q5 وتحويلات GGUF بالتفصيل.

- للأحمال الصغيرة إلى المتوسطة، يكون GGUF + llama.cpp غالبًا الطريقة الأرخص والأكثر قابلية للنقل لتشغيل نماذج لغة كبيرة محليًا.

ما الاعتبارات المتعلقة بالعَتاد والذاكرة؟

إرشادات قصيرة وعملية:

- نماذج 3B: يمكن غالبًا كمّها وتشغيلها على CPU لابتوب جيد أو وحدة GPU واحدة بذاكرة رسوميات 8–16 جيجابايت (حسب الدقة/الكمّ). يمكن لنسخ GGUF q4 العمل على العديد من المعالجات الحديثة.

- نسخ 8B و14B من ministral: تتطلب عادةً وحدة GPU متوسطة (مثل 24–80 جيجابايت بحسب الدقة وتخزين التفعيلات) أو كمّ عبر عدة أجهزة.

- Mistral Large 3 (إجمالي 675B، نشط 41B): مُوجّه لنشر مراكز البيانات ويعمل عادةً بأفضلية مع عُقَد متعددة GPU (مثل 8×A100 أو H100) وصيغ متخصصة (NVFP4/FP8) لـ vLLM. نشرت Mistral صراحةً نقاط تحقق مُحسّنة لجعل مثل هذه عمليات النشر ممكنة.

إذا كانت أولويتك الاستخدام على اللابتوب محليًا، فاستهدف مسار ministral 3B المُكمَّم بصيغة GGUF + llama.cpp. إذا كانت أولويتك معدل إنتاجية في الإنتاج، فانظر إلى vLLM + نقاط تحقق NVFP4 على وحدات GPU. إذا كنت تريد سهولة التجربة، فإن Ollama هو الأسرع للبدء.

كيف تختار الكمّ والدقة؟

الكمّ هو مقايضة: الذاكرة والسرعة مقابل جودة النموذج الخام. الخيارات الشائعة:

- q4_0 / q4_1 / q4_K_M: خيارات 4‑بت شائعة تُستخدم للاستدلال على CPU؛ غالبًا ما يقدم q4_K_M (نسخة k-means) توازنًا أفضل بين الجودة والأداء.

- q5 / q8 / نسخ imatrix: صيغ وسيطة قد تُحافظ على مزيد من الدقة مقابل زيادة الحجم.

- FP16 / BF16 / FP8 / NVFP4: دقات GPU — تُعد BF16 وFP16 شائعة للتدريب/الاستدلال على وحدات GPU الحديثة؛ أما FP8 / NVFP4 فهي صيغ ناشئة توفّر الذاكرة للنماذج الكبيرة جدًا وتدعمها بيئات تشغيل مُحسّنة وإصدارات نقاط تحقق من Mistral.

قاعدة عامة: للاستدلال المحلي على CPU اختر q4_K_M أو ما شابهه؛ وللاستدلال على GPU مع دقة عالية استخدم BF16/FP16 أو FP8/NVFP4 الخاصة بالبائع عند دعمها من بيئة التشغيل.

الخلاصة — هل ينبغي تشغيل Mistral 3 محليًا؟

إذا كنت تحتاج إلى الخصوصية أو زمن استجابة منخفض أو تخصيص، فالجواب نعم: تمنحك عائلة Mistral 3 طيفًا واسعًا — نماذج صغيرة لوحدات CPU على الحافة، ونماذج متوسطة الحجم لوحدة GPU واحدة أو عنقود متواضع، ونكهة MoE كبيرة لمقياس مراكز البيانات — كما أن المنظومة (Ollama وHugging Face وvLLM وllama.cpp) تدعم بالفعل أنماط نشر محلية وخاصة عملية. كما عملت Mistral مع NVIDIA وvLLM لتقديم نقاط تحقق مُحسّنة لمعدل إنتاجية عالٍ وبصمات ذاكرية منخفضة، ما يجعل الاستضافة الذاتية في الإنتاج أكثر واقعية من ذي قبل.

للبدء، استكشف قدرات مزيد من النماذج (مثل Gemini 3 Pro) في Playground واطلع على دليل API للحصول على تعليمات مفصلة. قبل الوصول، يُرجى التأكد من تسجيل الدخول إلى CometAPI والحصول على مفتاح API. تقدّم CometAPI سعرًا أقل بكثير من السعر الرسمي لمساعدتك على الدمج.

جاهز للانطلاق؟→ سجّل في CometAPI اليوم !