LobeChat i CometAPI to dwa dynamicznie rozwijające się projekty w otwartym ekosystemie AI. We wrześniu 2025 roku LobeChat połączył pełną integrację dostawcy CometAPI, co ułatwia wywoływanie z LobeChat zunifikowanych, zgodnych z OpenAI punktów końcowych CometAPI. W tym artykule wyjaśniono, czym są LobeChat i CometAPI, dlaczego warto je zintegrować, krok po kroku opisano integrację i konfigurację (w tym gotową do użycia konfigurację bazową dostawcy TypeScript), przykłady uruchomieniowe, konkretne przypadki użycia oraz wskazówki dotyczące produkcji, takie jak koszty, niezawodność i możliwość obserwacji.

Czym jest LobeChat i jakie funkcje oferuje?

LobeChat to nowoczesna platforma czatu typu open source, zaprojektowana do hostowania aplikacji czatu LLM dla wielu dostawców, z dopracowanym interfejsem użytkownika i narzędziami wdrożeniowymi. Została zaprojektowana z myślą o obsłudze multimodalnych danych wejściowych (tekst, obrazy, dźwięk), przepływów pracy w oparciu o bazę wiedzy/RAG, konwersacji rozgałęzionych i wizualizacji „łańcucha myśli”, a także rozszerzalnym systemie dostawców/wtyczek, umożliwiającym wymianę różnych modeli back-endów bez konieczności przeprojektowywania aplikacji. Dokumentacja i repozytorium LobeChat przedstawiają ją jako platformę gotową do produkcji, zarówno dla wdrożeń hostowanych samodzielnie, jak i w chmurze, z konfiguracją sterowaną środowiskowo i platformą integracyjną MCP (model control plane) innych firm.

Najważniejsze możliwości LobeChat w skrócie

- Obsługa wielu dostawców (OpenAI, Anthropic, Google Gemini, Ollama itp.).

- Przesyłanie plików + baza wiedzy dla przepływów pracy RAG (dokumenty, pliki PDF, pliki audio).

- Przyjazna dla programistów konfiguracja poprzez zmienne środowiskowe i import ustawień-URL.

- Rozszerzalne środowisko wykonawcze: dostawcy są konfigurowani przy użyciu małych środowisk wykonawczych adapterów, dzięki czemu można podłączać nowe zaplecza.

Czym jest CometAPI?

CometAPI to ujednolicona warstwa dostępu do sztucznej inteligencji (AI), która udostępnia ponad 500 modeli od wielu dostawców bazowych za pośrednictwem jednej, kompatybilnej z OpenAI platformy API. Została zaprojektowana tak, aby umożliwić programistom wybór punktów końcowych modelu pod kątem wydajności, kosztów lub możliwości bez konieczności uzależniania się od jednego dostawcy, a także scentralizowanie rozliczeń, routingu i dostępu. CometAPI reklamuje ujednolicone punkty końcowe dla czatów/uzupełnień oraz API listy modeli, aby znaleźć dostępne identyfikatory modeli.

Dlaczego CometAPI jest atrakcyjne dla zespołów

- Wybór modelu i przenośność: przełączaj się pomiędzy wieloma najnowocześniejszymi modelami bez znaczącej zmiany kodu integracyjnego.

- Punkty końcowe zgodne z OpenAI: wiele bibliotek klienckich i struktur, które oczekują punktów końcowych HTTP w stylu OpenAI, może współpracować z CometAPI poprzez zmianę adresu URL bazowego i uwierzytelniania. (Praktyczne przykłady pokazują

https://api.cometapi.com/v1/(jako powierzchnia zgodna z OpenAI.) - Dokumentacja i integracje dla programistów: CometAPI publikuje dokumentację i przewodniki krok po kroku dotyczące integracji z narzędziami takimi jak LlamaIndex i innymi platformami low-code.

Dlaczego warto zintegrować CometAPI z LobeChat?

Krótka odpowiedź: elastyczność, kontrola kosztów i szybki dostęp do nowych modeliLobeChat został zaprojektowany z myślą o niezależności od dostawcy; podłączenie CometAPI umożliwia wdrożeniu LobeChat wywoływanie wielu różnych modeli za pomocą tej samej ścieżki kodu — zamiana modeli pod kątem przepustowości, opóźnienia, kosztów lub możliwości bez zmiany interfejsu użytkownika ani przepływów komunikatów. Ponadto społeczność i osoby odpowiedzialne za utrzymanie systemu aktywnie dodali do LobeChat obsługę dostawcy CometAPI, co usprawnia integrację.

Korzyści biznesowe i techniczne

- Różnorodność modeli bez rotacji kodu. Potrzebujesz ocenić Gemini, Claude lub niszowy model obrazu? CometAPI może udostępnić te identyfikatory modeli za pośrednictwem jednego interfejsu API. Zmniejsza to liczbę zapytań dla poszczególnych dostawców w LobeChat.

- Optymalizacja kosztów. CometAPI umożliwia dynamiczne kierowanie do tańszych modeli lub wybieranie tańszych dostawców, co może znacząco obniżyć koszty pojedynczej rozmowy w przypadku wdrożeń o dużej objętości.

- Prostsze zarządzanie sekretami. Jeden klucz API do zarządzania w ustawieniach LobeChat lub środowisku Docker zamiast wielu kluczy dostawcy. Platforma LobeChat obsługuje już włączanie dostawcy za pośrednictwem

ENABLED_<PROVIDER>i wzorzec zmiennej środowiskowej klucza dostawcy, dzięki czemu integracja jest spójna pod względem operacyjnym. - Utrzymuje minimalną bazę kodu LobeChat: logika dostawcy jest hermetyzowana i konfigurowana za pomocą zmiennych środowiskowych.

Jak skonfigurować i zintegrować CometAPI z LobeChat?

Ta sekcja przedstawia praktyczny przepis krok po kroku: pobierz klucze, ustaw zmienne środowiskowe, dodaj dostawcę do LobeChat (przykładowa konfiguracja dostawcy) i pokaż użycie w czasie wykonywania (wywołanie czatu). Przykłady są zgodne ze wzorcami dostawców LobeChat i punktami końcowymi zgodnymi z CometAPI OpenAI.

1) Załóż konto CometAPI i uzyskaj klucz API

Zarejestruj się w CometAPI i otwórz konsolę API. Aby założyć konto CometAPI, musisz użyć adresu e-mail lub zalogować się bezpośrednio przez Google One-Click.

Po zakończeniu rejestracji przejdź do placu zabaw i kliknij „Dodaj nowy klucz tajny”, aby utworzyć nowy klucz API:

Uzyskaj klucz API.

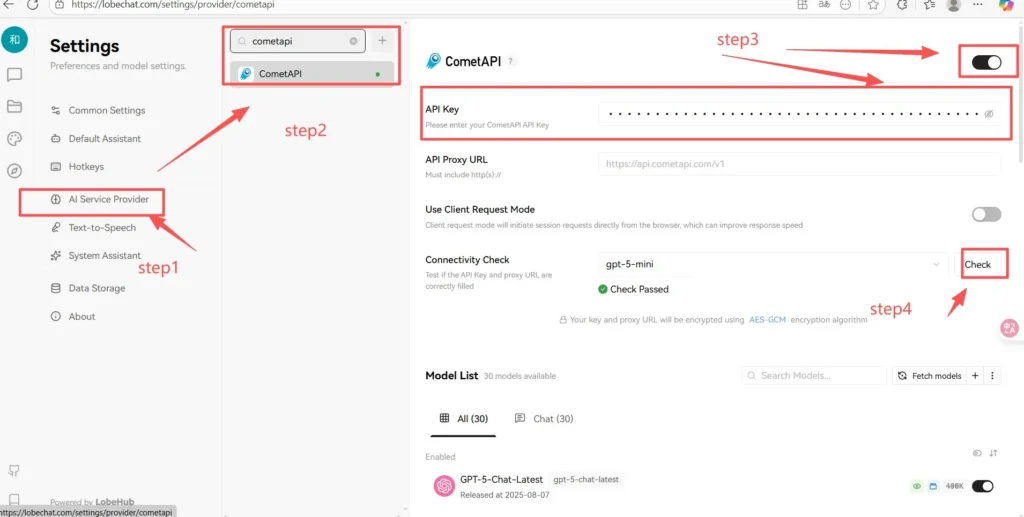

2) Konfigurowanie CometAPI w LobeChat

- Wejdź w menu ustawień Lobe-Chat, kliknij awatar, kliknij opcję ustawień aplikacji.

- Wybierz cometapi jako dostawcę modelu.

- Wklej sk-xxxxx z cometapi w polu wprowadzania klucza API i włącz przycisk, wybierz jeden model do sprawdzenia

3) Testowanie połączenia

Wybierz jeden model CometAPI do sprawdzenia. Wprowadź proste polecenie testowe w Lobe-Chat. Jeśli połączenie się powiedzie, otrzymasz odpowiednią odpowiedź. Jeśli nie, sprawdź poprawność konfiguracji lub skontaktuj się z obsługą klienta Cometapi online.

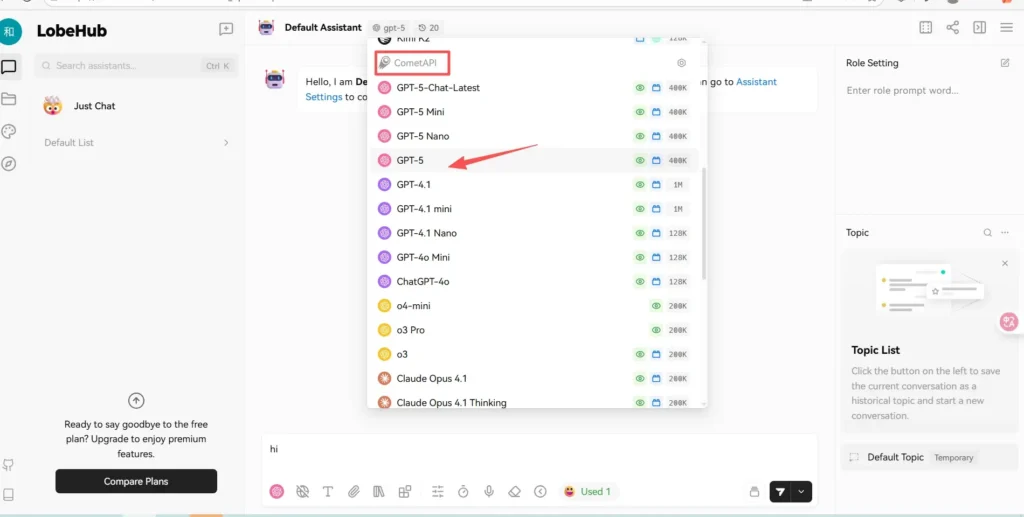

Obecnie cometapi udostępnia ponad 30 najnowszych modeli od głównych deweloperów (openAI, grok, claude, gemini) na lobechat.

W jaki sposób można rozszerzyć integrację (zaawansowane ulepszenia)?

Chcesz wyjść poza podstawy? Oto solidne kroki, które pomogą Ci przenieść integrację z poziomu funkcjonalnego do produkcyjnego.

Ulepszenie 1: Dynamiczna orkiestracja modelu (agenci wielomodelowi)

Stwórz logikę agenta w LobeChat, która dynamicznie przydziela podzadania do różnych modeli Comet (np. mały model osadzania do pobierania, średni model do szkicowania, model o dużej wydajności do podsumowania). Wykorzystaj system wywołań funkcji/wtyczek LobeChat do koordynowania przepływu pracy i agregowania końcowych odpowiedzi.

Ulepszenie 2: Buforowanie osadzeń i odpowiedzi

Podczas korzystania z osadzeń (dla RAG), oblicz osadzenia raz i zapisz je w pamięci podręcznej, aby zmniejszyć obciążenie. Jeśli wywołujesz CometAPI w celu osadzeń, przechowuj reprezentacje wektorowe w swojej bazie danych wektorów i przeliczaj je tylko po zmianach treści. Zmniejsza to liczbę tokenów i koszty.

Ulepszenie 3: Konfiguracja i limity dla poszczególnych dzierżawców

Jeśli korzystasz z wielodostępnej instancji LobeChat, kontroluj limity dla każdego z użytkowników (liczba żądań na godzinę, poziomy modeli), pisząc oprogramowanie pośredniczące, które mapuje identyfikator użytkownika → listę dozwolonych modeli (za pomocą identyfikatorów modeli CometAPI). Dzięki temu poziomy premium mają dostęp do lepszych modeli.

Ulepszenie 4: Korzystanie z metadanych modelu i kontroli stanu zdrowia

Wdrażaj kontrole stanu dostawcy, które wywołują lekki „ping modelu” CometAPI lub minimalną rozmowę na czacie, aby zapewnić, że opóźnienie mieści się w ramach SLA; w przeciwnym razie nie używaj modeli zapasowych. Monitoruj puls i prezentuj status dostawcy w interfejsie administracyjnym LobeChat.

Na jakie pułapki należy uważać?

- Ujawnienie klucza APINigdy nie przechowuj kluczy CometAPI w kodzie klienta. Zawsze przechowuj je po stronie serwera (warstwa serwerowa LobeChat).

- Dryf nazwy modelu: CometAPI może dodać lub wycofać identyfikatory modeli. Użyj mapowania serwera i zaktualizuj

COMETAPI_MODEL_LISTgdy chcesz zaprezentować nowe modele. - Różnice w formatach odpowiedzi:Mimo że CometAPI ma być zgodne ze standardem OpenAI, niektóre modele lub pola meta mogą się różnić. Zawsze mapuj i oczyszczaj odpowiedzi przed wyświetleniem ich użytkownikom.

Jak zacząć

CometAPI to ujednolicona platforma API, która agreguje ponad 500 modeli AI od wiodących dostawców — takich jak seria GPT firmy OpenAI, Gemini firmy Google, Claude firmy Anthropic, Midjourney, Suno i innych — w jednym, przyjaznym dla programistów interfejsie. Oferując spójne uwierzytelnianie, formatowanie żądań i obsługę odpowiedzi, CometAPI radykalnie upraszcza integrację możliwości AI z aplikacjami. Niezależnie od tego, czy tworzysz chatboty, generatory obrazów, kompozytorów muzycznych czy oparte na danych potoki analityczne, CometAPI pozwala Ci szybciej iterować, kontrolować koszty i pozostać niezależnym od dostawcy — wszystko to przy jednoczesnym korzystaniu z najnowszych przełomów w ekosystemie AI.

Na początek zapoznaj się z możliwościami modelu w Plac zabaw i zapoznaj się z Przewodnik po API aby uzyskać szczegółowe instrukcje. Przed uzyskaniem dostępu upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API. Interfejs API Comet zaoferuj cenę znacznie niższą niż oficjalna, aby ułatwić Ci integrację.

Gotowy do drogi?→ Zarejestruj się w CometAPI już dziś !

Podsumowanie

Integracja CometAPI z LobeChat to praktyczny sposób na zwiększenie różnorodności modeli, elastyczności kosztowej i możliwości szybkiego eksperymentowania, przy jednoczesnym zachowaniu dopracowanych funkcji UX i RAG oferowanych przez LobeChat. Społeczność LobeChat poczyniła już znaczące wysiłki w celu dodania obsługi CometAPI (karta dostawcy, lista modeli, adaptery środowiska uruchomieniowego, testy i dokumentacja), z której można korzystać bezpośrednio lub wykorzystać jako inspirację do wdrożenia niestandardowego adaptera dla specjalistycznych potrzeb. Aby uzyskać najdokładniejsze kroki integracji i najnowsze przykłady, zapoznaj się z dokumentacją CometAPI i Dokumentacja dostawcy modelu LobeChat i repozytorium — linki podane poniżej pomogą Ci kontynuować.