Najnowszy model rozumowania OpenAI, o3‑pro, stanowi znaczący skok w wydajności i możliwościach aplikacji opartych na sztucznej inteligencji. Wprowadzony na rynek na początku czerwca 2025 r. o3‑pro oferuje programistom i przedsiębiorstwom zaawansowane rozumowanie, zrozumienie multimodalne i korzystanie z narzędzi — wszystko w cenie premium. W tym artykule podsumowano najnowsze ogłoszenia, raporty użytkowników i dane porównawcze, aby zapewnić kompleksowy przegląd wydajności, kwestii kosztów i dostępności o3‑pro.

Czym jest o3‑pro?

Najnowsza oferta OpenAI, o3‑pro, stanowi znaczący kamień milowy w modelach rozumowania AI, łącząc ulepszone możliwości z wysoką ceną. Wprowadzony na rynek 11 czerwca 2025 r. o3‑pro jest następcą standardowego modelu o3 i zastępuje o1‑pro w ofercie produktów OpenAI, skierowanych do deweloperów i przedsiębiorstw, które stawiają na dogłębną analizę i niezawodność zamiast surowej szybkości. Zbudowany na tej samej podstawowej architekturze co o3 — pierwotnie wprowadzony w kwietniu 2025 r. — o3‑pro integruje wyszukiwanie w sieci w czasie rzeczywistym, analizę plików, rozumowanie wizualne, wykonywanie Pythona i zaawansowane funkcje pamięci, zajmując się złożonymi przepływami pracy w nauce, programowaniu, biznesie i pisaniu. Jednak celowe podejście do rozumowania modelu powoduje dłuższe opóźnienia i znaczny wzrost kosztów, co odzwierciedla jego obliczeniowo intensywny projekt.

Czym wyróżnia się o3‑pro od standardowego modelu o3?

Zaawansowane rozumowanie multimodalne

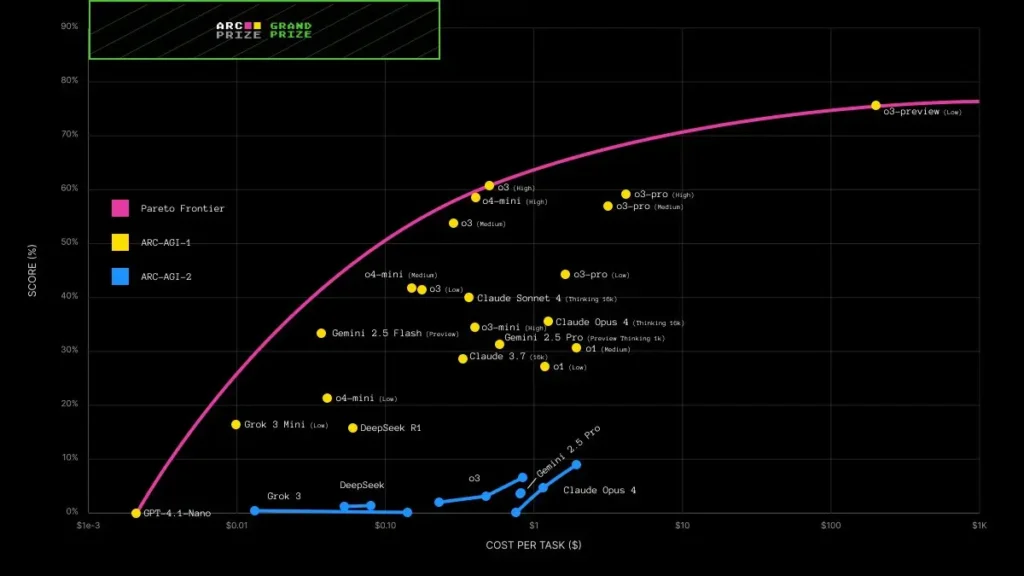

OpenAI rygorystycznie ocenił o3‑pro w wielu standardowych ocenach AI, aby potwierdzić jego sprawność rozumowania. W dziedzinie matematyki o3‑pro przewyższa Gemini 2.5 Pro firmy Google w teście porównawczym AIME 2024, wykazując lepsze logiczne rozumowanie i rozwiązywanie złożonych równań w warunkach ograniczonych czasowo. Podobnie w teście porównawczym GPQA Diamond — który mierzy zrozumienie naukowe na poziomie doktoratu i rozwiązywanie problemów — o3‑pro przewyższa Claude 4 Opus firmy Anthropic, podkreślając jego głębię w zaawansowanym rozumowaniu naukowym.

o3‑pro bazuje na mocnych stronach flagowego modelu o3 firmy OpenAI, integrując przeglądanie stron internetowych w czasie rzeczywistym, analizę plików, zrozumienie wizualne i wykonywanie Pythona w locie w jednym interfejsie. Według OpenAI ta ulepszona zdolność rozumowania pozwala o3‑pro na wykonywanie złożonych zadań — takich jak interpretacja danych naukowych, debugowanie kodu w długiej formie i generowanie treści multimodalnych — z większą niezawodnością niż jego poprzednik.

Niezawodność ponad opóźnienie

Te nowe możliwości wiążą się z pewnymi kompromisami: czasy reakcji o3‑pro są mierzalnie wolniejsze niż o3, co odzwierciedla dodatkowe kroki obliczeniowe i przetwarzania kontekstu wymagane do zaawansowanego korzystania z narzędzi. Wcześni użytkownicy zgłaszają typowe opóźnienia wynoszące 1.5–2 razy większe niż w przypadku o3 w przypadku równoważnych monitów, chociaż dokładne liczby różnią się w zależności od złożoności żądania.

Ograniczenia funkcji w momencie uruchomienia

Podczas uruchomienia użytkownicy o3‑pro zauważyli kilka tymczasowych ograniczeń: generowanie obrazów pozostaje niedostępne, a niektóre funkcje ChatGPT — takie jak efemeryczne sesje „Canvas” i tymczasowe wątki czatu — są wyłączone, podczas gdy OpenAI skaluje infrastrukturę dla nowego modelu. Oczekuje się, że ograniczenia te zostaną złagodzone w nadchodzących miesiącach wraz ze wzrostem pojemności.

Jak o3‑pro wypada w testach porównawczych w branży?

Standaryzowane testy rozumowania

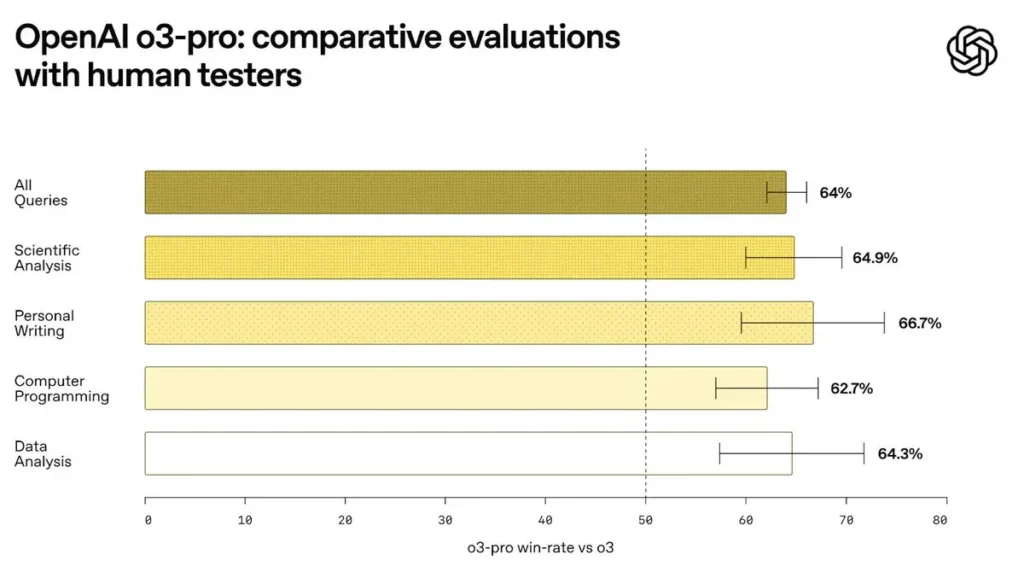

W testach wewnętrznych o3‑pro przewyższyło o3 o znaczną przewagę w standardowych zestawach rozumowania obejmujących matematykę, łamigłówki logiczne i wyzwania programistyczne. Wyniki zgłaszane przez społeczność plasują o3 na poziomie około 2,517 punktów, podczas gdy o3‑pro osiąga wyniki w pobliżu 2,748 — co stanowi poprawę o około 9%.

Oceny kodowania w świecie rzeczywistym

Programiści uruchamiający zadania generowania kodu na żywo i debugowania zauważyli, że o3‑pro generuje bardziej poprawne składniowo i semantycznie dokładne wyniki w ustawieniach pojedynczych i kilku. Testy porównawcze w repozytoriach kodowania, takich jak CodeSearchNet, pokazują 5–7% wzrost poprawności funkcjonalnej w porównaniu z o3, szczególnie w przypadku problemów z długim kontekstem przekraczających 4,000 tokenów.

Porównawcze wyniki w porównaniu z konkurencją

W testach bezpośrednich o3‑pro nie tylko pokonuje Gemini 2.5 Pro i Claude 4 Opus pod względem surowych wyników, ale także zapewnia bardziej spójne wyniki w testach wytrzymałościowych. Łącząc obsługę multimodalnych danych wejściowych i dynamiczne wykorzystanie narzędzi, o3‑pro zmniejsza lukę ze specjalistycznymi modelami od rywali, takimi jak Google PaLM i Anthropic Claude X. Wczesne testy bezpośrednie wskazują, że o3‑pro dorównuje lub przewyższa konkurencję pod względem dokładności w testach porównawczych złożonego rozumowania, chociaż kompleksowe raporty stron trzecich są nadal w przygotowaniu.

Jakiej struktury cenowej powinni spodziewać się deweloperzy?

Model rozliczeń oparty na tokenach

OpenAI kontynuuje rozliczanie oparte na tokenach: o3‑pro kosztuje 20 USD za milion tokenów wejściowych i 80 USD za milion tokenów wyjściowych — dokładnie dziesięć razy więcej niż standardowy model o3 po ostatniej obniżce ceny. Dla porównania, o3 kosztuje teraz 2 USD za milion tokenów wejściowych i 8 USD za milion tokenów wyjściowych po 80% obniżce ceny na początku czerwca 2025 r.

| Model | Wprowadź cenę tokena | Cena tokena wyjściowego |

|---|---|---|

| o3 | 2 USD / 1 mln tokenów | 8 USD / 1 mln tokenów |

| o3‑pro | 20 USD / 1 mln tokenów | 80 USD / 1 mln tokenów |

Uzasadnienie premii

Ten dziesięciokrotny wzrost ceny odzwierciedla dodatkowe zasoby obliczeniowe, infrastrukturę o wysokiej przepustowości i specjalistyczne integracje narzędzi, których wymaga o3‑pro. OpenAI pozycjonuje o3‑pro jako model „misji krytycznej” dla aplikacji, w których dokładność i zaawansowane rozumowanie uzasadniają premię kosztową.

Rabaty ilościowe i API partii

Przedsiębiorstwa przetwarzające duże wolumeny tokenów mogą nadal korzystać z interfejsu API Batch, aby zaoszczędzić do 50% na buforowanych danych wejściowych i wyjściowych. Podczas gdy ten mechanizm przynosi korzyści przede wszystkim użytkownikom o dużej liczbie danych wariantów GPT‑4.1, podobne opcje przetwarzania wsadowego mają zostać wdrożone dla modeli serii o w dalszej części 2025 r.

W jaki sposób deweloperzy i zespoły mogą uzyskać dostęp do o3‑pro?

Dostępność API

W testach porównawczych o3‑pro nie tylko pokonuje Gemini 2.5 Pro i Claude 4 Opus pod względem surowych wyników, ale także zapewnia bardziej spójne wyniki w testach wytrzymałościowych.

OpenAI udostępniło o3‑pro za pośrednictwem swojego publicznego interfejsu API 10 czerwca 2025 r., zapewniając natychmiastowe wsparcie zarówno w punktach końcowych Completions, jak i Chat. Deweloperzy mogą określić "o3-pro" modelu w swoich wywołaniach API, podlegającym limitom szybkości i ograniczeniom kwotowym związanym z poziomem subskrypcji.

POST https://api.openai.com/v1/chat/completions

{

"model": "o3-pro",

"messages": ,

"max_tokens": 1500

}

Plany ChatGPT Pro i Team

Subskrybenci ChatGPT Pro i Team uzyskują bezpośredni dostęp do o3‑pro w interfejsie ChatGPT. Użytkownicy mogą przełączać się między o3 i o3‑pro w selektorze modeli, chociaż początkowa dostępność jest ograniczona do podzbioru klientów korporacyjnych i testerów wersji beta.

Za pośrednictwem interfejsu API CometAPI

Deweloperzy mogą uzyskać dostęp Interfejs API o3-Pro(modelka: ”o3-Pro"Lub"o3-pro-2025-06-10") Poprzez Interfejs API Comet, najnowsze wymienione modele są z dnia publikacji artykułu. Na początek zapoznaj się z możliwościami modelu w Plac zabaw i zapoznaj się z Przewodnik po API aby uzyskać szczegółowe instrukcje. Przed uzyskaniem dostępu upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API. Interfejs API Comet zaoferuj cenę znacznie niższą niż oficjalna, aby ułatwić Ci integrację.

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.cometapi.com/v1",

api_key="<YOUR_API_KEY>",

)

response = client.chat.completions.create(

model="o3-Pro",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices.message.content

print(f"Assistant: {message}")

Jakie praktyczne zastosowania przynoszą największe korzyści z o3‑pro?

Badania naukowe i analiza danych

Naukowcy pracujący z dużymi zbiorami danych — od genomiki po symulacje klimatyczne — mogą wykorzystać funkcje analizy plików i wykonywania kodu Python dostępne w o3‑pro, aby zautomatyzować testowanie hipotez i generować wnioski bez ograniczeń związanych z długością kontekstu.

Przepływy pracy wiedzy przedsiębiorstwa

W sektorach takich jak finanse i usługi prawne, gdzie precyzja i możliwość audytu mają kluczowe znaczenie, lepsze przestrzeganie instrukcji i multimodalne rozumowanie oferowane przez o3‑pro zmniejszają liczbę błędów w przeglądach umów, modelowaniu finansowym i zadaniach związanych z przestrzeganiem przepisów.

Rozwój oprogramowania i DevOps

Łącząc rozumienie kodu o długim kontekście z testowaniem na żywo za pomocą wykonywania kodu w języku Python, o3‑pro usprawnia debugowanie i automatyzuje złożone przepływy pracy refaktoryzacji, przyspieszając cykle dostarczania dużych projektów oprogramowania.

Co organizacje powinny wziąć pod uwagę przed modernizacją?

Analiza kosztów i korzyści

Zespoły muszą rozważyć 10-krotny wzrost ceny w stosunku do przewidywanych zysków wydajności. W przypadku zadań o wysokiej wartości i małej objętości — takich jak tworzenie strategicznych raportów lub budowanie krytycznych systemów bezpieczeństwa — dokładność i wsparcie narzędzi mogą uzasadniać premię o3‑pro. W przypadku generowania treści masowych trzymanie się standardowych modeli o3 lub o4‑mini może być bardziej ekonomiczne.

Gotowość infrastruktury

Ponieważ o3‑pro wiąże się z większymi wymaganiami dotyczącymi opóźnień i przepustowości, organizacje powinny dokonać audytu limitów szybkości interfejsu API, przepustowości sieci i strategii ponawiania błędów, aby uniknąć wąskich gardeł podczas szczytowego wykorzystania.

Podsumowując

Model o3‑pro firmy OpenAI wyznacza nowe standardy zaawansowanego rozumowania, multimodalnego rozumienia i zintegrowanego wykorzystania narzędzi w AI. Jego zyski w testach porównawczych i ulepszenia niezawodności czynią go atrakcyjną opcją dla aplikacji o znaczeniu krytycznym, pod warunkiem, że budżety i infrastruktura mogą obsłużyć podwyższone koszty. W miarę rozwoju krajobrazu AI rola o3‑pro będzie się umacniać w obszarach wymagających najwyższego poziomu dokładności i głębi kontekstowej, podczas gdy obciążenia bardziej wrażliwe na koszty mogą nadal wykorzystywać podstawowe modele serii o lub pojawiające się warianty mini.