O mais recente modelo de raciocínio da OpenAI, o o3‑pro, representa um salto significativo em desempenho e capacidade para aplicações orientadas por IA. Lançado no início de junho de 2025, o o3‑pro oferece a desenvolvedores e empresas raciocínio avançado, compreensão multimodal e uso de ferramentas — tudo a um preço premium. Este artigo sintetiza os anúncios mais recentes, relatórios de usuários e dados de benchmark para fornecer uma visão geral abrangente do desempenho, das considerações de custo e da disponibilidade do o3‑pro.

O que é o3‑pro?

A mais recente oferta da OpenAI, o o3-pro, representa um marco significativo em modelos de raciocínio de IA, combinando recursos aprimorados com um preço premium. Lançado em 11 de junho de 2025, o o3-pro sucede o modelo padrão o3 e substitui o o1-pro na linha de produtos da OpenAI, visando desenvolvedores e empresas que priorizam análise aprofundada e confiabilidade em detrimento da velocidade bruta. Construído na mesma arquitetura subjacente do o3 — originalmente lançado em abril de 2025 —, o o3-pro integra pesquisa na web em tempo real, análise de arquivos, raciocínio visual, execução em Python e recursos avançados de memória, abordando fluxos de trabalho complexos em ciência, programação, negócios e escrita. No entanto, a abordagem de raciocínio deliberado do modelo incorre em latências mais longas e um aumento substancial de custo, refletindo seu design com uso intensivo de computação.

O que distingue o o3‑pro do modelo o3 padrão?

Raciocínio Multimodal Avançado

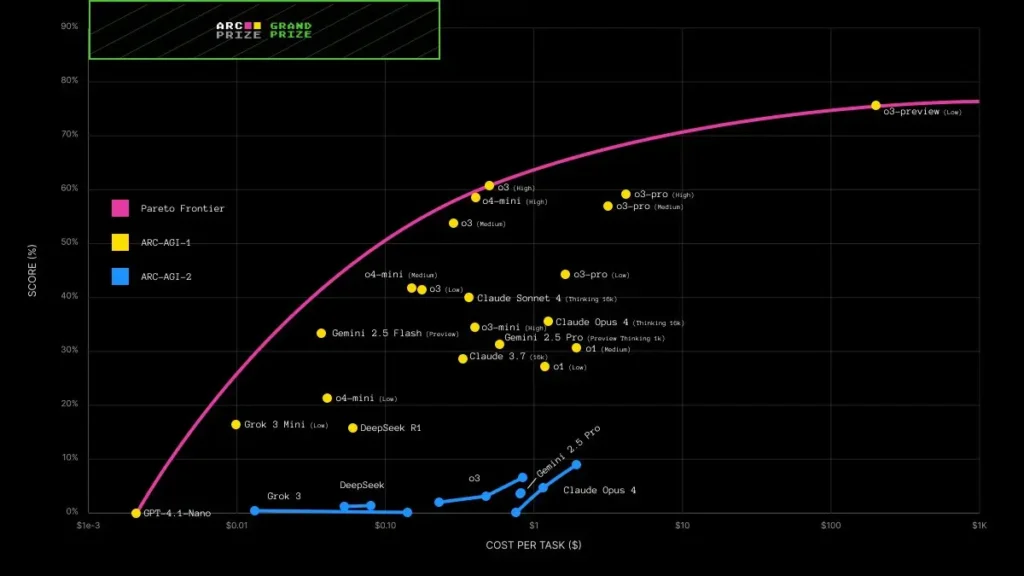

A OpenAI avaliou rigorosamente o o3-pro em diversas avaliações padrão de IA para validar sua capacidade de raciocínio. No domínio da matemática, o o3-pro supera o Gemini 2.5 Pro do Google no benchmark AIME 2024, demonstrando raciocínio lógico superior e resolução de equações complexas em condições cronometradas. Da mesma forma, no benchmark GPQA Diamond — que mede a compreensão científica e a resolução de problemas em nível de doutorado — o o3-pro supera o Claude 4 Opus da Anthropic, destacando sua profundidade em raciocínio científico avançado.

O o3-pro se baseia nos pontos fortes do modelo principal da OpenAI, o o3, integrando navegação na web em tempo real, análise de arquivos, compreensão visual e execução dinâmica de Python em uma única interface. De acordo com a OpenAI, essa capacidade aprimorada de raciocínio permite que o o3-pro execute tarefas complexas — como interpretação de dados científicos, depuração de código longo e geração de conteúdo multimodal — com maior confiabilidade do que seu antecessor.

Confiabilidade em vez de latência

Esses novos recursos apresentam desvantagens: os tempos de resposta do o3-pro são consideravelmente mais lentos que os do o3, refletindo as etapas extras de computação e processamento de contexto necessárias para o uso avançado da ferramenta. Os primeiros usuários relatam latências típicas de 1.5 a 2 vezes maiores que as do o3 em prompts equivalentes, embora os números exatos variem de acordo com a complexidade da solicitação.

Limitações de recursos no lançamento

No lançamento, os usuários do o3‑pro notaram algumas limitações temporárias: a geração de imagens permanece indisponível e certos recursos do ChatGPT — como sessões efêmeras do "Canvas" e conversas temporárias — estão desativados enquanto a OpenAI dimensiona a infraestrutura para o novo modelo. Espera-se que essas restrições sejam flexibilizadas nos próximos meses, à medida que a capacidade aumenta.

Como o o3‑pro se sai em relação aos benchmarks do setor?

Testes de raciocínio padronizados

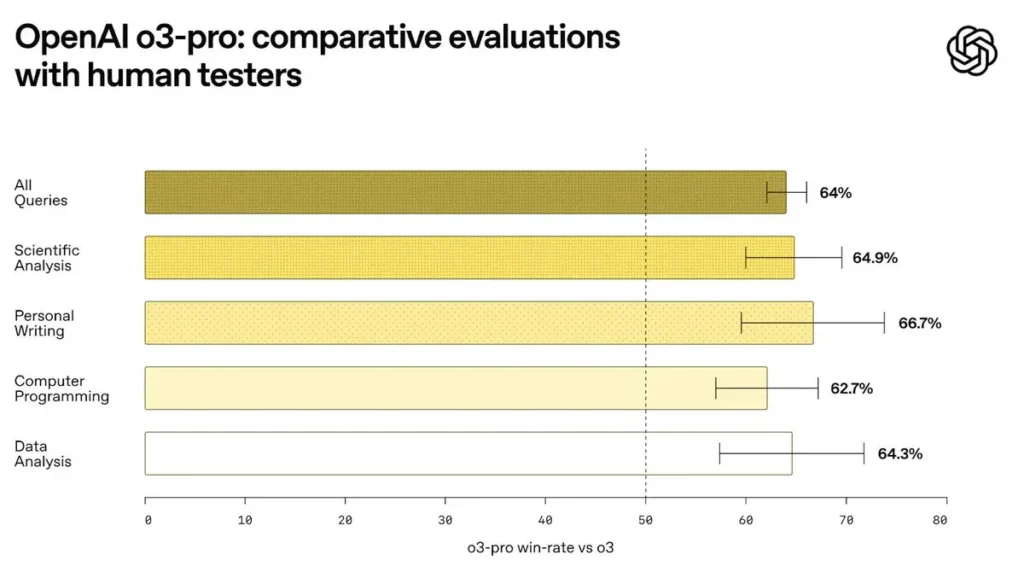

Em testes internos, o o3‑pro superou o o3 por uma margem considerável em suítes de raciocínio padronizadas que abrangem matemática, quebra-cabeças lógicos e desafios de programação. As pontuações relatadas pela comunidade colocam o o3 em cerca de 2,517 pontos, enquanto o o3‑pro pontua perto de 2,748 — uma melhoria de aproximadamente 9%.

Avaliações de codificação do mundo real

Desenvolvedores que realizam tarefas de geração e depuração de código ao vivo observaram que o o3-pro produz resultados sintaticamente mais corretos e semanticamente mais precisos em cenários de execução única e de poucas tentativas. Benchmarks em repositórios de codificação como o CodeSearchNet mostram um aumento de 5 a 7% na correção funcional em relação ao o3, especialmente em problemas de contexto longo que excedem 4,000 tokens.

Desempenho comparativo com concorrentes

Em testes comparativos, o o3-pro não só supera o Gemini 2.5 Pro e o Claude 4 Opus em pontuações brutas, mas também fornece resultados mais consistentes em testes de estresse adversário. Ao combinar o tratamento de entrada multimodal e o uso dinâmico de ferramentas, o o3-pro diminui a diferença com modelos especializados de rivais como o Google PaLM e o Anthropic Claude X. Os primeiros testes comparativos indicam que o o3-pro iguala ou excede a precisão dos concorrentes em benchmarks de raciocínio complexo, embora relatórios abrangentes de terceiros ainda estejam por vir.

Que estrutura de preços os desenvolvedores devem esperar?

Modelo de cobrança baseado em token

A OpenAI continua sua cobrança baseada em tokens: o o3-pro custa US$ 20 por milhão de tokens de entrada e US$ 80 por milhão de tokens de saída — exatamente dez vezes o custo do modelo padrão do o3 após seu recente corte de preço. Em contraste, o o3 agora custa US$ 2 por milhão de tokens de entrada e US$ 8 por milhão de tokens de saída, após uma redução de preço de 80% no início de junho de 2025.

| Modelo | Preço do Token de Entrada | Preço do Token de Saída |

|---|---|---|

| o3 | $ 2 / 1 milhão de tokens | $ 8 / 1 milhão de tokens |

| o3-pro | $ 20 / 1 milhão de tokens | $ 80 / 1 milhão de tokens |

Justificativa por trás do prêmio

Esse aumento de preço de dez vezes reflete os recursos computacionais adicionais, a infraestrutura de alto rendimento e as integrações de ferramentas especializadas exigidas pelo o3-pro. A OpenAI posiciona o o3-pro como um modelo de "missão crítica" para aplicações em que a precisão e o raciocínio avançado justificam o custo adicional.

Descontos por volume e API em lote

Empresas que processam grandes volumes de tokens ainda podem aproveitar a API Batch para economizar até 50% em entradas e saídas armazenadas em cache. Embora esse mecanismo beneficie principalmente usuários de alto volume de variantes do GPT-4.1, espera-se que opções semelhantes de processamento em lote sejam implementadas para modelos da série O ainda em 2025.

Como desenvolvedores e equipes podem acessar o o3‑pro?

Disponibilidade de API

Em testes comparativos, o o3-pro não só supera o Gemini 2.5 Pro e o Claude 4 Opus em pontuações brutas, mas também oferece resultados mais consistentes em testes de estresse adversários.

A OpenAI tornou o o3‑pro acessível por meio de sua API pública em 10 de junho de 2025, com suporte imediato nos endpoints de Conclusão e Bate-papo. Os desenvolvedores podem especificar o "o3-pro" modelo em suas chamadas de API, sujeito a limites de taxa e restrições de cota vinculados ao seu nível de assinatura.

POST https://api.openai.com/v1/chat/completions

{

"model": "o3-pro",

"messages": ,

"max_tokens": 1500

}

Planos ChatGPT Pro e Team

Os assinantes do ChatGPT Pro e Team têm acesso direto ao o3‑pro na interface do ChatGPT. Os usuários podem alternar entre o o3 e o o3‑pro no seletor de modelos, embora a disponibilidade inicial seja limitada a um subconjunto de clientes corporativos e testadores beta.

Via API CometAPI

Os desenvolvedores podem acessar API o3-Pro(modelo: "o3-Pro"ou"o3-pro-2025-06-10") através CometAPI, os modelos mais recentes listados são da data de publicação do artigo. Para começar, explore as capacidades do modelo no Playground e consulte o Guia de API para obter instruções detalhadas. Antes de acessar, certifique-se de ter feito login no CometAPI e obtido a chave da API. CometAPI oferecem um preço muito mais baixo que o preço oficial para ajudar você a se integrar.

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.cometapi.com/v1",

api_key="<YOUR_API_KEY>",

)

response = client.chat.completions.create(

model="o3-Pro",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices.message.content

print(f"Assistant: {message}")

Quais casos de uso prático se beneficiam mais do o3‑pro?

Pesquisa Científica e Análise de Dados

Pesquisadores que trabalham com grandes conjuntos de dados — que vão da genômica às simulações climáticas — podem aproveitar os recursos de análise de arquivos e execução do Python do o3-pro para automatizar testes de hipóteses e gerar insights sem restrições de comprimento de contexto.

Fluxos de trabalho de conhecimento empresarial

Em setores como finanças e serviços jurídicos, onde precisão e auditabilidade são fundamentais, a melhor adesão às instruções e o raciocínio multimodal do o3‑pro reduzem as taxas de erro em revisões de contratos, modelagem financeira e tarefas de conformidade regulatória.

Desenvolvimento de Software e DevOps

Ao combinar a compreensão de código de longo contexto com testes ao vivo por meio da execução do Python, o o3-pro simplifica a depuração e automatiza fluxos de trabalho de refatoração complexos, acelerando os ciclos de entrega de projetos de software de larga escala.

O que as organizações devem considerar antes de atualizar?

Análise de Custo-Benefício

As equipes devem ponderar o aumento de preço de 10 vezes em relação aos ganhos de eficiência projetados. Para tarefas de alto valor e baixo volume — como a elaboração de relatórios estratégicos ou a construção de sistemas de segurança críticos — a precisão e o suporte de ferramentas podem justificar o preço premium do o3-pro. Para geração de conteúdo em massa, optar pelos modelos padrão o3 ou o4-mini pode ser mais econômico.

Preparação da infraestrutura

Como o o3‑pro impõe maiores demandas de latência e taxa de transferência, as organizações devem auditar seus limites de taxa de API, capacidade de rede e estratégias de repetição de erros para evitar gargalos durante o pico de uso.

Em conclusão

O modelo o3-pro da OpenAI estabelece um novo padrão para raciocínio avançado, compreensão multimodal e uso integrado de ferramentas em IA. Seus ganhos de benchmark e melhorias de confiabilidade o tornam uma opção atraente para aplicações de missão crítica, desde que os orçamentos e a infraestrutura possam suportar os custos elevados. À medida que o cenário da IA evolui, o papel do o3-pro se consolidará em áreas que exigem os mais altos níveis de precisão e profundidade contextual, enquanto cargas de trabalho mais sensíveis a custos poderão continuar a utilizar modelos básicos da série o ou minivariantes emergentes.