Mistral 3 — ключевой релиз семейства моделей Mistral AI конца 2025 года. Он сочетает компактные, быстрые модели, ориентированные на локальное/периферийное (edge) развёртывание, и очень большую разрежённую флагманскую модель, которая продвигает передовой масштаб и длину контекста. В этой статье объясняется, что такое Mistral 3, как он устроен, почему вам может понадобиться запускать его локально, и три практических способа запустить его на вашем компьютере или приватном сервере — от «click-to-run»‑удобства Ollama до продакшен‑сервинга на GPU с vLLM/TGI и инференса на ЦП малых устройств с GGUF + llama.cpp.

Что такое Mistral 3?

Mistral 3 — это последнее поколение моделей с открытыми весами от Mistral AI. Семейство включает как массивную Mistral Large 3 (разрежённую модель типа Mixture‑of‑Experts — MoE), так и несколько edge/«ministral»‑вариантов (3B, 8B, 14B), настроенных на следование инструкциям и мультимодальные (текст+визуальные) задачи. Mistral позиционирует релиз как широко применимый: от высокопроизводительного инференса в дата‑центрах (со специализированными оптимизированными чекпоинтами) до использования на периферии и ноутбуках благодаря квантизованным форматам и меньшим вариантам.

Key practical properties :

- Архитектура Mixture‑of‑Experts (MoE) в варианте Large 3 даёт очень большое «общее» число параметров, при этом на каждый токен активируется лишь подмножество экспертов — это повышает эффективность в масштабе.

- Семейство Ministral 3 (3B / 8B / 14B), предназначенное для edge и локального использования, с вариантами, настроенными на инструкции и мультимодальность.

- Официальные чекпоинты и набор оптимизированных чекпоинтов (NVFP4/FP8) для ускоренных рантаймов вроде vLLM и платформ NVIDIA.

- Мультимодальность + многоязычность + длинный контекст — варианты Ministral и Large делают акцент на понимании изображений и текста и широком языковом охвате. Для приложений, где сочетаются изображения и длинные документы, это важно.

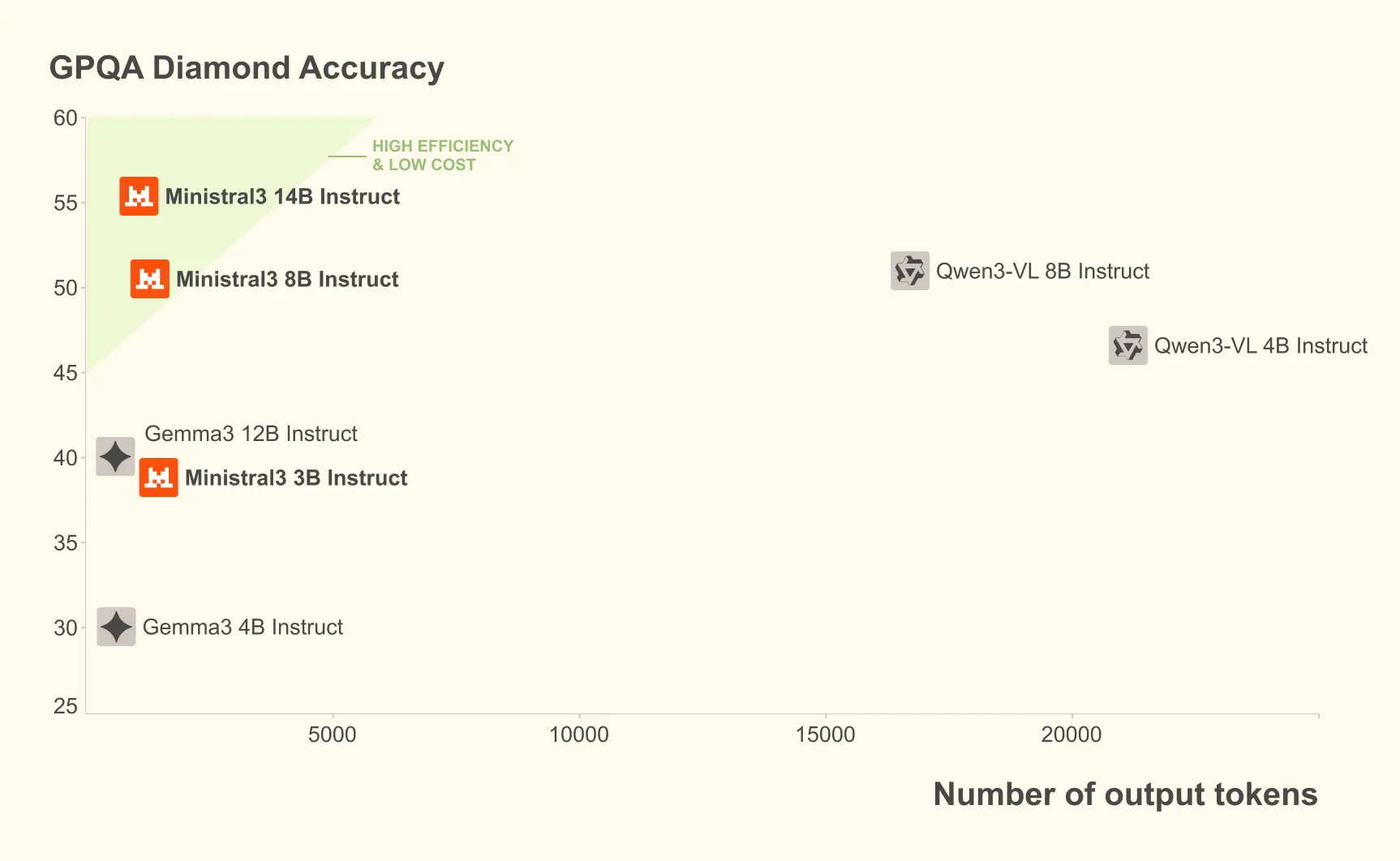

На наборе данных GPQA Diamond (строгий тест научного рассуждения) различные варианты Ministral 3 сохраняют высокую точность даже при увеличении числа выходных токенов. Например, модель Ministral 3B Instruct держит точность 35-40% при обработке до 20,000 токенов, сопоставимую с более крупными моделями вроде Gemma 2 9B, при меньших затратах ресурсов.

Какова архитектура Mistral 3?

Mistral 3 — это семейство, а не одна архитектура, но есть два архитектурных паттерна, которые стоит понимать:

Плотные малые модели (Ministral 3)

- Стандартные трансформерные стеки, оптимизированные для эффективности и инференса на периферии.

- Доступны в нескольких размерах (3B/8B/14B) и разных донастройках: base, instruct и reasoning; многие варианты включают нативную мультимодальность (vision + text) и работу с длинным контекстом. Модели Ministral выпускаются с оптимизированными весами FP8 для компактности в некоторых дистрибуциях.

Разрежённая Mixture‑of‑Experts (Mistral Large 3)

- Архитектура MoE: у модели много экспертов (огромное общее число параметров), но на каждый токен вычисляется лишь подмножество, выбранное маршрутизатором — это даёт лучший компромисс между масштабом и вычислениями.

- Mistral Large 3 указывает ~675B общих параметров при ~41B активных параметрах на инференсе, что отражает дизайн MoE. Модель обучалась на современной аппаратуре NVIDIA и оптимизирована для эффективного выполнения в низкой точности (NVFP4/TensorRT/оптимизации крупных ядер).

Технические особенности, важные при локальном запуске:

- Длинный контекст: некоторые варианты Mistral 3 поддерживают очень длинные контексты (в документации vLLM и Mistral упоминаются огромные окна контекста для отдельных вариантов; например, 256k в некоторых Ministral). Это влияет на память и паттерны сервинга.

- Форматы весов и квантизация: Mistral предоставляет веса в сжатых/оптимизированных форматах (FP8, NVFP4) и работает с современными инструментами квантизации (BitsAndBytes, GPTQ, вендорские тулчейны) для практического локального инференса.

Зачем запускать Mistral 3 локально?

Запуск LLM локально — больше не нишевое хобби, а практичный вариант для команд и отдельных пользователей, которым важны:

- Конфиденциальность данных и соответствие требованиям. Локальный хостинг удерживает чувствительные данные в вашей инфраструктуре (важно для финансов, здравоохранения, юриспруденции). Reuters сообщал о крупных клиентах, выбирающих самостоятельный хостинг моделей Mistral.

- Задержка и контроль затрат. Для жёстких SLO по задержке и предсказуемых затрат локальный или приватный кластерный инференс может оказаться дешевле облачных API. Меньшие варианты ministral и квантизованные форматы делают это практичным.

- Кастомизация и дообучение. Если нужна кастомная логика, function calling или новые модальности, локальный контроль позволяет настраивать обучение и обработку данных. Интеграции Hugging Face и vLLM упрощают это.

Если ваши приоритеты — приватность, контроль, предсказуемость затрат или исследования — стоит рассмотреть локальное развёртывание.

Как запустить Mistral 3 локально (три практических метода)?

Существует много способов локального запуска Mistral 3. Ниже — три подхода, покрывающие самые распространённые сценарии:

- Ollama (настольный/локальный сервер без конфигов, самый простой для многих пользователей)

- Hugging Face Transformers + PyTorch / vLLM (полный контроль, кластеры GPU)

- llama.cpp / ggml / GGUF квантизованный инференс на ЦП (лёгкий, работает на ноутбуках/ЦП)

Для каждого метода приведены случаи применения, предпосылки, пошаговые команды и небольшие примеры кода.

1) Как запустить Mistral 3 с Ollama (самый быстрый путь)?

Когда использовать: вам нужен беспрепятственный локальный опыт (macOS/Linux/Windows), удобный CLI или GUI и автоматическая загрузка/квантизованные артефакты при их наличии. В Ollama есть записи моделей для Ministral 3 и других членов семейства Mistral.

Предпосылки

- Установленная Ollama (следуйте установщику на ollama.com). Библиотека Ollama указывает минимальные версии для некоторых релизов ministral.

- Достаточно места на диске для артефактов модели (размеры различаются — квантизованные версии ministral 3B могут занимать несколько ГБ; крупные BF16‑варианты — многие десятки ГБ).

Шаги (пример)

- Установите Ollama (пример для macOS — замените под вашу платформу):

# macOS (Homebrew) example — see ollama.com for platform-specific installersbrew install ollama

- Запустите модель ministral:

# Pull and run the model interactivelyollama run ministral-3

- Поднимите локальный сервер (API) и вызывайте из кода:

# Run Ollama server (default port shown in docs)ollama serve# Then curl against it (example)curl -s -X POST "http://localhost:11434/api/v1/generate" \ -H "Content-Type: application/json" \ -d '{"model":"ministral-3","prompt":"Summarize Mistral 3 in one sentence."}'

Notes & tips

- Ollama берёт на себя загрузку модели и (когда доступны) локальные квантизованные варианты — очень удобно для быстрого знакомства.

- Если планируете продакшен с большим числом параллельных запросов, Ollama отлично подходит для прототипирования, но оцените масштабирование и оркестрацию ресурсов для стабильной нагрузки.

2) Как запустить Mistral 3 с Hugging Face Transformers (GPU / интеграция vLLM)?

Когда использовать: вам нужен программный контроль для исследований или продакшена, вы хотите донастраивать модель или использовать ускоренные стеки инференса вроде vLLM на GPU‑кластерах. Hugging Face предоставляет поддержку Transformers, а Mistral предлагает оптимизированные чекпоинты для vLLM/NVIDIA.

Предпосылки

- GPU с достаточной памятью (зависит от модели и точности). Малые Ministral 3 (3B/8B) могут работать на одном среднем GPU при квантизации; крупные варианты требуют нескольких H100/A100 или оптимизированных чекпоинтов NVFP4 для vLLM. NVIDIA и Mistral в документации рекомендуют конкретные конфигурации узлов для больших моделей.

- Python, PyTorch, transformers, accelerate (или vLLM, если нужен этот сервер).

Пример на Python — базовый конвейер Hugging Face (вариант 3B instruct, GPU):

# Example: CPU/GPU inference with transformers pipeline# Assumes you have CUDA and a compatible PyTorch build.import torchfrom transformers import pipelinemodel_name = "mistralai/Ministral-3-3B-Instruct-2512-BF16" # example HF model idgenerator = pipeline( "text-generation", model=model_name, device_map="auto", torch_dtype=torch.bfloat16, # use bfloat16 if your hardware supports it)prompt = "Explain how attention helps transformers, in 3 sentences."out = generator(prompt, max_new_tokens=120, do_sample=False)print(out[0]["generated_text"])

Использование vLLM для продакшена на GPU

vLLM разработан для эффективного обслуживания больших моделей, поддерживает семейство Mistral 3, а Mistral публикует чекпоинты, оптимизированные для vLLM/аппаратуры NVIDIA (NVFP4/FP8), чтобы уменьшить занимаемую память и повысить скорость. Запуск сервера vLLM даёт низкую задержку и батчированный инференс. См. рецепты vLLM и рекомендации Mistral по путям моделей и рекомендуемым флагам.

Notes & tips

- Для продакшена предпочитайте оптимизированные чекпоинты (NVFP4/FP8) и запускайте на рекомендованных GPU (например, H100/A100) или используйте оркестрацию с поддержкой тензорного/модельного параллелизма. У Mistral и NVIDIA есть документация и блоги по оптимизированным рантаймам.

- Всегда фиксируйте точный чекпоинт модели на диске (или воспроизводимый снапшот HF) — для воспроизводимости и чтобы избежать незаметных обновлений модели.

3) Как запустить Mistral 3 на ЦП через llama.cpp / квантизованные GGUF‑модели?

Когда использовать: вам нужен локальный офлайн‑инференс на ЦП (например, ноутбук разработчика, защищённая изолированная среда) и вы готовы немного пожертвовать качеством ради скорости и памяти. Этот метод использует ggml/llama.cpp и квантизованные веса GGUF (q4/q5/и т. д.).

Предпосылки

- Квантизованная GGUF‑сборка модели Ministral (многие участники сообщества публикуют GGUF на Hugging Face или конвертируют BF16‑веса в GGUF локально). Ищите варианты

Ministral-3-3B-Instructв GGUF. - Собранный бинарник llama.cpp (следуйте README проекта).

Квантизация (если у вас исходные веса) — пример (концептуально)

# Example: quantize from an FP16/BF16 model to a GGUF q4_K_M (syntax depends on llama.cpp version)./quantize /path/to/original/model.bin /path/to/out.gguf q4_k_m

Запуск GGUF в llama.cpp

# run interactive inference with a quantized GGUF model./main -m /path/to/ministral-3-3b-instruct.gguf -t 8 -c 2048 --interactive# -t sets threads, -c sets context (tokens) if supported

Пример на Python (локальный сервер llama.cpp или подпроцесс)

Можно породить llama.cpp как подпроцесс и передавать ему подсказки, либо использовать небольшой клиент‑обёртку. Многие проекты сообщества дают простой HTTP‑сервер поверх llama.cpp для интеграции в локальные приложения.

Notes & tradeoffs

- Квантизация снижает требования к VRAM и позволяет инференс на ЦП, но может уменьшить качество (от лёгкого до умеренного, зависит от формата). Форматы вроде q4_K_M или варианты q5 — распространённые компромиссы для ЦП. Японские и технические посты подробно объясняют типы Q4/Q5 и конверсии в GGUF.

- Для малых и средних нагрузок GGUF + llama.cpp часто самый дешёвый и портативный способ локального запуска LLM.

Какие аппаратные и память‑соображения важны?

Короткие практические рекомендации:

- Модели 3B: их часто можно квантизовать и запускать на нормальном ноутбучном ЦП или одном GPU с 8–16 ГБ VRAM (в зависимости от точности/квантизации). Варианты GGUF q4 работают на многих современных ЦП.

- 8B и 14B «министры»: обычно требуют среднего уровня GPU (например, 24–80 ГБ в зависимости от точности и кэширования активаций) или квантизации по нескольким устройствам.

- Mistral Large 3 (675B всего, 41B активных): предназначена для развёртывания в дата‑центрах и лучше всего работает на узлах с несколькими GPU (например, 8×A100 или H100) и специальными форматами (NVFP4/FP8) для vLLM. Mistral явно публикует оптимизированные чекпоинты, чтобы сделать такие деплойменты реализуемыми.

Если ваш приоритет — локальный запуск на ноутбуке, ориентируйтесь на маршрут с квантизованной Ministral 3B GGUF + llama.cpp. Если приоритет — производительная обработка в продакшене, смотрите vLLM + NVFP4‑чекпоинты на GPU. Если нужна простота экспериментов, Ollama — самый быстрый старт.

Как выбирать квантизацию и точность?

Квантизация — это компромисс: память и скорость против качества модели. Распространённые варианты:

- q4_0 / q4_1 / q4_K_M: популярные 4‑битные форматы для инференса на ЦП; q4_K_M (вариант k‑means) часто даёт лучший баланс качества/производительности.

- q5 / q8 / imatrix: промежуточные форматы, которые могут лучше сохранять качество, но больше весят.

- FP16 / BF16 / FP8 / NVFP4: точности на GPU — BF16 и FP16 распространены для обучения/инференса на современных GPU; FP8 / NVFP4 — новые форматы, экономящие память для очень больших моделей, поддерживаются оптимизированными рантаймами и релизами чекпоинтов Mistral.

Правило большого пальца: для локального запуска на ЦП выбирайте q4_K_M или аналог; для инференса на GPU с высокой точностью используйте BF16/FP16 или вендорские FP8/NVFP4 при поддержке рантайма.

Заключение — стоит ли запускать Mistral 3 локально?

Если вам нужны приватность, низкая задержка или кастомизация, да: семейство Mistral 3 предоставляет широкий набор — маленькие модели для периферийных ЦП, средние для одного GPU или небольшого кластера и большую MoE‑версию для масштаба дата‑центров — а экосистема (Ollama, Hugging Face, vLLM, llama.cpp) уже поддерживает практические паттерны локального и приватного развёртывания. Mistral также совместно с NVIDIA и vLLM подготовил оптимизированные чекпоинты для высокой пропускной способности и сниженного footprint по памяти, что делает продакшен‑самохостинг более реалистичным, чем раньше.

Чтобы начать, изучите больше возможностей модели (например, Gemini 3 Pro) в Playground и обратитесь к API guide за подробными инструкциями. Перед доступом убедитесь, что вы вошли в CometAPI и получили ключ API. CometAPI предлагает цену значительно ниже официальной, чтобы помочь вам интегрироваться.

Готовы начать?→ Sign up for CometAPI today !