Mistral 3 เป็นรุ่นไฮไลต์ของตระกูลโมเดลช่วงปลายปี 2025 จาก Mistral AI มาพร้อมส่วนผสมของโมเดลขนาดกะทัดรัด รวดเร็ว ที่มุ่งสู่การใช้งานแบบ local/edge และเรือธงแบบ sparse ขนาดใหญ่มากที่ผลักดันขีดจำกัดของสเกลและความยาวบริบทระดับ state-of-the-art บทความนี้อธิบายว่า Mistral 3 คืออะไร สร้างอย่างไร ทำไมคุณอาจอยากรันแบบโลคัล และสามวิธีเชิงปฏิบัติในการรันบนเครื่องหรือเซิร์ฟเวอร์ส่วนตัวของคุณ — ตั้งแต่ความสะดวกแบบ “คลิกแล้วรัน” ของ Ollama ไปจนถึงการเสิร์ฟ GPU ระดับโปรดักชันด้วย vLLM/TGI ไปจนถึงการอินเฟอเรนซ์บน CPU ของอุปกรณ์จิ๋วด้วย GGUF + llama.cpp

Mistral 3 คืออะไร?

Mistral 3 เป็นเจเนอเรชันล่าสุดของโมเดลแบบ open-weight จาก Mistral AI ตระกูลนี้ประกอบด้วย Mistral Large 3 ขนาดมหึมา (โมเดลแบบ Mixture-of-Experts — MoE — ที่มีโครงสร้าง sparse) และหลายรุ่นสำหรับ edge/“ministral” (3B, 8B, 14B) ที่ปรับแต่งเพื่อการทำตามคำสั่งและงานมัลติโหมด (ข้อความ+ภาพ) Mistral วางตำแหน่งการปล่อยรุ่นนี้ให้ใช้งานได้กว้าง: ตั้งแต่การอินเฟอเรนซ์ศูนย์ข้อมูลประสิทธิภาพสูง (พร้อมเช็คพอยท์ที่ปรับแต่งเฉพาะ) ไปจนถึงการใช้งานบนขอบและแล็ปท็อปผ่านรูปแบบควอนไทซ์และรุ่นที่เล็กลง

คุณสมบัติที่สำคัญในทางปฏิบัติ :

- สถาปัตยกรรม Mixture-of-Experts (MoE) ในรุ่น Large 3 ที่ให้จำนวนพารามิเตอร์รวมมหาศาล แต่เปิดใช้งานเฉพาะบางส่วนของ experts ต่อโทเค็น — ช่วยเพิ่มประสิทธิภาพเมื่อขยายสเกล

- ตระกูล Ministral 3 (3B / 8B / 14B) เพื่อการใช้งานบนขอบและโลคัล มีรุ่นที่ปรับแต่งตามคำสั่งและมัลติโหมด

- เช็คพอยท์ทางการและชุดเช็คพอยท์ที่ปรับแต่ง (NVFP4/FP8) สำหรับรันไทม์เร่งความเร็ว เช่น vLLM และแพลตฟอร์ม NVIDIA

- มัลติโหมด + หลายภาษา + บริบทยาว — ministers และรุ่นขนาดใหญ่ให้ความสำคัญกับความเข้าใจภาพ+ข้อความและครอบคลุมภาษากว้าง สำหรับแอปพลิเคชันที่ผสมภาพ + เอกสารยาว ประเด็นนี้สำคัญ

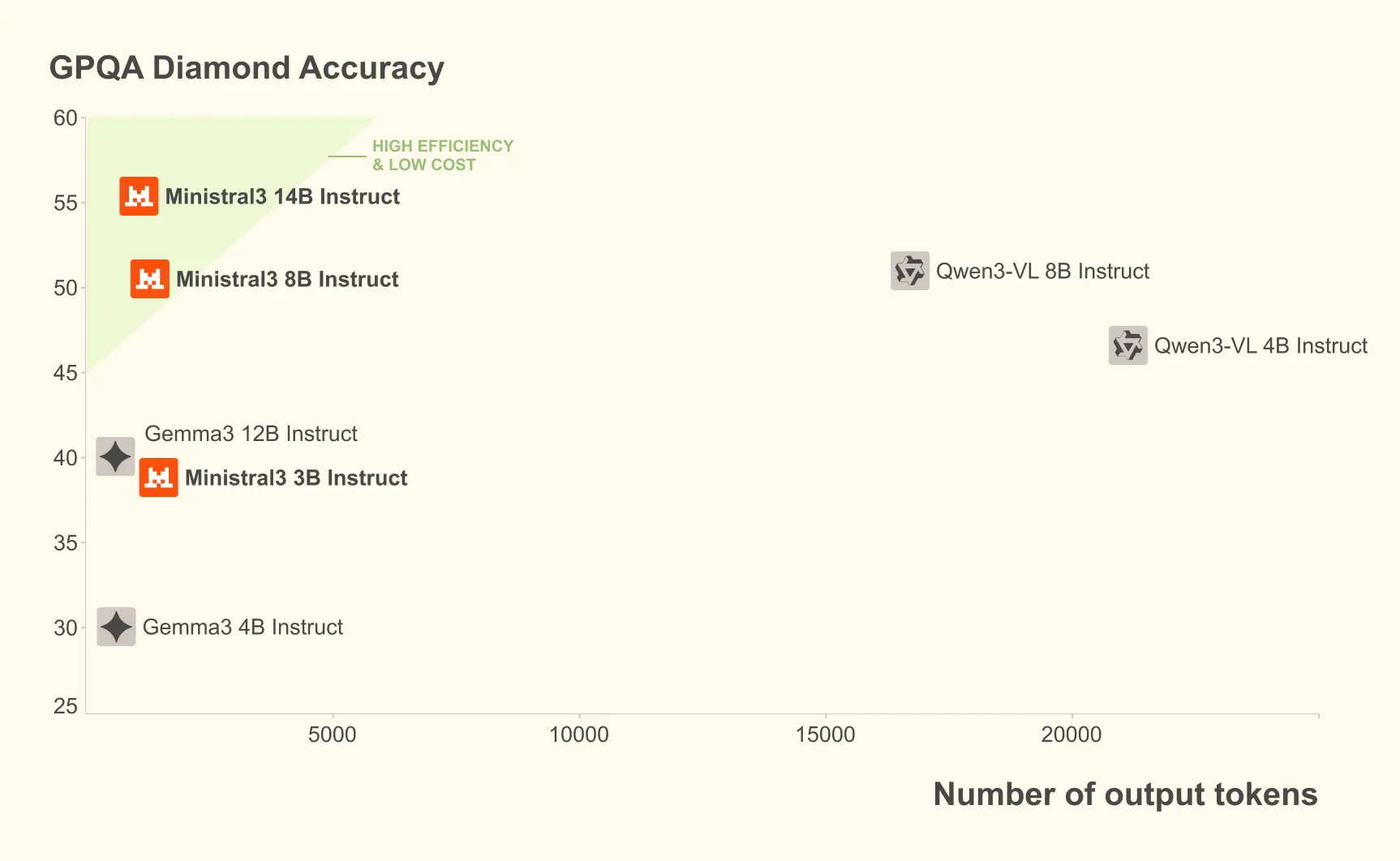

บนชุดข้อมูล GPQA Diamond (การทดสอบการให้เหตุผลทางวิทยาศาสตร์อย่างเข้มงวด) รุ่นต่างๆ ของ Miniral 3 รักษาความแม่นยำสูงแม้จำนวนโทเค็นผลลัพธ์เพิ่มขึ้น ตัวอย่างเช่นรุ่น Miniral 3B Instruct รักษาความแม่นยำ 35–40% เมื่อต้องจัดการถึง 20,000 โทเค็น เทียบเคียงกับโมเดลที่ใหญ่กว่าอย่าง Gemma 2 9B ขณะใช้ทรัพยากรน้อยกว่า

สถาปัตยกรรมของ Mistral 3 เป็นอย่างไร?

Mistral 3 เป็นทั้งครอบครัว ไม่ใช่สถาปัตยกรรมเดียว แต่มีรูปแบบสถาปัตยกรรมสองแบบที่ควรเข้าใจ:

โมเดลขนาดเล็กแบบ Dense (Ministral 3)

- สแต็กทรานส์ฟอร์เมอร์มาตรฐาน ปรับให้มีประสิทธิภาพและเหมาะกับการอินเฟอเรนซ์บนขอบ

- มีหลายขนาด (3B/8B/14B) และหลายสายการปรับแต่ง: base, instruct และ reasoning; หลายรุ่นรองรับมัลติโหมดโดยกำเนิด (ภาพ + ข้อความ) และบริบทยาว รุ่น Minstral เผยแพร่ด้วยน้ำหนัก FP8 ที่ปรับให้กระทัดรัดในบางดิสทริบิวชัน

แบบ Sparse Mixture-of-Experts (Mistral Large 3)

- สถาปัตยกรรม MoE: โมเดลมี experts จำนวนมาก (จำนวนพารามิเตอร์รวมมหาศาล) แต่จะประเมินเฉพาะส่วนที่ถูก routing เลือกต่อโทเค็น — ให้สมดุลสเกลต่อคอมพิวต์ที่ดีกว่า

- Mistral Large 3 ระบุพารามิเตอร์รวมประมาณ ~675B โดยมี ~41B พารามิเตอร์ที่ active ระหว่างอินเฟอเรนซ์ สะท้อนการออกแบบ MoE โมเดลถูกฝึกบนฮาร์ดแวร์ NVIDIA รุ่นใหม่และปรับให้ทำงานความแม่นยำต่ำอย่างมีประสิทธิภาพ (NVFP4/TensorRT/การปรับ large-kernel)

คุณสมบัติทางเทคนิคที่สำคัญเมื่อรันแบบโลคัล:

- บริบทยาว: บางรุ่นของ Mistral 3 รองรับบริบทที่ยาวมาก (เอกสาร vLLM และ Mistral กล่าวถึงหน้าต่างบริบทขนาดมหึมาสำหรับบางรุ่น; เช่น 256k ในบางรุ่น Ministral) ซึ่งส่งผลต่อรูปแบบการใช้หน่วยความจำและการเสิร์ฟ

- รูปแบบน้ำหนัก & การควอนไทซ์: Mistral จัดเตรียมน้ำหนักในรูปแบบที่บีบอัด/ปรับแต่ง (FP8, NVFP4) และทำงานร่วมกับชุดเครื่องมือควอนไทซ์สมัยใหม่ (BitsAndBytes, GPTQ, เครื่องมือผู้ขาย) เพื่อการอินเฟอเรนซ์โลคัลที่ใช้งานได้จริง

ทำไมคุณถึงอยากรัน Mistral 3 แบบโลคัล?

การรัน LLM แบบโลคัลไม่ใช่งานอดิเรกเฉพาะกลุ่มอีกต่อไป — เป็นตัวเลือกที่ใช้งานได้จริงสำหรับทีมและบุคคลที่ใส่ใจ:

- ความเป็นส่วนตัวของข้อมูลและการปฏิบัติตามข้อกำหนด การโฮสต์ภายในช่วยเก็บอินพุตที่อ่อนไหวไว้ในโครงสร้างพื้นฐานของคุณ (สำคัญสำหรับการเงิน การแพทย์ กฎหมาย) Reuters รายงานว่าลูกค้าระดับสูงเลือกโฮสต์โมเดล Mistral ด้วยตนเอง

- Latency และการควบคุมต้นทุน สำหรับ SLO ด้าน latency ที่เข้มงวดและต้นทุนที่คาดการณ์ได้ การอินเฟอเรนซ์แบบโลคัลหรือคลัสเตอร์ส่วนตัวอาจเหนือกว่า API บนคลาวด์ รุ่น ministral ที่เล็กและรูปแบบควอนไทซ์ทำให้สิ่งนี้เป็นไปได้จริง

- การปรับแต่งและการปรับจูน เมื่อคุณต้องการพฤติกรรมเฉพาะ การเรียกฟังก์ชัน หรือโมดาลิตี้ใหม่ การควบคุมแบบโลคัลช่วยให้ปรับจูนและจัดการข้อมูลได้ Hugging Face และ vLLM ผสานรวมให้ตั้งค่าได้สะดวกขึ้น

หากเหตุผลเหล่านี้สอดคล้องกับลำดับความสำคัญของคุณ — ความเป็นส่วนตัว การควบคุม ความคาดการณ์ต้นทุน หรือการวิจัย — การปรับใช้แบบโลคัลน่าพิจารณา

จะรัน Mistral 3 แบบโลคัลได้อย่างไร (สามวิธีเชิงปฏิบัติ)?

มีหลายวิธีในการรัน Mistral 3 แบบโลคัล ฉันจะครอบคลุมสามแนวทางที่พบได้บ่อย:

- Ollama (เดสก์ท็อป/เซิร์ฟเวอร์โลคัลแบบ zero-config ใช้ง่ายที่สุดสำหรับหลายคน)

- Hugging Face Transformers + PyTorch / vLLM (ควบคุมเต็มรูปแบบ คลัสเตอร์ GPU)

- llama.cpp / ggml / การอินเฟอเรนซ์ CPU แบบ GGUF ที่ควอนไทซ์ (เบา รันบนแล็ปท็อป/CPU)

สำหรับแต่ละวิธีจะบอกว่าเมื่อใดเหมาะสม ข้อกำหนดเบื้องต้น คำสั่งทีละขั้น และตัวอย่างโค้ดขนาดเล็ก

1) จะรัน Mistral 3 ด้วย Ollama ได้อย่างไร (ทางที่เร็วที่สุด)?

เมื่อควรใช้: คุณต้องการประสบการณ์โลคัลแบบไร้แรงเสียดทาน (macOS/Linux/Windows) ทั้ง CLI หรือ GUI ที่เข้าถึงง่าย และดาวน์โหลดอัตโนมัติ/อาร์ติแฟกต์แบบควอนไทซ์เมื่อมี Ollama มีรายการโมเดลสำหรับ Ministral 3 และสมาชิกตระกูล Mistral อื่นๆ

ข้อกำหนดเบื้องต้น

- ติดตั้ง Ollama แล้ว (ตามตัวติดตั้งบน ollama.com) ไลบรารีของ Ollama ระบุเวอร์ชันขั้นต่ำสำหรับบางรุ่น ministral

- พื้นที่ดิสก์เพียงพอเพื่อเก็บอาร์ติแฟกต์โมเดล (ขนาดโมเดลต่างกัน — รุ่น ministral 3B แบบควอนไทซ์อาจมีขนาดไม่กี่ GB; รุ่นใหญ่แบบ BF16 มีขนาดหลายสิบ GB)

ขั้นตอน (ตัวอย่าง)

- ติดตั้ง Ollama (ตัวอย่าง macOS — ปรับตามแพลตฟอร์ม):

# macOS (Homebrew) example — see ollama.com for platform-specific installersbrew install ollama

- รันโมเดล ministral:

# Pull and run the model interactivelyollama run ministral-3

- ให้บริการโลคัล (API) และเรียกจากโค้ด:

# Run Ollama server (default port shown in docs)ollama serve# Then curl against it (example)curl -s -X POST "http://localhost:11434/api/v1/generate" \ -H "Content-Type: application/json" \ -d '{"model":"ministral-3","prompt":"Summarize Mistral 3 in one sentence."}'

หมายเหตุและเคล็ดลับ

- Ollama จัดการดาวน์โหลดโมเดลและ (เมื่อมี) รุ่นควอนไทซ์โลคัล — สะดวกมากสำหรับการลองโมเดลอย่างรวดเร็ว

- หากคุณวางแผนใช้โมเดลในโปรดักชันที่มีคำขอพร้อมกันจำนวนมาก Ollama เหมาะกับการสร้างต้นแบบ แต่ควรประเมินการสเกลและการจัดทรัพยากรสำหรับโหลดคงที่

2) จะรัน Mistral 3 ด้วย Hugging Face Transformers (GPU / ผสานรวม vLLM) ได้อย่างไร?

เมื่อควรใช้: คุณต้องการการควบคุมแบบโปรแกรมสำหรับงานวิจัยหรือโปรดักชัน อยากปรับจูน หรือใช้สแต็กอินเฟอเรนซ์แบบเร่งความเร็วอย่าง vLLM บนคลัสเตอร์ GPU Hugging Face มีการรองรับ Transformers และ Mistral จัดเตรียมเช็คพอยท์ที่ปรับแต่งสำหรับ vLLM/NVIDIA

ข้อกำหนดเบื้องต้น

- GPU ที่มีหน่วยความจำเพียงพอ (ขึ้นอยู่กับโมเดลและความแม่นยำ) รุ่น ministral ขนาดเล็ก (3B/8B) สามารถรันบน GPU ระดับกลางตัวเดียวเมื่อควอนไทซ์; รุ่นที่ใหญ่กว่าต้องใช้ H100/A100 หลายตัว หรือเช็คพอยท์ NVFP4 ที่ปรับแต่งสำหรับ vLLM เอกสาร NVIDIA และ Mistral แนะนำขนาดโหนดที่เฉพาะเจาะจงสำหรับรุ่นใหญ่

- Python, PyTorch, transformers, accelerate (หรือ vLLM หากต้องการเซิร์ฟเวอร์นั้น)

ตัวอย่าง Python — pipeline ขั้นพื้นฐานของ Hugging Face (รุ่น 3B instruct, GPU):

# Example: CPU/GPU inference with transformers pipeline# Assumes you have CUDA and a compatible PyTorch build.import torchfrom transformers import pipelinemodel_name = "mistralai/Ministral-3-3B-Instruct-2512-BF16" # example HF model idgenerator = pipeline( "text-generation", model=model_name, device_map="auto", torch_dtype=torch.bfloat16, # use bfloat16 if your hardware supports it)prompt = "Explain how attention helps transformers, in 3 sentences."out = generator(prompt, max_new_tokens=120, do_sample=False)print(out[0]["generated_text"])

ใช้ vLLM สำหรับการอินเฟอเรนซ์ GPU ในโปรดักชัน

vLLM ถูกออกแบบมาเพื่อเสิร์ฟโมเดลใหญ่ได้อย่างมีประสิทธิภาพ รองรับตระกูล Mistral 3 และ Mistral เผยแพร่เช็คพอยท์ที่ปรับแต่งสำหรับฮาร์ดแวร์ vLLM/NVIDIA (NVFP4/FP8) เพื่อลดการใช้หน่วยความจำและเพิ่มความเร็ว การเริ่มเซิร์ฟเวอร์ vLLM ให้เอ็นด์พอยต์อินเฟอเรนซ์แบบ latency ต่ำและรองรับ batching ดูสูตรของ vLLM และแนวทางของ Mistral สำหรับพาธโมเดลและแฟล็กที่แนะนำ

หมายเหตุและเคล็ดลับ

- สำหรับโปรดักชัน ให้ใช้เช็คพอยท์ที่ปรับแต่ง (NVFP4/FP8) และรันบน GPU ที่แนะนำ (เช่น H100/A100) หรือใช้เลเยอร์ orchestration ที่รองรับ tensor/model parallelism Mistral และ NVIDIA มีเอกสารและบล็อกโพสต์เกี่ยวกับรันไทม์ที่ปรับแต่ง

- ควร pin เช็คพอยท์โมเดลที่แน่นอนบนดิสก์ (หรือ snapshot ของ HF ที่ทำซ้ำได้) เพื่อผลลัพธ์ที่ทำซ้ำได้ และหลีกเลี่ยงการอัปเดตโมเดลโดยไม่รู้ตัว

3) จะรัน Mistral 3 บน CPU ด้วย llama.cpp / โมเดล GGUF ที่ควอนไทซ์ได้อย่างไร?

เมื่อควรใช้: คุณต้องการอินเฟอเรนซ์แบบโลคัล ออฟไลน์ บน CPU (เช่น แล็ปท็อปนักพัฒนา สภาพแวดล้อม air-gapped ที่ปลอดภัย) และยอมแลกความแม่นยำบางส่วนเพื่อประสิทธิภาพรันไทม์และหน่วยความจำ วิธีนี้ใช้ ggml/llama.cpp และน้ำหนัก GGUF ที่ควอนไทซ์ (q4/q5/etc.)

ข้อกำหนดเบื้องต้น

- บิลด์ GGUF ที่ควอนไทซ์ของโมเดล Ministral (มีสมาชิกชุมชนจำนวนมากเผยแพร่น้ำหนัก GGUF ที่ควอนไทซ์บน Hugging Face หรือแปลงน้ำหนัก BF16 เป็น GGUF ในโลคัล) ค้นหา

Ministral-3-3B-Instructรุ่น GGUF - คอมไพล์ไบนารี llama.cpp แล้ว (ทำตาม README ของโปรเจ็กต์)

ควอนไทซ์ (หากมีน้ำหนักต้นฉบับ) — ตัวอย่าง (เชิงแนวคิด)

# Example: quantize from an FP16/BF16 model to a GGUF q4_K_M (syntax depends on llama.cpp version)./quantize /path/to/original/model.bin /path/to/out.gguf q4_k_m

รัน GGUF ด้วย llama.cpp

# run interactive inference with a quantized GGUF model./main -m /path/to/ministral-3-3b-instruct.gguf -t 8 -c 2048 --interactive# -t sets threads, -c sets context (tokens) if supported

ตัวอย่างไคลเอนต์ Python (เซิร์ฟเวอร์โลคัลของ llama.cpp หรือ subprocess)

คุณสามารถสปิน llama.cpp เป็น subprocess และส่งพรอมป์เข้าไป หรือใช้ไคลเอนต์ห่อเล็กๆ หลายโปรเจ็กต์ในชุมชนมี HTTP เซิร์ฟเวอร์ขนาดเล็กห่อหุ้ม llama.cpp เพื่อผสานกับแอปโลคัล

หมายเหตุและข้อแลกเปลี่ยน

- การควอนไทซ์ลดการใช้ VRAM และทำให้อินเฟอเรนซ์บน CPU เป็นไปได้ แต่คุณภาพอาจลดลง (เล็กน้อยถึงปานกลาง ขึ้นอยู่กับรูปแบบควอนไทซ์) รูปแบบอย่าง q4_K_M หรือรุ่น q5 เป็นสมดุลที่พบบ่อยสำหรับการใช้ CPU บทความภาษาญี่ปุ่นและเชิงเทคนิคอธิบายประเภท Q4/Q5 และการแปลง GGUF อย่างละเอียด

- สำหรับงานขนาดเล็กถึงกลาง GGUF + llama.cpp มักเป็นวิธีที่ถูกและพกพาได้มากที่สุดในการรัน LLM แบบโลคัล

ฮาร์ดแวร์และหน่วยความจำที่ควรคำนึงถึงมีอะไรบ้าง?

แนวทางสั้นๆ เชิงปฏิบัติ:

- โมเดล 3B: มักควอนไทซ์และรันบน CPU แล็ปท็อปดีๆ ได้ หรือ GPU ตัวเดียวที่มี VRAM 8–16 GB (ขึ้นอยู่กับความแม่นยำ/การควอนไทซ์) รุ่น GGUF q4 รันได้บน CPU สมัยใหม่จำนวนมาก

- ministral 8B และ 14B: โดยทั่วไปต้องใช้ GPU ระดับกลาง (เช่น 24–80 GB ขึ้นอยู่กับความแม่นยำและการแคช activation) หรือควอนไทซ์ข้ามหลายอุปกรณ์

- Mistral Large 3 (675B รวม, 41B active): ตั้งใจใช้ในดาต้าเซ็นเตอร์และทำงานได้ดีที่สุดกับโหนดหลาย GPU (เช่น 8×A100 หรือ H100) และรูปแบบเฉพาะ (NVFP4/FP8) สำหรับ vLLM Mistral เผยแพร่เช็คพอยท์ที่ปรับแต่งเพื่อให้การปรับใช้ลักษณะนี้เป็นไปได้จริง

หากลำดับความสำคัญของคุณคือ การใช้งานบนแล็ปท็อปโลคัล ให้มุ่งไปที่เส้นทาง ministral 3B แบบ GGUF ที่ควอนไทซ์ + llama.cpp หากลำดับความสำคัญคือ throughput ในโปรดักชัน ดู vLLM + เช็คพอยท์ NVFP4 บน GPU หากคุณต้องการ ทดลองใช้ง่าย Ollama คือจุดเริ่มต้นที่เร็วที่สุด

ควรเลือกการควอนไทซ์และความแม่นยำอย่างไร?

การควอนไทซ์เป็นการแลก: หน่วยความจำและความเร็ว vs. คุณภาพโมเดลดิบ ทางเลือกที่พบได้บ่อย:

- q4_0 / q4_1 / q4_K_M: ตัวเลือก 4 บิตยอดนิยมสำหรับอินเฟอเรนซ์บน CPU; q4_K_M (แบบ k-means) มักให้สมดุลคุณภาพ/ประสิทธิภาพที่ดีกว่า

- q5 / q8 / imatrix variants: รูปแบบระดับกลางที่อาจคงความเที่ยงตรงมากขึ้นโดยแลกกับขนาดที่ใหญ่ขึ้น

- FP16 / BF16 / FP8 / NVFP4: ความแม่นยำบน GPU — BF16 และ FP16 เป็นที่นิยมสำหรับการฝึก/อินเฟอเรนซ์บน GPU รุ่นใหม่; FP8 / NVFP4 เป็นรูปแบบเกิดใหม่ที่ประหยัดหน่วยความจำสำหรับโมเดลใหญ่มาก และรองรับโดยรันไทม์ที่ปรับแต่งและเช็คพอยท์ของ Mistral

หลักง่ายๆ: สำหรับการรัน CPU โลคัล เลือก q4_K_M หรือใกล้เคียง; สำหรับอินเฟอเรนซ์บน GPU ที่ต้องการความเที่ยงตรงสูง ใช้ BF16/FP16 หรือรูปแบบเฉพาะผู้ขายอย่าง FP8/NVFP4 เมื่อรันไทม์รองรับ

บทสรุป — ควรรัน Mistral 3 แบบโลคัลหรือไม่?

หากคุณต้องการ ความเป็นส่วนตัว ความหน่วงต่ำ หรือการปรับแต่ง คำตอบคือใช่: ตระกูล Mistral 3 ให้ทางเลือกหลากหลาย — โมเดลเล็กสำหรับ CPU บนขอบ โมเดลขนาดกลางสำหรับ GPU ตัวเดียวหรือคลัสเตอร์ขนาดย่อม และรสชาติ MoE ขนาดใหญ่สำหรับสเกลดาต้าเซ็นเตอร์ — และระบบนิเวศ (Ollama, Hugging Face, vLLM, llama.cpp) รองรับรูปแบบการปรับใช้แบบโลคัลและส่วนตัวที่ใช้งานได้จริงอยู่แล้ว นอกจากนี้ Mistral ยังร่วมกับ NVIDIA และ vLLM จัดเตรียมเช็คพอยท์ที่ปรับแต่งเพื่อ throughput สูงและลดการใช้หน่วยความจำ ทำให้การโฮสต์เองในโปรดักชันเป็นจริงมากกว่าที่เคย

ในการเริ่มต้น สำรวจความสามารถของโมเดลเพิ่มเติม (เช่น Gemini 3 Pro) ใน Playground และดู คู่มือ API สำหรับคำแนะนำโดยละเอียด ก่อนเข้าใช้งาน โปรดตรวจสอบให้แน่ใจว่าคุณได้ล็อกอิน CometAPI และได้รับคีย์ API แล้ว CometAPI มีราคาที่ต่ำกว่าราคาทางการอย่างมากเพื่อช่วยให้คุณผสานรวมได้

พร้อมใช้งานแล้วหรือยัง?→ สมัคร CometAPI วันนี้ !