o3‑pro ซึ่งเป็นโมเดลการใช้เหตุผลล่าสุดของ OpenAI ถือเป็นก้าวกระโดดครั้งสำคัญในด้านประสิทธิภาพและความสามารถสำหรับแอปพลิเคชันที่ขับเคลื่อนด้วย AI o2025‑pro เปิดตัวเมื่อต้นเดือนมิถุนายน 3 โดยนำเสนอการใช้เหตุผลขั้นสูง ความเข้าใจแบบหลายโหมด และการใช้เครื่องมือสำหรับนักพัฒนาและองค์กรต่างๆ ในราคาพรีเมียม บทความนี้รวบรวมประกาศล่าสุด รายงานของผู้ใช้ และข้อมูลประสิทธิภาพ เพื่อให้ภาพรวมที่ครอบคลุมเกี่ยวกับประสิทธิภาพ ค่าใช้จ่าย และความพร้อมใช้งานของ o3‑pro

o3‑pro คืออะไร?

o3‑pro ซึ่งเป็นผลิตภัณฑ์ล่าสุดของ OpenAI ถือเป็นก้าวสำคัญในโมเดลการใช้เหตุผลของ AI โดยผสานความสามารถขั้นสูงเข้ากับราคาที่แพง o11‑pro เปิดตัวเมื่อวันที่ 2025 มิถุนายน 3 โดยเป็นโมเดลต่อจาก o3 มาตรฐานและมาแทนที่ o1‑pro ในกลุ่มผลิตภัณฑ์ของ OpenAI โดยมุ่งเป้าไปที่นักพัฒนาและองค์กรที่ให้ความสำคัญกับการวิเคราะห์เชิงลึกและความน่าเชื่อถือมากกว่าความเร็ว o3‑pro ซึ่งสร้างขึ้นบนสถาปัตยกรรมพื้นฐานเดียวกันกับ o2025 ซึ่งเปิดตัวครั้งแรกในเดือนเมษายน 3 ผสานรวมการค้นหาเว็บแบบเรียลไทม์ การวิเคราะห์ไฟล์ การใช้เหตุผลแบบภาพ การดำเนินการด้วย Python และฟีเจอร์หน่วยความจำขั้นสูง เพื่อตอบโจทย์เวิร์กโฟลว์ที่ซับซ้อนในด้านวิทยาศาสตร์ การเขียนโปรแกรม ธุรกิจ และการเขียน อย่างไรก็ตาม แนวทางการใช้เหตุผลโดยเจตนาของโมเดลนี้ทำให้เกิดความล่าช้าและต้นทุนที่เพิ่มขึ้นอย่างมาก ซึ่งสะท้อนถึงการออกแบบที่เน้นการคำนวณ

อะไรที่ทำให้ o3‑pro แตกต่างจากรุ่น o3 มาตรฐาน?

การใช้เหตุผลแบบมัลติโหมดขั้นสูง

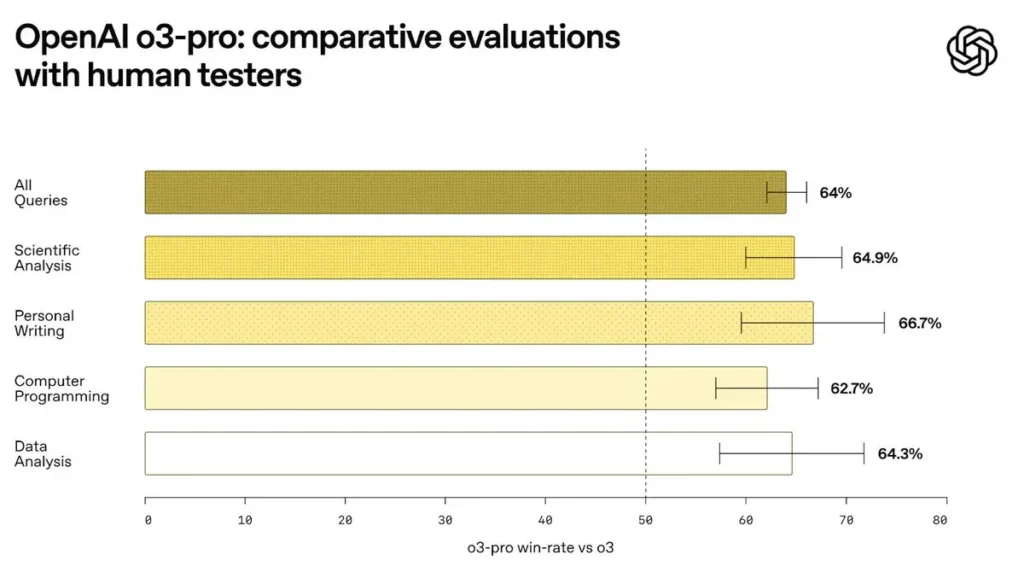

OpenAI ได้ประเมิน o3‑pro อย่างเข้มงวดในการประเมิน AI มาตรฐานหลายแบบเพื่อยืนยันความสามารถในการใช้เหตุผล ในโดเมนคณิตศาสตร์ o3‑pro เหนือกว่า Gemini 2.5 Pro ของ Google ในเกณฑ์มาตรฐาน AIME 2024 โดยแสดงให้เห็นถึงการใช้เหตุผลเชิงตรรกะที่เหนือกว่าและการแก้สมการที่ซับซ้อนภายใต้เงื่อนไขที่กำหนดเวลา ในทำนองเดียวกัน ในเกณฑ์มาตรฐาน GPQA Diamond ซึ่งวัดความเข้าใจทางวิทยาศาสตร์และการแก้ปัญหาในระดับปริญญาเอก o3‑pro เหนือกว่า Claude 4 Opus ของ Anthropic ซึ่งเน้นย้ำถึงความลึกซึ้งในการใช้เหตุผลทางวิทยาศาสตร์ขั้นสูง

o3‑pro พัฒนาจากจุดแข็งของโมเดลเรือธง o3 ของ OpenAI โดยผสานการท่องเว็บแบบเรียลไทม์ การวิเคราะห์ไฟล์ การทำความเข้าใจภาพ และการดำเนินการ Python แบบเรียลไทม์เข้าเป็นอินเทอร์เฟซเดียว OpenAI ระบุว่าความสามารถในการใช้เหตุผลขั้นสูงนี้ช่วยให้ o3‑pro สามารถจัดการกับงานที่ซับซ้อน เช่น การตีความข้อมูลทางวิทยาศาสตร์ การดีบักโค้ดรูปแบบยาว และการสร้างเนื้อหาแบบหลายโหมดได้อย่างน่าเชื่อถือมากกว่ารุ่นก่อนหน้า

ความน่าเชื่อถือเหนือความล่าช้า

ความสามารถใหม่เหล่านี้มาพร้อมกับข้อแลกเปลี่ยน: เวลาตอบสนองของ o3‑pro ช้ากว่า o3 อย่างเห็นได้ชัด ซึ่งสะท้อนถึงขั้นตอนการประมวลผลและบริบทเพิ่มเติมที่จำเป็นสำหรับการใช้เครื่องมือขั้นสูง ผู้ใช้ในช่วงแรกรายงานว่าเวลาแฝงทั่วไปอยู่ที่ 1.5–2 เท่าของ o3 ในพรอมต์ที่เทียบเท่ากัน แม้ว่าตัวเลขที่ชัดเจนจะแตกต่างกันไปตามความซับซ้อนของคำขอก็ตาม

ข้อจำกัดของคุณสมบัติเมื่อเปิดตัว

เมื่อเปิดตัว ผู้ใช้ o3‑pro สังเกตเห็นข้อจำกัดชั่วคราวบางประการ: การสร้างภาพยังคงไม่พร้อมใช้งาน และฟีเจอร์ ChatGPT บางอย่าง เช่น เซสชัน "Canvas" ชั่วคราวและเธรดแชทชั่วคราว จะถูกปิดใช้งานในขณะที่ OpenAI ปรับขนาดโครงสร้างพื้นฐานสำหรับโมเดลใหม่ ข้อจำกัดเหล่านี้คาดว่าจะคลี่คลายลงในช่วงไม่กี่เดือนข้างหน้านี้เมื่อความจุเพิ่มขึ้น

o3‑pro ทำผลงานได้อย่างไรในเกณฑ์มาตรฐานอุตสาหกรรม?

แบบทดสอบการใช้เหตุผลแบบมาตรฐาน

ในการทดสอบภายใน o3‑pro มีประสิทธิภาพเหนือกว่า o3 อย่างเห็นได้ชัดในชุดการใช้เหตุผลมาตรฐานที่ครอบคลุมคณิตศาสตร์ ปริศนาตรรกะ และความท้าทายด้านการเขียนโปรแกรม คะแนนที่รายงานโดยชุมชนระบุว่า o3 ได้คะแนนประมาณ 2,517 คะแนน ในขณะที่ o3‑pro ได้คะแนนประมาณ 2,748 คะแนน ซึ่งถือว่าดีขึ้นประมาณ 9%

การประเมินการเขียนโค้ดในโลกแห่งความเป็นจริง

นักพัฒนาที่รันโค้ดแบบสดและงานแก้ไขข้อบกพร่องพบว่า o3‑pro สร้างผลลัพธ์ที่ถูกต้องตามไวยากรณ์และความหมายได้ดีกว่าในการตั้งค่าแบบช็อตเดียวและแบบช็อตสองช็อต เกณฑ์มาตรฐานบนคลังโค้ดเช่น CodeSearchNet แสดงให้เห็นว่าความถูกต้องของฟังก์ชันเพิ่มขึ้น 5–7% เมื่อเทียบกับ o3 โดยเฉพาะในปัญหาบริบทยาวที่มีโทเค็นเกิน 4,000 โทเค็น

ประสิทธิภาพการทำงานเปรียบเทียบกับคู่แข่ง

ในการทดสอบแบบตัวต่อตัว o3‑pro ไม่เพียงแต่เอาชนะ Gemini 2.5 Pro และ Claude 4 Opus ในเรื่องคะแนนดิบเท่านั้น แต่ยังมอบผลลัพธ์ที่สม่ำเสมอยิ่งขึ้นในการทดสอบความเครียดเชิงปฏิปักษ์อีกด้วย โดยการรวมการจัดการอินพุตแบบหลายโหมดและการใช้เครื่องมือแบบไดนามิก o3‑pro จึงลดช่องว่างด้วยโมเดลเฉพาะทางจากคู่แข่ง เช่น Google PaLM และ Anthropic Claude X การทดสอบแบบตัวต่อตัวในช่วงแรกบ่งชี้ว่า o3‑pro เทียบได้หรือดีกว่าความแม่นยำของคู่แข่งในเกณฑ์มาตรฐานการใช้เหตุผลที่ซับซ้อน แม้ว่ารายงานจากบุคคลภายนอกที่ครอบคลุมจะยังออกมาไม่มากนัก

นักพัฒนาควรคาดหวังโครงสร้างราคาอย่างไร?

รูปแบบการเรียกเก็บเงินตามโทเค็น

OpenAI ยังคงเรียกเก็บเงินตามโทเค็นต่อไป โดย o3‑pro มีค่าใช้จ่าย 20 ดอลลาร์ต่อโทเค็นอินพุต 80 ล้านโทเค็น และ 3 ดอลลาร์ต่อโทเค็นเอาต์พุต 3 ล้านโทเค็น ซึ่งสูงกว่าต้นทุนของโมเดล o2 มาตรฐาน 8 เท่าพอดีหลังจากลดราคาลงเมื่อไม่นานนี้ ในทางตรงกันข้าม ปัจจุบัน o80 มีค่าใช้จ่าย 2025 ดอลลาร์ต่อโทเค็นอินพุต XNUMX ล้านโทเค็น และ XNUMX ดอลลาร์ต่อโทเค็นเอาต์พุต XNUMX ล้านโทเค็น หลังจากลดราคาลง XNUMX% เมื่อต้นเดือนมิถุนายน XNUMX

| รุ่น | ราคาโทเค็นอินพุต | ราคาโทเค็นเอาท์พุต |

|---|---|---|

| o3 | 2 ดอลลาร์/1 ล้านโทเค็น | 8 ดอลลาร์/1 ล้านโทเค็น |

| โอ3โปร | 20 ดอลลาร์/1 ล้านโทเค็น | 80 ดอลลาร์/1 ล้านโทเค็น |

เหตุผลเบื้องหลังเบี้ยประกันภัย

การเพิ่มราคาขึ้นสิบเท่าสะท้อนถึงทรัพยากรการประมวลผลเพิ่มเติม โครงสร้างพื้นฐานที่มีปริมาณงานสูง และการบูรณาการเครื่องมือเฉพาะทางที่ o3‑pro ต้องการ OpenAI วางตำแหน่ง o3‑pro ให้เป็นโมเดล "ที่สำคัญต่อภารกิจ" สำหรับแอปพลิเคชันที่ความแม่นยำและการใช้เหตุผลขั้นสูงเป็นเหตุผลประกอบที่คุ้มค่ากับต้นทุนที่เพิ่มขึ้น

ส่วนลดตามปริมาณและ API แบบแบตช์

องค์กรที่ประมวลผลโทเค็นจำนวนมากยังสามารถใช้ประโยชน์จาก Batch API เพื่อประหยัดอินพุตและเอาต์พุตที่แคชไว้ได้มากถึง 50% แม้ว่ากลไกนี้จะให้ประโยชน์แก่ผู้ใช้ GPT‑4.1 ในปริมาณมากเป็นหลัก แต่คาดว่าตัวเลือกการแบ่งแบตช์ที่คล้ายกันนี้จะเปิดตัวสำหรับโมเดลซีรีส์ o ในช่วงปลายปี 2025

นักพัฒนาและทีมงานสามารถเข้าถึง o3‑pro ได้อย่างไร

ความพร้อมใช้งานของ API

ในการทดสอบตัวต่อตัว o3‑pro ไม่เพียงแต่เอาชนะ Gemini 2.5 Pro และ Claude 4 Opus ในเรื่องคะแนนดิบเท่านั้น แต่ยังมอบผลลัพธ์ที่สม่ำเสมอมากขึ้นในการทดสอบความเครียดเชิงแข่งขันอีกด้วย

OpenAI ทำให้ o3‑pro เข้าถึงได้ผ่าน API สาธารณะในวันที่ 10 มิถุนายน 2025 พร้อมรองรับทันทีในทั้งปลายทาง Completions และ Chat นักพัฒนาสามารถระบุ "o3-pro" โมเดลในการเรียก API ของพวกเขา ขึ้นอยู่กับขีดจำกัดอัตราและข้อกำหนดโควตาที่ผูกไว้กับระดับการสมัครใช้งานของพวกเขา

POST https://api.openai.com/v1/chat/completions

{

"model": "o3-pro",

"messages": ,

"max_tokens": 1500

}

แผน ChatGPT Pro และทีม

สมาชิก ChatGPT Pro และ Team สามารถเข้าถึง o3‑pro ได้โดยตรงภายในอินเทอร์เฟซ ChatGPT ผู้ใช้สามารถสลับระหว่าง o3 และ o3‑pro ได้ในตัวเลือกรุ่น แม้ว่าความพร้อมใช้งานเบื้องต้นจะจำกัดเฉพาะกลุ่มย่อยของลูกค้าองค์กรและผู้ทดสอบเบต้าเท่านั้น

ผ่านทาง API ของ CometAPI

นักพัฒนาสามารถเข้าถึงได้ o3-โปร เอพีไอ(แบบอย่าง: "o3-Pro"หรือ"o3-pro-2025-06-10") ผ่าน โคเมทเอพีไอรุ่นล่าสุดที่แสดงไว้เป็นข้อมูล ณ วันที่เผยแพร่บทความ ในการเริ่มต้น ให้สำรวจความสามารถของรุ่นใน สนามเด็กเล่น และปรึกษา คู่มือ API สำหรับคำแนะนำโดยละเอียด ก่อนเข้าใช้งาน โปรดตรวจสอบให้แน่ใจว่าคุณได้เข้าสู่ระบบ CometAPI และได้รับรหัส API แล้ว โคเมทเอพีไอ เสนอราคาที่ต่ำกว่าราคาอย่างเป็นทางการมากเพื่อช่วยคุณบูรณาการ

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.cometapi.com/v1",

api_key="<YOUR_API_KEY>",

)

response = client.chat.completions.create(

model="o3-Pro",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices.message.content

print(f"Assistant: {message}")

กรณีการใช้งานจริงใดที่ได้รับประโยชน์สูงสุดจาก o3‑pro

การวิจัยทางวิทยาศาสตร์และการวิเคราะห์ข้อมูล

นักวิจัยที่ทำงานกับชุดข้อมูลขนาดใหญ่ตั้งแต่จีโนมิกส์ไปจนถึงการจำลองสภาพภูมิอากาศสามารถใช้ประโยชน์จากการวิเคราะห์ไฟล์ของ o3‑pro และความสามารถในการดำเนินการ Python เพื่อทำการทดสอบสมมติฐานแบบอัตโนมัติและสร้างข้อมูลเชิงลึกโดยไม่มีข้อจำกัดด้านความยาวบริบท

เวิร์กโฟลว์ความรู้ขององค์กร

ในภาคส่วนต่างๆ เช่น การเงินและบริการทางกฎหมาย ซึ่งความแม่นยำและการตรวจสอบถือเป็นสิ่งสำคัญที่สุด การปฏิบัติตามคำแนะนำและการใช้เหตุผลแบบหลายโหมดที่ได้รับการปรับปรุงของ o3‑pro ช่วยลดอัตราข้อผิดพลาดในการตรวจสอบสัญญา การสร้างแบบจำลองทางการเงิน และงานปฏิบัติตามกฎระเบียบ

การพัฒนาซอฟต์แวร์และ DevOps

การรวมความเข้าใจโค้ดในบริบทระยะยาวกับการทดสอบสดด้วยการดำเนินการ Python ทำให้ o3-pro ปรับปรุงการดีบักและทำให้เวิร์กโฟลว์การรีแฟกเตอร์ที่ซับซ้อนเป็นอัตโนมัติ ช่วยเร่งรอบการส่งมอบสำหรับโครงการซอฟต์แวร์ขนาดใหญ่

องค์กรควรพิจารณาอะไรบ้าง ก่อนการอัพเกรด?

การวิเคราะห์ต้นทุนและผลประโยชน์

ทีมงานต้องชั่งน้ำหนักระหว่างราคาที่เพิ่มขึ้น 10 เท่าเทียบกับประสิทธิภาพที่คาดว่าจะได้รับ สำหรับงานที่มีมูลค่าสูงและมีปริมาณน้อย เช่น การร่างรายงานเชิงกลยุทธ์หรือการสร้างระบบความปลอดภัยที่สำคัญ ความแม่นยำและการสนับสนุนเครื่องมืออาจคุ้มค่ากับค่าใช้จ่ายของ o3‑pro สำหรับการสร้างเนื้อหาจำนวนมาก การยึดติดอยู่กับโมเดลมาตรฐาน o3 หรือ o4‑mini อาจประหยัดกว่า

ความพร้อมด้านโครงสร้างพื้นฐาน

เนื่องจาก o3‑pro กำหนดเวลาแฝงและความต้องการปริมาณงานที่สูงกว่า องค์กรต่างๆ ควรตรวจสอบขีดจำกัดอัตรา API ความจุเครือข่าย และกลยุทธ์การลองผิดลองถูกซ้ำ เพื่อหลีกเลี่ยงคอขวดระหว่างการใช้งานสูงสุด

โดยสรุป

โมเดล o3‑pro ของ OpenAI กำหนดมาตรฐานใหม่สำหรับการใช้เหตุผลขั้นสูง ความเข้าใจแบบหลายโหมด และการใช้เครื่องมือแบบบูรณาการใน AI การปรับปรุงประสิทธิภาพและความน่าเชื่อถือทำให้โมเดลนี้เป็นตัวเลือกที่น่าสนใจสำหรับแอปพลิเคชันที่สำคัญต่อภารกิจ โดยต้องมีงบประมาณและโครงสร้างพื้นฐานที่สามารถรองรับต้นทุนที่สูงขึ้นได้ เมื่อภูมิทัศน์ของ AI เปลี่ยนแปลงไป บทบาทของ o3‑pro จะแข็งแกร่งขึ้นในพื้นที่ที่ต้องการความแม่นยำและความลึกของบริบทในระดับสูงสุด ในขณะที่ภาระงานที่อ่อนไหวต่อต้นทุนมากขึ้นอาจยังคงใช้โมเดล o‑series พื้นฐานหรือตัวแปรขนาดเล็กที่เพิ่งเกิดขึ้น