Mistral 3, Mistral AI’nin 2025 sonu model ailesinin manşet sürümüdür. Yerel/uç (edge) dağıtım için tasarlanmış kompakt, hızlı modeller ile en ileri düzey ölçek ve bağlam uzunluğunu zorlayan çok büyük, seyrek bir amiral modeli bir araya getirir. Bu makale Mistral 3’ün ne olduğunu, nasıl inşa edildiğini, neden yerelde çalıştırmak isteyebileceğinizi ve makinenizde veya özel sunucunuzda çalıştırmanın üç pratik yolunu açıklar — Ollama’nın “tıkla-çalıştır” kolaylığından vLLM/TGI ile üretim GPU sunumuna, GGUF + llama.cpp kullanarak küçük cihazlarda CPU çıkarımına kadar.

Mistral 3 nedir?

Mistral 3, Mistral AI’den açık ağırlık (open-weight) modellerin en son neslidir. Aile, devasa Mistral Large 3’ü (seyrek Uzman Karışımı — MoE — model) ve yönerge izleme ile çok modlu (metin+görsel) görevler için ayarlanmış birkaç uç/“Ministral” varyantı (3B, 8B, 14B) içerir. Mistral, sürümü geniş ölçekte kullanılabilir olacak şekilde konumlandırdı: özel optimize edilmiş kontrol noktalarıyla yüksek performanslı veri merkezi çıkarımından, kuantize biçimler ve daha küçük varyantlar aracılığıyla uç ve dizüstü kullanıma kadar.

Önemli pratik özellikler:

- Large 3 varyantında Uzman Karışımı (MoE) mimarisi: çok büyük bir “toplam” parametre sayısı sağlar ancak her belirteç için uzmanların yalnızca bir alt kümesi etkinleştirilir — bu, ölçekte verimliliği artırır.

- Uç ve yerel kullanım için tasarlanmış Ministral 3 model ailesi (3B / 8B / 14B); yönergeye uyumlu ve çok modlu varyantlar mevcuttur.

- vLLM ve NVIDIA platformları gibi hızlandırılmış çalışma zamanları için resmi kontrol noktaları ve optimize edilmiş kontrol noktaları (NVFP4/FP8).

- Çok modlu + çok dilli + uzun bağlam — Ministral ve Large varyantları görsel+metin anlayışı ile geniş dil kapsamasına vurgu yapar. Görseller + uzun belgeleri birleştiren uygulamalar için bu önemlidir.

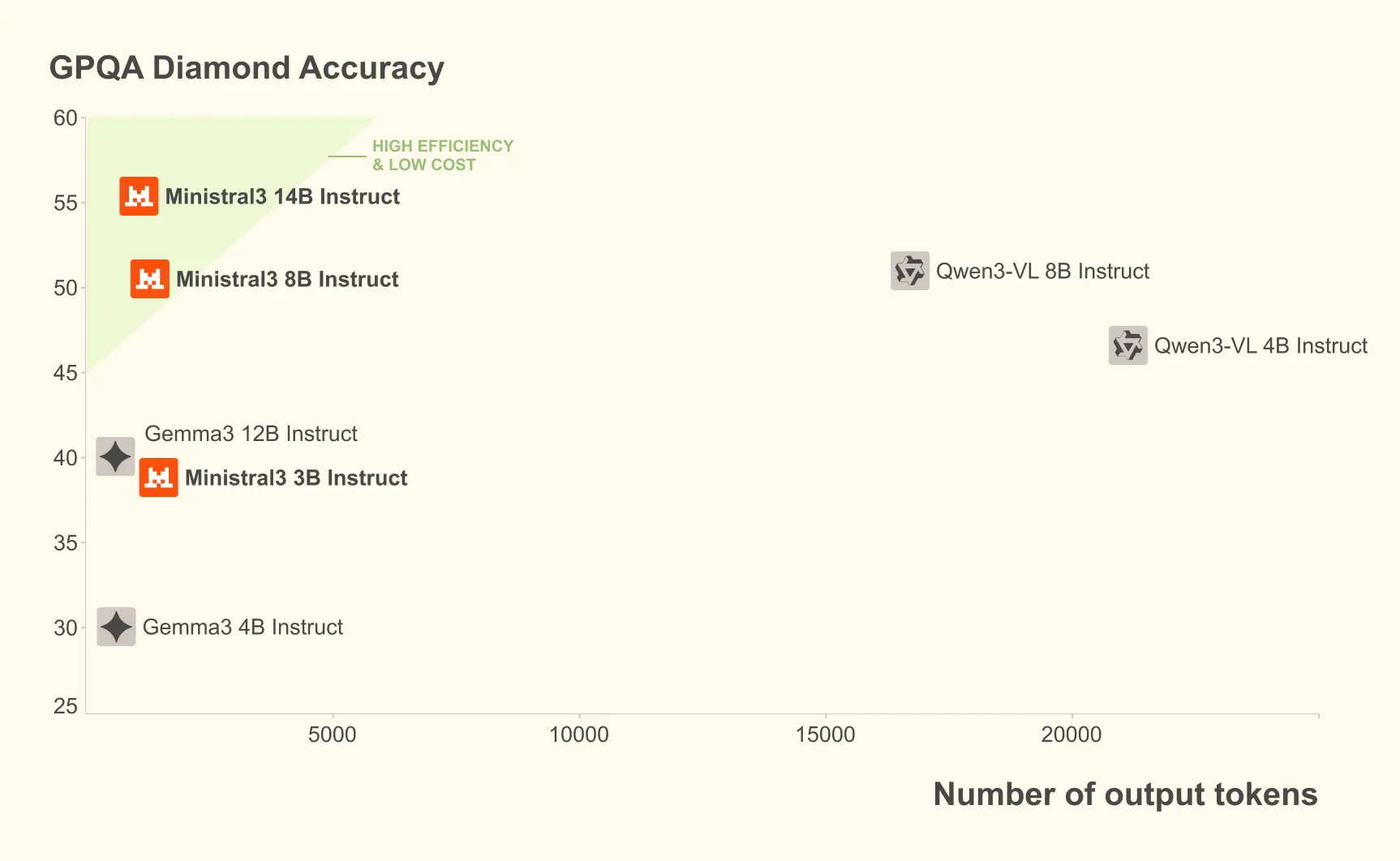

GPQA Diamond veri setinde (katı bir bilimsel akıl yürütme testi), çeşitli Ministral 3 varyantları, çıktı belirteç sayısı artsa bile yüksek doğruluğu korur. Örneğin, Ministral 3B Instruct modeli, 20.000 belirtece kadar işlerken %35–40 doğruluğu korur; daha az kaynak kullanırken Gemma 2 9B gibi daha büyük modellerle karşılaştırılabilir düzeydedir.

Mistral 3’ün mimarisi nedir?

Mistral 3 tek bir mimariden ziyade bir aile; ancak anlamanız gereken iki mimari desen şunlardır:

Yoğun küçük modeller (Ministral 3)

- Verimlilik ve uç (edge) çıkarım için optimize edilmiş standart transformer yığınları.

- Birden fazla boyutta sunulur (3B/8B/14B) ve farklı ince ayarlı varyantlar içerir: base, instruct ve reasoning; birçok varyant yerel çok modlu (görsel + metin) desteğe ve uzun bağlam çalışmasına sahiptir. Ministral modeller, bazı dağıtımlarda kompaktlık için optimize edilmiş FP8 ağırlıklarla yayımlanmıştır.

Seyrek Mixture-of-Experts (Mistral Large 3)

- MoE mimarisi: modelde çok sayıda uzman (muazzam toplam parametre sayısı) bulunur, ancak her belirteç için yalnızca yönlendirme ile seçilen bir alt küme değerlendirilir — bu, hesaplama/ölçek dengelerini iyileştirir.

- Mistral Large 3, çıkarım sırasında ~41B “aktif” parametreyle birlikte ~675B toplam parametre bildirir; bu MoE tasarımını yansıtır. Model modern NVIDIA donanımı üzerinde eğitilmiş ve verimli düşük hassasiyetli yürütme (NVFP4/TensorRT/büyük çekirdek optimizasyonları) için optimize edilmiştir.

Yerelde çalıştırırken önemli teknik özellikler:

- Uzun bağlam: bazı Mistral 3 varyantları çok uzun bağlamları destekler (vLLM belgeleri ve Mistral belgeleri, belirli varyantlar için çok büyük bağlam pencerelerinden bahseder; ör. bazı Ministral varyantlarında 256k). Bu, bellek ve sunum desenlerini etkiler.

- Ağırlık biçimleri ve kuantizasyon: Mistral, sıkıştırılmış/optimize edilmiş biçimlerde (FP8, NVFP4) ağırlıklar sağlar ve pratik yerel çıkarım için modern kuantizasyon araç zincirleriyle (BitsAndBytes, GPTQ, satıcı araç zincirleri) çalışır.

Neden Mistral 3’ü yerel olarak çalıştırırsınız?

LLM’leri yerelde çalıştırmak artık niş bir hobi değil — şu konulara önem veren ekipler ve bireyler için pratik bir seçenek:

- Veri gizliliği ve uyumluluk. Yerel barındırma, hassas girdileri altyapınız içinde tutar (finans, sağlık, hukuk için önemlidir). Reuters, Mistral modellerini kendi kendine barındırmayı seçen üst düzey müşterileri bildirdi.

- Gecikme ve maliyet kontrolü. Sıkı gecikme SLO’ları ve öngörülebilir maliyetler için, yerel veya özel küme çıkarımı bulut API fatura şokunu geride bırakabilir. Daha küçük Ministral varyantlar ve kuantize biçimler, bunu pratik hale getirir.

- Özelleştirme ve ince ayar. Özel davranış, fonksiyon çağrısı veya yeni modaliteler gerektiğinde, yerel kontrol özelleştirilmiş ince ayarı ve veri işleme imkânı sağlar. Hugging Face ve vLLM entegrasyonu, bunu daha da hazır hale getirir.

Bu nedenler önceliklerinizle — gizlilik, kontrol, maliyet öngörülebilirliği veya araştırma — örtüşüyorsa, yerel dağıtımı değerlendirmeye değer.

Mistral 3’ü yerelde nasıl çalıştırabilirsiniz (üç pratik yöntem)?

Mistral 3’ü yerelde çalıştırmanın birçok yolu vardır. En yaygın kullanıcı senaryolarını kapsayan üç yaklaşımı ele alacağım:

- Ollama (sıfır yapılandırmalı masaüstü / yerel sunucu, çoğu kullanıcı için en kolay)

- Hugging Face Transformers + PyTorch / vLLM (tam kontrol, GPU kümeleri)

- llama.cpp / ggml / GGUF kuantize CPU çıkarımı (hafif, dizüstünde/CPU’da çalışır)

Her yöntem için ne zaman mantıklı olduğunu, önkoşulları, adım adım komutları ve küçük kod örneklerini listeleyeceğim.

1) Mistral 3’ü Ollama ile nasıl çalıştırırsınız (en hızlı yol)?

Ne zaman kullanılır: sürtünmesiz bir yerel deneyim (macOS/Linux/Windows), kullanışlı bir CLI veya GUI ve mevcut olduğunda otomatik indirmeler/kuantize yapıtlar istiyorsunuz. Ollama’da Ministral 3 ve Mistral ailesinin diğer üyeleri için model girdileri bulunur.

Önkoşullar

- Ollama kurulu (ollama.com’daki yükleyiciyi izleyin). Ollama kitaplığı, bazı Ministral sürümleri için belirli asgari sürümleri belirtir.

- Model yapıtlarını depolamak için yeterli disk alanı (model boyutları değişir — Ministral 3B kuantize sürümler birkaç GB olabilir; daha büyük BF16 varyantları onlarca GB’dır).

Adımlar (örnek)

- Ollama’yı kurun (macOS örneği — platforma göre değiştirin):

# macOS (Homebrew) example — see ollama.com for platform-specific installersbrew install ollama

- Bir Ministral modeli çalıştırın:

# Pull and run the model interactivelyollama run ministral-3

- Yerelde sunun (API) ve koddan çağırın:

# Run Ollama server (default port shown in docs)ollama serve# Then curl against it (example)curl -s -X POST "http://localhost:11434/api/v1/generate" \ -H "Content-Type: application/json" \ -d '{"model":"ministral-3","prompt":"Summarize Mistral 3 in one sentence."}'

Notlar ve ipuçları

- Ollama, model indirmelerini ve (mevcut olduğunda) yerel kuantize varyantları yönetir — modelleri hızlıca denemek için çok kullanışlıdır.

- Modeli çok eşzamanlı isteklerle üretimde kullanmayı planlıyorsanız, Ollama prototipleme için harikadır; ancak sürekli yük için ölçekleme ve kaynak orkestrasyonunu değerlendirin.

2) Mistral 3’ü Hugging Face Transformers ile nasıl çalıştırırsınız (GPU / vLLM entegrasyonu)?

Ne zaman kullanılır: araştırma veya üretim için programatik kontrol, ince ayar yapmak ya da GPU kümelerinde vLLM gibi hızlandırılmış çıkarım yığınlarını kullanmak istiyorsunuz. Hugging Face Transformers desteği sağlar ve Mistral, vLLM/NVIDIA için optimize edilmiş kontrol noktaları sunar.

Önkoşullar

- Yeterli belleğe sahip GPU (model ve hassasiyete göre değişir). Ministral 3 küçük modelleri (3B/8B) kuantize edildiğinde tek bir orta seviye GPU’da çalıştırılabilir; daha büyük varyantlar birden çok H100/A100 veya vLLM için optimize edilmiş NVFP4 kontrol noktaları gerektirir. NVIDIA ve Mistral belgeleri, büyük modeller için önerilen düğüm boyutlarını belirtir.

- Python, PyTorch, transformers, accelerate (veya sunucu istenirse vLLM).

Python örneği — temel Hugging Face pipeline (3B instruct varyantı, GPU):

# Example: CPU/GPU inference with transformers pipeline# Assumes you have CUDA and a compatible PyTorch build.import torchfrom transformers import pipelinemodel_name = "mistralai/Ministral-3-3B-Instruct-2512-BF16" # example HF model idgenerator = pipeline( "text-generation", model=model_name, device_map="auto", torch_dtype=torch.bfloat16, # use bfloat16 if your hardware supports it)prompt = "Explain how attention helps transformers, in 3 sentences."out = generator(prompt, max_new_tokens=120, do_sample=False)print(out[0]["generated_text"])

Üretim GPU çıkarımı için vLLM kullanma

vLLM büyük modelleri verimli şekilde sunmak için tasarlanmıştır, Mistral 3 ailesini destekler ve Mistral, bellek ayak izini azaltmak ve hız kazandırmak için vLLM/NVIDIA donanımı üzerinde optimize edilmiş kontrol noktaları (NVFP4/FP8) yayımlamıştır. Bir vLLM sunucusu başlatmak, düşük gecikmeli, toplu çıkarım uç noktası sağlar. Model yolları ve önerilen bayraklar için vLLM tariflerine ve Mistral yönlendirmelerine bakın.

Notlar ve ipuçları

- Üretimde, optimize edilmiş kontrol noktalarını (NVFP4/FP8) tercih edin ve önerilen GPU’larda (ör. H100/A100) çalıştırın veya tensör/model paralelliğini destekleyen bir orkestrasyon katmanı kullanın. Mistral ve NVIDIA, optimize edilmiş çalışma zamanları hakkında belgeler ve blog yazıları sunar.

- Yeniden üretilebilir sonuçlar için diskteki model kontrol noktasını (veya yeniden üretilebilir bir HF anlık görüntüsünü) her zaman sabitleyin ve sessiz model güncellemelerinden kaçının.

3) Mistral 3’ü CPU’da llama.cpp / GGUF kuantize modellerle nasıl çalıştırırsınız?

Ne zaman kullanılır: CPU’da yerel, çevrimdışı çıkarıma (örn. geliştirici dizüstü bilgisayarı, güvenli izole ortam) ihtiyacınız var ve çalışma süresi ile bellek verimliliği için bir miktar kalite ödününü kabul ediyorsunuz. Bu yöntem ggml/llama.cpp ve GGUF kuantize ağırlıkları (q4/q5/vb.) kullanır.

Önkoşullar

- Bir Ministral modelinin GGUF kuantize derlemesi (çok sayıda topluluk üyesi, Hugging Face üzerinde kuantize GGUF’lar yayımlar veya BF16 ağırlıkları yerelde GGUF’a dönüştürür).

Ministral-3-3B-InstructGGUF varyantlarını arayın. - Derlenmiş llama.cpp ikili dosyası (proje README’sini izleyin).

Kuantize etme (orijinal ağırlıklara sahipseniz) — örnek (kavramsal)

# Example: quantize from an FP16/BF16 model to a GGUF q4_K_M (syntax depends on llama.cpp version)./quantize /path/to/original/model.bin /path/to/out.gguf q4_k_m

llama.cpp ile bir GGUF çalıştırma

# run interactive inference with a quantized GGUF model./main -m /path/to/ministral-3-3b-instruct.gguf -t 8 -c 2048 --interactive# -t sets threads, -c sets context (tokens) if supported

Python istemci örneği (yerel llama.cpp sunucusu veya alt işlem)

llama.cpp’yi bir alt işlem olarak başlatıp istemleri besleyebilir veya küçük bir sarmalayıcı istemci kullanabilirsiniz. Birçok topluluk projesi, yerel uygulama entegrasyonu için llama.cpp etrafında basit bir HTTP sunucu sarmalayıcısı sunar.

Notlar ve ödünler

- Kuantizasyon, VRAM’i azaltır ve CPU çıkarımını mümkün kılar ancak kaliteyi düşürebilir (kuant biçimine bağlı olarak hafif ile orta düzey arası). q4_K_M veya q5 varyantları gibi biçimler, CPU kullanımı için yaygın uzlaşıdır. Japonca ve teknik yazılar, Q4/Q5 türlerini ve GGUF dönüşümlerini ayrıntılı olarak açıklar.

- Küçük ve orta ölçekli iş yükleri için GGUF + llama.cpp, yerel LLM’leri çalıştırmanın çoğu zaman en ucuz ve en taşınabilir yoludur.

Hangi donanım ve bellek hususları önemlidir?

Kısa, pratik rehberlik:

- 3B modeller: genellikle kuantize edilip makul bir dizüstü CPU’sunda veya tek bir GPU’da 8–16 GB VRAM ile (hassasiyet/kuantizasyona bağlı) çalıştırılabilir. GGUF q4 varyantları birçok modern CPU’da çalışır.

- 8B ve 14B Ministral: tipik olarak orta seviye bir GPU (örn. hassasiyet ve aktivasyon önbelleklemesine bağlı olarak 24–80 GB) veya birden çok aygıt arasında kuantizasyon gerektirir.

- Mistral Large 3 (675B toplam, 41B aktif): veri merkezi dağıtımı için tasarlanmıştır ve genellikle çoklu GPU düğümlerinde (ör. 8×A100 veya H100) ve vLLM için uzmanlaşmış biçimlerde (NVFP4/FP8) en iyi şekilde çalışır. Mistral, bu tür dağıtımları uygulanabilir kılmak için açıkça optimize edilmiş kontrol noktaları yayımladı.

Önceliğiniz yerel dizüstü kullanımı ise, Ministral 3B kuantize GGUF + llama.cpp yolunu hedefleyin. Önceliğiniz üretim verimi ise, GPU’larda vLLM + NVFP4 kontrol noktalarına bakın. Deney kolaylığı istiyorsanız, başlamak için en hızlı yol Ollama’dır.

Kuantizasyon ve hassasiyeti nasıl seçmelisiniz?

Kuantizasyon bir uzlaşıdır: bellek ve hız ile ham model kalitesi arasında. Yaygın seçimler:

- q4_0 / q4_1 / q4_K_M: CPU çıkarımı için kullanılan popüler 4-bit seçenekler; q4_K_M (k-means varyantı), çoğu zaman daha iyi kalite/performans dengesi sunar.

- q5 / q8 / imatrix varyantları: daha fazla sadakati koruyabilecek, ancak boyut maliyeti olan ara biçimler.

- FP16 / BF16 / FP8 / NVFP4: GPU hassasiyetleri — BF16 ve FP16 modern GPU’larda eğitim/çıkarım için yaygındır; FP8 / NVFP4, çok büyük modeller için belleği tasarruf eder ve optimize çalışma zamanları ile Mistral’in kontrol noktası sürümleri tarafından desteklenir.

Kural: yerel CPU çalıştırmaları için q4_K_M veya benzeri biçimleri seçin; yüksek sadakatli GPU çıkarımı için BF16/FP16 veya çalışma zamanı desteklediğinde satıcıya özgü FP8/NVFP4 kullanın.

Sonuç — Mistral 3’ü yerelde çalıştırmalı mısınız?

Gizlilik, düşük gecikme veya özelleştirme gerekiyorsa, evet: Mistral 3 ailesi size geniş bir palet sunar — uç CPU için minik modeller, tek GPU veya mütevazı bir küme için orta boyutlu modeller ve veri merkezi ölçeği için büyük bir MoE tatları — ve ekosistem (Ollama, Hugging Face, vLLM, llama.cpp) halihazırda pratik yerel ve özel dağıtım desenlerini destekler. Mistral ayrıca NVIDIA ve vLLM ile, yüksek verim ile azaltılmış bellek ayak izleri sağlayan optimize kontrol noktaları üzerinde çalıştı; bu da üretim ortamında kendi kendine barındırmayı eskisinden daha gerçekçi hale getiriyor.

Başlamak için, Gemini 3 Pro gibi daha fazla modelin yeteneklerini Playground’da keşfedin ve ayrıntılı talimatlar için API guide’a başvurun. Erişmeden önce, CometAPI’ye giriş yaptığınızdan ve API anahtarını edindiğinizden emin olun. CometAPI, entegrasyonunuza yardımcı olmak için resmi fiyattan çok daha düşük bir fiyat sunar.

Hazır mısınız?→ Sign up for CometAPI today !