Mistral 3، Mistral AI کے late-2025 ماڈل فیملی کا نمایاں ریلیز ہے۔ یہ مقامی/ایج ڈپلائمنٹ کے لیے کمپیکٹ، تیز رفتار ماڈلز کا مجموعہ اور ایک بہت بڑا sparse flagship پیش کرتا ہے جو state-of-the-art scale اور context length کو آگے بڑھاتا ہے۔ یہ مضمون بتاتا ہے کہ Mistral 3 کیا ہے، یہ کیسے بنایا گیا ہے، آپ اسے لوکل طور پر کیوں چلانا چاہیں گے، اور آپ کی مشین یا پرائیویٹ سرور پر اسے چلانے کے تین عملی طریقے — Ollama کی “click-to-run” سہولت سے لے کر vLLM/TGI کے ساتھ پروڈکشن GPU سرونگ تک، اور GGUF + llama.cpp کے ذریعے tiny-device CPU inference تک۔

Mistral 3 کیا ہے؟

Mistral 3، Mistral AI کے open-weight ماڈلز کی تازہ ترین جنریشن ہے۔ یہ فیملی ایک بڑے Mistral Large 3 (sparse Mixture-of-Experts — MoE — ماڈل) اور کئی edge/“ministral” ویریئنٹس (3B، 8B، 14B) پر مشتمل ہے جو instruction following اور multimodal (ٹیکسٹ+ویژن) ٹاسکس کے لیے ٹیون کیے گئے ہیں۔ Mistral نے اس ریلیز کو وسیع استعمال کے لیے پوزیشن کیا ہے: high-performance datacenter inference (specialized optimized checkpoints کے ساتھ) سے لے کر ایج اور لیپ ٹاپ استعمال تک، quantized فارمیٹس اور چھوٹے ویریئنٹس کے ذریعے۔

کلیدی عملی خصوصیات:

- Mixture-of-Experts (MoE) آرکیٹیکچر Large 3 ویریئنٹ میں، جو بہت بڑے “کل” پیرامیٹر کاؤنٹ کے ساتھ کام کرتا ہے جبکہ ہر ٹوکن پر صرف منتخب ماہرین فعال ہوتے ہیں — اس سے scale-for-compute کی کارکردگی بہتر ہوتی ہے۔

- Ministral 3 ماڈلز کی فیملی (3B / 8B / 14B) جو ایج اور لوکل استعمال کے لیے بنائی گئی ہے، ان میں instruction-tuned اور multimodal ویریئنٹس شامل ہیں۔

- Official checkpoints اور optimized checkpoints (NVFP4/FP8) جو vLLM اور NVIDIA پلیٹ فارمز جیسے accelerated runtimes کے لیے ہیں۔

- Multimodal + multilingual + long context — Ministral اور Large ویریئنٹس تصویر+متن فہمی اور وسیع زبان کور کی ترجیح دیتے ہیں۔ ایسی ایپلی کیشنز کے لیے جو تصاویر + طویل دستاویزات کو ملاتی ہیں، یہ اہم ہے۔

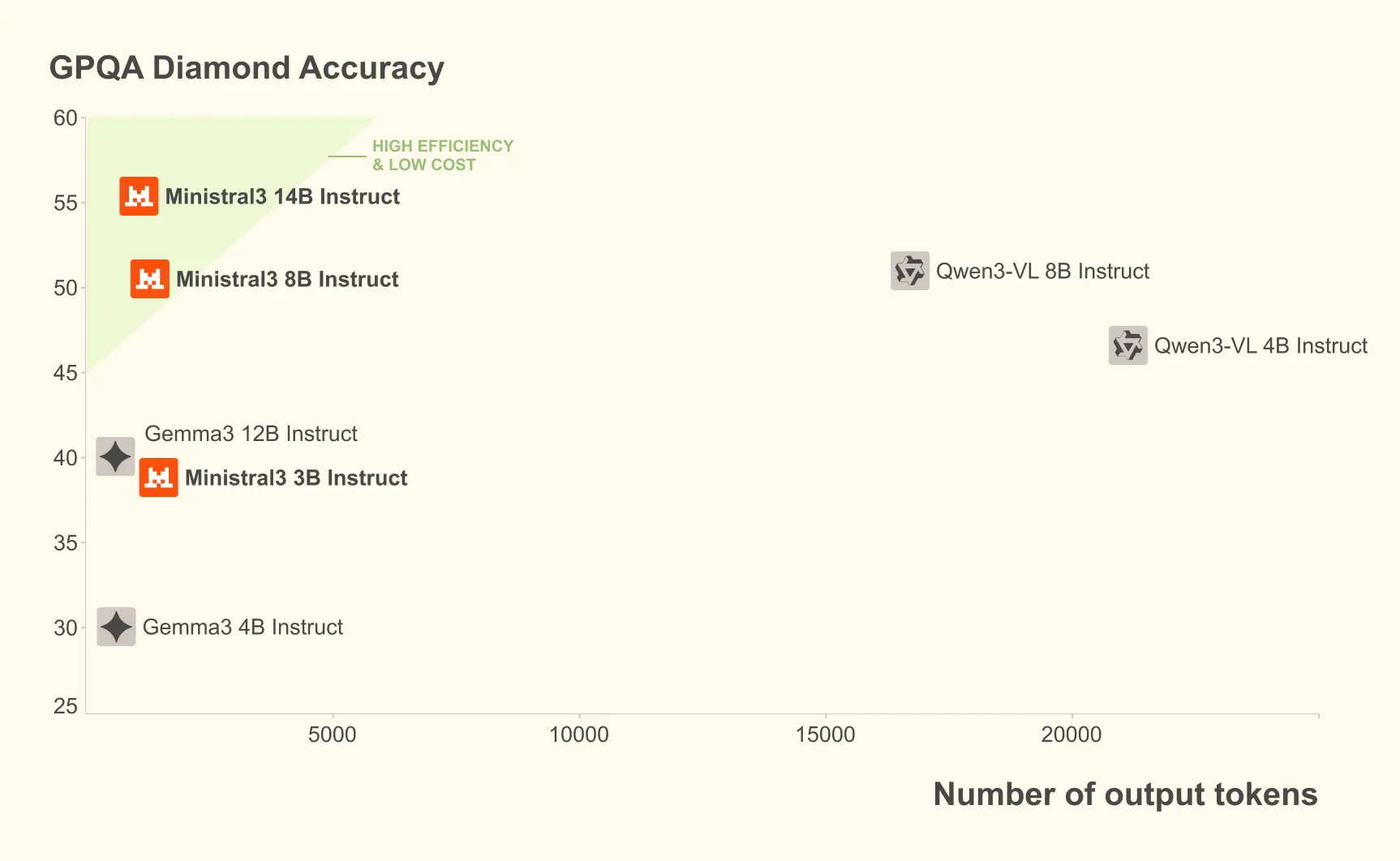

GPQA Diamond ڈیٹاسیٹ (ایک سخت سائنسی ریزننگ ٹیسٹ) پر، Miniral 3 کے مختلف ویریئنٹس، آؤٹ پٹ ٹوکنز کی تعداد بڑھنے کے باوجود، اعلیٰ درستگی برقرار رکھتے ہیں۔ مثال کے طور پر، Miniral 3B Instruct ماڈل 20,000 ٹوکنز تک ہینڈل کرتے وقت 35-40% درستگی برقرار رکھتا ہے، جو Gemma 2 9B جیسے بڑے ماڈلز کے قابلِ موازنہ ہے، جبکہ کم وسائل استعمال کرتا ہے۔

Mistral 3 کی آرکیٹیکچر کیا ہے؟

Mistral 3 ایک فیملی ہے نہ کہ ایک سنگل آرکیٹیکچر، لیکن دو پیٹرنز جنہیں سمجھنا ضروری ہے وہ یہ ہیں:

Dense چھوٹے ماڈلز (Ministral 3)

- معیاری transformer stacks، جو کارکردگی اور ایج inference کے لیے optimize کیے گئے ہیں۔

- متعدد سائز (3B/8B/14B) اور مختلف fine-tuned ویریئنٹس میں دستیاب: base، instruct، اور reasoning؛ بہت سے ویریئنٹس میں native multimodal (ویژن + ٹیکسٹ) سپورٹ اور long context آپریشن شامل ہیں۔ Minstral ماڈلز بعض ڈسٹری بیوشنز میں compactness کے لیے optimized FP8 weights کے ساتھ ریلیز کیے گئے ہیں۔

Sparse Mixture-of-Experts (Mistral Large 3)

- MoE آرکیٹیکچر: ماڈل میں بہت سے experts (بہت بڑا کل پیرامیٹر کاؤنٹ) ہوتے ہیں، لیکن فی ٹوکن صرف routing-selected subset کو evaluate کیا جاتا ہے — اس سے compute کے مقابلے میں بہتر scale حاصل ہوتا ہے۔

- Mistral Large 3 تقریباً ~675B کل پیرامیٹرز اور تقریباً ~41B active پیرامیٹرز بطور inference کے دوران رپورٹ کرتا ہے، جو اس MoE ڈیزائن کی عکاسی ہے۔ ماڈل جدید NVIDIA ہارڈویئر پر ٹرین کیا گیا اور کم-precision execution (NVFP4/TensorRT/Large-kernel optimizations) کے لیے optimize کیا گیا ہے۔

لوکل طور پر چلانے کے لیے اہم تکنیکی فیچرز:

- Long context: بعض Mistral 3 ویریئنٹس بہت طویل context کو سپورٹ کرتے ہیں (vLLM ڈاکس اور Mistral ڈاکس بعض ویریئنٹس کے لیے بڑے context windows کا ذکر کرتے ہیں؛ مثلاً، کچھ Ministral ویریئنٹس میں 256k)۔ یہ میموری اور سرونگ پیٹرنز کو متاثر کرتا ہے۔

- Weight فارمیٹس اور quantization: Mistral، weights کو compressed/optimized فارمیٹس (FP8, NVFP4) میں فراہم کرتا ہے اور جدید quantization ٹول چینز (BitsAndBytes, GPTQ, vendor toolchains) کے ساتھ کام کرتا ہے تاکہ عملی لوکل inference ممکن ہو۔

آپ Mistral 3 کو لوکل طور پر کیوں چلائیں گے؟

لوکل LLM چلانا اب محض ایک نِش مشغلہ نہیں رہا — یہ اُن ٹیموں اور افراد کے لیے عملی آپشن ہے جو درج ذیل چیزوں کو اہمیت دیتے ہیں:

- ڈیٹا پرائیویسی اور کمپلائنس۔ لوکل ہوسٹنگ حساس ان پٹس کو آپ کے انفراسٹرکچر کے اندر رکھتی ہے (فنانس، ہیلتھ کیئر، لیگل میں اہم)۔ Reuters نے ہائی پروفائل کسٹمرز کے بارے میں رپورٹ کیا ہے جو Mistral ماڈلز کو خود ہوسٹ کرنے کا انتخاب کرتے ہیں۔

- Latency اور لاگت پر کنٹرول۔ سخت latency SLOs اور قابلِ پیش گوئی لاگت کے لیے، لوکل یا پرائیویٹ کلسٹر inference کلاؤڈ API کے مہنگے جھٹکے سے بہتر ہو سکتا ہے۔ چھوٹے ministral ویریئنٹس اور quantized فارمیٹس اسے عملی بناتے ہیں۔

- Customization اور fine-tuning۔ جب آپ کو کسٹم رویہ، فنکشن کالنگ یا نئی modalities درکار ہوں، لوکل کنٹرول، کسٹم fine-tuning اور ڈیٹا ہینڈلنگ کو ممکن بناتا ہے۔ Hugging Face اور vLLM انٹیگریشن اسے مزید تیار شدہ بناتے ہیں۔

اگر یہ وجوہات آپ کی ترجیحات — پرائیویسی، کنٹرول، لاگت کی پیش گوئی، یا تحقیق — سے میل کھاتی ہیں تو لوکل ڈپلائمنٹ پر غور کرنا چاہیے۔

آپ Mistral 3 کو لوکل طور پر کیسے چلا سکتے ہیں (تین عملی طریقے)؟

Mistral 3 کو لوکل طور پر چلانے کے کئی طریقے ہیں۔ میں تین طریقے بیان کروں گا جو عام یوزر سیناریوز کو کور کرتے ہیں:

- Ollama (زیرو-کنفیگ ڈیسک ٹاپ / لوکل سرور، اکثر یوزرز کے لیے آسان ترین)

- Hugging Face Transformers + PyTorch / vLLM (فل کنٹرول، GPU کلسٹرز)

- llama.cpp / ggml / GGUF quantized CPU inference (ہلکا پھلکا، لیپ ٹاپ/CPU پر چلتا ہے)

ہر طریقے کے لیے میں بتاؤں گا کہ کب معنی رکھتا ہے، prerequisites، مرحلہ وار کمانڈز اور چھوٹے کوڈ مثالیں۔

1) آپ Mistral 3 کو Ollama کے ساتھ کیسے چلائیں (سب سے تیز راستہ)؟

کب استعمال کریں: آپ ایک frictionless لوکل تجربہ چاہتے ہیں (macOS/Linux/Windows)، آسان CLI یا GUI، اور جب دستیاب ہو تو خودکار ڈاؤن لوڈز/quantized artifacts۔ Ollama کے پاس Ministral 3 اور Mistral فیملی کے دیگر ماڈلز کے انٹریز موجود ہیں۔

ضروریات

- Ollama انسٹال ہو (پلیٹ فارم مخصوص انسٹالرز کے لیے ollama.com دیکھیں)۔ Ollama لائبریری بعض ministral ریلیزز کے لیے مخصوص کم از کم ورژنز کی نشاندہی کرتی ہے۔

- ماڈل artifacts اسٹور کرنے کے لیے کافی ڈسک اسپیس (ماڈل سائز مختلف ہوتے ہیں — ministal 3B کے quantized ورژنز چند GB ہوسکتے ہیں؛ بڑے BF16 ویریئنٹس کئی درجن GB کے ہوتے ہیں)۔

مراحل (مثال)

- Ollama انسٹال کریں (macOS مثال — اپنے پلیٹ فارم کے مطابق تبدیل کریں):

# macOS (Homebrew) example — see ollama.com for platform-specific installersbrew install ollama

- ایک ministral ماڈل چلائیں:

# Pull and run the model interactivelyollama run ministral-3

- لوکل طور پر سرونگ (API) اور کوڈ سے کال کریں:

# Run Ollama server (default port shown in docs)ollama serve# Then curl against it (example)curl -s -X POST "http://localhost:11434/api/v1/generate" \ -H "Content-Type: application/json" \ -d '{"model":"ministral-3","prompt":"Summarize Mistral 3 in one sentence."}'

نوٹس اور مشورے

- Ollama ماڈل ڈاؤن لوڈ اور (جب دستیاب ہو) لوکل quantized ویریئنٹس کو خود ہینڈل کرتا ہے — ماڈلز کو جلدی آزمانے کے لیے بہت سہولت ہے۔

- اگر آپ ماڈل کو پروڈکشن میں بہت سے متوازی ریکویسٹ کے ساتھ استعمال کرنے کا ارادہ رکھتے ہیں تو Ollama پروٹو ٹائپنگ کے لیے بہترین ہے، لیکن مستقل لوڈ کے لیے scaling اور resource orchestration کا جائزہ لیں۔

2) آپ Mistral 3 کو Hugging Face Transformers کے ساتھ کیسے چلائیں (GPU / vLLM انٹیگریشن)؟

کب استعمال کریں: آپ کو تحقیق یا پروڈکشن کے لیے programmatic کنٹرول چاہیے، fine-tune کرنا چاہتے ہیں، یا GPU کلسٹرز پر vLLM جیسی accelerated inference stacks استعمال کرنا چاہتے ہیں۔ Hugging Face، Transformers سپورٹ فراہم کرتا ہے اور Mistral، vLLM/NVIDIA کے لیے optimized checkpoints پیش کرتا ہے۔

ضروریات

- کافی میموری کے ساتھ GPU (ماڈل اور precision کے مطابق مختلف ہوتا ہے)۔ Ministral 3 کے چھوٹے ماڈلز (3B/8B) کو quantize کرنے پر سنگل mid-range GPU پر چلایا جا سکتا ہے؛ بڑے ویریئنٹس کے لیے متعدد H100/A100 یا vLLM کے لیے optimized NVFP4 checkpoints درکار ہوتے ہیں۔ NVIDIA اور Mistral ڈاکیومنٹیشن بڑے ماڈلز کے لیے مخصوص نوڈ سائزز کی سفارش کرتی ہے۔

- Python، PyTorch، transformers، accelerate (یا اگر آپ وہ سرور چاہتے ہیں تو vLLM)۔

Python مثال — بنیادی Hugging Face pipeline (3B instruct ویریئنٹ، GPU):

# Example: CPU/GPU inference with transformers pipeline# Assumes you have CUDA and a compatible PyTorch build.import torchfrom transformers import pipelinemodel_name = "mistralai/Ministral-3-3B-Instruct-2512-BF16" # example HF model idgenerator = pipeline( "text-generation", model=model_name, device_map="auto", torch_dtype=torch.bfloat16, # use bfloat16 if your hardware supports it)prompt = "Explain how attention helps transformers, in 3 sentences."out = generator(prompt, max_new_tokens=120, do_sample=False)print(out[0]["generated_text"])

پروڈکشن GPU inference کے لیے vLLM استعمال کرنا

vLLM بڑے ماڈلز کو مؤثر انداز میں سرونگ کے لیے ڈیزائن کیا گیا ہے، Mistral 3 فیملی کو سپورٹ کرتا ہے، اور Mistral نے vLLM/NVIDIA ہارڈویئر کے لیے optimized checkpoints (NVFP4/FP8) شائع کیے ہیں تاکہ میموری فٹ پرنٹ کم اور رفتار بہتر ہو۔ vLLM سرور شروع کرنے سے آپ کو کم latency، batched inference اینڈ پوائنٹ ملتا ہے۔ ماڈل پاتھز اور تجویز کردہ flags کے لیے vLLM recipes اور Mistral کی ہدایات دیکھیں۔

نوٹس اور مشورے

- پروڈکشن کے لیے، optimized checkpoints (NVFP4/FP8) کو ترجیح دیں اور تجویز کردہ GPUs (مثلاً، H100/A100) پر چلائیں یا ایسے orchestration لیئر کا استعمال کریں جو tensor/model parallelism کو سپورٹ کرتی ہو۔ Mistral اور NVIDIA کے پاس optimized runtimes پر ڈاکیومنٹیشن اور بلاگ پوسٹس ہیں۔

- ہمیشہ ڈسک پر عین وہی ماڈل checkpoint (یا reproducible HF snapshot) pin کریں تاکہ نتائج قابلِ تکرار رہیں اور خاموش ماڈل اپ ڈیٹس سے بچا جا سکے۔

3) آپ Mistral 3 کو CPU پر llama.cpp / GGUF quantized ماڈلز کے ساتھ کیسے چلائیں؟

کب استعمال کریں: آپ کو لوکل، آف لائن inference CPU پر چاہیے (مثلاً، ڈیولپر لیپ ٹاپ، محفوظ air-gapped ماحول) اور آپ runtime اور میموری ایفیشنسی کے بدلے کچھ کوالٹی ٹریڈ آف کرنے پر آمادہ ہیں۔ یہ طریقہ ggml/llama.cpp اور GGUF quantized weights (q4/q5/etc.) استعمال کرتا ہے۔

ضروریات

- Ministral ماڈل کا GGUF quantized بلڈ (کمیونٹی کے بہت سے ممبرز Hugging Face پر quantized GGUFs شائع کرتے ہیں یا BF16 weights کو لوکل طور پر GGUF میں تبدیل کرتے ہیں)۔

Ministral-3-3B-InstructGGUF ویریئنٹس تلاش کریں۔ - کمپائل شدہ llama.cpp بائنری (پروجیکٹ README فالو کریں)۔

Quantize (اگر آپ کے پاس اصل weights ہوں) — مثال (تصوری)

# Example: quantize from an FP16/BF16 model to a GGUF q4_K_M (syntax depends on llama.cpp version)./quantize /path/to/original/model.bin /path/to/out.gguf q4_k_m

GGUF کو llama.cpp کے ساتھ چلائیں

# run interactive inference with a quantized GGUF model./main -m /path/to/ministral-3-3b-instruct.gguf -t 8 -c 2048 --interactive# -t sets threads, -c sets context (tokens) if supported

Python کلائنٹ مثال (لوکل llama.cpp سرور یا subprocess)

آپ llama.cpp کو ایک subprocess کے طور پر اسپان کر کے اسے prompts دے سکتے ہیں، یا ایک چھوٹا wrapper کلائنٹ استعمال کر سکتے ہیں۔ کمیونٹی کے بہت سے پروجیکٹس، لوکل ایپ انٹیگریشن کے لیے llama.cpp کے گرد ایک سادہ HTTP سرور wrapper فراہم کرتے ہیں۔

نوٹس اور ٹریڈ آفز

- Quantization، VRAM کم کرتی ہے اور CPU inference کو ممکن بناتی ہے لیکن کوالٹی کم کر سکتی ہے (ہلکی سے معتدل، quant فارمیٹ پر منحصر)۔ q4_K_M یا q5 قسم کے فارمیٹس CPU استعمال کے لیے عام سمجھوتے ہیں۔ جاپانی اور تکنیکی پوسٹس Q4/Q5 اقسام اور GGUF کنورژنز کی تفصیل بیان کرتی ہیں۔

- چھوٹے سے درمیانے ورک لوڈز کے لیے، GGUF + llama.cpp اکثر لوکل LLM چلانے کا سب سے سستا اور قابلِ حمل طریقہ ہے۔

کون سا ہارڈویئر اور میموری غور و فکر اہم ہے؟

مختصر، عملی رہنمائی:

- 3B ماڈلز: اکثر quantize کر کے اچھے لیپ ٹاپ CPU یا ایک سنگل GPU پر 8–16 GB VRAM کے ساتھ چل سکتے ہیں (precision/quantization پر منحصر)۔ GGUF q4 ویریئنٹس کئی جدید CPUs پر چل سکتے ہیں۔

- 8B اور 14B ministers: عموماً mid-range GPU درکار ہوتا ہے (مثلاً، 24–80 GB precision اور activation caching کے مطابق) یا متعدد ڈیوائسز پر quantization۔

- Mistral Large 3 (675B کل، 41B active): ڈیٹا سینٹر ڈپلائمنٹ کے لیے بنایا گیا اور عموماً multi-GPU نوڈز (مثلاً، 8×A100 یا H100) کے ساتھ بہترین چلتا ہے، اور vLLM کے لیے specialized فارمیٹس (NVFP4/FP8) استعمال کرتا ہے۔ Mistral نے ایسے ڈپلائمنٹس کو قابلِ عمل بنانے کے لیے optimized checkpoints واضح طور پر شائع کیے ہیں۔

اگر آپ کی ترجیح لوکل لیپ ٹاپ استعمال ہے تو Ministral 3B quantized GGUF + llama.cpp کو منتخب کریں۔ اگر آپ کی ترجیح پروڈکشن تھرو پٹ ہے تو GPUs پر vLLM + NVFP4 checkpoints دیکھیں۔ اگر آپ آسان تجربہ کاری چاہتے ہیں تو Ollama شروع کرنے کا تیز ترین طریقہ ہے۔

آپ quantization اور precision کیسے منتخب کریں؟

Quantization ایک ٹریڈ ہے: میموری اور رفتار بمقابلہ خام ماڈل کوالٹی۔ عام انتخاب:

q4_0/q4_1/q4_K_M: مشہور 4-bit آپشنز جو CPU inference کے لیے استعمال ہوتے ہیں؛q4_K_M(k-means ویریئنٹ) اکثر بہتر quality/performance بیلنس پیش کرتا ہے۔q5/q8/ imatrix ویریئنٹس: درمیانی فارمیٹس جو سائز کی قیمت پر زیادہ fidelity محفوظ رکھ سکتے ہیں۔- FP16 / BF16 / FP8 / NVFP4: GPU precisions — BF16 اور FP16 جدید GPUs پر ٹریننگ/Inference کے لیے عام ہیں؛ FP8 / NVFP4 ابھرتے ہوئے فارمیٹس ہیں جو بہت بڑے ماڈلز کے لیے میموری بچاتے ہیں اور optimized runtimes اور Mistral کے checkpoint ریلیزز میں سپورٹ ہوتے ہیں۔

Rule of thumb: لوکل CPU رنز کے لیے q4_K_M یا اس جیسا انتخاب کریں؛ ہائی fidelity کے ساتھ GPU inference کے لیے BF16/FP16 استعمال کریں یا runtime کی سپورٹ ہونے پر vendor-specific FP8/NVFP4 منتخب کریں۔

نتیجہ — کیا آپ کو Mistral 3 لوکل طور پر چلانا چاہیے؟

اگر آپ کو پرائیویسی، کم latency، یا customization درکار ہے، تو ہاں: Mistral 3 فیملی آپ کو وسیع انتخاب دیتی ہے — ایج CPU کے لیے چھوٹے ماڈلز، سنگل GPU یا معمولی کلسٹر کے لیے درمیانے ماڈلز، اور ڈیٹا سینٹر اسکیل کے لیے بڑا MoE فلیور — اور ایکو سسٹم (Ollama، Hugging Face، vLLM، llama.cpp) پہلے ہی عملی لوکل اور پرائیویٹ ڈپلائمنٹ پیٹرنز کو سپورٹ کرتا ہے۔ Mistral نے NVIDIA اور vLLM کے ساتھ مل کر high throughput اور کم میموری فٹ پرنٹ کے لیے optimized checkpoints بھی فراہم کیے ہیں، جس سے پروڈکشن self-hosting پہلے سے زیادہ حقیقت پسندانہ بن گئی ہے۔

شروع کرنے کے لیے، مزید ماڈلز (مثلاً Gemini 3 Pro) کی صلاحیتیں Playground میں ایکسپلور کریں اور تفصیلی ہدایات کے لیے API guide سے رجوع کریں۔ رسائی سے پہلے، براہ کرم یقینی بنائیں کہ آپ نے CometAPI میں لاگ ان کیا ہے اور API key حاصل کر لی ہے۔ CometAPI سرکاری قیمت سے کہیں کم قیمت پیش کرتا ہے تاکہ آپ کو انٹیگریٹ کرنے میں مدد ملے۔

تیار ہیں؟→ CometAPI پر آج ہی سائن اپ کریں !