Mô hình lý luận mới nhất của OpenAI, o3‑pro, đại diện cho bước nhảy vọt đáng kể về hiệu suất và khả năng cho các ứng dụng do AI điều khiển. Ra mắt vào đầu tháng 2025 năm 3, o3‑pro cung cấp cho các nhà phát triển và doanh nghiệp khả năng lý luận tiên tiến, hiểu biết đa phương thức và sử dụng công cụ—tất cả đều ở mức giá cao cấp. Bài viết này tổng hợp các thông báo, báo cáo của người dùng và dữ liệu chuẩn mới nhất để cung cấp tổng quan toàn diện về hiệu suất, cân nhắc về chi phí và tính khả dụng của oXNUMX‑pro.

O3‑pro là gì?

Sản phẩm mới nhất của OpenAI, o3‑pro, đánh dấu một cột mốc quan trọng trong các mô hình suy luận AI bằng cách kết hợp các khả năng nâng cao với mức giá cao cấp. Ra mắt vào ngày 11 tháng 2025 năm 3, o3‑pro kế thừa mô hình o1 tiêu chuẩn và thay thế o3‑pro trong dòng sản phẩm của OpenAI, nhắm mục tiêu đến các nhà phát triển và doanh nghiệp ưu tiên phân tích sâu và độ tin cậy hơn tốc độ thô. Được xây dựng trên cùng một kiến trúc cơ bản như o2025—ban đầu được giới thiệu vào tháng 3 năm XNUMX—oXNUMX‑pro tích hợp tìm kiếm web thời gian thực, phân tích tệp, suy luận trực quan, thực thi Python và các tính năng bộ nhớ nâng cao, giải quyết các quy trình làm việc phức tạp trong khoa học, lập trình, kinh doanh và viết. Tuy nhiên, cách tiếp cận suy luận có chủ đích của mô hình phải chịu độ trễ dài hơn và tăng chi phí đáng kể, phản ánh thiết kế chuyên sâu về tính toán của nó.

Điểm khác biệt giữa o3‑pro và mẫu o3 tiêu chuẩn là gì?

Lý luận đa phương thức nâng cao

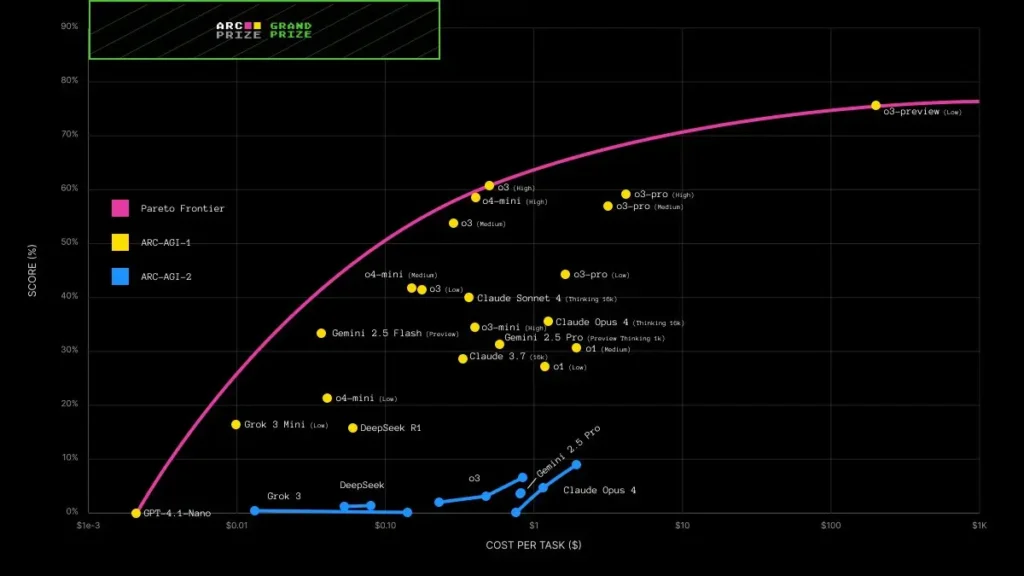

OpenAI đã đánh giá nghiêm ngặt o3‑pro qua nhiều đánh giá AI tiêu chuẩn để xác thực khả năng lập luận của nó. Trong lĩnh vực toán học, o3‑pro vượt trội hơn Gemini 2.5 Pro của Google trên chuẩn AIME 2024, chứng minh khả năng lập luận logic và giải phương trình phức tạp vượt trội trong điều kiện giới hạn thời gian. Tương tự như vậy, trên chuẩn GPQA Diamond—đo lường hiểu biết khoa học và giải quyết vấn đề ở cấp độ tiến sĩ—o3‑pro vượt trội hơn Claude 4 Opus của Anthropic, nhấn mạnh chiều sâu của nó trong lập luận khoa học nâng cao.

o3‑pro xây dựng dựa trên thế mạnh của mô hình o3 hàng đầu của OpenAI bằng cách tích hợp duyệt web thời gian thực, phân tích tệp, hiểu trực quan và thực thi Python tức thời vào một giao diện duy nhất. Theo OpenAI, khả năng suy luận nâng cao này cho phép o3‑pro giải quyết các tác vụ phức tạp—chẳng hạn như diễn giải dữ liệu khoa học, gỡ lỗi mã dài và tạo nội dung đa phương thức—với độ tin cậy cao hơn so với phiên bản tiền nhiệm.

Độ tin cậy hơn độ trễ

Những khả năng mới này đi kèm với sự đánh đổi: thời gian phản hồi của o3-pro chậm hơn đáng kể so với o3, phản ánh các bước tính toán và xử lý ngữ cảnh bổ sung cần thiết để sử dụng công cụ nâng cao. Những người dùng sớm báo cáo độ trễ thông thường là 1.5–2 lần so với o3 trên các lời nhắc tương đương, mặc dù các con số chính xác thay đổi tùy theo độ phức tạp của yêu cầu.

Giới hạn tính năng khi ra mắt

Khi ra mắt, người dùng o3‑pro nhận thấy một số hạn chế tạm thời: việc tạo hình ảnh vẫn không khả dụng và một số tính năng ChatGPT—chẳng hạn như các phiên “Canvas” tạm thời và các luồng trò chuyện tạm thời—bị vô hiệu hóa trong khi OpenAI mở rộng cơ sở hạ tầng cho mô hình mới. Những hạn chế này dự kiến sẽ được nới lỏng trong những tháng tới khi năng lực mở rộng.

O3‑pro hoạt động như thế nào trên các tiêu chuẩn công nghiệp?

Bài kiểm tra lý luận chuẩn hóa

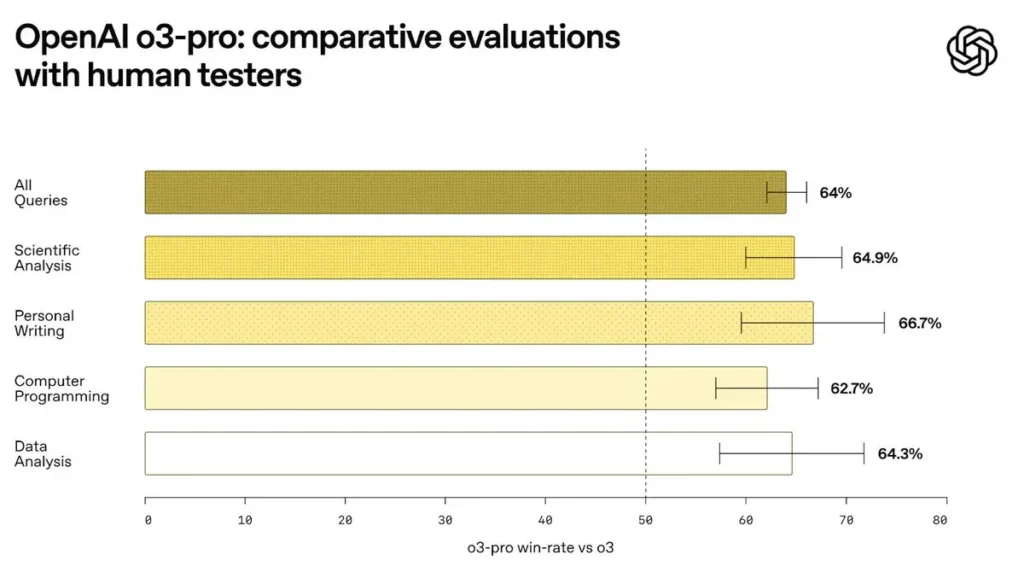

Trong các bài kiểm tra nội bộ, o3‑pro đã vượt trội hơn o3 với biên độ đáng kể về các bộ lý luận chuẩn hóa bao gồm toán học, câu đố logic và các thử thách lập trình. Điểm số do cộng đồng báo cáo cho thấy o3 đạt khoảng 2,517 điểm, trong khi điểm số của o3‑pro đạt gần 2,748—cải thiện khoảng 9%.

Đánh giá mã hóa thế giới thực

Các nhà phát triển chạy tác vụ tạo mã trực tiếp và gỡ lỗi đã quan sát thấy rằng o3‑pro tạo ra các đầu ra chính xác hơn về mặt cú pháp và chính xác hơn về mặt ngữ nghĩa trong các thiết lập single-shot và few-shot. Các điểm chuẩn trên các kho lưu trữ mã hóa như CodeSearchNet cho thấy mức tăng 5–7% về độ chính xác về mặt chức năng so với o3, đặc biệt là đối với các vấn đề ngữ cảnh dài vượt quá 4,000 mã thông báo.

Hiệu suất so sánh với đối thủ cạnh tranh

Trong các bài kiểm tra đối đầu, o3‑pro không chỉ đánh bại Gemini 2.5 Pro và Claude 4 Opus về điểm thô mà còn cung cấp kết quả đầu ra nhất quán hơn trong các bài kiểm tra ứng suất đối nghịch. Bằng cách kết hợp xử lý đầu vào đa phương thức và sử dụng công cụ động, o3‑pro thu hẹp khoảng cách với các mô hình chuyên biệt từ các đối thủ như Google PaLM và Anthropic Claude X. Các bài kiểm tra đối đầu ban đầu cho thấy o3‑pro ngang bằng hoặc vượt trội hơn về độ chính xác của đối thủ trên các điểm chuẩn lý luận phức tạp, mặc dù các báo cáo toàn diện của bên thứ ba vẫn chưa được công bố.

Các nhà phát triển nên mong đợi cấu trúc giá nào?

Mô hình thanh toán dựa trên mã thông báo

OpenAI tiếp tục tính phí theo token: o3‑pro có giá 20 đô la cho mỗi triệu token đầu vào và 80 đô la cho mỗi triệu token đầu ra—chính xác gấp mười lần chi phí của mô hình o3 tiêu chuẩn sau khi giảm giá gần đây. Ngược lại, o3 hiện có giá 2 đô la cho mỗi triệu token đầu vào và 8 đô la cho mỗi triệu token đầu ra sau khi giảm giá 80% vào đầu tháng 2025 năm XNUMX.

| Mẫu | Giá Token đầu vào | Giá token đầu ra |

|---|---|---|

| o3 | 2 đô la/1 triệu token | 8 đô la/1 triệu token |

| o3‑chuyên nghiệp | 20 đô la/1 triệu token | 80 đô la/1 triệu token |

Cơ sở lý luận đằng sau phí bảo hiểm

Mức tăng giá gấp mười lần này phản ánh các tài nguyên tính toán bổ sung, cơ sở hạ tầng thông lượng cao và tích hợp công cụ chuyên dụng mà o3‑pro yêu cầu. OpenAI định vị o3‑pro là mô hình “quan trọng đối với sứ mệnh” cho các ứng dụng mà độ chính xác và lý luận nâng cao biện minh cho mức phí bảo hiểm.

Chiết khấu theo khối lượng và API theo lô

Các doanh nghiệp xử lý khối lượng lớn token vẫn có thể tận dụng Batch API để tiết kiệm tới 50% cho các đầu vào và đầu ra được lưu trong bộ nhớ đệm. Mặc dù cơ chế này chủ yếu có lợi cho người dùng khối lượng lớn các biến thể GPT-4.1, các tùy chọn xử lý hàng loạt tương tự dự kiến sẽ được triển khai cho các mô hình o-series vào cuối năm 2025.

Các nhà phát triển và nhóm có thể truy cập o3‑pro bằng cách nào?

Tính khả dụng của API

Trong các bài kiểm tra đối đầu, o3‑pro không chỉ đánh bại Gemini 2.5 Pro và Claude 4 Opus về điểm số thô mà còn mang lại kết quả nhất quán hơn trong các bài kiểm tra căng thẳng đối nghịch.

OpenAI đã tạo ra o3‑pro có thể truy cập thông qua API công khai của mình vào ngày 10 tháng 2025 năm XNUMX, với sự hỗ trợ ngay lập tức ở cả điểm cuối Hoàn thành và Trò chuyện. Các nhà phát triển có thể chỉ định "o3-pro" mô hình trong các lệnh gọi API của họ, tuân theo giới hạn tỷ lệ và hạn ngạch gắn liền với tầng đăng ký của họ.

POST https://api.openai.com/v1/chat/completions

{

"model": "o3-pro",

"messages": ,

"max_tokens": 1500

}

Gói ChatGPT Pro & Team

Người đăng ký ChatGPT Pro và Team có quyền truy cập trực tiếp vào o3‑pro trong giao diện ChatGPT. Người dùng có thể chuyển đổi giữa o3 và o3‑pro trong trình chọn mô hình, mặc dù tính khả dụng ban đầu chỉ giới hạn ở một nhóm nhỏ khách hàng doanh nghiệp và người thử nghiệm beta.

Thông qua API CometAPI

Các nhà phát triển có thể truy cập API o3-Pro(người mẫu: "o3-Pro"hoặc"o3-pro-2025-06-10") bởi vì Sao chổiAPI, các mô hình mới nhất được liệt kê là tính đến ngày xuất bản bài viết. Để bắt đầu, hãy khám phá khả năng của mô hình trong Sân chơi và tham khảo ý kiến Hướng dẫn API để biết hướng dẫn chi tiết. Trước khi truy cập, vui lòng đảm bảo bạn đã đăng nhập vào CometAPI và lấy được khóa API. Sao chổiAPI cung cấp mức giá thấp hơn nhiều so với giá chính thức để giúp bạn tích hợp.

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.cometapi.com/v1",

api_key="<YOUR_API_KEY>",

)

response = client.chat.completions.create(

model="o3-Pro",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices.message.content

print(f"Assistant: {message}")

Những trường hợp sử dụng thực tế nào được hưởng lợi nhiều nhất từ o3‑pro?

Nghiên cứu khoa học & Phân tích dữ liệu

Các nhà nghiên cứu làm việc với các tập dữ liệu lớn, từ nghiên cứu bộ gen đến mô phỏng khí hậu, có thể tận dụng khả năng phân tích tệp và thực thi Python của o3‑pro để tự động kiểm tra giả thuyết và tạo ra thông tin chi tiết mà không bị hạn chế về độ dài ngữ cảnh.

Quy trình công việc kiến thức doanh nghiệp

Trong các lĩnh vực như tài chính và dịch vụ pháp lý, nơi độ chính xác và khả năng kiểm toán là tối quan trọng, khả năng tuân thủ hướng dẫn được cải thiện và lý luận đa phương thức của o3-pro giúp giảm tỷ lệ lỗi trong các nhiệm vụ xem xét hợp đồng, lập mô hình tài chính và tuân thủ quy định.

Phát triển phần mềm & DevOps

Bằng cách kết hợp khả năng hiểu mã ngữ cảnh dài với thử nghiệm trực tiếp thông qua thực thi Python, o3‑pro hợp lý hóa quá trình gỡ lỗi và tự động hóa quy trình tái cấu trúc phức tạp, đẩy nhanh chu kỳ phân phối cho các dự án phần mềm quy mô lớn.

Các tổ chức nên cân nhắc những gì trước khi nâng cấp?

Phân tích chi phí-lợi ích

Các nhóm phải cân nhắc mức tăng giá 10 lần so với mức tăng hiệu quả dự kiến. Đối với các nhiệm vụ có giá trị cao, khối lượng thấp—chẳng hạn như soạn thảo báo cáo chiến lược hoặc xây dựng các hệ thống an toàn quan trọng—độ chính xác và hỗ trợ công cụ có thể biện minh cho mức phí bảo hiểm của o3-pro. Đối với việc tạo nội dung số lượng lớn, việc sử dụng các mô hình o3 hoặc o4-mini tiêu chuẩn có thể tiết kiệm hơn.

Sự sẵn sàng của cơ sở hạ tầng

Do o3‑pro áp đặt yêu cầu về độ trễ và thông lượng cao hơn nên các tổ chức cần kiểm tra giới hạn tốc độ API, dung lượng mạng và chiến lược thử lại lỗi để tránh tình trạng tắc nghẽn trong thời gian sử dụng cao điểm.

Trong kết luận

Mô hình o3-pro của OpenAI đặt ra một chuẩn mực mới cho lý luận nâng cao, hiểu biết đa phương thức và sử dụng công cụ tích hợp trong AI. Các điểm chuẩn tăng và cải tiến về độ tin cậy của nó khiến nó trở thành một lựa chọn hấp dẫn cho các ứng dụng quan trọng, với điều kiện ngân sách và cơ sở hạ tầng có thể hỗ trợ chi phí cao. Khi bối cảnh AI phát triển, vai trò của o3-pro sẽ được củng cố trong các lĩnh vực đòi hỏi mức độ chính xác và chiều sâu ngữ cảnh cao nhất, trong khi khối lượng công việc nhạy cảm hơn về chi phí có thể tiếp tục tận dụng các mô hình o-series cơ bản hoặc các biến thể mini mới nổi.