OpenAI 在 10 月的更新中報告稱, 每週活躍用戶的 0.15% 對話中包含明確的潛在自殺計劃或意圖的跡象——這一比例,當擴展到 ChatGPT 龐大的用戶群時,相當於 每周有超過一百萬人 透過與該服務討論自殺相關話題,人們將焦點轉向了一個棘手的問題:當人們在聊天中提出嚴重的心理健康問題(包括精神病、躁狂症、自殺意圖和深度情感依賴)時,大型語言模型能否做出有意義且安全的回應?

因此,OpenAI 10 月對 GPT-5 的更新——隨著 gpt-5-oct-3 更新——代表了該公司最明確、最謹慎的舉措,旨在使大型語言模型 (LLM) 在用戶提出心理健康問題時更加安全、更有用。這些變化並非一蹴可幾的靈丹妙藥;而是一系列技術、流程和評估舉措,旨在減少有害或無益的輸出,提供專業資源,並阻止使用者依賴該模型來取代臨床護理。但是,該系統在實務上究竟有多好?究竟發生了哪些變化?還存在哪些風險?

OpenAI 在 GPT-5 中更新了什麼?為什麼這很重要?

OpenAI 部署了 ChatGPT 預設 GPT-5 模型的更新(在通訊中通常稱為 gpt-5-oct-3)旨在加強模型的行為 敏感對話 — 其中包括精神病或躁狂症的跡象、自殺意念或計劃,或對人工智慧的情感依賴,這種依賴可能會取代現實世界的關係。

這些變化是在諮詢了 170 多位心理健康專家後,根據具體的「期望行為」設計的新的內部分類法和自動評估的結果而得出的。經過心理學專家的優化,GPT-5 模型:

- 在針對性的心理健康挑戰集上,新的 GPT-5 模型得分 〜92% 符合公司期望的行為分類法(相比之下,以前版本在困難測試集上的百分比要低得多)。

- 對於自殘和自殺場景,自動評估上升到 〜91% 遵守 77% 在先前描述的基準測試中,GPT-5 變體的表現優於其他變體。 OpenAI 也報告了 〜65% 降低生產流量中多個心理健康領域的「不完全符合」的回應率。

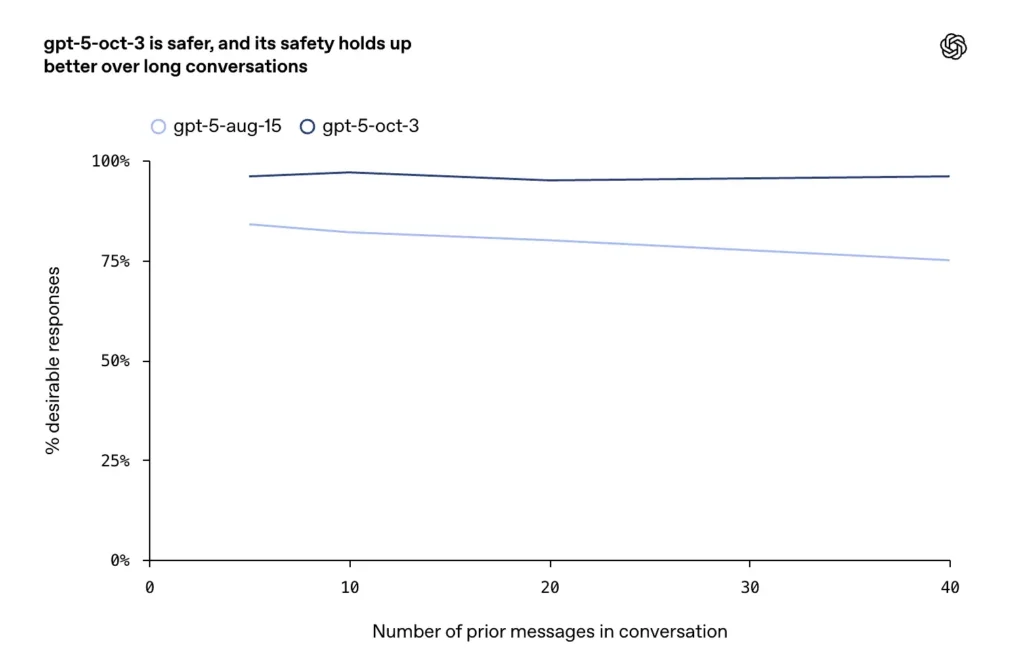

- 據報道,長時間、對抗性或拖延的對話(聊天模型的已知失敗模式)有所改進,該公司表示,10 月的更新在延長的對話過程中保持了更高的一致性和安全性。

這有什麼關係

OpenAI 表示,鑑於 ChatGPT 目前的規模,即使敏感對話的比例很小,也意味著參與人數絕對數量非常龐大。該公司報告稱,在一個典型的一周內:

- 關於 0.07% 活躍用戶表現出與精神病或躁症一致的可能症狀;

- 關於 0.15% 活躍用戶的對話中包含了潛在自殺計畫或意圖的明確跡象;

- 大致 0.15% 活躍用戶對 ChatGPT 表現出「高度」的情感依戀。

為了使這些百分比更加具體:OpenAI 的執行長表示 ChatGPT 已經 ~每週 800 億活躍用戶. 相乘得出絕對用戶數:

Psychosis/mania: 800,000,000 × 0.0007 = 560,000 people/week

Suicidal planning/intent: 800,000,000 × 0.0015 = 1,200,000 people/week

Emotional reliance: 800,000,000 × 0.0015 = 1,200,000 people/week

這些類別嘈雜且重疊(單一對話可能出現在多個類別中),而這些是 估計 源自內部檢測分類法而非臨床診斷。

OpenAI 是如何實現這些改變的──五步驟改進機制?

OpenAI 描述了一個多管齊下、專家指導的流程。以下是一個經過提煉、可重現的流程 五步驟改進機制 這與公司在模型安全工程中的揭露和常見做法相符。

五步驟改進機制

- 專家指導的分類和標籤。 召集精神科醫生、心理學家和初級保健臨床醫生來定義表明精神病/躁狂症、自殘意圖或不健康情感依賴的行為和語言;建立標記資料集和裁決規則。

- 有針對性的資料收集和精選的提示。 收集具有代表性的對話片段、邊緣案例範例和對抗性輸入;並在臨床醫生的監督下製作受控的角色扮演記錄。

- 具有安全目標的模型調整/微調。 使用懲罰強化妄想的損失項、提供安全反應範本和促進路由到危機資源的損失項,在精選資料集上訓練或微調基礎模型。

- 分類器+護欄層(運轉時安全)。 部署快速分類器或監控層,即時偵測高風險的轉向,並調整模型的解碼參數、切換到專門的回應器或升級到人工審核流程。 (這對於避免對話偏離時出現脆弱行為至關重要。)

- 人工專家評估和持續校準。 讓臨床醫生使用臨床評估標準對模型反應進行盲評;測量非預期回應率;迭代分類法、訓練資料和系統提示。維護生產遙測數據並定期重新運行基準測試。

下面是一個緊湊的偽代碼/技術草圖,它捕獲了大多數安全團隊實施的運行時流程(這是 說明性的 和非專有的):

# Illustration: runtime pipeline for sensitive-conversation handling

def handle_user_message(user_msg, user_context):

# Step 1: lightweight classifier to detect risk signals

risk_scores = risk_classifier.predict(user_msg)

if risk_scores > SUICIDE_THRESHOLD:

# Step 2: route to crisis-response responder

response = crisis_responder.generate(user_msg, user_context)

log_event('suicide_route', user_id=user_context.id, scores=risk_scores)

if risk_scores > IMMINENT_THRESHOLD:

trigger_human_alert(user_context)

return response

if risk_scores > PSYCHOSIS_THRESHOLD:

# Step 3: use reality-grounding responder

return grounding_responder.generate(user_msg, user_context)

if risk_scores > RELIANCE_THRESHOLD:

# Step 4: offer boundary-setting and resources

return reliance_responder.generate(user_msg, user_context)

# Default: safe general responder

return default_model.generate(user_msg, user_context)

生產流程通常由短期分類器(快速)、速度較慢但品質較高的反應器(專用提示/調整的檢查點)以及標記病例的人工審核組成。這並非純粹的學術研究:臨床醫師審核了超過 1,800 模型回應並根據分類法對其進行評分,並且這些評論實質上影響了提示和後備行為的編寫方式。

OpenAI 的公開資訊表明,他們使用了所有五個步驟的不同變體以及臨床醫生的評級來評估結果:

- 專家們審閱了超過1,800份模型回覆。

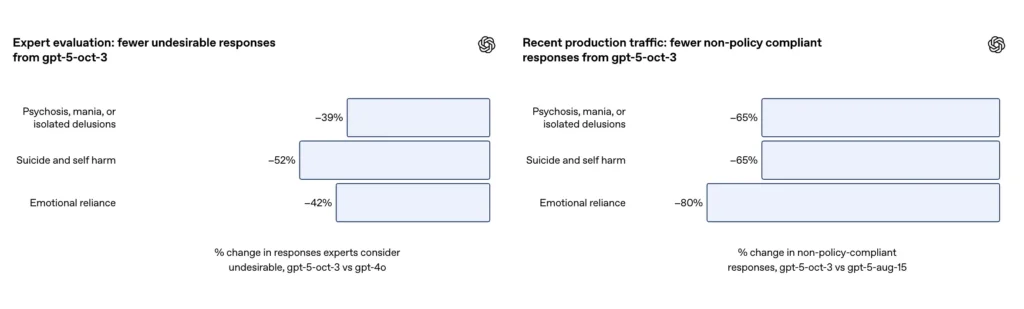

- GPT-5 將所有類別的「不滿意答案」減少了 39%–52%。

- 評分者間信度為 71%–77%,顯示儘管存在主觀差異,但整體共識度很高。

GPT-5 現在對精神病或躁症有何反應?

OpenAI 教會模式做什麼(以及不做什麼)

測量: 提升模型對幻覺和躁狂等嚴重症狀的辨識和反應能力。對於可能暗示妄想、幻覺或躁狂的對話,OpenAI 重寫了部分模型規範,並提供了監督式訓練範例,使 GPT-5 能夠在不肯定或強化無根據的信念的情況下做出回應。模型被鼓勵展現同理心,避免認可妄想,並在必要時溫和地引導使用者採取切實可行的安全措施並尋求專業協助。

評估結果顯示

OpenAI 報告稱,在一組關於精神病/躁狂症的具有挑戰性的對話測試集中,與之前的基線相比,較新的 GPT-5 大幅減少了不必要的響應,並且自動評估對更新後的模型在其分類法上的合規性給予了很高的評分。

| 公制 | GPT-4o | GPT-5 | 起色 |

|---|---|---|---|

| 不合規回覆率 | Baseline | ↓65% | 巨大的進步 |

| 臨床專家評估 | - | 不良反應減少39% | - |

| 自動評估合規率 | 27% | 92% | 上升65個百分點 |

| 用戶參與率 | 約佔每週活躍用戶的 0.07% | 極低,但受到明確監控 | - |

請注意:

- 不當反應減少了 65%;

- 只有 0.07% 的用戶和 0.01% 的訊息包含此類內容;

- 在專家評估中,GPT-5 產生的錯誤回答比 GPT-4o 少 39%;

- 在自動化評估中,GPT-5 的合規率達到了 92%(而其前身僅為 27%)。

GPT-5 如何面對自殺意念與自殘行為?

加強對支援部門的回應,並拒絕提供指示

OpenAI 描述了針對自殘和自殺案例的擴展和明確訓練:該模型經過訓練,能夠識別意圖或計劃的直接和間接信號,提供同理心和緩和衝突的語言,提供危機資源(熱線電話、當地緊急指示),並拒絕提供自殘指導。 10 月的更新強調在長時間對話中表現得更加穩定,而先前的模型有時會給出不安全或前後矛盾的答案。

衡量結果

OpenAI 報告稱,在精心挑選的包含具有挑戰性的自殘和自殺對話的評估數據集上,更新後的 GPT-5 取得了優異的成績。 91%合規 與 OpenAI 期望的行為相比 77% 對於先前的 GPT-5 模型,該公司還表示,領域專家認為更新後的模型將不期望的答案減少了約 100%。 與 GPT-4o 相比,52% 在同一組問題上。此外,OpenAI 聲稱估計 65%減少 在推出新的安全措施後,生產流量中出現了一些「不完全符合」自殘情況分類標準的回應。

| 公制 | GPT-4o | GPT-5 | 起色 |

|---|---|---|---|

| 不適當反應率 | Baseline | ↓65% | 巨大的進步 |

| 臨床專家評級 | - | 不當回應減少了52% | - |

| 自動評估合規率 | 77% | 91% | 上升14個百分點 |

| 用戶參與率 | 每週 0.15%(數百萬用戶) | 水平很低,但具有社會意義 | - |

請注意:

- 不當反應減少了 65%;

- 約 0.15% 的用戶和 0.05% 的訊息涉及潛在的自殺風險;

- 專家評級顯示,與 GPT-4o 相比,GPT-5 減少了 52% 的不當反應;

- 自動評估的合規率提高到 91%(上一代為 77%);

- 在長時間的對話中,GPT-5 保持了 95% 以上的穩定。

什麼是「情感依賴」?又是如何解決這個問題的呢?

使用者建立依戀關係的挑戰

OpenAI 將情感依賴定義為使用者對人工智慧表現出潛在不健康的依賴模式,這種依賴會損害現實世界的人際關係、責任感或身心健康。這並非像自殘指令那樣會立即造成人身安全隱患,而是一種行為安全問題,會隨著時間的推移削弱個人的社會支持和心理韌性。該公司在其模型規範工作中明確將情感依賴列為一個類別,並訓練模型鼓勵使用者與現實世界建立聯繫,使主動與人交流成為一種常態,並避免使用強化依戀排他性的語言。

在這些對話中,該模型被訓練成:

- 鼓勵使用者聯繫朋友、家人或心理諮商師;

- 避免強化對人工智慧的依戀;

- 以溫和理性的方式回應妄想或錯誤信念。

結果報告

根據 OpenAI 的補充說明,此次更新產生了… 減少約 80% 在生產流量中,模型反應中不完全符合情感依賴分類標準的回應率有所提高。在精心策劃的評估對話中,自動評估對更新後的模型給出了以下分數: 97%合規 與先前的 GPT-5 的 50% 相比,GPT-5 在情緒依賴情境下表現出了更符合預期的行為。這些數據表明,在特定的分類和測試集上,GPT-5 的表現有了顯著提升;然而,在實際環境中測量情感依賴本身就存在噪聲,並且容易受到文化和情境差異的影響。

| 公制 | GPT-4o | GPT-5 | 起色 |

|---|---|---|---|

| 不合規回覆率 | 50% | 97%合規 | ↓80% 不當回應 |

| 專家評估 | 不恰當的回答減少了42% | - | - |

| 用戶參與率 | 每週用戶數 0.15%,訊息數 0.03%。 | 罕見但確實存在 | - |

| 模型行為 | 鼓勵現實生活中的戀愛關係;反對「模擬社交戀愛」。 | - | - |

請注意:

- 不當反應減少了 80%;

- 約 0.15% 的用戶/0.03% 的消息顯示出對人工智慧可能有情感依賴的跡象;

- 專家評估顯示,與 GPT-4o 相比,GPT-5 減少了 42% 的不適當反應;

- 自動評估合規率從 50% 顯著提高到 97%。

有哪些限制和潛在風險?

假陰性和假陽性

- 假陰性該模型可能無法識別用戶處於極度危險狀態的微妙或編碼訊號——尤其是在人們以隱晦或暗語交流時。

- 誤報系統可能會在不必要的情況下升級處理或發布危機訊息,這會削弱用戶信任或造成不必要的恐慌。這兩種錯誤都很重要,因為它們會影響使用者的行為和對醫療服務的認知。 OpenAI 也承認檢測並不完美。

過度依賴自動化

即使是最好的模型,也可能促使一些用戶依賴即時、隨時可用的AI回复,而不是尋求持續的人工支援。 OpenAI正是因為有這種風險,才明確將情感依賴列為安全類別;該公司不斷更新系統,試圖引導使用者與他人建立聯繫,但僅靠資訊提示很難改變社會動態。

背景和文化差異

在一種文化或語言中看似恰當的安全短語,在另一種文化或語言中可能忽略了細微差別。因此,徹底的本地化和具有文化敏感性的評估至關重要;OpenAI 已發布的研究結果尚未提供按語言或地區劃分的完整細分數據。

法律和道德風險

當罕見故障造成嚴重後果時,公司將面臨法律和聲譽風險(媒體報告和訴訟已充分凸顯這一點)。 OpenAI 公開揭露問題規模及其為減輕損害所做的努力,這固然是重要的一步,但也招致了監管機構和法律部門的審查。

那麼-GPT-5現在可以處理心理健康問題了嗎?

簡短的回答: **它在許多具體、可衡量的任務上表現明顯更好。**OpenAI 公佈的指標顯示,在自殘、精神病/躁狂和情緒依賴測試套件中,不良反應顯著減少。這些改進是實實在在的,得益於專家意見、更清晰的分類體係以及積極的評估和監控。該公司公開的數據——高合規率和精選數據集上不合規反應的大幅減少——是迄今為止最有力的證據,證明精心設計的多學科工程和臨床合作能夠顯著改變模型的行為。

如何存取最新的 GPT-5 API?

CometAPI 是一個統一的 API 平台,它將來自領先供應商(例如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等)的 500 多個 AI 模型聚合到一個開發者友好的介面中。透過提供一致的身份驗證、請求格式和回應處理,CometAPI 顯著簡化了將 AI 功能整合到您的應用程式中的過程。無論您是建立聊天機器人、影像產生器、音樂作曲家,還是資料驅動的分析流程,CometAPI 都能讓您更快地迭代、控製成本,並保持與供應商的兼容性——同時也能充分利用整個 AI 生態系統的最新突破。

開發人員可以訪問 GPT-5 API 透過 CometAPI, 最新型號版本 始終與官方網站同步更新。首先,探索該模型的功能 游乐场 並諮詢 API指南 以獲得詳細說明。造訪前請確保您已經登入CometAPI並取得API金鑰。 彗星API 提供遠低於官方價格的價格,幫助您整合。

準備出發了嗎? → 立即註冊 CometAPI !