Mistral 3 是 Mistral AI 於 2025 年末推出的模型家族的重磅版本。它同時提供面向本地/邊緣部署的緊湊高速模型,以及一款極大型稀疏旗艦模型,將當前最先進的規模與上下文長度推向新高度。本文將說明 Mistral 3 是什麼、如何構建、為何你可能想在本地運行它,以及三種在你的機器或私有伺服器上運行它的實用方法——從 Ollama 的「點擊即運行」便利性,到使用 vLLM/TGI 的生產級 GPU 服務,再到利用 GGUF + llama.cpp 在小型裝置上進行 CPU 推理。

什麼是 Mistral 3?

Mistral 3 是 Mistral AI 最新一代的開源權重模型。該系列同時包含一款巨大的 Mistral Large 3(稀疏的混合專家——MoE——模型),以及多個邊緣/「ministral」變體(3B、8B、14B),針對指令跟隨與多模態(文字+視覺)任務進行調校。Mistral 將此版本定位為廣泛可用:從高性能資料中心推理(提供專門的優化檢查點)到透過量化格式與較小變體在邊緣與筆電上的使用。

Key practical properties :

- 在 Large 3 變體中採用 Mixture-of-Experts (MoE) 架構,具有非常大的「總」參數量,但推理時每個 token 只啟用部分專家——這在大規模下提升效率。

- 一系列 Ministral 3 模型(3B / 8B / 14B),面向邊緣與本地使用,包含指令調校與多模態變體。

- 官方檢查點與一組優化檢查點(NVFP4/FP8),用於如 vLLM 與 NVIDIA 平台等加速執行環境。

- 多模態+多語言+長上下文——ministral 與大型變體都強調圖像+文字理解與廣泛語言覆蓋。對於同時處理圖像與長文檔的應用,這點很重要。

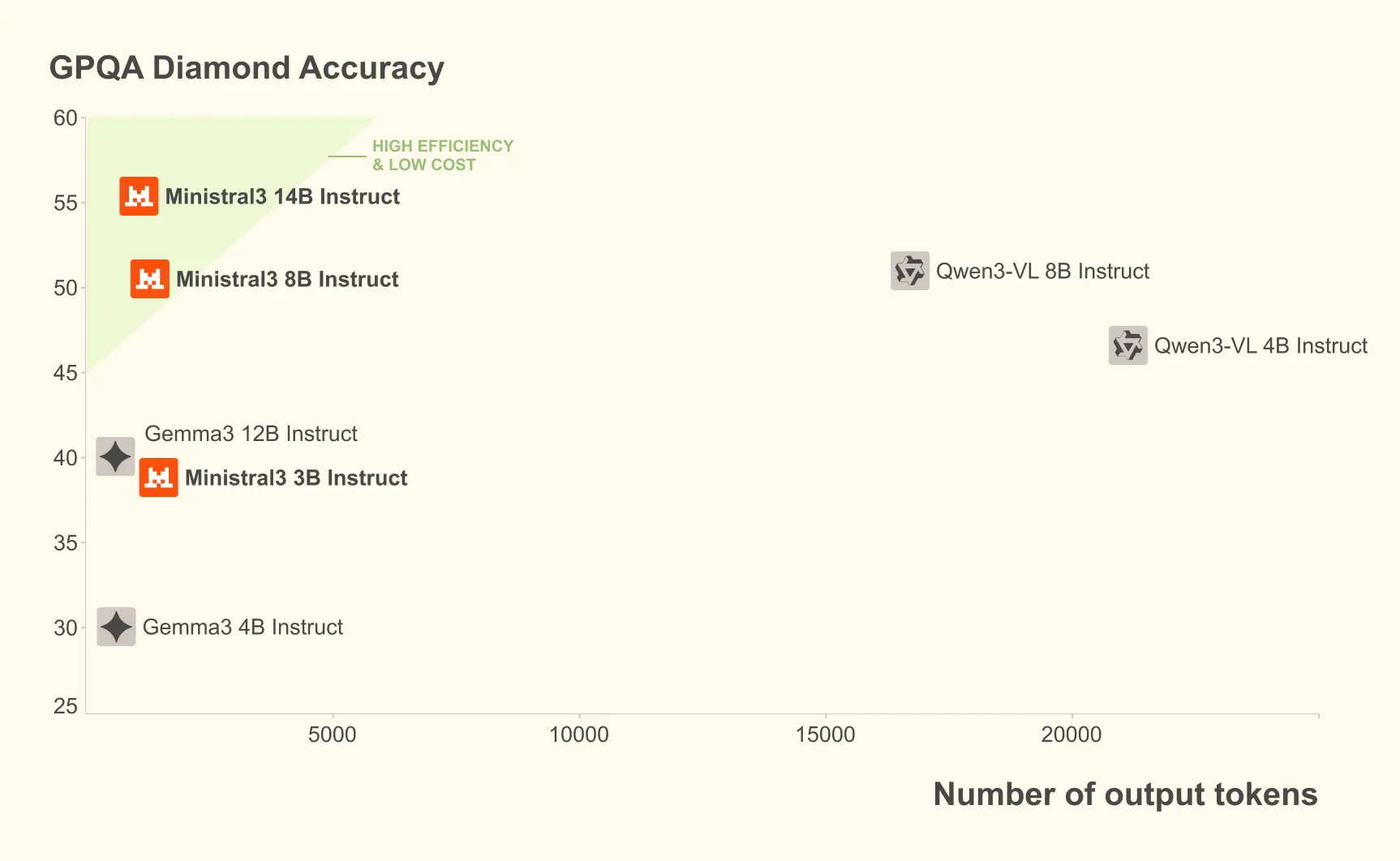

在 GPQA Diamond 數據集(一項嚴格的科學推理測試)上,Miniral 3 的各種變體即使在輸出 token 數增加的情況下依然保持高準確度。例如,Miniral 3B Instruct 模型在處理最多 20,000 個 token 時維持 35–40% 的準確率,與較大的模型(如 Gemma 2 9B)相當,同時使用更少的資源。

Mistral 3 的架構是什麼?

Mistral 3 是一個家族,而非單一架構,但你需要了解的兩種架構模式是:

稠密小模型(Ministral 3)

- 標準 transformer 堆疊,針對效率與邊緣推理進行優化。

- 提供多種尺寸(3B/8B/14B)與不同微調變體:base、instruct、reasoning;許多變體包含原生多模態(視覺+文字)支援與長上下文運作。Minstral 模型在某些發行中以優化的 FP8 權重提供緊湊性。

稀疏混合專家(Mistral Large 3)

- MoE 架構:模型擁有許多專家(總參數量極大),但每個 token 只經過路由選擇的部分專家——這帶來更佳的計算-規模權衡。

- Mistral Large 3 標示總參數約 ~675B,推理期間「活躍」參數約 ~41B,反映其 MoE 設計。該模型在現代 NVIDIA 硬體上訓練,並針對低精度高效執行(NVFP4/TensorRT/大型核心優化)進行了優化。

在本地運行時重要的技術特性:

- 長上下文:部分 Mistral 3 變體支援非常長的上下文(vLLM 文件與 Mistral 文件提到某些變體具有巨大的上下文窗口;例如,部分 Ministral 變體達到 256k)。這會影響記憶體與服務模式。

- 權重格式與量化:Mistral 提供壓縮/優化格式的權重(FP8、NVFP4),並與現代量化工具鏈(BitsAndBytes、GPTQ、供應商工具鏈)協同,用於實用的本地推理。

為什麼要在本地運行 Mistral 3?

在本地運行 LLM 不再是小眾嗜好——對於重視以下方面的團隊與個人而言,這是切實可行的選擇:

- 資料隱私與合規。 本地託管可讓敏感輸入留在你的基礎設施內部(在金融、醫療、法律領域至關重要)。Reuters 報導高端客戶選擇自行託管 Mistral 模型。

- 延遲與成本控制。 針對嚴格的延遲 SLO 與可預測成本,本地或私有叢集推理可以避免雲端 API 帳單爆炸。較小的 ministral 變體與量化格式使其成為現實。

- 自訂與微調。 當你需要自訂行為、函式呼叫或新模態時,本地控制能實現自訂微調與資料處理。Hugging Face 與 vLLM 的整合使這更為即插即用。

如果這些理由符合你的優先事項——隱私、控制、成本可預測性或研究——就值得考慮本地部署。

如何在本地運行 Mistral 3(3 種實用方法)?

在本地運行 Mistral 3 的方式很多。以下介紹三種涵蓋最常見使用場景的方法:

- Ollama(零配置桌面/本地伺服器,對多數使用者而言最容易)

- Hugging Face Transformers + PyTorch/vLLM(完整控制,GPU 叢集)

- llama.cpp/ggml/GGUF 量化 CPU 推理(輕量,於筆電/CPU 運行)

1) 如何使用 Ollama 運行 Mistral 3(最快捷的途徑)?

適用情況: 你希望在本地有無摩擦體驗(macOS/Linux/Windows)、好用的 CLI 或 GUI,並在可用時自動下載/量化工件。Ollama 已為 Ministral 3 與其他 Mistral 家族模型提供條目。

先決條件

- 已安裝 Ollama(遵循 ollama.com 的安裝程式)。Ollama 的資料庫對部分 ministral 版本有最低版本要求。

- 充足的磁碟空間以儲存模型工件(尺寸不同——ministral 3B 的量化版本可能僅數 GB;較大的 BF16 版本可能達數十 GB)。

步驟(示例)

- 安裝 Ollama(macOS 示例——依平台替換):

# macOS (Homebrew) example — see ollama.com for platform-specific installersbrew install ollama

- 運行一個 ministral 模型:

# Pull and run the model interactivelyollama run ministral-3

- 本地提供服務(API)並從程式碼呼叫:

# Run Ollama server (default port shown in docs)ollama serve# Then curl against it (example)curl -s -X POST "http://localhost:11434/api/v1/generate" \ -H "Content-Type: application/json" \ -d '{"model":"ministral-3","prompt":"Summarize Mistral 3 in one sentence."}'

注意與提示

- Ollama 會負責模型下載,並在可用時提供本地量化變體——對快速試用模型非常方便。

- 若計畫在生產中承載高並發請求,Ollama 非常適合原型設計,但請評估在穩定負載下的擴展與資源編排。

2) 如何使用 Hugging Face Transformers 運行 Mistral 3(GPU/vLLM 整合)?

適用情況: 你需要研究或生產的程式化控制、想要微調,或希望在 GPU 叢集上使用像 vLLM 這樣的加速推理框架。Hugging Face 提供 Transformers 支援,Mistral 則為 vLLM/NVIDIA 提供優化檢查點。

先決條件

- 具有足夠記憶體的 GPU(視模型與精度而定)。較小的 Ministral 3(3B/8B)在量化後可於單張中階 GPU 運行;較大的變體需要多張 H100/A100,或在 vLLM 中使用優化的 NVFP4 檢查點。NVIDIA 與 Mistral 文件對大型模型推薦了特定節點規格。

- Python、PyTorch、transformers、accelerate(若需伺服則可用 vLLM)。

Python 範例——基本 Hugging Face pipeline(3B instruct 變體,GPU):

# Example: CPU/GPU inference with transformers pipeline# Assumes you have CUDA and a compatible PyTorch build.import torchfrom transformers import pipelinemodel_name = "mistralai/Ministral-3-3B-Instruct-2512-BF16" # example HF model idgenerator = pipeline( "text-generation", model=model_name, device_map="auto", torch_dtype=torch.bfloat16, # use bfloat16 if your hardware supports it)prompt = "Explain how attention helps transformers, in 3 sentences."out = generator(prompt, max_new_tokens=120, do_sample=False)print(out[0]["generated_text"])

使用 vLLM 進行生產級 GPU 推理

vLLM 旨在高效服務大型模型,支援 Mistral 3 家族,且 Mistral 發布了為 vLLM/NVIDIA 硬體優化的檢查點(NVFP4/FP8),以降低記憶體占用並加速。啟動 vLLM 伺服器可提供低延遲、批量化的推理端點。請參閱 vLLM 的示例與 Mistral 指引以獲取模型路徑與推薦旗標。

注意與提示

- 在生產環境中,優先使用優化檢查點(NVFP4/FP8),並部署於推薦的 GPU(例如 H100/A100),或使用支援張量/模型並行的編排層。Mistral 與 NVIDIA 已提供優化運行時的文件與部落格文章。

- 請始終在磁碟上固定精確的模型檢查點(或可重現的 HF 快照),以保證可重現結果並避免模型靜默更新。

3) 如何在 CPU 上使用 llama.cpp/GGUF 量化模型運行 Mistral 3?

適用情況: 你需要在 CPU 上進行本地、離線推理(例如開發者筆電、嚴格隔離環境),並願意以部分準確度為代價換取運行速度與記憶體效率。此方法使用 ggml/llama.cpp 與 GGUF 量化權重(q4/q5/等)。

先決條件

- Ministral 模型的 GGUF 量化版本(許多社群成員在 Hugging Face 發布 GGUF 量化包,或在本地將 BF16 權重轉為 GGUF)。搜尋

Ministral-3-3B-Instruct的 GGUF 變體。 - 已編譯的 llama.cpp 可執行檔(遵循專案 README)。

量化(如果你有原始權重)——示例(概念性)

# Example: quantize from an FP16/BF16 model to a GGUF q4_K_M (syntax depends on llama.cpp version)./quantize /path/to/original/model.bin /path/to/out.gguf q4_k_m

使用 llama.cpp 運行 GGUF

# run interactive inference with a quantized GGUF model./main -m /path/to/ministral-3-3b-instruct.gguf -t 8 -c 2048 --interactive# -t sets threads, -c sets context (tokens) if supported

Python 客戶端示例(本地 llama.cpp 伺服器或子程序)

你可以將 llama.cpp 作為子程序啟動並傳入提示,或使用小型封裝客戶端。許多社群專案提供圍繞 llama.cpp 的簡單 HTTP 伺服器,用於本地應用整合。

注意與權衡

- 量化降低 VRAM 占用並支援 CPU 推理,但可能在品質上有所下降(視量化格式不同,降幅從輕微到中等)。如 q4_K_M 或 q5 等格式是 CPU 使用的常見折衷。日文與技術文章詳述 Q4/Q5 類型與 GGUF 轉換。

- 對於小到中等工作負載,GGUF + llama.cpp 往往是最便宜且最可攜的本地運行方案。

有哪些硬體與記憶體考量?

簡短、實用的指引:

- 3B 模型: 在量化後通常可於性能不錯的筆電 CPU 或單張 GPU(8–16 GB VRAM,視精度/量化而定)運行。GGUF 的 q4 變體可在許多現代 CPU 上運行。

- 8B 與 14B ministers: 通常需要中階 GPU(例如 24–80 GB,視精度與激活快取而定)或跨多裝置的量化。

- Mistral Large 3(總 675B、活躍 41B): 面向資料中心部署,通常在多 GPU 節點(如 8×A100 或 H100)配合專門格式(NVFP4/FP8)透過 vLLM 運行最佳。Mistral 明確發布了優化檢查點,使此類部署更可行。

若你的優先事項是本地筆電使用,請選擇 ministral 3B 的量化 GGUF + llama.cpp 路線。若你的優先事項是生產吞吐量,請在 GPU 上使用 vLLM + NVFP4 檢查點。若你想要易於試驗,Ollama 是最快上手的選擇。

該如何選擇量化與精度?

量化是一種權衡:記憶體與速度對比原始模型品質。常見選項:

- q4_0 / q4_1 / q4_K_M: 用於 CPU 推理的熱門 4-bit 選擇;q4_K_M(k-means 變體)通常在品質/性能間提供更佳平衡。

- q5 / q8 / imatrix 變體: 中間格式,在更大的尺寸代價下可能保留更多保真度。

- FP16 / BF16 / FP8 / NVFP4: GPU 精度——BF16 與 FP16 是現代 GPU 上常見的訓練/推理精度;FP8 / NVFP4 是新興格式,能為超大模型節省記憶體,並受優化運行時與 Mistral 的檢查點支持。

經驗法則: 對本地 CPU 運行選擇 q4_K_M 或類似格式;對高保真度的 GPU 推理使用 BF16/FP16,或在運行時支持的情況下使用供應商特定的 FP8/NVFP4。

結論——是否應該在本地運行 Mistral 3?

如果你需要隱私、低延遲或自訂,答案是肯定的:Mistral 3 家族提供廣泛選項——從可在邊緣 CPU 上運行的小模型,到可在單張 GPU 或小型叢集上運行的中型模型,再到面向資料中心規模的大型 MoE 風格——而生態(Ollama、Hugging Face、vLLM、llama.cpp)已支持務實的本地與私有部署模式。Mistral 也與 NVIDIA 與 vLLM 合作提供優化檢查點,以提升吞吐並降低記憶體占用,使生產自託管比以往更為可行。

要開始,探索更多模型(例如 Gemini 3 Pro)的能力,並參考 API 指南 以獲取詳細說明。存取前,請確保你已登入 CometAPI 並取得 API 金鑰。CometAPI 提供遠低於官方價格的方案,助你完成整合。

準備好了嗎?→ 立即註冊 CometAPI !