LobeChat 和 CometAPI 是開放 AI 生態系統中兩個快速發展的項目。 2025 年 XNUMX 月,LobeChat 合併了 CometAPI 提供者的完整集成,使用戶能夠直接從 LobeChat 呼叫 CometAPI 統一且相容 OpenAI 的端點。本文介紹了 LobeChat 和 CometAPI 的含義、整合它們的原因、整合和配置的逐步指南(包括可立即使用的 TypeScript 提供者基礎配置)、運行時範例、具體用例以及有關成本、可靠性和可觀察性的生產技巧。

什麼是 LobeChat?它提供哪些功能?

LobeChat 是一個開源的現代聊天框架,旨在託管多提供者 LLM 聊天應用程序,並配備完善的 UI 和部署工具。它支援多模式輸入(文字、圖像、音訊)、知識庫/RAG 工作流程、分支對話和「思路鏈」視覺化,以及一個可擴展的提供者/插件系統,讓您無需重新架構應用程式即可切換不同的模型後端。 LobeChat 的文件和程式碼庫將其描述為一個可用於自託管和雲端部署的生產級框架,具有環境驅動的配置和第三方 MCP(模型控制平面)整合市場。

LobeChat 主要功能一覽

- 多提供者支援(OpenAI、Anthropic、Google Gemini、Ollama 等)。

- RAG 工作流程(文件、PDF、音訊)的文件上傳 + 知識庫。

- 透過環境變數和設定 URL 導入進行開發友好配置。

- 可擴展的運行時:提供者配置了小型適配器運行時,因此新的後端是可插入的。

CometAPI 是什麼?

CometAPI 是一個統一的 AI 存取層,透過一個相容於 OpenAI 的 API 接口,開放來自眾多底層提供者的 500 多個模型。它旨在讓開發者根據效能、成本或功能選擇模型端點,而無需鎖定任何模型,並實現計費、路由和存取的集中化。 CometAPI 提供統一的聊天/完成端點,以及一個用於發現可用模型 ID 的模型清單 API。

CometAPI 為何對團隊具有吸引力

- 模型選擇和可移植性: 無需顯著改變整合程式碼即可在許多尖端模型之間切換。

- OpenAI 相容端點: 許多需要 OpenAI 風格 HTTP 端點的客戶端庫和框架可以透過更改基本 URL + 身份驗證來與 CometAPI 配合使用。 (實際範例顯示

https://api.cometapi.com/v1/作為與 OpenAI 相容的表面。 ) - 開發人員文件和整合: CometAPI 發布了與 LlamaIndex 等工具和其他低程式碼平台整合的文件和逐步指南。

為什麼要將 CometAPI 整合到 LobeChat 中?

簡短的回答: 靈活性、成本控制和快速取得新模型LobeChat 的建置理念是與提供者無關;在連接 CometAPI 後,您的 LobeChat 部署能夠透過相同程式碼路徑呼叫多個不同的模型——無需更改 UI 或提示流程,即可根據吞吐量、延遲、成本或功能切換不同的模型。此外,社群和維護人員也積極為 LobeChat 添加 CometAPI 提供者支持,使整合更加順暢。

商業和技術優勢

- 無需程式碼變更即可實現模型多樣性。 需要評估 Gemini、Claude 或某個小眾影像模型嗎? CometAPI 可以透過單一 API 公開這些模型 ID。這減少了 LobeChat 中每個提供者的管道工作量。

- 成本優化。 CometAPI 讓您可以動態路由到更便宜的模型或選擇更低成本的供應商,這可以大幅降低大容量部署的每次對話成本。

- 更簡單的秘密管理。 在 LobeChat 的設定或 Docker 環境中,只需一個 API 金鑰即可管理,無需使用多個提供者金鑰。 LobeChat 平台已支援透過以下方式啟用供應商

ENABLED_<PROVIDER>以及提供者密鑰環境變數模式,因此整合在操作上是一致的。 - 保持 LobeChat 程式碼庫最小化:提供者邏輯被封裝並使用環境變數進行配置。

如何在 LobeChat 中設定和整合 CometAPI?

本節提供可操作的逐步指南:取得金鑰、設定環境變數、將提供者新增至 LobeChat(提供程式設定範例)以及顯示執行時間使用情況(聊天呼叫)。這些範例遵循 LobeChat 的提供者模式以及與 CometAPI OpenAI 相容的端點。

1)取得 CometAPI 帳戶和 API 金鑰

在 CometAPI 註冊並開啟 API 控制台。要註冊 CometAPI 帳戶,您需要使用電子郵件地址或直接使用 Google One-Click 登入。

完成報名後,進入playground點選add new secret key建立新的API key:

取得 API 金鑰。

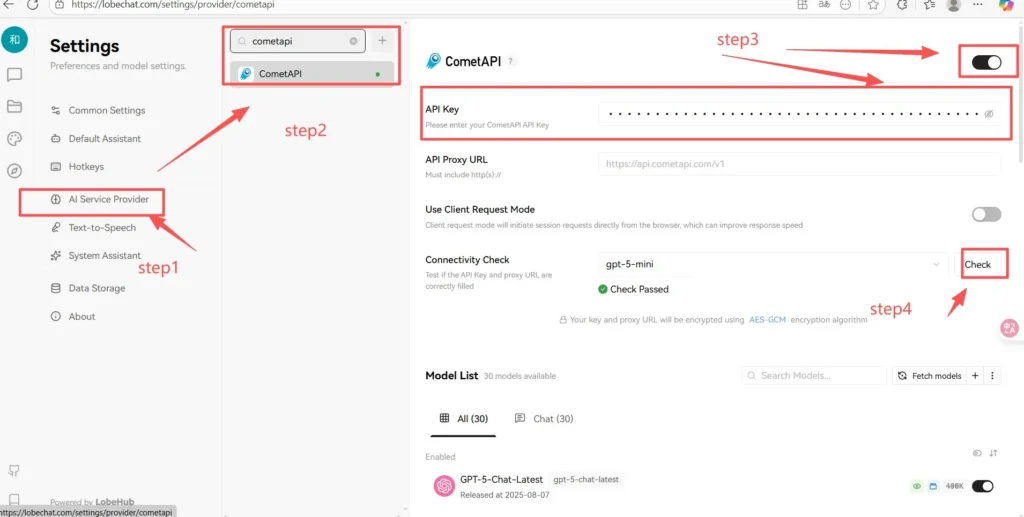

2)在 LobeChat 中設定 CometAPI

- 進入Lobe-Chat設定選單,點選頭像,點選應用設定選項。

- 選擇 cometapi 作為模型提供者。

- 將 cometapi 的 sk-xxxxx 貼到 API key 輸入框中,打開按鈕,選擇模型進行檢查

3)測試通話

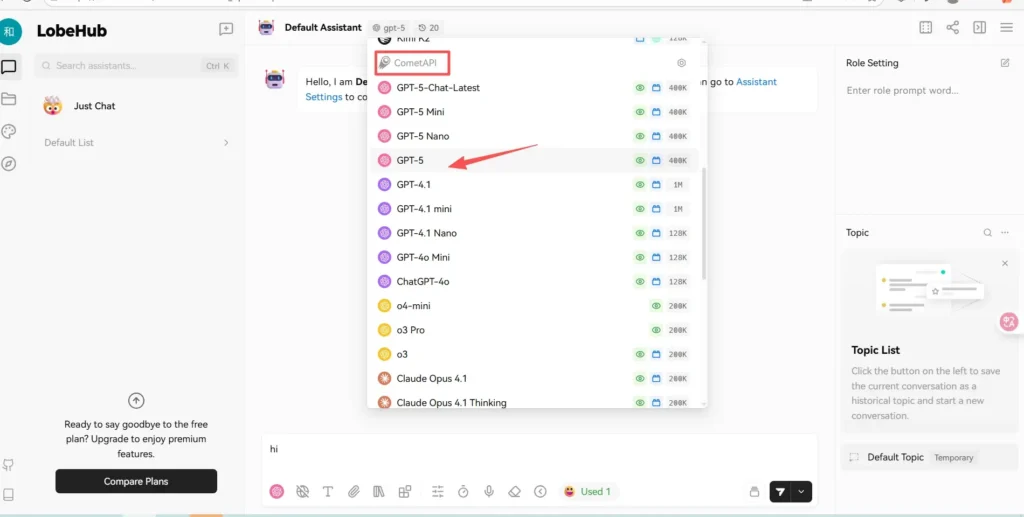

選擇CometAPI的某款機型進行測試,在Lobe-Chat輸入簡單的測試指令。呼叫成功會收到對應的回覆;失敗請檢查配置是否正確或聯絡cometapi線上客服。

目前,cometapi在lobechat上提供了來自各大開發者(openAI、grok、claude、gemini)的30多個最新模型。

如何擴展整合(進階增強)?

想要超越基礎?以下是一些切實可行的後續步驟,可將您的整合從功能級提升到生產級。

增強功能 1:動態模型編排(多模型代理程式)

在 LobeChat 中建立代理邏輯,動態地將子任務分配到不同的 Comet 模型(例如,用於檢索的小型嵌入模型、用於起草的中型模型、用於摘要的高效能模型)。使用 LobeChat 的函數呼叫/插件系統來協調工作流程並彙總最終回應。

增強功能 2:快取嵌入與回應

使用嵌入(用於 RAG)時,只需計算一次嵌入並快取即可減少開銷。如果您呼叫 CometAPI 進行嵌入,請將向量表示儲存在向量資料庫中,並僅在內容變更時重新計算。這可以減少令牌和成本。

增強功能 3:每個租戶的配置和配額

如果您執行的是多租用戶 LobeChat 實例,請編寫一個中介軟體,將租用戶 ID 對應到允許的模型清單(使用 CometAPI 模型 ID),從而控制每個租用戶的限制(每小時請求數、模型層級)。這可以使高階層級的使用者能夠存取更優的模型。

增強功能 4:使用模型元資料和健康檢查

實施提供者健康檢查,調用輕量級 CometAPI“模型 ping”或最小聊天調用,以確保延遲在 SLA 範圍內;否則,優雅地回退模型。保持心跳監控並在 LobeChat 管理介面中顯示提供者狀態。

您應該注意哪些陷阱?

- API 金鑰暴露:切勿將 CometAPI 金鑰儲存在客戶端程式碼中。請務必將其保存在伺服器端(LobeChat 的服務層)。

- 模型名稱漂移:CometAPI 可能會新增或棄用模型 ID。請使用伺服器映射並更新

COMETAPI_MODEL_LIST當你想要展示新模型。 - 回應格式差異:儘管 CometAPI 旨在實現 OpenAI 相容性,但某些模型或元欄位可能有所不同;在向使用者顯示回應之前,請務必對其進行對應和清理。

入門

CometAPI 是一個統一的 API 平台,它將來自領先供應商(例如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等)的 500 多個 AI 模型聚合到一個開發者友好的介面中。透過提供一致的身份驗證、請求格式和回應處理,CometAPI 顯著簡化了將 AI 功能整合到您的應用程式中的過程。無論您是建立聊天機器人、影像產生器、音樂作曲家,還是資料驅動的分析流程,CometAPI 都能讓您更快地迭代、控製成本,並保持與供應商的兼容性——同時也能充分利用整個 AI 生態系統的最新突破。

首先,探索該模型的功能 游乐场 並諮詢 API指南 以獲得詳細說明。造訪前請確保您已經登入CometAPI並取得API金鑰。 彗星API 提供遠低於官方價格的價格,幫助您整合。

準備出發了嗎? → 立即註冊 CometAPI !

結論

將 CometAPI 整合到 LobeChat 是一種切實可行的方法,它不僅可以實現模型多樣性、成本靈活性和快速實驗能力,還能保留 LobeChat 提供的完整的使用者體驗和 RAG 功能。 LobeChat 社群已經大力推動添加 CometAPI 支援(提供者卡、模型清單、運行時適配器、測試和文件),您可以直接利用這些支持,也可以將其作為靈感,根據特定需求實現自訂適配器。如需最準確的整合步驟和最新範例,請參閱 CometAPI 的文件和 LobeChat 模型提供者文檔 和 repo——下面引用的連結將幫助您繼續。